HA搭建

下载zookeeper

HA配置

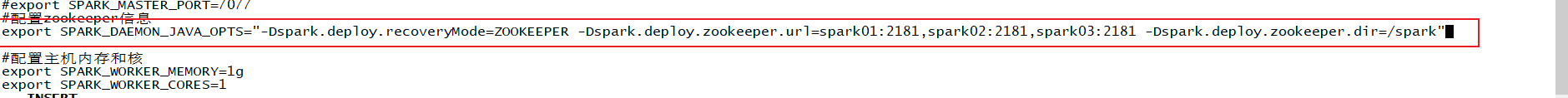

修改spark-env.sh配置

将下图之前配置好的的主节点信息注释

并加上

export SPARK_DAEMON_JAVA_OPTS="-Dspark.deploy.recoveryMode=ZOOKEEPER -Dspark.deploy.zookeeper.url=spark01:2181,spark02:2181,spark03:2181 -Dspark.deploy.zookeeper.dir=/spark"

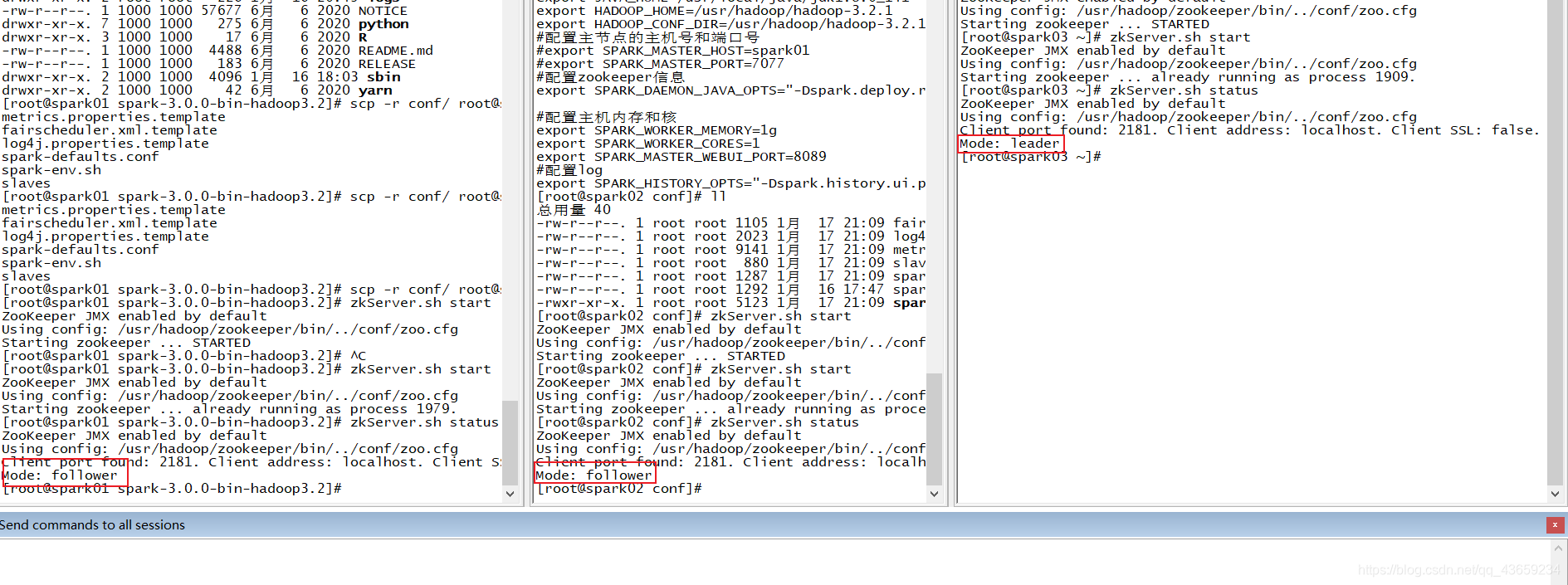

将修改好的文件分发给另外两台虚拟机

[root@spark01 spark-3.0.0-bin-hadoop3.2]# scp -r conf/ root@spark02:/usr/spark/spark-3.0.0-bin-hadoop3.2/

[root@spark01 spark-3.0.0-bin-hadoop3.2]# scp -r conf/ root@spark03:/usr/spark/spark-3.0.0-bin-hadoop3.2/

三台虚拟机启动zookeeper

zkServer.sh start

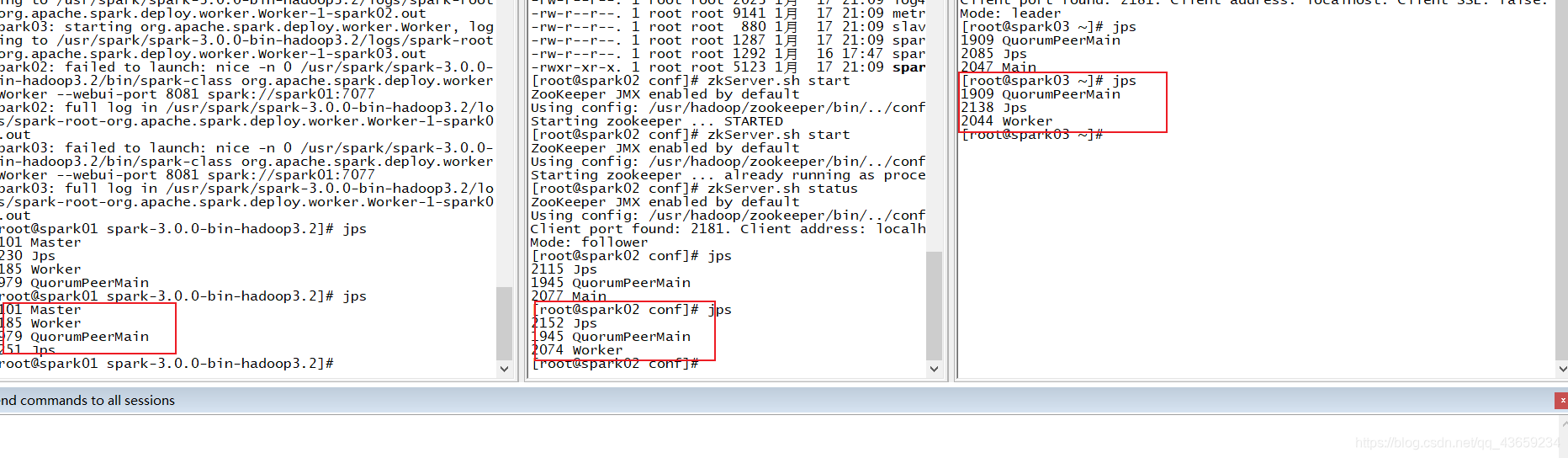

启动spark集群start-all-spark.sh

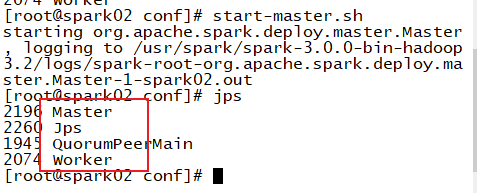

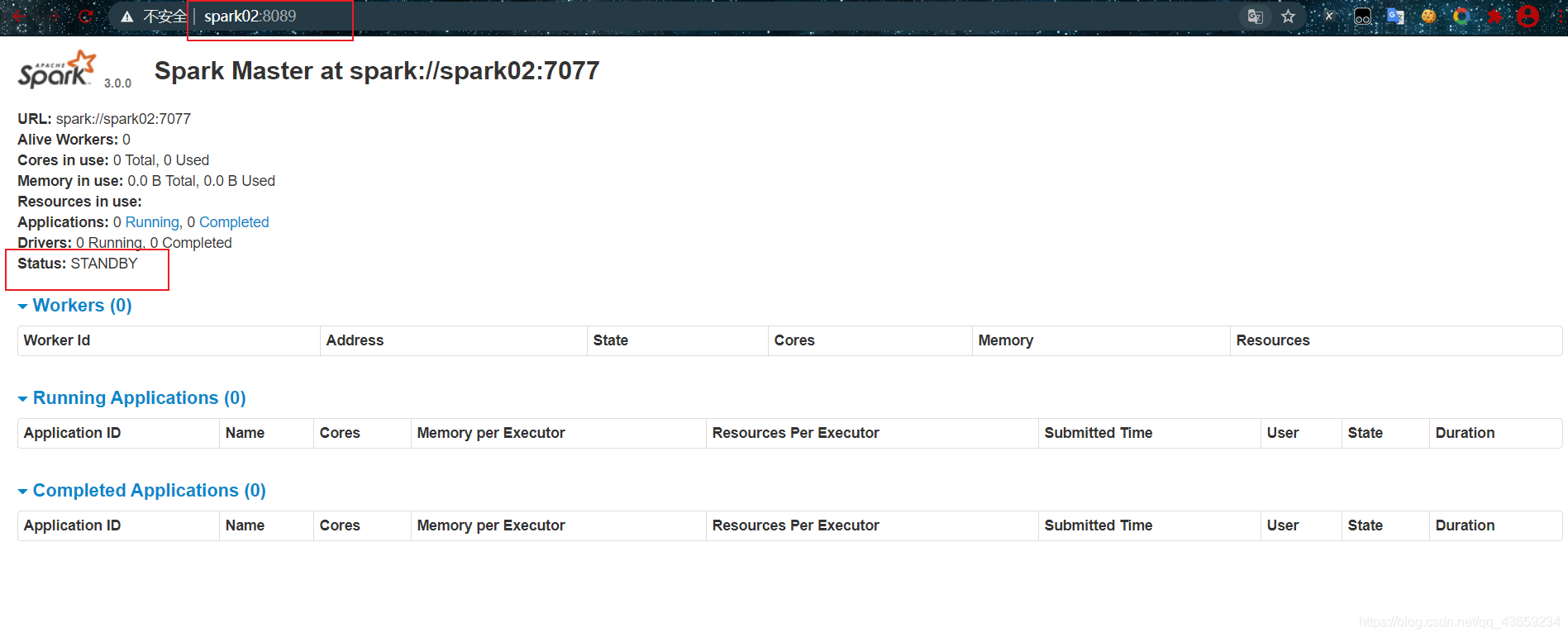

在spark02上再启动start-master.sh

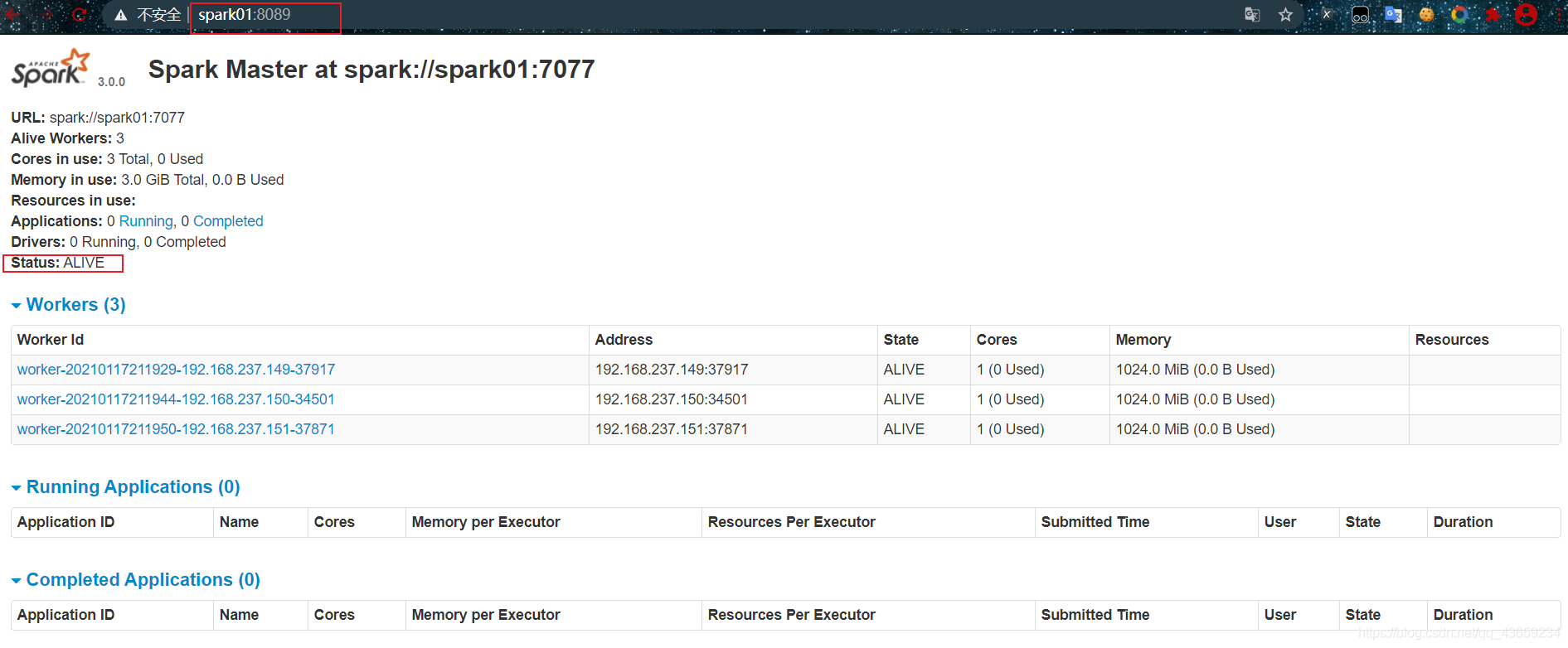

UI查看

访问UI界面进行查看

141

141

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?