一、环境搭建及Stable-Diffusion-Webui

系统配置

学校的云计算平台(Linux系统)(CPU 1核,GPU 0.5卡,内存 20G)、Xftp7

基础环境配置

配置python3.10环境,<env_name>为设定的环境名称

conda create -n <env_name> python=3.10 ipykernel

激活环境

source activate <env_name>

将环境写入Notebook的Kernel里

python -m ipykernel install --user --name <env_name> --display-name "<env_name>"

重启实例,可以看到自己创建的py3.10环境,打开Terminal,安装git

conda install git

正式部署Stable Diffusion

激活环境

source activate <env_name>

确认git版本,最好是2.XX

下载代码

git clone https://github.com/AUTOMATIC1111/stable-diffusion-webui.git

进入目录

cd stable-diffusion-webui

安装依赖

pip config set global.index-url https://mirrors.aliyun.com/pypi/simple/

pip install -r requirements_versions.txt

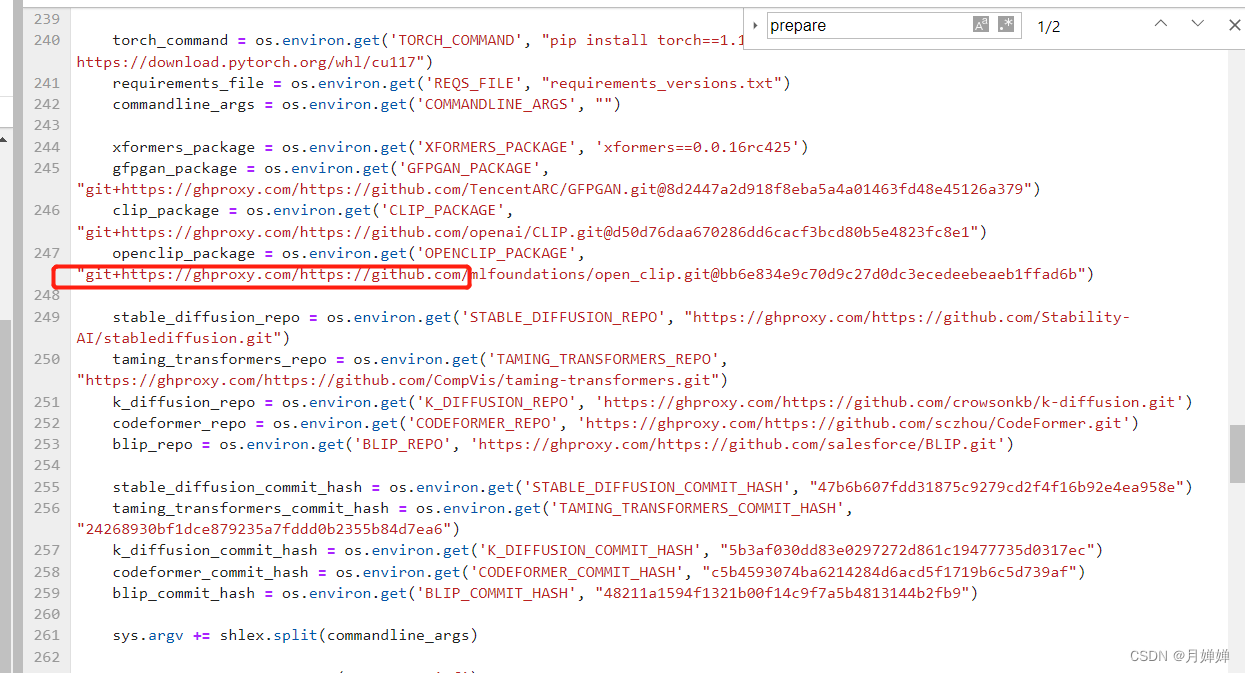

打开stable-diffusion-webui/launch.py,找到prepare_函数,把里面所有的“https://github.com”替换为“https://ghproxy.com/https://github.com”,利用Ghproxy进行代理,加速国内Git

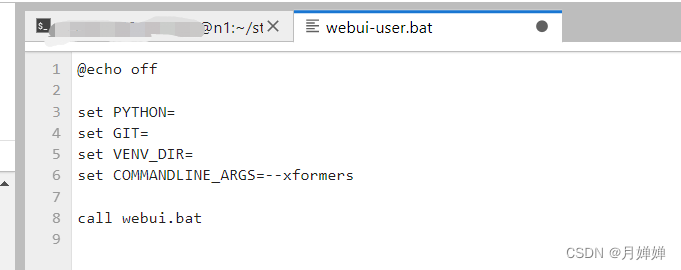

打开目录下的webui-user.bat,在图示位置增加--xformers,虽然对于我遇到的--xformers Cannot import xformers 报错好像没什么用,但谁知道对其他朋友有没有用呢?

启动程序

./webui.sh

遇到报错尝试根据Command,直接利用git下载,比如:

git clone https://xx.git

下载完之后继续重复上述操作

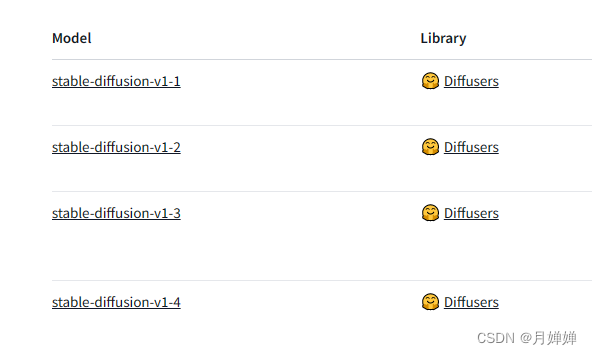

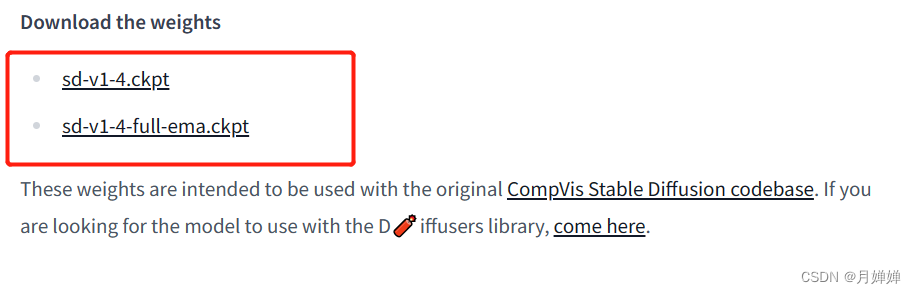

如果提示没有主模型checkpoint,去官网下载主模型

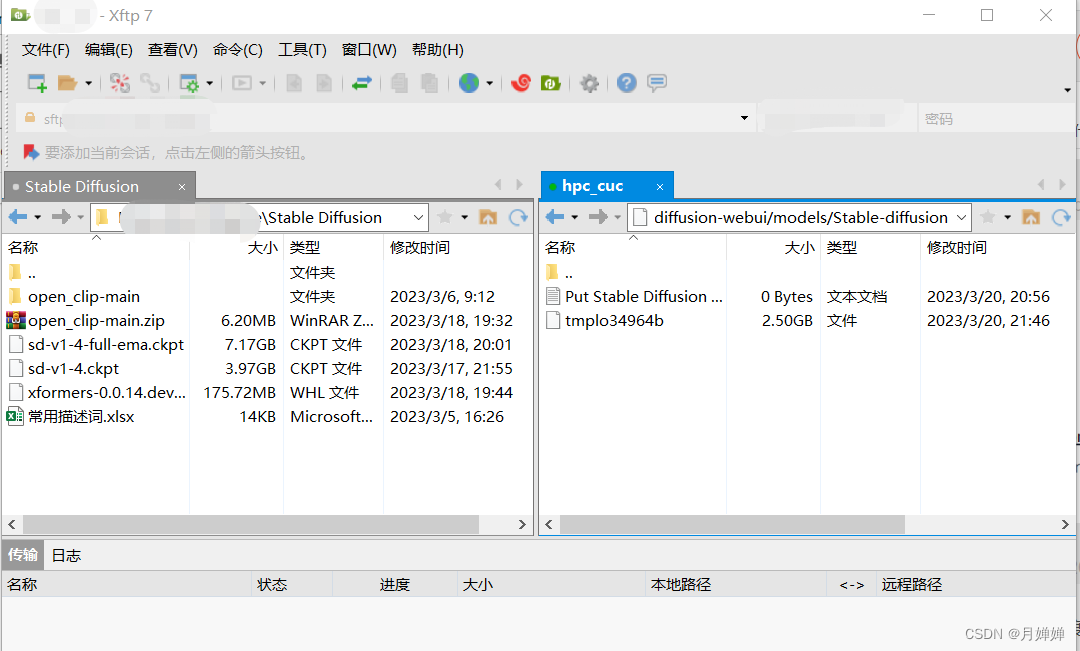

sd-v1-4为半精度,大概4G,sd-v1-4-full-ema为单精度,大概7G,我是先下载到本地,再通过xftp连接到云平台进行上传到下面这个位置:

/home/XXXX/stable-diffusion-webui/models/Stable-diffusion/

我装第二次的时候 (谁知道我个憨憨为什么不小心把文件夹删了还找不回来呢) ,非常顺利,没有提示open_clip的问题,还自动给我安装了v1-5的主模型(咱就是说很玄学)

至于xformers说没安装的问题,其实也不影响运行,只是个警告⚠而已。。。

open_clip的问题,我也找到解决方法,可供参考👇

直接去github把open_clip下载到stable-diffusion-webui/目录下面,注意是/src/open_clip这里的open_clip

等到显示了一个local URL之后,输入./webui.sh --share再跑一下,就能有个public URL,粘贴到浏览器就可以使用了,手机电脑都能运行(只要云平台不关机)

二、Stable-Diffusion-Webui使用手册

-

模型调整(改变风格、优化人体形态等等),网上有很多公开的ckpt文件,把它们传到上面主模型位置处就行,使用的时候,通过切换Stable

Diffusion checkpoint即可更换模型 -

prompt提示词参考网站:https://lexica.art/

-

推荐大佬博客《模型应用—使用Stable Diffusion UI手册》

-

推荐大佬博客《使用stable-diffusion-webui部署NovelAi/Stable Diffusion 保姆级教程、命令解释、原理讲解(colab、windows、Linux )》

-

界面使用(目前我探索的还比较有限,会进一步跟进理论知识学习)

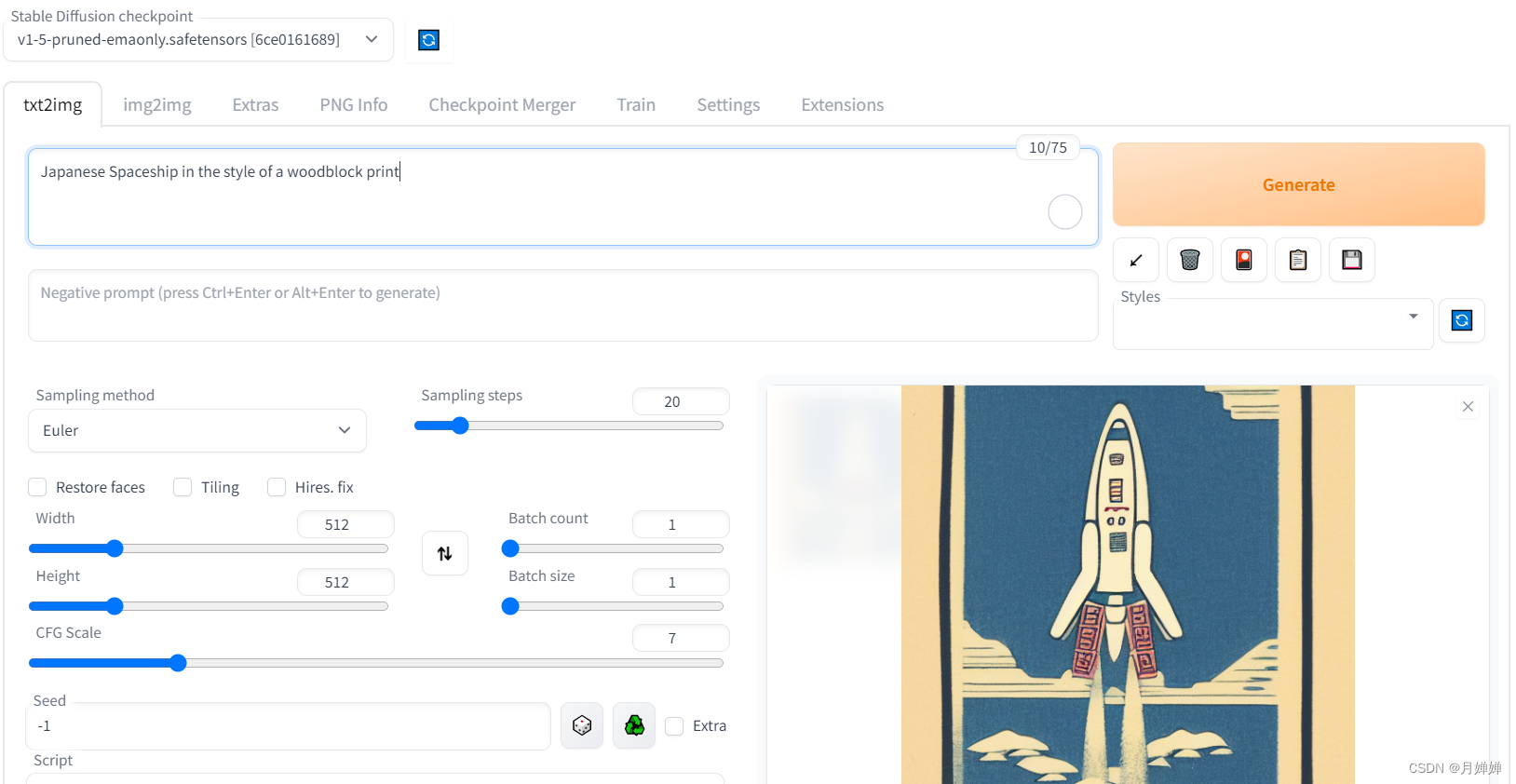

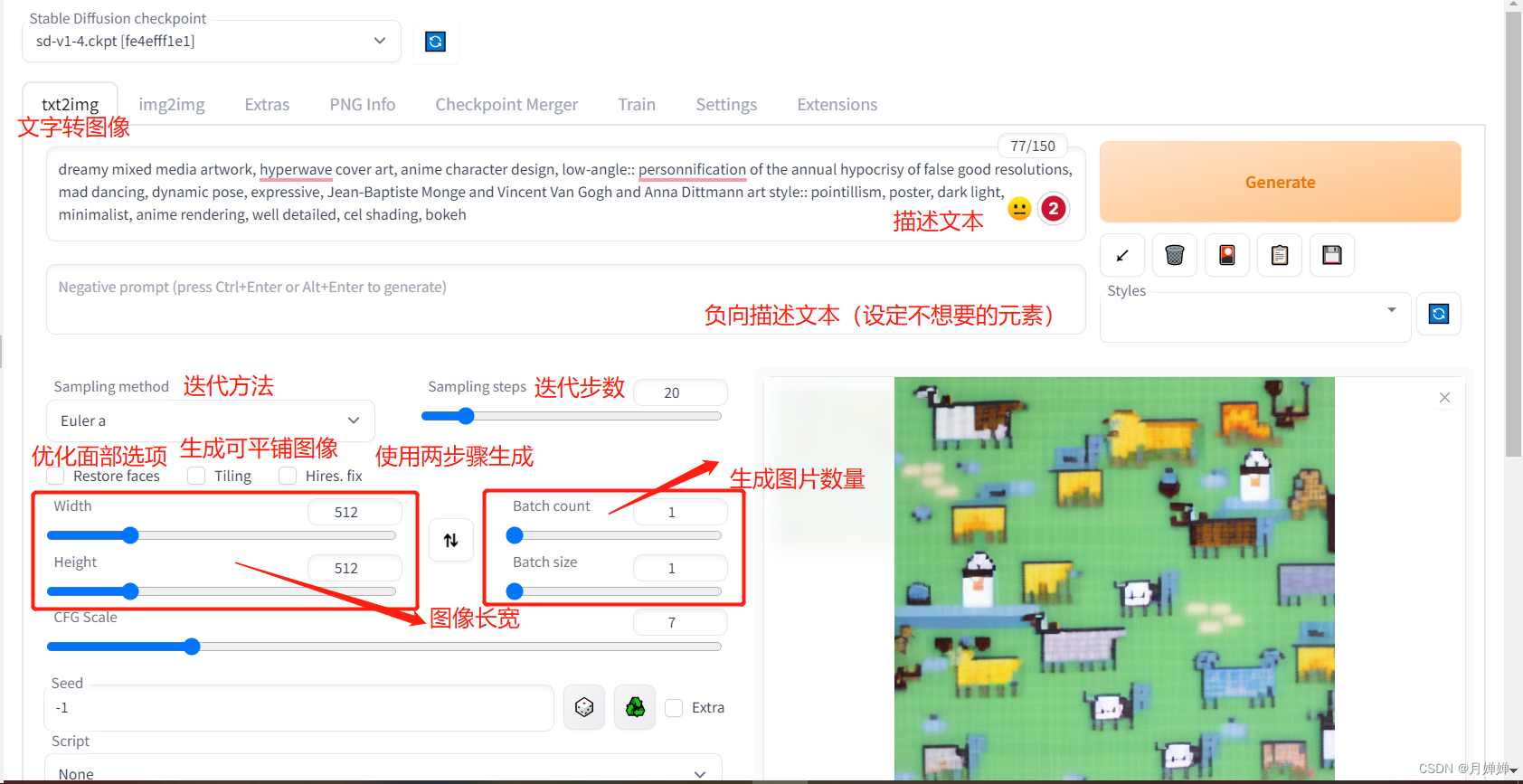

txt2img — 标准的文字生成图像,具体参考下图所示;

img2img — 根据图像成文范本、结合文字生成图像,增加要模仿的图像,参数设置输出图片尺寸、与原图一致性程度

Extras — 优化(清晰、扩展)图像;

PNG Info — 图像基本信息

Checkpoint Merger — 模型合并

Textual inversion — 训练模型对于某种图像风格

Settings — 默认参数修改

三、参考链接

- https://blog.csdn.net/weixin_45569617/article/details/126873709

- https://blog.csdn.net/qq_52360013/article/details/127661249

- https://zhuanlan.zhihu.com/p/569663856

- https://www.douban.com/note/845051967/?_i=9139642RrDlhSY,9316584ryzr_Rz

- https://blog.csdn.net/qq_40902709/article/details/128152329

- https://github.com/Sygil-Dev/sygil-webui/issues/1430

- https://www.bilibili.com/read/cv21987039

- https://www.bilibili.com/read/cv19991459?spm_id_from=333.976.0.0

- https://zhuanlan.zhihu.com/p/574200991

- https://www.bilibili.com/read/cv19991459/

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?