数学基础:概率论乘法法则

两个事件相互独立:P(A∩B) = P(A)×P(B)

· 意思是事件A和事件B同时发生的概率 = 事件A发生的概率 × 事件B发生的概率

· · 举个栗子:掷两枚硬币硬币同时立着的概率 = 掷一枚硬币立着的概率 × 再掷一枚

· · 硬币立着的概率。

两个事件非独立:P(A∩B) = P(A)×P(B|A) = P(B)×P(A|B)

· 意思是事件A和事件B同时发生的概率 = 事件A发生的概率 × 在事件A发生的概率下事

· 件B发生的概率 = 事件B发生的概率 × 在事件B发生的概率下事件A发生的概率。

熵的概念

熵的非形式化概念

随机事件的不确定性,在密码学中将不确定性予以量化,并用熵来表示其不确定性的程度,值越大,不确定性越高,值为0时,为确定性事件。

熵是所包含的未知信息量。(某个事件的未知信息量越大,其不确定性就越大,对应的其熵值就越大)

熵的形式化概念

设事件X有x1、x2、x3、… 、xn共n中可能的结果,称为“自信息量”,记为I(xi)

I

(

x

i

)

=

−

log

2

P

(

x

i

)

(

发

生

的

概

率

P

越

大

信

息

量

I

就

会

越

小

)

I(x_i)=-\log_2P(x_i)(发生的概率 P 越大信息量 I 就会越小)

I(xi)=−log2P(xi)(发生的概率P越大信息量I就会越小)

自信息量的 数学期望1就是事件X的熵,记作

H

(

X

)

H(X)

H(X)公式为:

H

(

X

)

=

∑

i

=

1

n

[

P

(

x

i

)

×

I

(

x

i

)

]

=

−

∑

i

=

1

n

[

P

(

x

i

)

×

log

2

P

(

x

i

)

]

H(X) = \sum_{i=1}^n[P(x_i)×I(x_i)]= -\sum_{i=1}^n[P(x_i)×\log_2P(x_i)]

H(X)=i=1∑n[P(xi)×I(xi)]=−i=1∑n[P(xi)×log2P(xi)]

如果结果x1 ··· xn的发生概率相等,则

I

(

x

i

)

I(x_i)

I(xi)的 数学期望1也就是H(X)的关系为

H

(

X

)

=

I

(

x

i

)

H(X) = I(x_i)

H(X)=I(xi)

因此熵就是各个事件信息量的平均值。

熵 联合熵 条件熵

熵: 0 ≤ H ( X ) = − ∑ i = 1 n [ P ( x i ) log 2 P ( x i ) ] ≤ log 2 n 0\leq H(X)=-\sum_{i=1}^n[P(x_i)\log_2P(x_i)]\leq \log_2n 0≤H(X)=−∑i=1n[P(xi)log2P(xi)]≤log2n

联合熵:

假设X和Y是 相互独立 的两个事件,X和Y同时出现的事件xiyj有 i×j 种结果,则XY同时出现的熵值为:

H

(

X

,

Y

)

=

−

∑

i

=

1

n

∑

j

=

1

m

P

(

x

i

,

y

j

)

log

2

P

(

x

i

,

y

i

)

H(X,Y)=-\sum_{i=1}^n \sum_{j=1}^mP(x_i,y_j)\log_2P(x_i,y_i)

H(X,Y)=−i=1∑nj=1∑mP(xi,yj)log2P(xi,yi)

条件熵:

事件Y发生的条件下,事件X的熵值

H

(

X

∣

Y

)

−

∑

i

=

1

n

∑

j

=

1

m

P

(

x

i

,

y

j

)

log

2

P

(

x

i

∣

y

i

)

H(X|Y)-\sum_{i=1}^n \sum_{j=1}^mP(x_i,y_j)\log_2P(x_i|y_i)

H(X∣Y)−i=1∑nj=1∑mP(xi,yj)log2P(xi∣yi)

p ( x i , y j ) p(x_i,y_j) p(xi,yj)表示 xi,yj 结果同时发生的概率

p ( x i ∣ y j ) p(x_i | y_j) p(xi∣yj)表示 xi 在 yj 发生的情况下发生的概率

假设X和Y是 不独立 的两个事件,X和Y同时出现的事件xiyj也会有 i×j 种结果,则XY同时出现的熵值为,

定理:

H

(

X

,

Y

)

=

H

(

X

)

+

H

(

Y

∣

X

)

H(X,Y)=H(X)+H(Y|X)

H(X,Y)=H(X)+H(Y∣X) (X,Y)不独立

推论:

- H ( X , Y ) ≤ H ( Y ) + H ( X ∣ Y ) H(X,Y)\leq H(Y)+H(X|Y) H(X,Y)≤H(Y)+H(X∣Y) (当X,Y独立时等号成立)

- H ( X ∣ Y ) ≤ H ( X ) H(X|Y)\leq H(X) H(X∣Y)≤H(X) (当X,Y独立时等号成立)

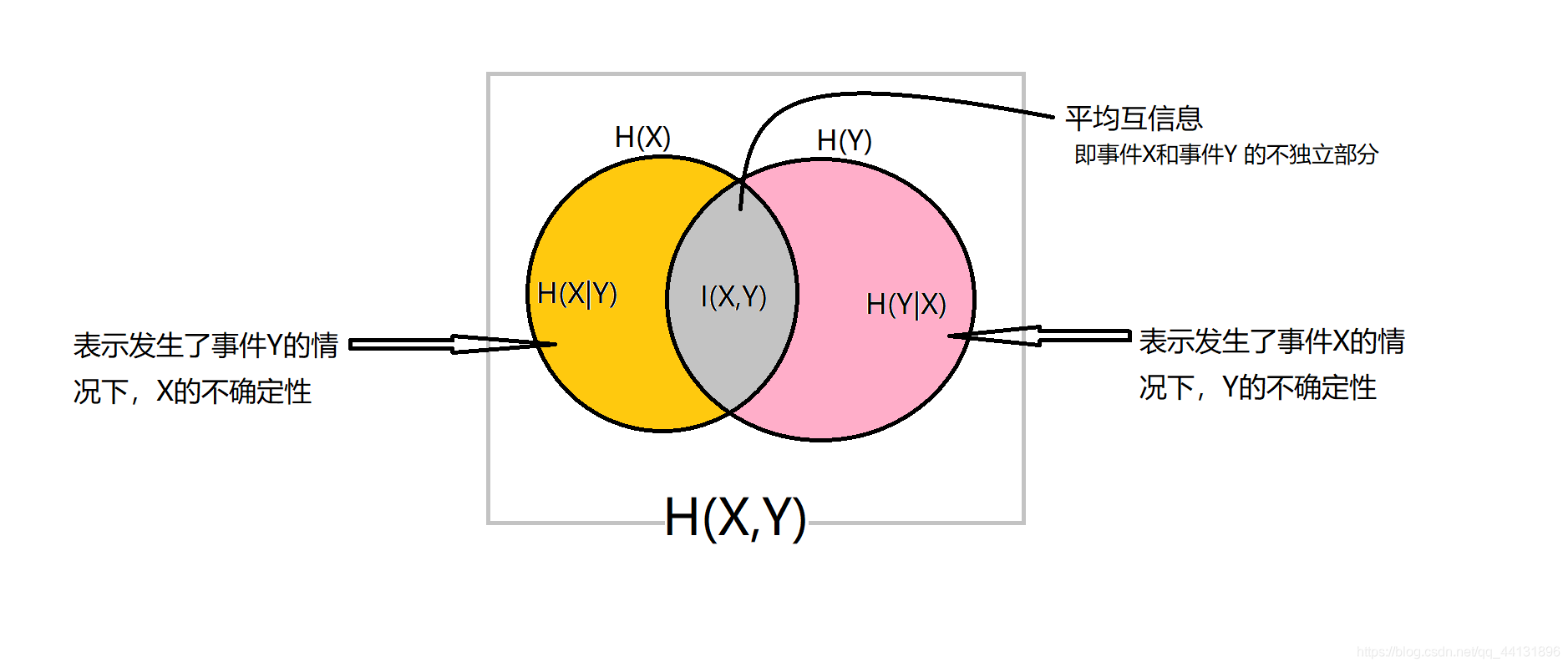

平均互信息

度量两个事件之间的相关性,用 I ( X ; Y ) I(X;Y) I(X;Y)表示

由图可知其有以下几条性质:

- I ( X ; Y ) = I ( Y ; X )

- I ( X ; Y ) ≥ \geq ≥ 0 (当X,Y相互独立时为0)

- I ( X ; Y ) ≤ \leq ≤ H(X)或者 ≤ \leq ≤ H(Y) (仅当X与Y相同时等号成立)

- I(X;Y)=H(X)-H(X|Y)

- I(X;Y)=H(Y)-H(Y|X)

- I(X;Y)=H(X)+H(Y)-H(Y∪X)

本篇仅说明了,熵的概念,以及熵的一些性质,和平均互信息的性质。之后会介绍熵这个概念应用于密码学的信息理论之中,在信息论中,命名为信息熵。用于抽象出密码学的本质,并以形式化的方式予以描述。

855

855

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?