简介

Scrapy是用纯Python实现一个为了爬取网站数据、提取结构性数据而编写的应用框架,用途非常广泛。Scrapy用途广泛,可以用于数据挖掘、监测和自动化测试。Scrapy吸引人的地方在于它是一个框架,任何人都可以根据需求方便的修改。它也提供了多种类型爬虫的基类,如BaseSpider、sitemap爬虫等,最新版本又提供了web2.0爬虫的支持。

数据流程图

各组件功能

-

引擎(Scrapy ENGINE)----------用来处理整个框架系统的数据流处理,触发事务(框架核心)

-

调度器(Scheduler)-------------- 接收引擎发送的请求,把请求放入队列中,在引擎再次请求的时候返回,可以理解为一个url的优先队列,由它来决定下一个抓取的网址是什么,同时去除重复的网址

-

爬虫(Spider)-----------------------爬虫主要是干活的,用来从特定的网页中提取自己需要的信息,即所谓的实体(ITEM),用户可以从中提取出链接,Scrapy爬取下一个页面的信息

-

下载中间件(Downloader MiddlerWares)----------位于ENGINE和下载器之间的框架,其实就是类,用来处理引擎和下载器之间的请求和响应

-

爬虫中间件(Soider MiddlerWares)------------------位于ENGINE和爬虫之间的框架,也是类,用来处理spider的响应输入和请求输出

-

项目管道(Pipline)---------------- 负责处理爬虫从网页里面抽取的实体,主要功能是持久化实体,验证实体的有效性,清除不需要的信息,将生成好的新的请求发送给调度模块,并请求下一个请求

Scrapy运行流程

1,引擎从调度器中提取出一个链接url,用于接下来的爬取

2,引擎将链接url封装成一个请求(Request)传给下载器

3,下载器将资源下载下来,封装成应答包(Response),传给引擎

4,Spider爬虫解析Response

5,解析出里面的实体(ITEM),则交给实体管道进行进一步的处理

6,解析出里面的链接(URL),则把URL交给调度器等待抓取

Scrapy安装

-windows

官方推荐用anaconda

-自定义安装

-1.https://www.lfd.uci.edu/~gohlke/pythonlibs/下载对应的twisted ,注意python的版本和32/64

-2.再pip安装

pip install scrapy

-Ubuntu

-要在Ubuntu(或基于Ubuntu)系统上安装scrapy,您需要安装这些依赖项:

sudo apt-get install python-dev python-pip libxml2-dev libxslt1-dev zlib1g-dev libffi-dev libssl-dev

-如果你想在python3上安装scrapy,你还需要Python3的开发头文件:

sudo apt-get install python3-dev

scrapy 框架的使用

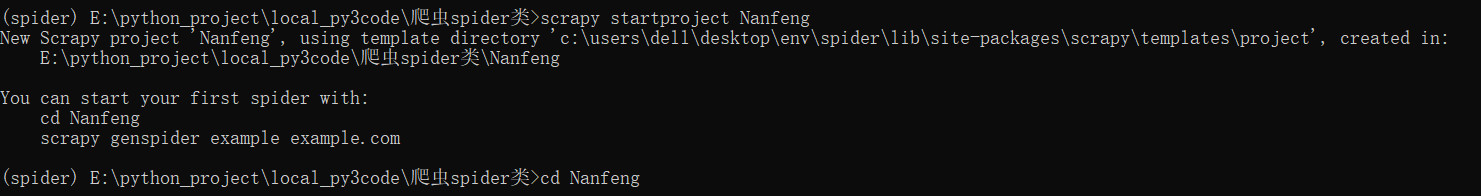

-1.新建项目

命令:scrapy startproject <project_name> [project_dir]

注意:cd到想要创建项目的目录下

-2.编写爬虫

-手动编写

-1.继承scrapy.Spider

-2.name属性

-3.start_urls

-4.parse方法

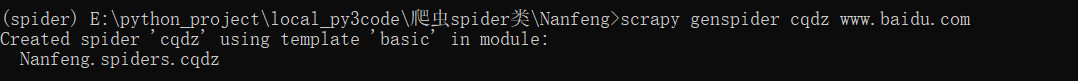

-命令行直接创建:scrapy genspider [-t template] <name> <domain>

scrapy genspider tzc www.shiguangkey.com

-3.启动爬虫

-scrapy crawl <spidername>

-4.追踪连接

return scrapy.Request()

切换到需要存放项目的目录来创建

项目目录结构

文件说明:

scrapy.cfg 项目的主配置信息。(真正爬虫相关的配置信息在settings.py文件中)

items.py 设置数据存储模板,用于结构化数据,如:Django的Model

pipelines 数据处理行为,如:一般结构化的数据持久化

settings.py 配置文件,如:递归的层数、并发数,延迟下载等

spiders 爬虫目录,如:创建文件,编写爬虫规则

spiders文件

# -*- coding: utf-8 -*-

import scrapy

class CqdzSpider(scrapy.Spider):

name = 'cqdz'

allowed_domains = ['www.baidu.com']

start_urls = ['http://www.baidu.com/']

def parse(self, response):

pass

必须继承scrapy.Spider这个类,必须定义下面三个属性

-name:spider的名字,必须且唯一

-start_urls:初始的url,每个初始化url爬取之后,会调用这个方法

-parse(self, response)方法:每个url完成之后被调用,这个函数要完成两个功能

*解析响应,封装成item对象并返回这个对象

*提取新的需要下载的url,创建新的request,并返回它

1177

1177

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?