Windows 32或64位下载安装配置Spark:

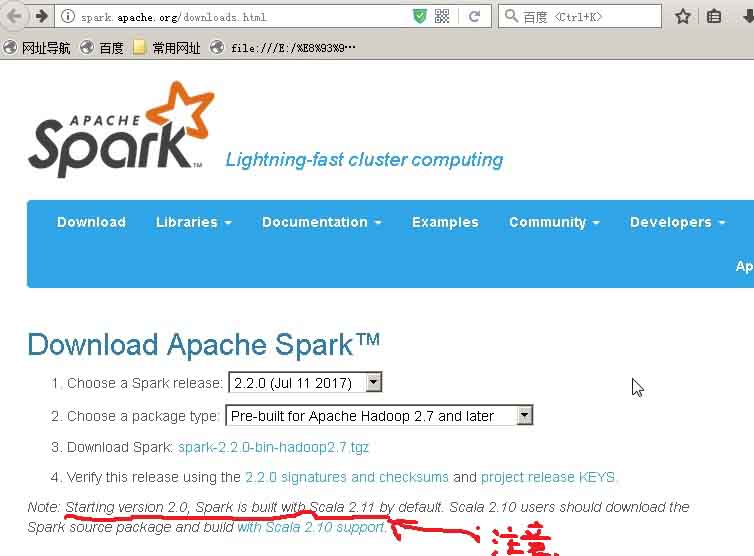

1)下载地址:http://spark.apache.org/downloads.html

马克-to-win @ 马克java社区:选择需要下载的Spark版本,我选的是当前最新的版本2.2.0。因为我已经安装了Hadoop 2.7.4版本的,所以我选择对应的Pre-built for Hadoop 2.7 and later。注意网站上说scala要求2.11版本以上。(在我的新机器上,是没有预先装scala的,先装的spark, 证明这么装的顺序是可行的)

2)配置:

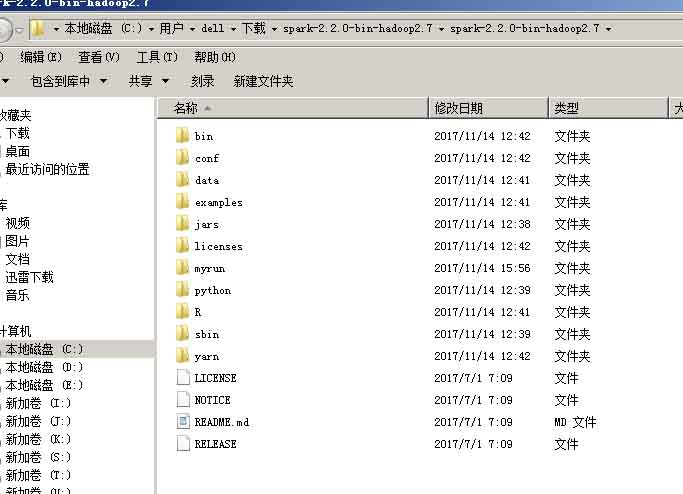

马克-to-win @ 马克java社区:解压spark-2.2.0-bin-hadoop2.7.tgz到本机一个目录,例如C:\Users\dell\Downloads\spark-2.2.0-bin-hadoop2.7\spark-2.2.0-bin-hadoop2.7,参考hadoop那节,配置环境变量%SPARK_HOME%,再有把%SPARK_HOME%/bin加入到Path里面, 我自己建了一个目录叫myrun,因为在哪个目录运行,就会在其中产生metastore_db这个目录,所以为了运行,我专门建了一个目录来运行。

3)启动测试:

a)启动Hadoop

b)在cmd窗口运行spark-shell,出现下图代表OK。

篇幅原因,版权保护,尊重原创,原文出处 :http://www.mark-to-win.com/tutorial/mydb_SparkScala_SparkInsConf.html

2923

2923

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?