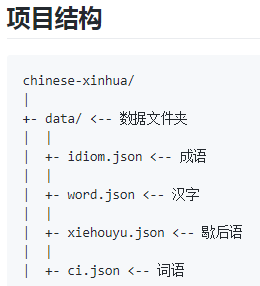

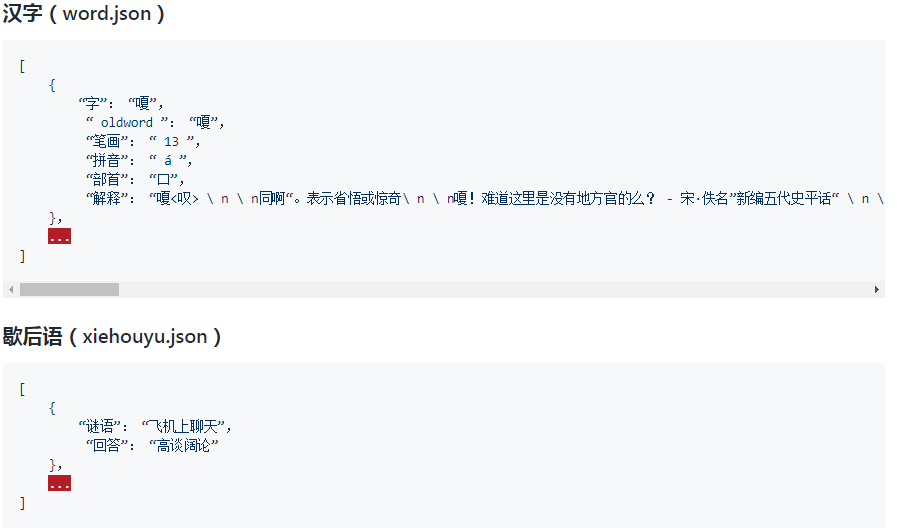

中华新华字典数据库和 API 。收录包括 14032 条歇后语,16142 个汉字,264434 个词语,31648 个成语。

GitHub地址:GitHub - pwxcoo/chinese-xinhua: 中华新华字典数据库。包括歇后语,成语,词语,汉字。

自然语言处理seq2seq模型实现人工智能对对联(基于TensorFlow框架)

目录

春节贴春联是中国人庆祝春节(过年)的特有习俗。但我真正对对联有些认识和喜欢,不是从年年贴春联开始的,而是从《唐伯虎点秋香》那段经典的对对子开始的。那工整又有韵律和意境的对子,配上有节奏的配乐读出来着实让人热血沸腾,大呼过瘾。

先来回味一下这段台词吧,你的耳边是否响起了对对子的节奏。。。

-

对穿肠:一乡二里共三夫子,不识四书五经六义,竟敢教七八九子,十分大胆! -

宁王:对啊,怎麼不对呢?你不给我面子,我可真的要发飙了! -

唐伯虎:让我来试试! 十室九贫,凑得八两七钱六分五毫四厘,尚且三心二意,一等下流! -

对穿肠:好工整啊! -

华太师:华安,你来的正是时候。 -

唐伯虎:没事,没事,没事。 -

对穿肠:在下是七省文状元兼参谋将军,绰号对王之王的对穿肠。阁下是? -

唐伯虎:小弟读过两年书,尘世中一个迷途小书僮,华安。 -

对穿肠:好!我就来会一会你! -

(两人互相凝视,蓄势待发,突然......亲了一下......众人跌倒在地!) -

唐伯虎:对不起,我俩惺惺相惜,情不自禁。 -

对穿肠:言归正传,我们开始了。 -

图书里,龙不吟虎不啸,小小书僮可笑可笑。 -

唐伯虎:棋盘里,车无轮马无韁,叫声将军提防提防。 -

众 人:对得好!对得好! -

对穿肠:莺莺燕燕翠翠红红处处融融洽洽。 -

唐伯虎:雨雨风风花花叶叶年年暮暮朝朝。 -

众 人:华安真行啊!对得好! -

宁 王:快出对子对死他,对死他! -

对穿肠:十口心思,思君思国思社稷。 -

唐伯虎:八目共赏,赏花赏月赏秋香。 -

对穿肠:我上等威风,显现一身虎胆。 -

唐伯虎:你下流贱格,露出半个龟头。 -

对穿肠:我堂堂参谋将军会输给你个书僮? 你家坟头来种树。 -

唐伯虎:汝家澡盆杂配鱼。 -

对穿肠:鱼肥果熟入我肚。 -

唐伯虎:你老娘来亲下厨! -

(对穿肠倒地喷血) -

唐伯虎:对对本为消遣作乐,今曰穿肠兄居然对到呕出几十两血,可谓空前绝后,小弟佩服佩服!

十年前,微软亚洲研究院推出了一个对联生成引擎,可以根据用户输入的上联自动生成下联,当时火了一把。那时候觉得这个好神奇啊。

十年后,人工智能的风已经热吹了几年。随着硬件GPU计算能力的提升,和深度学习框架(TensorFlow,PyTorch,MxNet等等)的推出和发展,人工智能(其实就是更深层的机器学习)首先在图像处理领域大放异彩,人脸识别、物体检测等技术应用广泛。然而,在自然语言处理处理方面,深度学习的应用还没有图像处理那么成熟。不过,人工智能作古诗,对对子应用的看起来还不错。

快过年了,贴对联是必不可少的传统风俗。不知道各位小伙伴有没有自己写过对联呢?写对联可不是一件简单的事情,如果不是满腹经纶绝难出口成章啊。最近我就发现了一个对对联的开源项目,绝对有才。

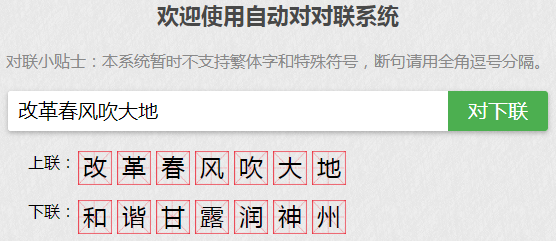

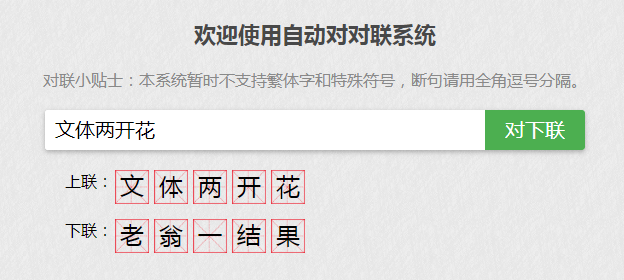

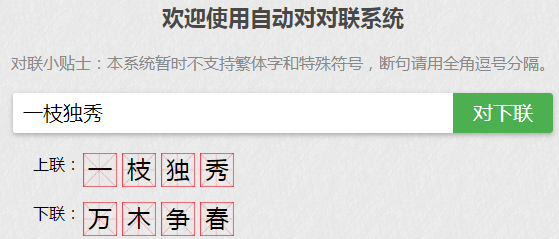

将试用网站分享给各位小伙伴,可以在线感受下AI机智对对联(建议用Google浏览器):王斌给您对对联 -_-!

效果图如下:

怎么样,对的还算工整吧,就是在专业领域不具有专业特色。

AI对对联项目,使用seq2seq模型,基于深度学习框架Tensorflow使用Python 3.6开发,作者是王斌一位软件工程师,一位极具才情的程序员。下面咱们就解析seq2seq模型原理机制。

对于一些自然语言处理任务,比如聊天机器人,机器翻译,自动文摘等,传统的方法都是从候选集中选出答案,这对素材的完善程度要求很高,随着最近几年深度学习的兴起,国外学者将深度学习技术应用与自然语言的生成和自然语言的理解的方面的研究,并取得了一些突破性的成果,比如,Sequence-to-sequence (seq2seq) 模型,它是目前自然语言处理技术中非常重要而且非常流行的一个模型,该技术突破了传统的固定大小输入问题框架,开通了将经典深度神经网络模型运用于翻译与职能问答这一类序列型任务的先河,并且被证实在各主流语言之间的相互翻译以及语音助手中人机短问快答的应用中有着非常好的表现,下面给大家简要介绍一下关于seq2seq模型的一些细节。

seq2seq模型是在2014年,是由Google Brain团队和Yoshua Bengio 两个团队各自独立的提出来[1] 和 [2],他们发表的文章主要关注的是机器翻译相关的问题。而seq2seq模型,简单来说就是一个翻译模型,把一个语言序列翻译成另一种语言序列,整个处理过程是通过使用深度神经网络( LSTM (长短记忆网络),或者RNN (递归神经网络)前面的文章已经详细的介绍过,这里就不再详细介绍) 将一个序列作为输入影射为另外一个输出序列,如下图所示:

。。。。。。。。。。。。。。。。。

版权原因,完整文章,请参考如下:自然语言处理seq2seq模型实现人工智能对对联(基于TensorFlow框架)

本文介绍了seq2seq模型在自然语言处理中的应用,特别是对对联生成。作者通过一个开源项目展示了如何使用TensorFlow实现AI对对联,回顾了微软亚洲研究院十年前的对联生成引擎,并探讨了seq2seq模型的核心思想。此外,还分享了一个在线AI对对联的试用网站,让读者体验人工智能的创造力。

本文介绍了seq2seq模型在自然语言处理中的应用,特别是对对联生成。作者通过一个开源项目展示了如何使用TensorFlow实现AI对对联,回顾了微软亚洲研究院十年前的对联生成引擎,并探讨了seq2seq模型的核心思想。此外,还分享了一个在线AI对对联的试用网站,让读者体验人工智能的创造力。

368

368

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?