(每个人错误情况可能不一样,仅供参考。以复现一篇含自定义激活函数论文为例。)

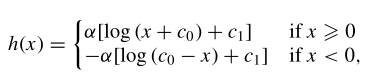

1:拟设计激活函数:

2:代码编辑:

class log_act(nn.Module):

def __init__(self, alpha, beta, positive_flag=True):

super(log_act, self).__init__()

self.positive_flag = positive_flag

self.a = alpha

self.C1 = beta

def forward(self, x):

x = x.detach().numpy()

C0 = np.exp(

本文通过实例展示了如何在PyTorch中实现自定义激活函数,包括遇到的问题及解决方案。首先介绍了设计激活函数的思路,接着讨论了两个常见问题:1. 转换PyTorch张量到numpy时保持梯度信息;2. log函数对输入值的限制。解决方案分别涉及张量的克隆或detach操作,以及对输入值的条件检查。最后进行了测试验证,对于需要梯度的情况,还提供了参考链接。

本文通过实例展示了如何在PyTorch中实现自定义激活函数,包括遇到的问题及解决方案。首先介绍了设计激活函数的思路,接着讨论了两个常见问题:1. 转换PyTorch张量到numpy时保持梯度信息;2. log函数对输入值的限制。解决方案分别涉及张量的克隆或detach操作,以及对输入值的条件检查。最后进行了测试验证,对于需要梯度的情况,还提供了参考链接。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

8516

8516

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?