标题:

利用灰狼优化算法(GWO)增强支持向量机(SVM)性能:一种 Python 实现方法

引言:

在数据科学和机器学习的领域,找到最佳的模型参数是达到高准确率和优化模型性能的关键。本文旨在介绍如何通过灰狼优化算法(GWO)自动化地优化支持向量机(SVM)的参数。GWO 是一种模仿自然界灰狼狩猎行为的群体智能优化算法,非常适合解决复杂的优化问题。结合 SVM 的强大分类能力,本文将探讨如何应用 GWO 来提升 SVM 在数据分类任务中的表现。

灰狼优化算法详解:

灰狼优化算法是由 Mirjalili 等人于 2014 年提出的一种新型群体智能优化方法。它的设计灵感来自于灰狼的社会等级结构和团队合作的狩猎方式。在 GWO 中,灰狼群体被分为四个等级:Alpha(领袖)、Beta(副领袖)、Delta(下属)和Omega(普通成员)。这种等级制度有助于指导搜索过程,其中 Alpha 狼通常引导整个群体。

在搜索的每一步,群体中的每只狼(代表一个解决方案)都会根据 Alpha、Beta 和 Delta 的位置来更新自己的位置,这反映了灰狼跟随领头狼狩猎的行为。这种策略不仅有助于算法探索搜索空间(通过模仿领头狼),也有助于利用当前已知的最佳解决方案(通过跟随 Alpha、Beta 和 Delta)。

支持向量机简介:

支持向量机是一种广泛使用的监督学习算法,适用于分类和回归任务。其主要思想是在特征空间中找到一个最优的超平面,以此来区分不同的类别。SVM 的性能极大地依赖于其参数的选择,特别是正则化参数 C 和核函数参数 gamma。适当的参数设置可以显著提高模型的泛化能力和准确度。

Python 实现和数据集选择:

为了展示 GWO 在 SVM 参数优化中的应用,我们选择了经典的 Iris 数据集进行实验。这个数据集包含 150 个样本,分为三个鸢尾花种类,每个样本有四个特征。数据集的多样性和平衡性使其成为评估机器学习算法的理想选择。

# 加载数据集

X, y = load_iris(return_X_y=True)

我们的实验包括两个主要部分:首先,我们实现了 GWO.py,在其中编写了灰狼优化算法的逻辑;接着,在 SVM.py 中,我们定义了 SVM 的目标函数,以及如何使用 GWO 来优化 SVM 的参数。

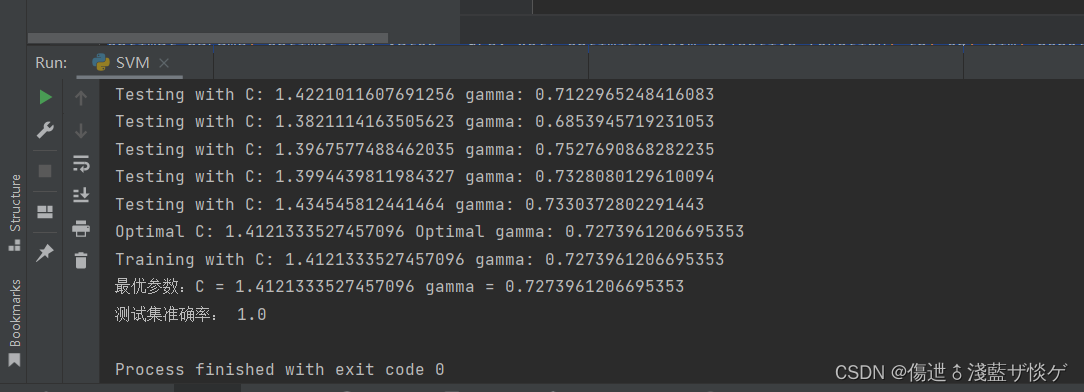

使用 GWO 寻找最优参数

# 使用 GWO 寻找最优参数

optimal_params, optimal_obj_value = grey_wolf_optimizer(svm_objective_function, lb, ub, dim, population_size, iterations)

结果

代码链接

https://download.csdn.net/download/qq_44642168/88666511

1400

1400

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?