安装Llama-factory工具及相关环境包配置:

git clone https://github.com/hiyouga/LLaMA-Factory.git 或者 wget https://github.com/hiyouga/LLaMA-Factory/archive/refs/tags/v0.8.3.tar.gz

其他相关环境包版本适配:

torch相关安装包链接:https://pytorch.org/get-started/previous-versions/

https://download.pytorch.org/whl/torch_stable.html

安装版本:

pip install torch-2.3.0+cu118-cp310-cp310-linux_x86_64.whl

pip install torchvision0.18.0 torchaudio2.3.0 --index-url https://download.pytorch.org/whl/cu118

transformers4.43.4

vllm0.4.3

llamafactory==0.9.2.dev0(cd LLaMA-Factory目录下执行:pip install -e “.[torch,metrics]”)

datasets

accelerate

peft

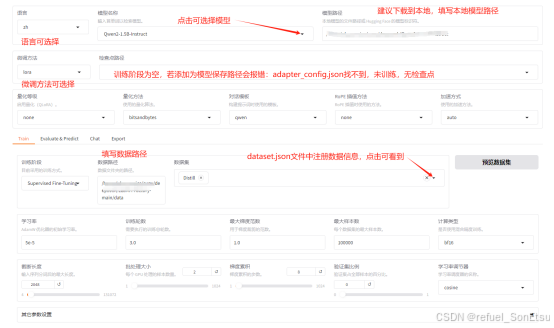

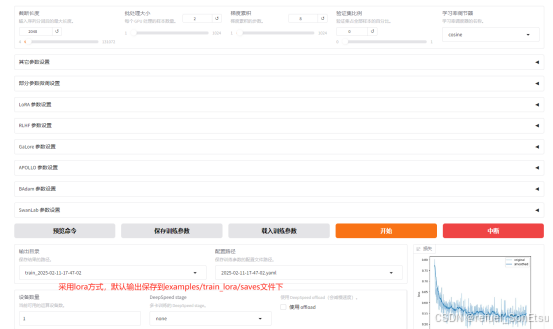

执行llamafactory-cli webui命令,进入页面

webui页面使用备注:

dataset.json修改为dataset_info.json

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?