–

文章目录

一、深度学习平台简介

1.1 PyTorch简介

- PyTorch是一个Python的深度学习库。它最初由Facebook人工智能研究小组开发,而优步的Pyro软件则用于概率编程。

- 最初,PyTorch由Hugh Perkins开发,作为基于Torch框架的LusJIT的Python包装器。PyTorch在Python中重新设计和实现Torch,同时为后端代码共享相同的核心C库。

- 除了Facebook之外,Twitter、GMU和Salesforce等机构都采用了PyTorch。

- 到目前,据统计已有80%的研究采用PyTorch,包括Google

学习资源:动手学深度学习 官方教程

1.1.1 PyTorch与TensorFlow2的对比

| PyTorch | TensorFlow2 |

|---|---|

| 上手简单、学习速度快 | 上手难 |

| 部署能力稍弱 | 部署方便、稳定 |

| 支持动态图 | 支持动态图 |

| 函数简洁、运用灵活 | 函数封装复杂 |

1.1.2 PyTorch基本概念

- 张量

是一个物理量,对高维(维数 ≥ 2) 的物理量进行“量纲分析” 的一种工具。简单的可以理解为:一维数组称为矢量,二维数组为二阶张量,三维数组为三阶张量 - 计算图

用“结点”(nodes)和“线”(edges)的有向图来描述数学计算的图像。“节点” 一般用来表示施加的数学操作,但也可以表示数据输入的起点/输出的终点,或者是读取/写入持久变量的终点。“线”表示“节点”之间的输入/输出关系。这些数据“线”可以输运“size可动态调整”的多维数据数组,即“张量”(tensor) - 使用 tensor 表示数据

- 使用 Dataset、DataLoader 读取样本数据和标签

- 使用变量 (Variable) 存储神经网络权值等参数

- 使用计算图 (computational graph) 来表示计算任务

- 在代码运行过程中同时执行计算图

1.1.3 简单示例

构建简单的计算图,每个节点将零个或多个tensor作为输入,产生一个tensor作为输出。PyTorch中,所见即为所得,tensor的使用和numpy中的多维数组类似:

import torch

x_const = torch.tensor([1.0, 2.0, 3.0])

y = torch.tensor([3.0, 4.0, 5.0])

output = x_const + y

print(x_const, '\n', y, '\n',output)

1000个散点样本,求出回归方程

定义网络 :

import torch.nn as nn

class LinearRegression(nn.Module):

def __init__(self):

super(LinearRegression, self).__init__()

self.linear = nn.Linear(1, 1) # 输入和输出的维度都是1

def forward(self, x):

out = self.linear(x)

return out

进行训练:

model = LinearRegression()

params = list(model.named_parameters())

(_, w) = params[0]

(_, b) = params[1]

criterion = nn.MSELoss()

optimizer = torch.optim.SGD(model.parameters(), lr=0.3)

x = torch.unsqueeze(torch.linspace(-1, 1, 100), dim=1)

y = 2*x + 10 + torch.rand(x.size())

for epoch in range(20):

inputs = x

target = y

out = model(inputs) # 向前传播

loss = criterion(out, target) # 向后传播

optimizer.zero_grad() # 注意每次迭代都需要清零

loss.backward()

optimizer.step()

print('Epoch: {}, w: {:.4f},b:{:.4f}'.format(epoch + 1, float(w.data),

float(b.data)))

model.eval()

二、卷积神经网络基础

2.1 基本概念

- 全连接网络:链接权过多,难算难收敛,同时可能进入局部极小值,也容易产生过拟合问题

- 局部连接网络:顾名思义,只有一部分权值连接。部分输入和权值卷积。

- 填充(Padding),也就是在矩阵的边界上填充一些值,以增加矩阵的大小,通常用0或者复制边界像素来进行填充。

- 步长(Stride):如图步长为2

- 多通道卷积:如RGB

- 池化(Pooling)

思想:使用局部统计特征,如均值或最大值。解决特征过多问题

- 卷积神经网络结构

构成:由多个卷积层和下采样层构成,后面可连接全连接网络

卷积层:k个滤波器

下采样层:采用mean或max

后面:连着全连接网络

- 学习算法 递推

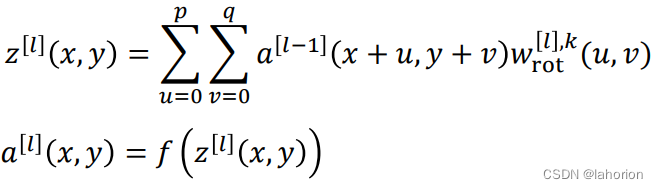

前向传播定义为:

如果第𝑙层是卷积+池化层,则:

三、LeNet-5网络

3.1 网络结构

3.1.1 结构详解

- C1层

6个Feature map构成

每个神经元对输入进行55卷积

每个神经元对应55+1个参数,共6个feature map,

2828个神经元,因此共有

(55+1)6(28*28)=122,304连接 - S2层 Pooling层

- C3层 卷积层

- S4层 与S2层工作相同

- C5层

120个神经元

每个神经元同样对输入进行55卷积,与S4全连接

总连接数(55*16+1)*120=48120 - F6层

84个神经元

与C5全连接

总连接数(120+1)*84=10164 - 输出层

由欧式径向基函数单元构成

每类一个单元

输出RBF单元计算输入向量和参数向量之间的欧式距离 - 网络结构

3.1.2 与现在网络区别

- 卷积时不进行填充(padding)

- 池化层选用平均池化而非最大池化

- 选用Sigmoid或tanh而非ReLU作为非线性环节激活函数

- 层数较浅,参数数量小(约为6万)

普遍规律——随网络深入,宽、高衰减,通道数增加

3.1.3 误差反向传播

随着网络深入,宽、高衰减,通道数增加。依然使用经典的BP算法进行权值更新。

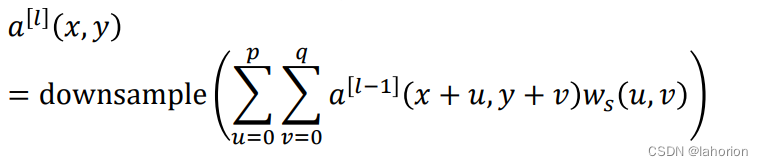

池化层根据是平均池化还是最大值池化,将误差反传至卷积层:

误差从卷积层传回池化层:

式中五角星表示图像卷积,计算时需首先上下、左右翻转后再做相关

网络结构可视化:https://adamharley.com/nn_vis/cnn/3d.html

3.1.4 LeNet5代码实现

import torch

from torch import nn

from d2l import torch as d2l

net = nn.Sequential(

nn.Conv2d(1, 6, kernel_size=5, padding=2), nn.Sigmoid(),

nn.AvgPool2d(kernel_size=2, stride=2),

nn.Conv2d(6, 16, kernel_size=5), nn.Sigmoid(),

nn.AvgPool2d(kernel_size=2, stride=2),

nn.Flatten(),

nn.Linear(16 * 5 * 5, 120), nn.Sigmoid(),

nn.Linear(120, 84), nn.Sigmoid(),

nn.Linear(84, 10))

X = torch.rand(size=(1, 1, 28, 28), dtype=torch.float32)

for layer in net:

X = layer(X)

print(layer.__class__.__name__,'output shape: \t',X.shape)

def evaluate_accuracy_gpu(net, data_iter, device=None): #@save

"""使用GPU计算模型在数据集上的精度"""

if isinstance(net, nn.Module):

net.eval() # 设置为评估模式

if not device:

device = next(iter(net.parameters())).device

# 正确预测的数量,总预测的数量

metric = d2l.Accumulator(2)

with torch.no_grad():

for X, y in data_iter:

if isinstance(X, list):

# BERT微调所需的(之后将介绍)

X = [x.to(device) for x in X]

else:

X = X.to(device)

y = y.to(device)

metric.add(d2l.accuracy(net(X), y), y.numel())

return metric[0] / metric[1]

def train_ch6(net, train_iter, test_iter, num_epochs, lr, device):

"""用GPU训练模型(在第六章定义)"""

def init_weights(m):

if type(m) == nn.Linear or type(m) == nn.Conv2d:

nn.init.xavier_uniform_(m.weight)

net.apply(init_weights)

print('training on', device)

net.to(device)

optimizer = torch.optim.SGD(net.parameters(), lr=lr)

loss = nn.CrossEntropyLoss()

animator = d2l.Animator(xlabel='epoch', xlim=[1, num_epochs],

legend=['train loss', 'train acc', 'test acc'])

timer, num_batches = d2l.Timer(), len(train_iter)

for epoch in range(num_epochs):

# 训练损失之和,训练准确率之和,样本数

metric = d2l.Accumulator(3)

net.train()

for i, (X, y) in enumerate(train_iter):

timer.start()

optimizer.zero_grad()

X, y = X.to(device), y.to(device)

y_hat = net(X)

l = loss(y_hat, y)

l.backward()

optimizer.step()

with torch.no_grad():

metric.add(l * X.shape[0], d2l.accuracy(y_hat, y), X.shape[0])

timer.stop()

train_l = metric[0] / metric[2]

train_acc = metric[1] / metric[2]

if (i + 1) % (num_batches // 5) == 0 or i == num_batches - 1:

animator.add(epoch + (i + 1) / num_batches,

(train_l, train_acc, None))

test_acc = evaluate_accuracy_gpu(net, test_iter)

animator.add(epoch + 1, (None, None, test_acc))

print(f'loss {train_l:.3f}, train acc {train_acc:.3f}, '

f'test acc {test_acc:.3f}')

print(f'{metric[2] * num_epochs / timer.sum():.1f} examples/sec '

f'on {str(device)}')

lr, num_epochs = 0.9, 10

train_ch6(net, train_iter, test_iter, num_epochs, lr, d2l.try_gpu())

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?