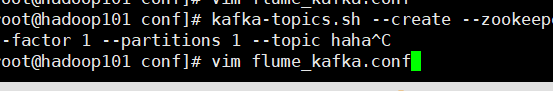

先使用kafka创建一个主题

kafka-topics.sh --create --zookeeper hadoop102:2181 --replication-factor 1 --partitions 1 --topic haha

进入flume目录conf文件下写入配置文件对接kafka的收集器

#起名字

s

在hadoo102启动kafka的消费者测试查看是否收到了数据

kafka-console-consumer.sh --bootstrap-server 192.168.10.101:9092,192.168.10.102:9092,192.168.10.103:9092 --topic haha --from-beginning

在第一台机器中新打开终端监听端口

nc -lp 12600或者是 nc (启动了Kafka的机器 )(端口)

启动flume集群

flume-ng agent -c conf -f /usr/local/src/flume/conf/xxx.conf -name a1 -Dflume.root.logger=INFO,console

在端口发送数据,然后看kafka(配置的是102)中的消费者界面是否出现

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?