批量归一化

是什么

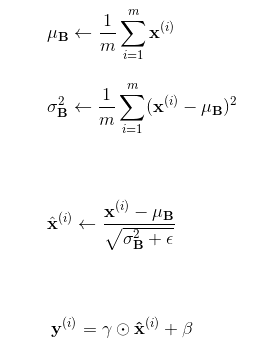

归一化是处理数据的一系列操作,让数据的平均值为0,方差为1:对数据求平均值,和标准差,再让每一个数据减去平均值,然后再去除以标准差。 对每一层网络都进行归一化,这样的行为就是批量归一化。

为什么

批量归一化有利于让训练出来的模型更加稳定。 因为数值的不稳定会影响训练出来的模型的好坏。

公式

在什么时候用

1.卷积层之后。

2.全连接层之后。

3.预测之前。

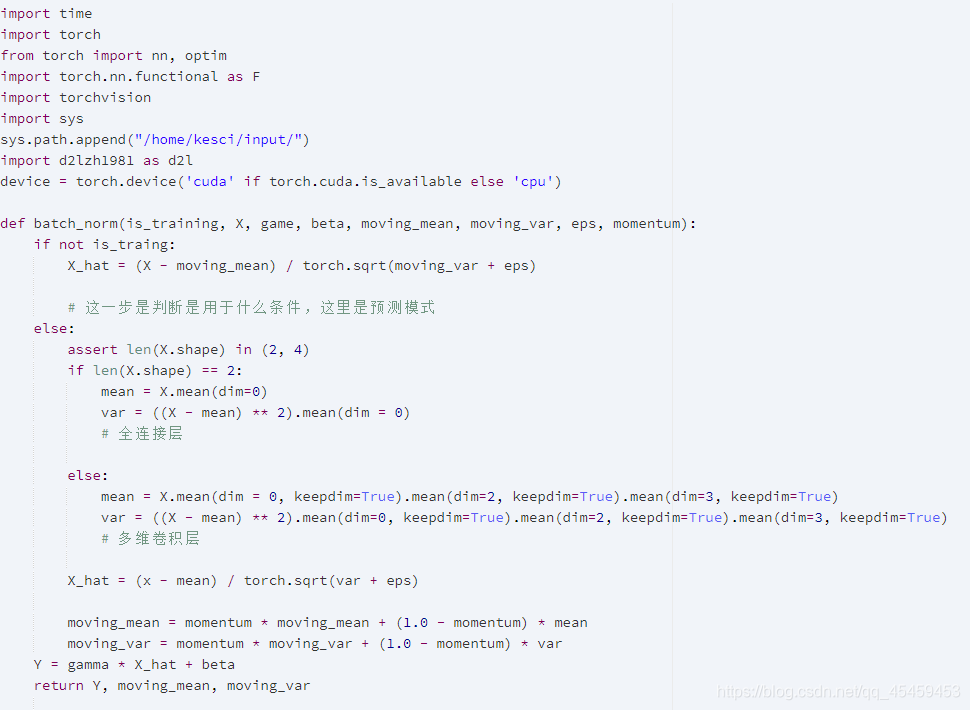

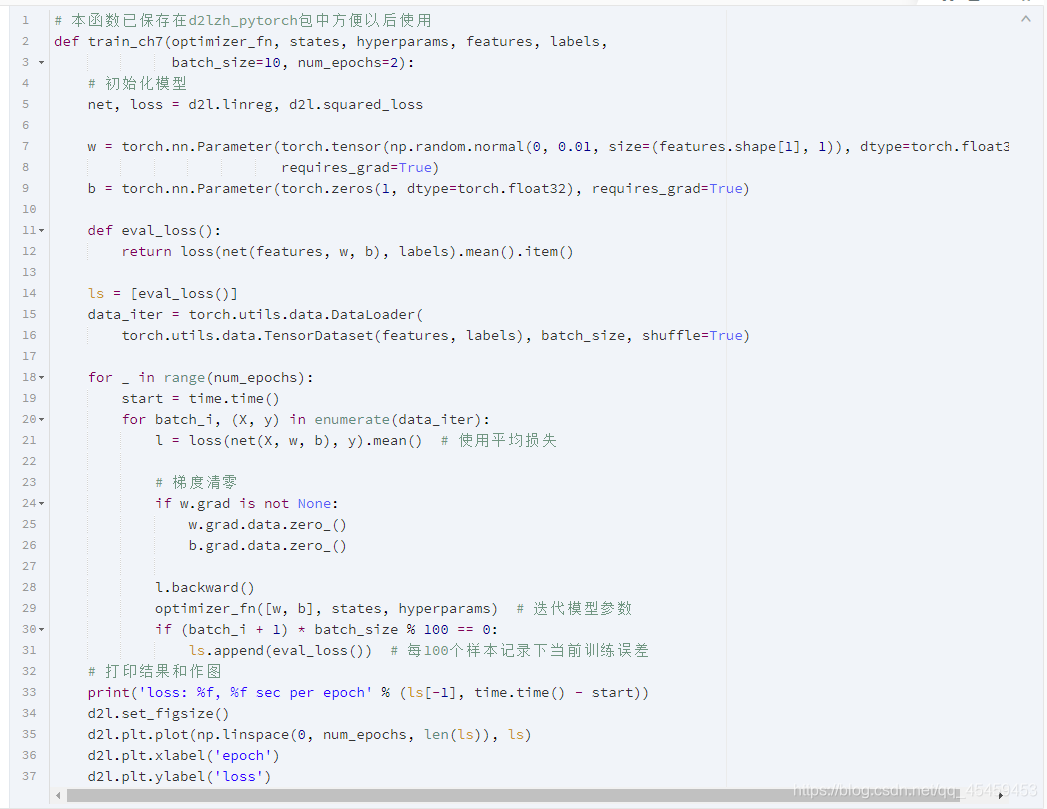

代码实现

对于 预测模式:可直接运算出结果。

对于 训练模式:需要先把 方差 和平均值运算出来,再继续运算。

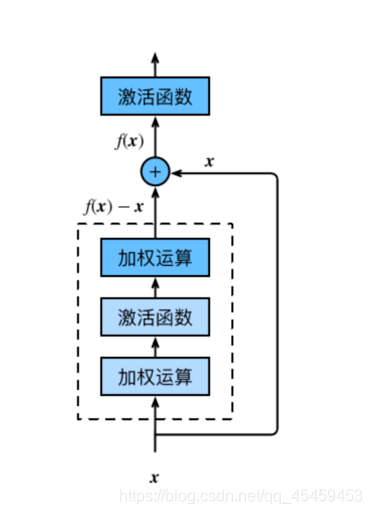

残差网络

是啥

好处

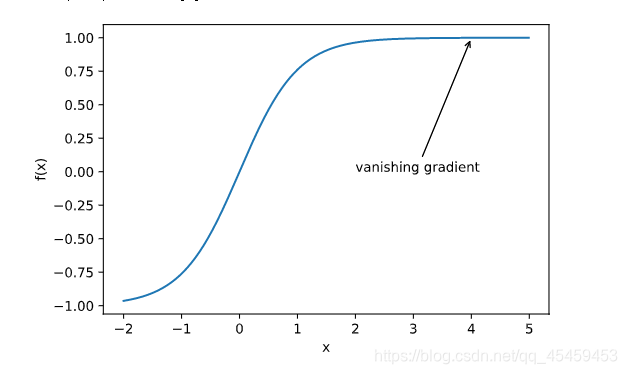

可以避免梯度消失。

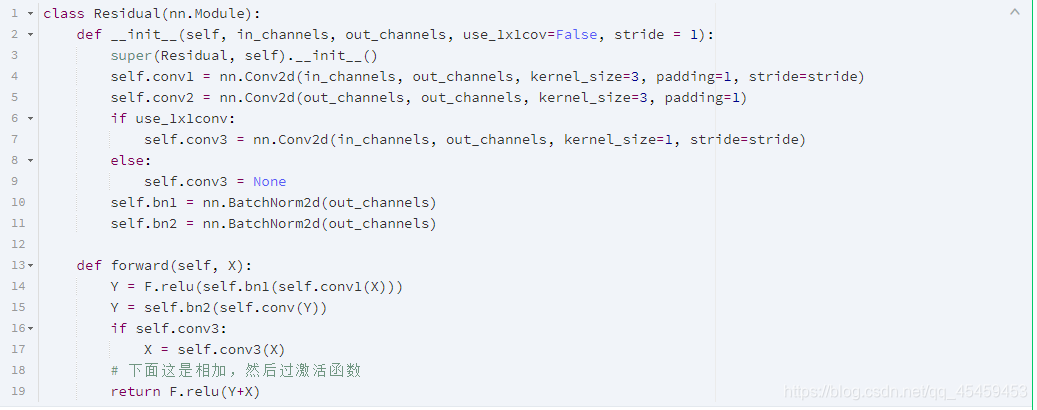

代码

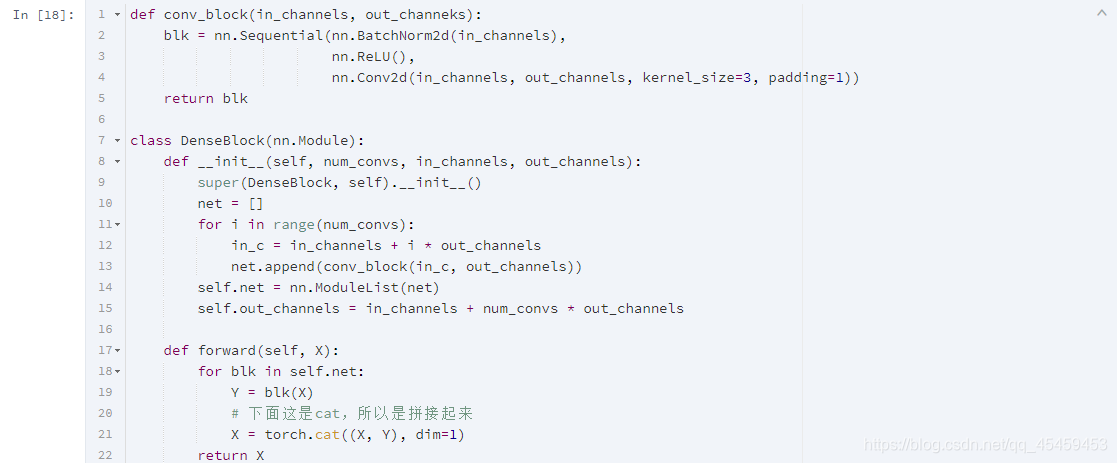

稠密连接网络

与残差网络不同的是,DN是将输入和输出连接,而不是相加。

凸优化

优化种遇到的问题

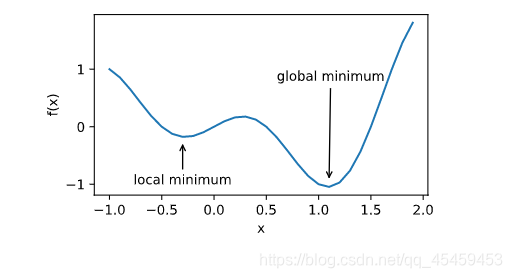

局部最小值

局部最小值的问题是,会导致训练的模型,无法接近最优的模型,因为训练会在那个局部最小值处震荡。

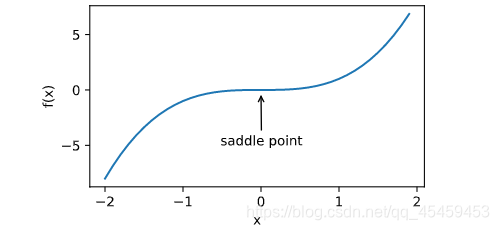

鞍点

在鞍点处,导数为0,假如你训练的模型恰好停在鞍点,那么就无法继续训练。

梯度消失

梯度消失会让训练几乎停止。

凸优化的作用

凸优化是用来解决凸函数最小化的问题。

凸优化就是用来解决上述鞍点和局部最小值的问题的。

梯度下降

X -= lr * f’(x)

1091

1091

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?