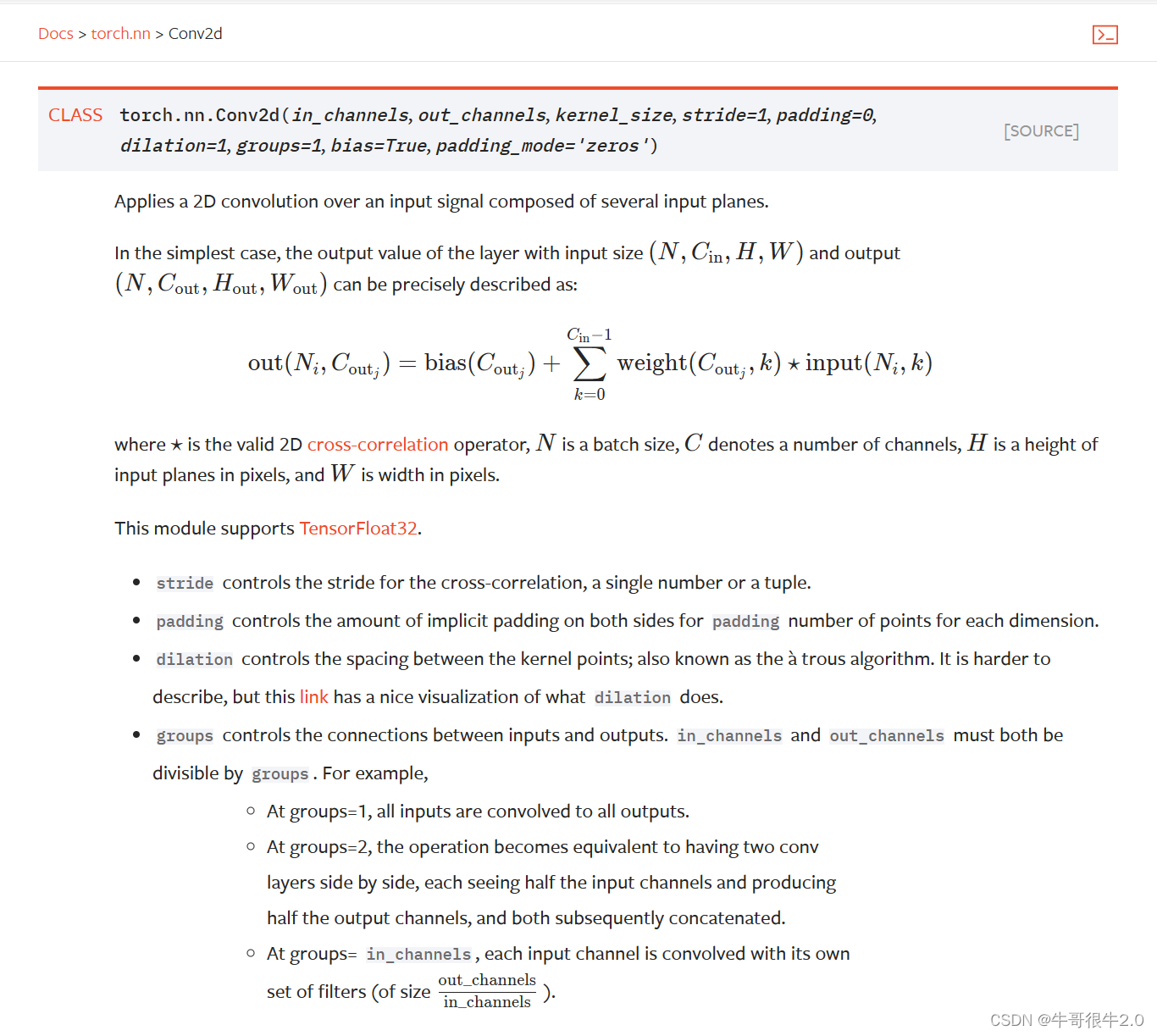

这是官网对Conv2d二维卷积神经网络的描述,其中包含有很多参数,主要使用的是:in_channels是输入通道数,out_channels是输出通道数,kernel_size是卷积核的大小(可以是一个数也可以是一个元组),stride是步径大小,padding就是给出的一个选项,自行选择是否填充并设置大小。

步骤:

1.准备测试集,从pytorch官网下载CIFAR10数据集,并使用DataLoader进行加载;

dataset = torchvision.datasets.CIFAR10("./conv2d_data",train=False,transform=torchvision.transforms.ToTensor(),download=True)

dataloader = DataLoader(dataset,batch_size=64)2.搭建神经网络,命名为Learn_Conv,继承nn.Module类,首先编写init初始化方法,完成父类的初始化以及第一层卷积的设置;再重写forward方法,使其执行卷积,将x传入卷积层,经过卷积操作得到输出;

class Learn_Conv(nn.Module):

def __init__(self):

super(Learn_Conv,self).__init__() #父类的初始化

self.conv1 = Conv2d(in_channels=3,out_channels=6,kernel_size=3,stride=1,padding=0)

def forward(self,x):

x = self.conv1(x)

return x

conv = Learn_Conv()

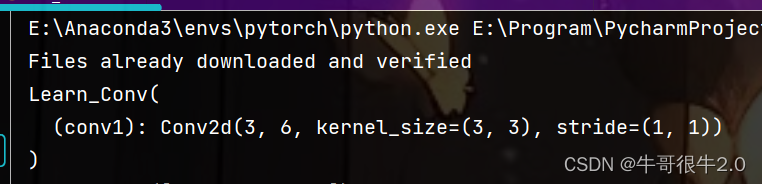

print(conv)3.初始化网络为conv,使用print查看网络结构,输出结果为

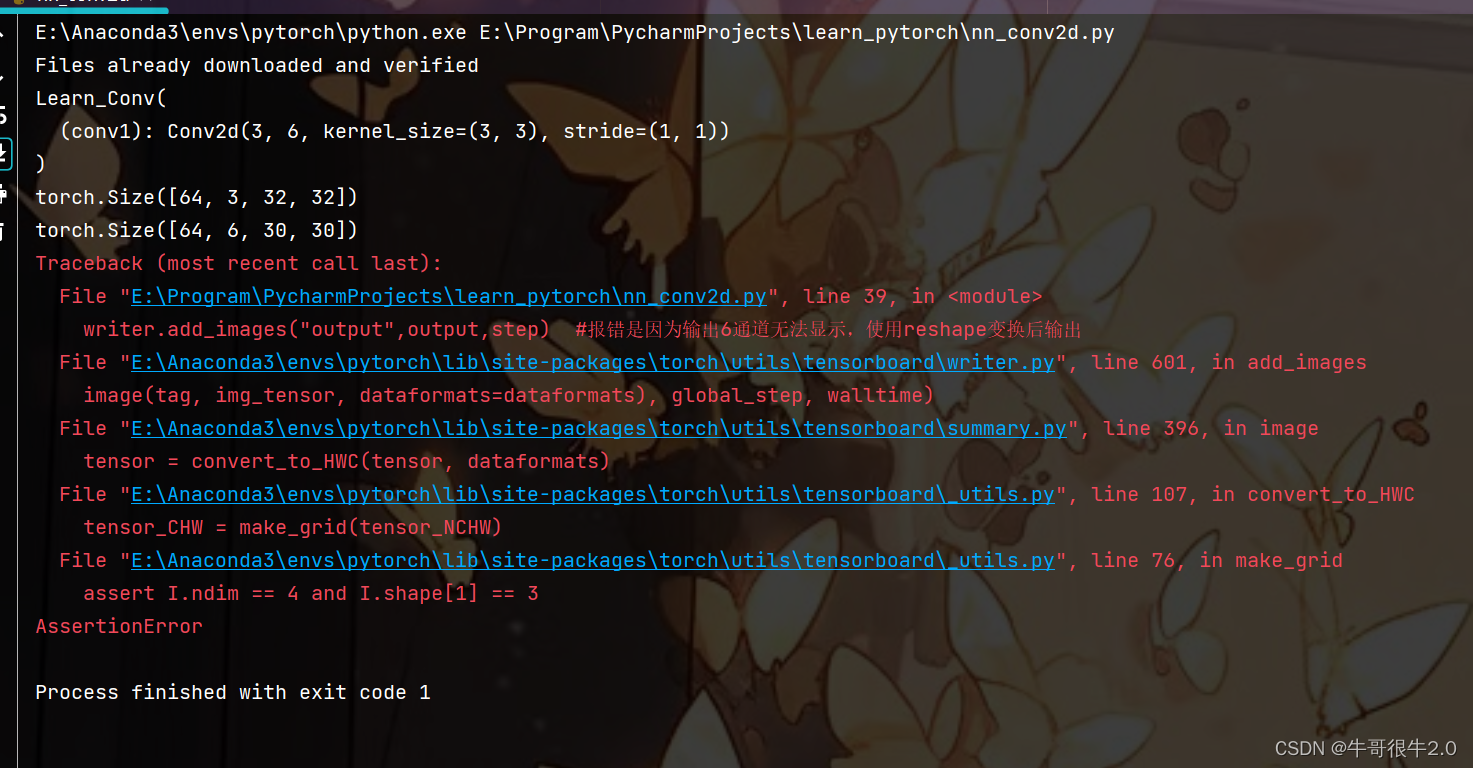

4.将测试集中的每张图像放进该神经网络,并使用tensorboard进行展示,下述代码执行后产生了一个错误,原因是只能显示出3通道的图像,而神经网络中设置的6通道tensorboard无法显示,在此处使用torch.reshape进行了一个重构操作解决这个问题;

step =0

writer = SummaryWriter("logs")

for data in dataloader:

imgs,targets =data

output =conv(imgs)

print(imgs.shape)

print(output.shape)

writer.add_images("input",imgs,step)

writer.add_images("output",output,step)

step = step + 1

修改后的代码:

step =0

writer = SummaryWriter("logs")

for data in dataloader:

imgs,targets =data

output =conv(imgs)

print(imgs.shape)

print(output.shape)

writer.add_images("input",imgs,step)

output = torch.reshape(output,(-1,3,30,30))

writer.add_images("output",output,step) #报错是因为输出6通道无法显示,使用reshape变换后输出

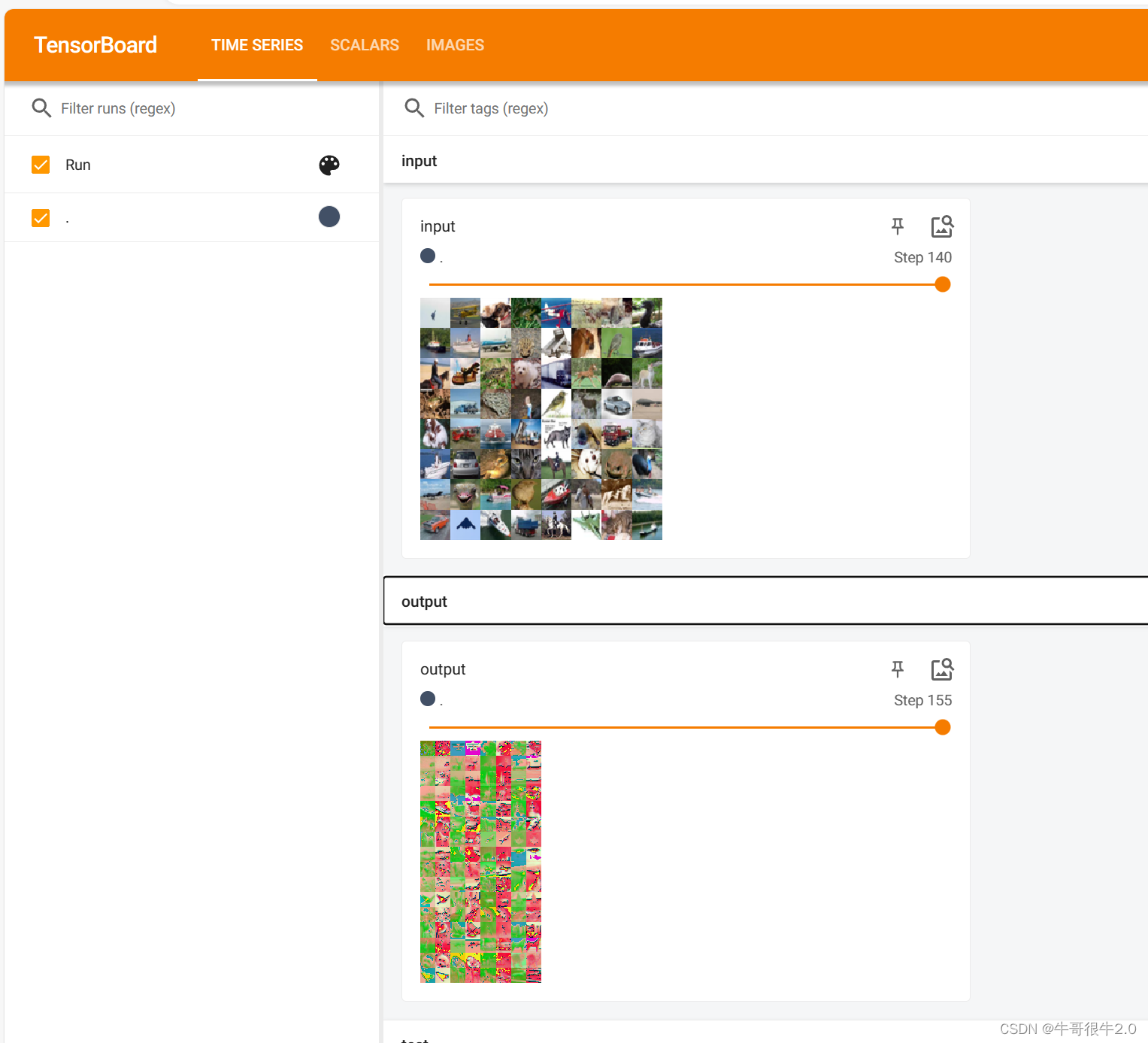

step = step + 15.运行代码,在terminal中执行tensorboard --logbir logs查看结果如下图:

完整代码如下:

import torch

import torchvision

from torch import nn

from torch.nn import Conv2d

from torch.utils.data import DataLoader

from torch.utils.tensorboard import SummaryWriter

#测试集

dataset = torchvision.datasets.CIFAR10("./conv2d_data",train=False,transform=torchvision.transforms.ToTensor(),download=True)

dataloader = DataLoader(dataset,batch_size=64)

# Python中的super(Net, self).__init__()是指首先找到Net的父类(比如是类NNet),

# 然后把类Net的对象self转换为类NNet的对象,然后“被转换”的类NNet对象调用自己的init函数,

# 其实简单理解就是子类把父类的__init__()放到自己的__init__()当中,这样子类就有了父类的__init__()的那些东西。

#

# 回过头来看看我们的我们最上面的代码,Net类继承nn.Module,super(Net, self).__init__()就是对继承自父类nn.Module的属性进行初始化。而且是用nn.Module的初始化方法来初始化继承的属性。

class Learn_Conv(nn.Module):

def __init__(self):

super(Learn_Conv,self).__init__() #父类的初始化

self.conv1 = Conv2d(in_channels=3,out_channels=6,kernel_size=3,stride=1,padding=0)

def forward(self,x):

x = self.conv1(x)

return x

conv = Learn_Conv()

print(conv)

step =0

writer = SummaryWriter("logs")

for data in dataloader:

imgs,targets =data

output =conv(imgs)

print(imgs.shape)

print(output.shape)

writer.add_images("input",imgs,step)

output = torch.reshape(output,(-1,3,30,30))

writer.add_images("output",output,step) #报错是因为输出6通道无法显示,使用reshape变换后输出

step = step + 1

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?