用于超声图像中的乳腺病变分割的全局指导网络

Global guidance network for breast lesion segmentation in ultrasound images

摘要

超声中的自动乳腺病变分割有助于诊断乳腺癌,这是影响全球女性的可怕疾病之一。由于乳腺超声图像固有的斑点伪影、模糊的乳腺病变边界以及乳腺病变区域内的不均匀强度分布,从超声图像中准确分割乳腺区域是一项具有挑战性的任务。最近,卷积神经网络(CNN)在医学图像分割任务中表现出了显着的效果。然而,CNN中的卷积操作通常集中在局部区域,这些局部区域在捕获输入超声图像的长程依赖性方面能力有限,从而导致乳房病变分割准确性下降。在本文中,我们开发了一种深度卷积神经网络,配备了全局指导块(GGB)和乳腺病变边界检测(BD)模块,用于增强乳腺超声病变分割。GGB利用多层集成特征映射作为指导信息,从空间域和信道域学习远程非局部依赖性。BD模块学习额外的乳腺病变边界图,以提高分割结果细化的边界质量。在公共数据集和收集数据集上的实验结果表明,我们的网络优于其他医学图像分割方法和最近的语义分割方法对乳腺超声病变的分割。此外,我们还展示了我们的网络在超声前列腺分割上的应用,其中我们的方法比最先进的网络更好地识别前列腺区域。

引言

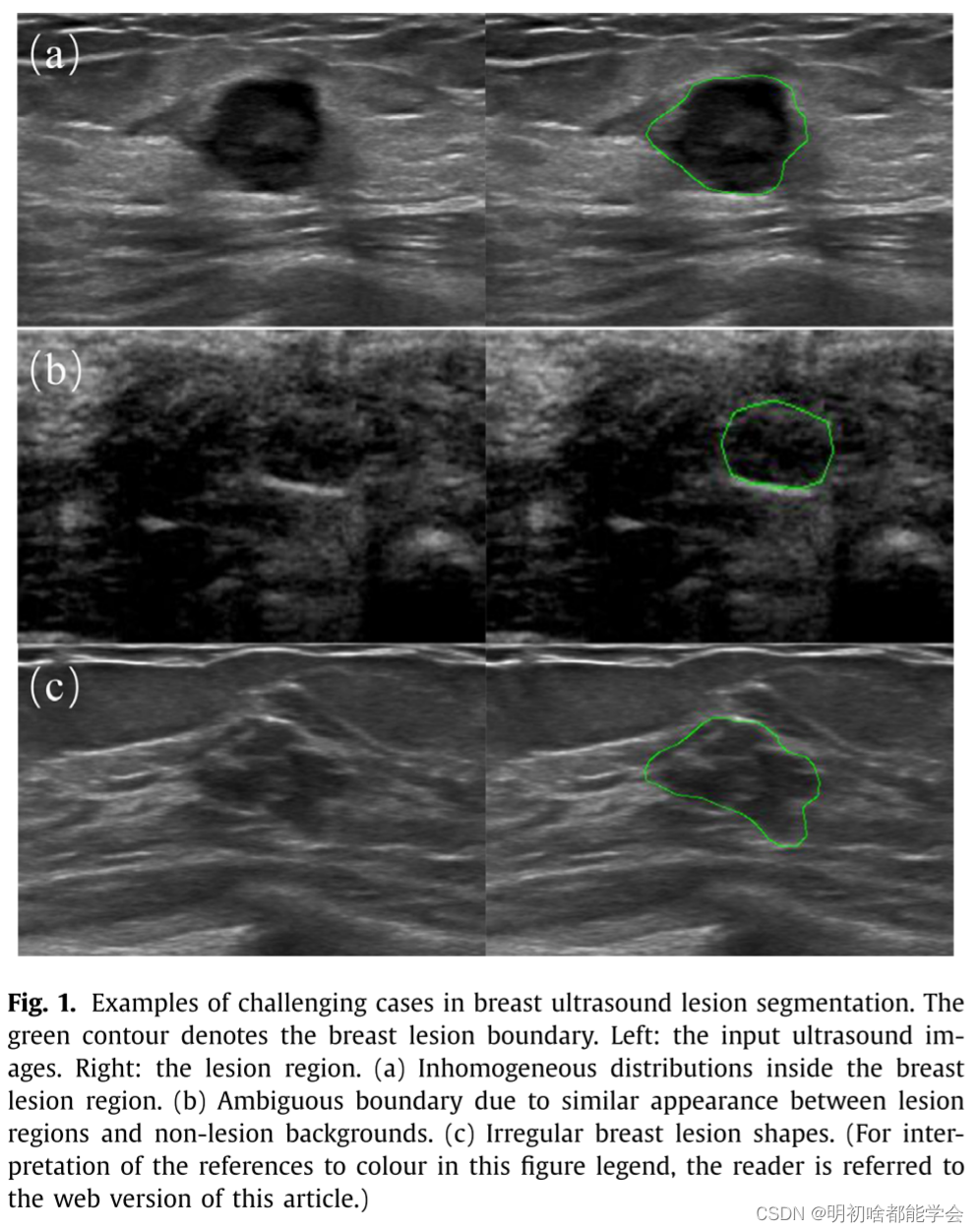

乳腺癌是影响全球妇女的可怕疾病之一。根据美国癌症协会(2019)报告的统计信息,估计2019年将发生42,260例乳腺癌死亡。从超声图像中准确分割出乳腺病变有助于乳腺癌的早期诊断。然而,2D超声图像中的乳腺病变自动分割是一项具有挑战性的任务,因为超声中存在斑点噪声和强阴影,乳腺病变区域中的不均匀分布,乳腺病变和非病变区域之间的边界模糊,以及不规则的乳腺病变形状;参见图1的示例。

超声图像中的乳腺病变分割在研究界得到了广泛的研究。早期的尝试,例如,(Shan等人,2012; Madabhushi和Metaxas,2002; Shan等人,2008; Kwak等人,2005年; Madabhushi和Metaxas,2003年; Yezzi等人,1997; Chen等人,2002; Xian等人,2015; Ashton和帕克,1995; Boukerroui等人,1998; Xiao等人,2002)主要基于手工制作的特征来检测乳腺病变边界。然而,这些特征具有有限的特征表示能力,导致在复杂的环境中错误识别乳腺病变。最近,卷积神经网络(CNN)在乳腺超声分割任务上取得了令人印象深刻的进展。例如,雅普等人,采用U-Net、FCN-AlexNet和基于块的LeNet进行2D超声图像乳腺病变检测(雅普等人,2017年)。Lei等人,采用在边界上具有监督信号的深度神经网络来处理整个乳房超声图像(Lei等人,2018年)。Xu等人,采用八层CNN来分割超声数据中的3D乳房(Xu等人,2019年)。

超声图像具有许多与乳腺病变相似的远距离像素。对这些像素进行分类可以提供长期的非局部特征,以学习用于超声乳腺病变分割的区分性特征。获取超声图像分割的全局上下文信息是医学图像领域的一个长期课题。先前的研究提出用扩张卷积、池化操作来扩大感受野(Chen等人,2018; 2017 b; 2014);或将中级和高级特征与更多任务相关的语义特征融合(Ronneberger等人,2015; Lin等人,2017年)。然而,这些方法无法捕捉上下文信息的全局视图,只考虑空间域之间的相互依赖性。在医学图像分析领域,大多数先前的方法依赖于用于分割任务的局部区域操作(Ronneberger等人,2015; Dou等人,2016; Lin等人,2017年)。然而,捕获的长程相关性信息具有很大的潜力,但尚未得到很好的探索。这些网络中的传统非局部块(Qi等人,2019; Dou等人,2018)仅嵌入到深层CNN层中,以学习网络预测的长期依赖关系。然而,由于比浅CNN层相对更大的感受野,分割网络的深层负责捕获整个乳房病变的线索,并且不知何故缺少乳房病变区域的部分,从而降低了分割性能。

在这项工作中,我们开发了一个卷积神经网络(CNN)来整合所有CNN层(包括深层和浅层CNN层)的特征,以产生多级整合特征(MLIF)作为空间和通道方式的非局部块的指导信息,以补充更多的乳腺病变边界细节,这些细节通常被深层CNN层忽略。此外,我们提出预测额外的乳腺病变边界图,使得预测的边界图被正则化为与底层的地面实况一样相似。通过这样做,我们的网络可以产生具有更准确的乳腺病变边界的分割结果。

总之,我们的贡献是四方面的:

- 首先,我们提出了一个具有全局指导块(GGB)的CNN(表示为GG-Net),以在多层集成特征的指导下聚合空间和信道域中的非局部特征,以学习强大的非局部上下文信息。

- 其次,我们在浅层CNN层中开发了乳腺病变边界检测(BD)模块,以嵌入乳腺病变的额外边界图,从而获得具有高质量边界的分割结果。

- 第三,在两个超声乳腺病变数据集上的实验结果表明,我们的网络在乳腺病变分割方面优于现有的医学图像分割方法。

- 此外,我们还展示了我们的网络在超声前列腺分割上的应用,我们的网络获得了令人满意的性能。

相关工作

由于斑点伪影、低对比度、阴影、模糊边界和病变形状的变化,从超声图像分割乳腺病变非常具有挑战性(Kirberger,1995)。已经提出了各种乳房病变分割算法,并且这些方法可以大致分为四类,包括基于区域的方法(Shan等人,2012; Madabhushi和Metaxas,2002; Shan等人,2008; Kwak等人,2005)、可变形模型(Madabhushi和Metaxas,2003; Yezzi等人,1997; Chen等人,2002)、基于图的方法(Xian等人,2015; Ashton和帕克,1995; Boukerroui等人,1998; Xiao等人,2002)和基于学习的方法(Liu等人,2010; Huang等人,2008; Lo等人,2014; Moon等人,2014; Othman和Tizhoosh,2011)。这些方法通常使用纹理特征来表示像素强度的局部变化,然后检测超声图像中的异常区域。然而,这些方法依赖于手工制作的特征,并且具有有限的表示能力。

卷积神经网络(CNN)已经在许多医学图像分析任务中显示出卓越的性能,包括图像分类(Yu等人,2018; 2017),语义分割(Ronneberger等人,2015; Dou等人,2016; Yu等人,2016年; Li等人,2018年)。这些方法充分利用了神经网络的上级学习能力,在分割效果上优于其他传统的分割方法。对于乳房图像分析,最近的工作以基于CNN的方法为特征(雅普等人,2017; Lei等人,2018; Xu等人,2019; Dhungel等人,2017; Mordang等人,2016 a; Ahn等人,2017; Mordang等人,2016 b; Hu等人,2019; Mishra等人,2018年)。雅普等人采用基于pacth的LeNet、U-Net和FCN-AlexNet进行乳腺病变检测雅普等人(2017)。Lei等人提出了一种用于整个乳房超声图像分割的ConvEDNet,其具有深度边界监督和自适应域转移知识(Lei等人,2018年)。一些工作采用具有不同层的CNN来检测肿块、估计乳房密度并分割乳房超声图像(Dhungel等人,2017; Ahn等人,2017; Xu等人,2019年)。Mordang等人,采用OxfordNet进行乳房X线照相术微钙化检测(Mordang等人,2016年b)。Hu等人,提出了一种用于乳腺肿瘤分割的扩张的完全卷积网络(Hu等人,2019年)。Mishra等人,开发了一种具有深度监督的完全卷积神经网络,用于路门分割和肝脏病变分割(Mishra等人,2018年)。

为了提高逐像素预测的准确性,许多研究人员考虑在网络中加入长程依赖和上下文信息,从而增强逐像素预测的特征表示。例如,空间金字塔池化(ASPP)被设计为嵌入全局上下文信息,并且它在DeepLabv2中被广泛采用(Chen等人,2014)和DeepLabv3(Chen等人,2018年)。同样,Zhao等人,设计了金字塔池化模块以收集具有不同尺度的有效上下文先验(Zhao等人,2017年)。此外,EncNet引入了一种通道注意力机制来捕获全局上下文(Zhang et al.,2018年)。Peng等人,认为大内核在语义分割任务中起着重要作用,并且提出了全局卷积网络来学习上下文信息(Peng et al.,2017年)。在医学图像分析领域中,最近有一些工作也考虑了上下文信息,例如编码器-解码器结构(Ronneberger等人,2015)融合了中级和高级特征以获得不同尺度的上下文。在方尖碑网络(Heinrich等人,2019),稀疏可变形卷积被制定为学习大的上下文信息。然而,这些方法大多堆叠了一系列卷积层来捕获上下文信息。已经提出了几项工作来通过隐含地利用注意力机制或非局部操作来增加感受野并捕获上下文信息来缓解这个问题(Wang等人,2018a; Vaswani等人,2017; Schlemper等人,2019; Zhang等人,2017; Roy等人,2018; Joutard等人,2019年)。然而,多层特征中的精细特征和特征通道之间的长程依赖性被忽略。在这方面,我们引入了一个网络,优雅地统一了上述方法,它不仅考虑了空间上和通道上的长程依赖关系,而且还嵌入了来自不同层的上下文信息。

方法

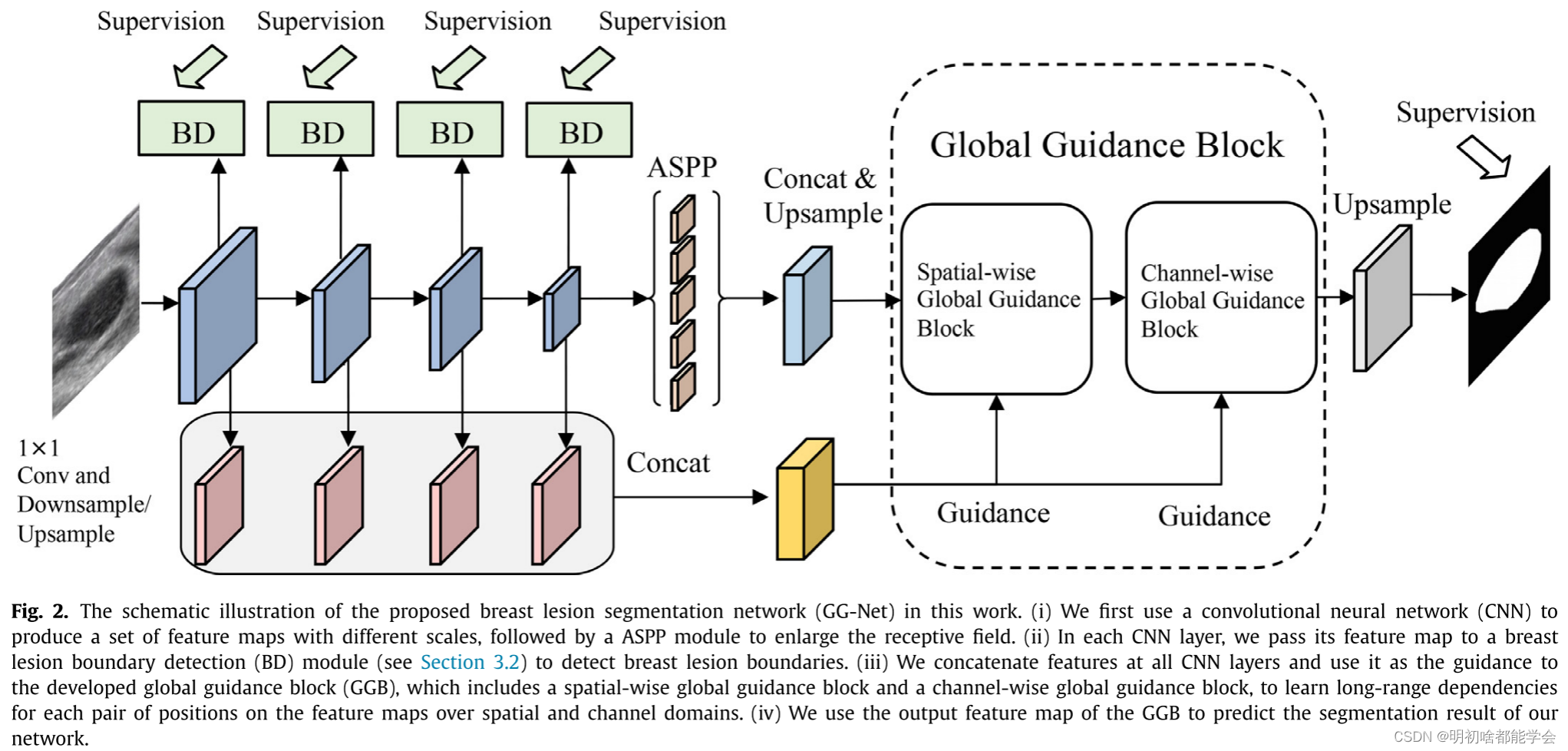

图2示出了所开发的网络(表示为GG-Net)的架构。我们的网络以乳腺超声图像作为输入,并以端到端的方式生成分段掩模。具体来说,我们的GG-Net首先使用CNN生成具有不同空间分辨率的多级特征图,并采用ASPP(Chen et al.,2018年),以增强功能的接受领域。为了利用不同CNN层之间的互补信息,GGB被引入以通过在来自浅CNN层的集成特征图的指导下学习远程特征依赖性来细化特征。此外,BD模块嵌入在浅CNN层中,以捕获乳腺病变轮廓,并为更好地分割乳腺病变和细化病变边界提供强有力的线索。最后,生成预测图作为我们网络的分割结果。在下面的小节中,我们将详细介绍我们的方法中开发的GGB和BD。

3.1. Global guidance block

CNN的卷积和递归运算仅捕获局部邻域内的空间依赖性。虽然堆叠卷积层可以学习长程依赖性,但是这种重复的局部卷积是耗时的,并且导致需要仔细解决的优化困难(Wang等人,2018年a)。此外,乳腺超声图像通常包含斑点和阴影,由于局部卷积的有限感受野,这些斑点和阴影往往被识别为乳腺病变。在这方面,我们开发了一个全球性的指导块(GGB),它利用的指导功能地图,学习的长期依赖关系,考虑空间和信道信息。

3.1.1. Spatial-wise global guidance block

来自浅CNN层的特征图提供了详细的信息,但包含更多的非病变区域,而具有较大接收场的深CNN层消除了非病变区域,但往往会丢失局部细节。在这方面,我们认为不同CNN层的特征图包含互补信息,如图3所示。在我们的方法中,我们首先将前四个CNN层的特征映射调整为第二个CNN层的特征映射的大小,然后将它们连接到一个多层集成特征(MLIF)映射。在此基础上,提出了一种空间全局制导块(spatial-wise GGB),以MLIF为制导图,学习远程位置依赖关系。

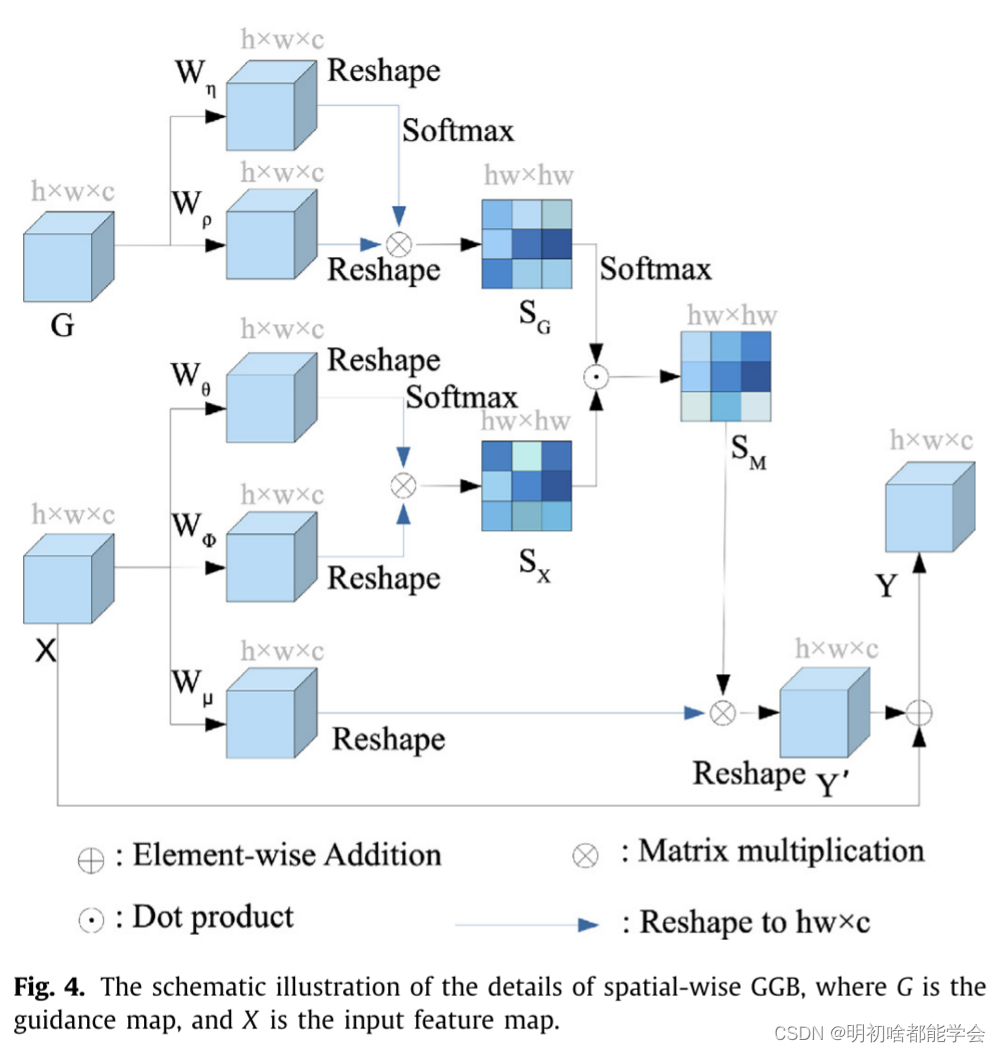

图4示出了我们的空间方向GGB的示意图。具体来说,让X(x ∈ R h ×w ×c)表示ASPP模块的输出特征图(见图2),G(g ∈ R h ×w ×c)表示引导图。空间方向的GGB首先将X馈送到具有不同参数W θ(x)、W φ(x)和W μ(x)的三个1 × 1卷积层中,以分别生成三个特征图θ(x)、φ(x)和μ(x)。之后,我们将θ(x)、φ(x)和μ(x)重塑为R hw ×c矩阵,将重塑后的φ(x)与重塑后的θ(x)的转置相乘,并在相乘结果上应用softmax层以计算hw × hw空间位置相似性映射S x:

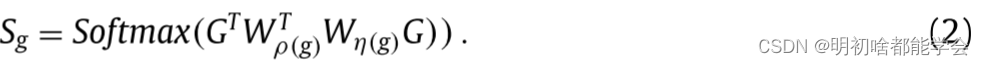

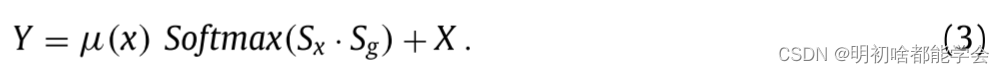

其中sof tmax遵循传统的sigmoid函数,并应用于hw × hw X T W T θ(x)W φ(x)X的每个元素。另一方面,在引导图G上应用具有参数W η(g)和W ρ(g)的两个1 × 1卷积层,以获得两个特征图η(x)和ρ(x),重塑η(x)和ρ(x),将重塑的η(x)乘以重塑的ρ(x)的转置,并应用softmax层,用于从导航地图G产生另一个hw × hw位置相似性矩阵(表示为Sg):

一旦获得两个相似性矩阵S X和S G,我们就在S X和S G的逐元素乘法结果上使用softmax层来生成引导相似性矩阵S M。然后,我们将S M与特征μ(x)相乘以获得新的特征图Y,然后将其与输入特征X相加以生成输出特征图Y:

3.1.2. Channel-wise global guidance block

我们的空间明智的GGB对待每个特征通道平等学习时,长期的依赖关系,导致忽略了不同的特征通道之间的相关性。最近,允许来自不同特征通道的不同贡献已经在许多计算机视觉任务中实现了上级性能(Hou等人,2019; Chen等人,2017 a; Hu等人,2018年)。受此启发,我们开发了一个通道式全局指导块(通道式GGB),以进一步学习不同特征通道之间的长期相互依赖关系。图5示出了所提出的逐通道GGB的示意性细节,其将特征图Y和引导图G作为两个输入并生成细化的特征图Z。具体来说,我们将Y重塑为Rc ×hw,将重塑后的Y与重塑后的Y的转置相乘,并使用softmax层来获得通道方向的相似性映射S Z ∈ Rc ×c。对于输入引导特征图G,我们首先使用挤压和激励块来强调G的信息特征通道,并抑制不太有用的。为了实现这一点,我们使用全局平均池化来生成通道方式的统计数据β,并且描述符(β)的第k个元素由下式给出:

其中G(i,j,k)表示导航地图G的位置(i,j,k)处的元素。之后,我们使用两个全连接(fc)层和通道统计量β上的S形激活函数来生成系数向量V λ:

其中G(i,j,k)表示导航地图G的位置(i,j,k)处的元素。之后,我们使用两个全连接(fc)层和通道统计量β上的sigmoid激活函数来生成系数向量V λ:V λ =(W 2(W 1 β))(5)其中W 1和W 2表示两个全连接层的参数,分别是ReLU和sigmoid激活函数。然后,我们将V λ与G相乘,以在G的通道上分配不同的权重,并获得细化的特征图(表示为G λ)。一旦获得G,我们将其重塑为Rc ×hw,将重塑的G与重塑的G的转置相乘,并使用softmax层生成c × c相似性映射S G。随后,softmax层被应用于S Z和S G的乘法,以获得引导相似性图S Q。最后,我们将SQ与输入Y相乘以产生新的特征图Z,然后将其添加到输入特征Y以获得我们的通道方式GGB的输出特征图Z。

3.2. Breast lesion boundary detection module 3.2.乳腺病灶边界检测模块

虽然GGB生成了乳腺病变分割结果,但我们发现结果中存在许多分割失败的区域,如图6(e)所示,这些区域具有不准确的乳腺病变边界图。为了缓解这一问题,我们开发了一个乳腺病变边界检测(BD)模块,以识别乳腺病变的多级边界图,并增强分割结果与额外的边界预测损失。图7示出了在第i个CNN层处开发的BD模块以检测乳腺病变边界的示意图。它将第i层CNN的特征图作为输入,并输出乳腺病变的边界图和乳腺病变分割结果。具体来说,我们首先在输入特征F(i)上使用1 × 1卷积层,以获得具有一个通道的新特征映射F φ(i)。然后,我们通过最大池化操作将F φ(i)移位一个像素(步幅= 1,填充= 1,内核大小= 3 × 3 ;参见(Feng et al.,2019),并从F φ(i)中减去移位结果,以获得乳腺病变的边界图E。之后,我们将F φ(i)与E相加以获得乳腺病变分割图。

32

32

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?