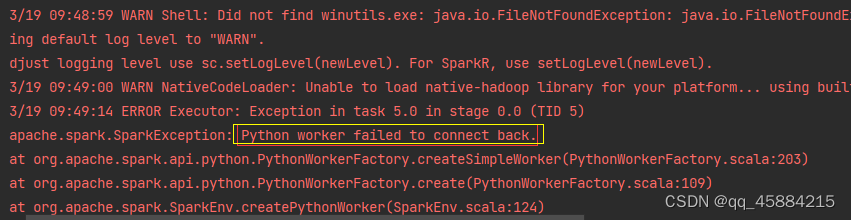

1、问题描述

2、解决方案

spark找不到python在哪里,所以需要添加python的绝对路径地址,以下代码即可

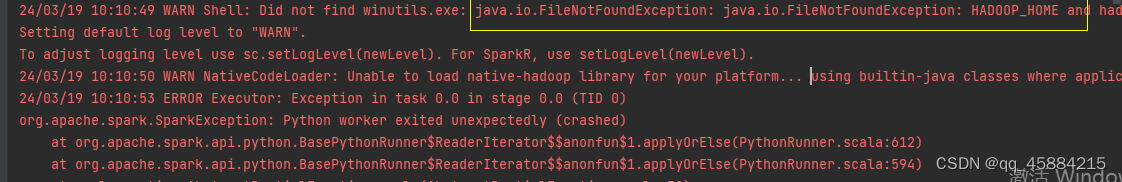

3、在解决完上诉问题后,又出现

4、如果添加完Java路径以后还是报错,那么就考虑是python版本的问题,降低python版本即可,注意,需要将pyspark安装到该python路径下,可以参考以下方式多版本 Python 使用 pip 安装 package_多版本python pip-CSDN博客

5、如果4无法将pyspark安装到该python版本的路径下,可以考虑将之前版本的python删掉后,重新安装,我目前改用3.10.11版本后能够正常运行,之前的版本为3.12

485

485

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?