pytorch中loss求梯度-----以mse为例

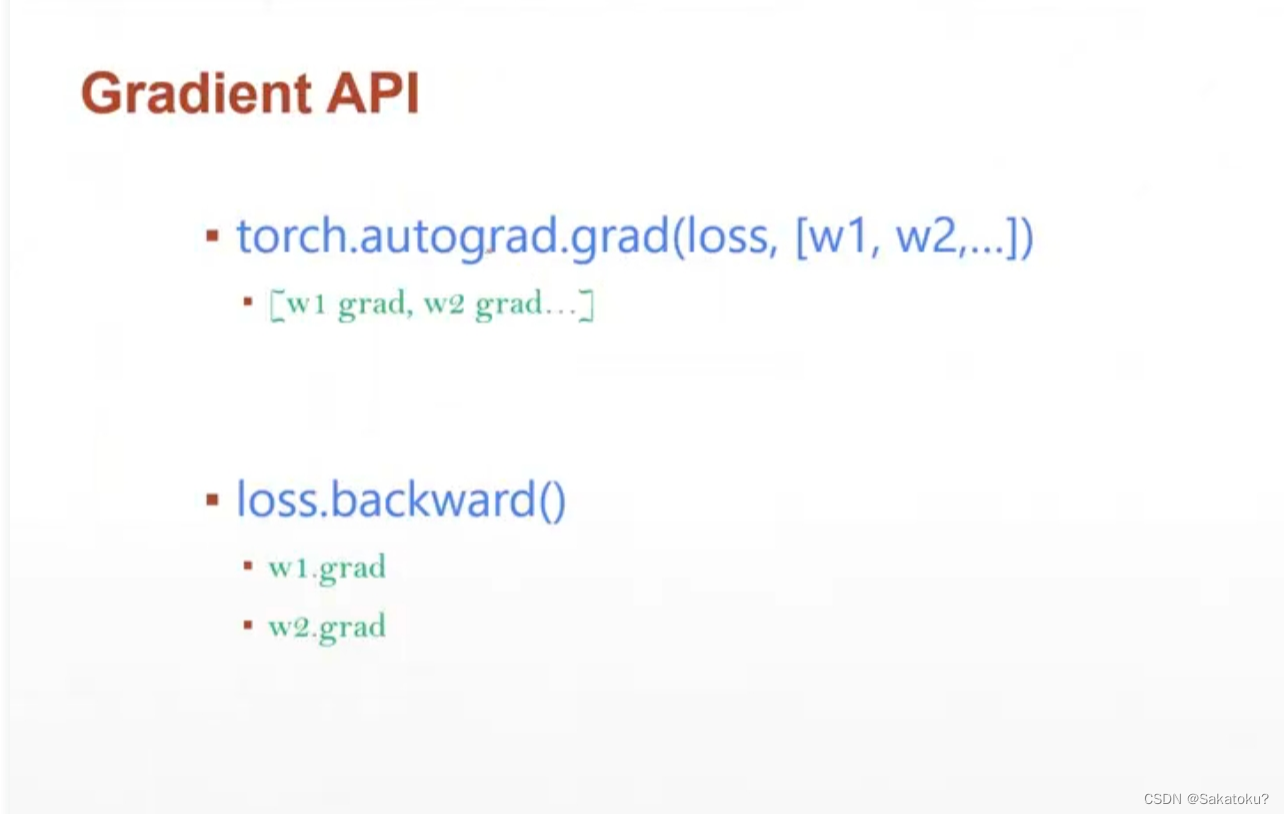

#法1 autograd.grad

x=torch.ones(1)

w=torch.full([1],2.)

w.requires_grad=True#要求开启梯度

mse=F.mse_loss(torch.ones(1),x*w)

a=torch.autograd.grad(mse,[w])

print(mse)

print(a)

#法2 loss.backward

x=torch.ones(1)

w=torch.full([1],2.)

w.requires_grad=True#要求开启梯度

mse=F.mse_loss(torch.ones(1),x*w)

mse.backward()

191

191

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?