今天学习比较仓促,已经是快到deadline了,所幸内容不是很难,那我就来抓住今天的尾巴来打个卡。今天学到的主要内容是SSL验证、代理设置、超时设置、与身份认证。其他几个我都可以实践并且记录,不过代理设置还需要花费来买ip,所以本篇文章我们暂时跳过这个内容,具体可以参照https://chuanchuan.blog.csdn.net/article/details/120873957

SSL验证

由于我这个小白对这个东西不清楚,所以又专门查阅了一下SSL出现的原因及其表达的意义。

requests发送https请求时默认验证ssl证书,此时如果访问的地址ssl证书过期失效或不信任,则请求失败。

很不幸的是这样验证失败的网站我暂时还找不到例子,以下我尝试了好多次结果都给成功了。

总之我们知道当出现以下错误的时候

InsecureRequestWarning: Unverified HTTPS request is being made. Adding certificate verification is strongly advised. See: https://urllib3.readthedocs.io/en/latest/advanced-usage.html#ssl-warnings

InsecureRequestWarning

为了使请求成功,我们可以设置verify为False,暂时不验证。

结果我们出现了这种报错

可以看到报错有个警告,让我们添加证书,我们可以通过设置忽略警告的方式来屏蔽这个警告

import requests

from requests.packages import urllib3

urllib3.disable_warnings()

response = requests.get('https://cdgavin.tuchong.com/103192513/#image1138892868', verify=False)

print(response.status_code)

这样我们就忽略了这条警告

我们也可以通过下面这条捕获日志式来捕获警告(logging.captureWarnings)

import logging

import requests

logging.captureWarnings(True)

response = requests.get('https://cdgavin.tuchong.com/103192513/#image1138892868', verify=False)

print(response.status_code)

超时设置

在本机网络状况不好或者服务器网络响应太慢甚至无响应时,我们可能会等待特别久的时间才可能收到响应,甚至到最后收不到响应而报错。为了防止服务器不能及时响应,应该设置一个超时时间,即超过了这个时间还没有得到响应,那就报错。这需要用到 timeout 参数。这个时间的计算是发出请求到服务器返回响应的时间。

这个参数表示我们可以接受的最长的一个等待时间,当我们timeout是一个数值的时候,他表示请求的连接和读取总时长限度,我们也可以元组(a,b)形式来分别做一个限制。当然不设置即默认为None,他将一直等待下去。

一般来说,我们的电脑处理速度很快,我们不会触发到这个错误,所以我故意设置了一个值让他报错

import requests

r = requests.get('https://cdgavin.tuchong.com/103192513/#image1138892868', timeout=0.00000000001)

print(r.status_code)

那我们为了严谨点,再把timeout变大些,看他是否成功呢

果然,他成功了!

身份认证

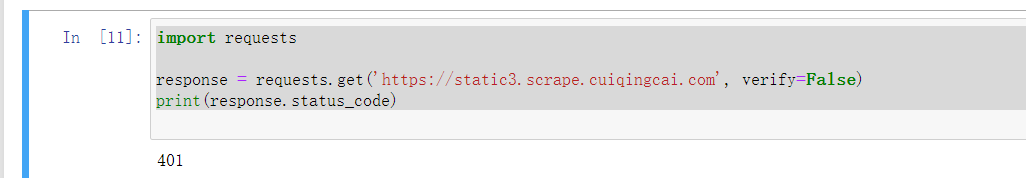

虽然我也不懂具体为什么要有身份认证这一环,但想来无非就是安全二字吧。比如说这个网站https://static3.scrape.cuiqingcai.com

起初我不添加verify=False结果他报错一大堆,那我于是要添加这个来看看是不是他的问题(盲猜不是,但需要验证)

import requests

response = requests.get('https://static3.scrape.cuiqingcai.com', verify=False)

print(response.status_code)

但接下来我改进了,不会报错,但会出现401,应该是我的用户名和密码没有通过认证吧。

import requests

from requests.auth import HTTPBasicAuth

r = requests.get('https://static3.scrape.cuiqingcai.com/', auth=HTTPBasicAuth('username', 'password'),verify=False)

print(r.status_code)

但下面的另一种摘要式身份认证,我还是得到了想要的结果。

import requests

from requests.auth import HTTPDigestAuth

url = 'http://httpbin.org/digest-auth/auth/user/pass'

requests.get(url, auth=HTTPDigestAuth('user', 'pass'))

我只能说,这确实挺神奇的,更深的原理需要继续学习。

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?