目录

HDFS完全分布式集群搭建详细步骤:

一 步骤框架

- 前期准备工作(准备3台虚拟机)

----将默认主机名(hostname)修改为node01、node02、node03。

----修改每台机器/etc/hosts文件

2. 配置环境工作

----分别修改Hadoop-env.sh和yarn-env.sh

----修改核心配置文件core-site.xml

----修改核心配置文件hdfs-site.xml

----修改核心配置文件yarn-site.xml

----修改核心配置文件mapred-site.xml

----修改配置文件slaves文件

注:这四个配置文件都存放在/opt/software/hadoop/hadoop-2.9.2这个路径下,我们需要在这个路径下去修改这些配置文件。Hadoop的安装版本是Hadoop-2.9.2

二 详细配置过程(傻瓜式配置过程)

1.检查当前环境

----网络配置

----主机名配置

----主机名映射

----防火墙与selinux的关闭

----ssh免密

----JDK的安装

注:具体详见下文

2.开始配置操作

----创建安装目录

cd /opt

mkdir software

cd software

mkdir hadoop

cd hadoop/

mkdir hdfs

cd hdfs/

mkdir data

mkdir name

mkdir tmp----返回hadoop目录上传文件

cd /opt/software/hadoop/

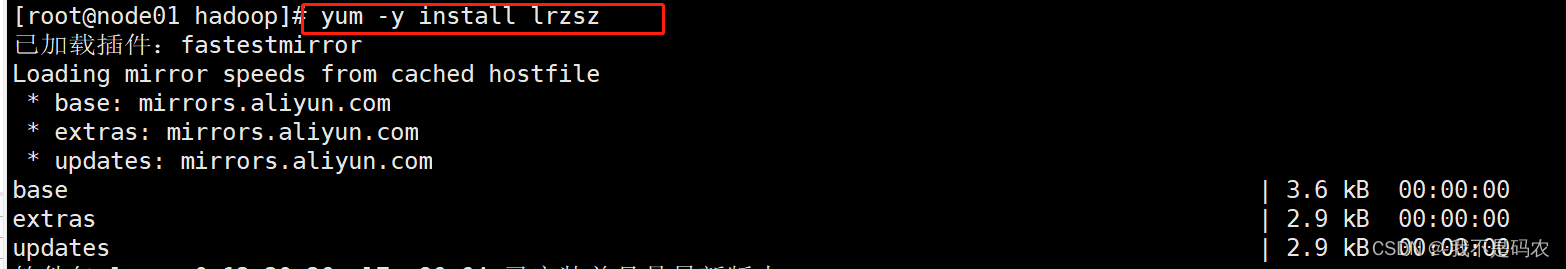

----安装lrzsz插件

yum -y install lrzsz

----rz#上传hadoop-2.9.2.tar.gz(或者直接将压缩包拖拽进命令行)

![]()

----将上传的文件进行解压

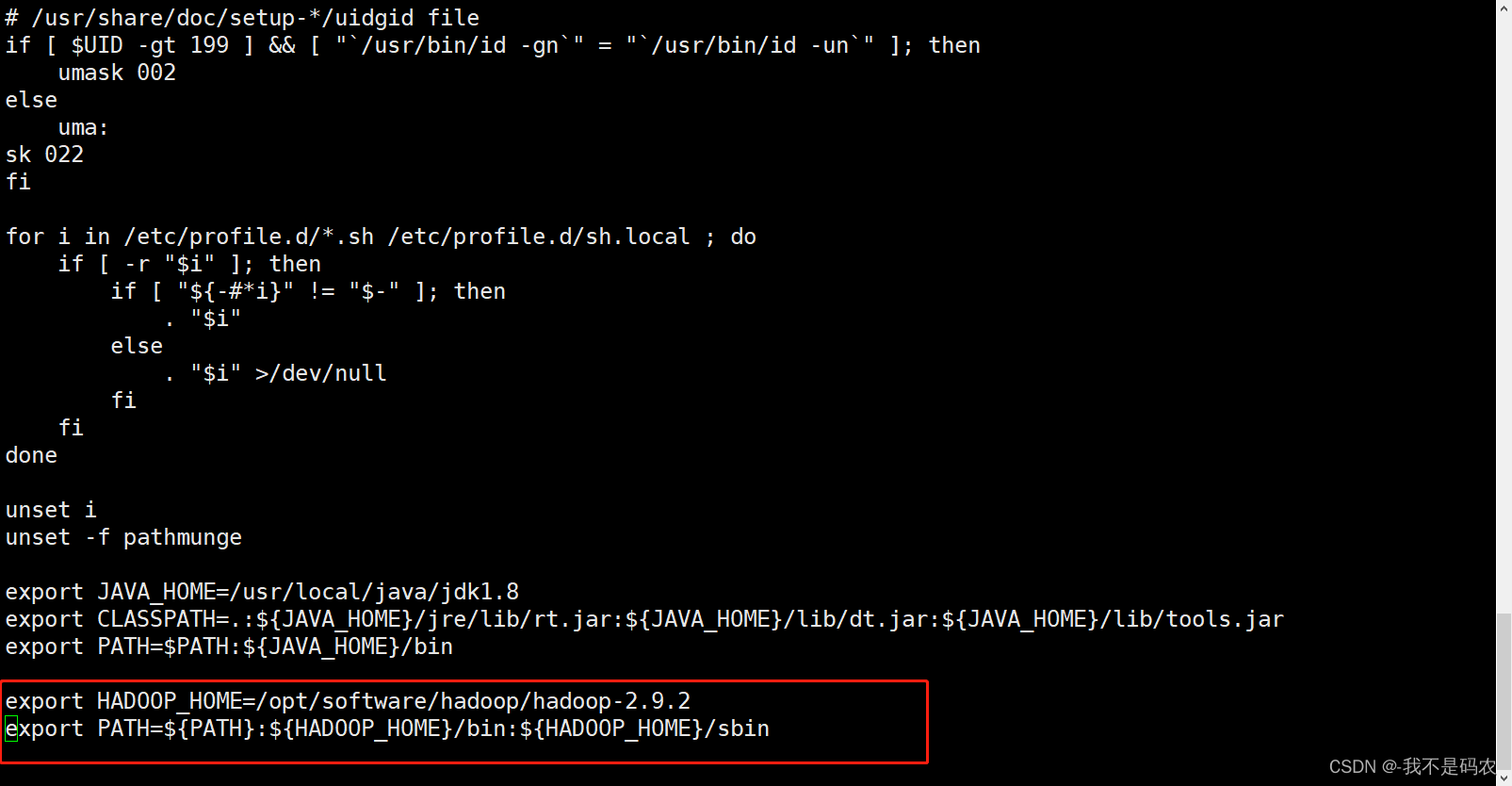

tar -xvzf hadoop-2.9.2.tar.gz----配置HADOOP HOME的环境变量

vi /etc/profile----打开配置文件后将以下代码键入最底部

export HADOOP_HOME=/opt/software/hadoop/hadoop-2.9.2

export PATH=${PATH}:${HADOOP_HOME}/bin:${HADOOP_HOME}/sbin

----刷新配置文件

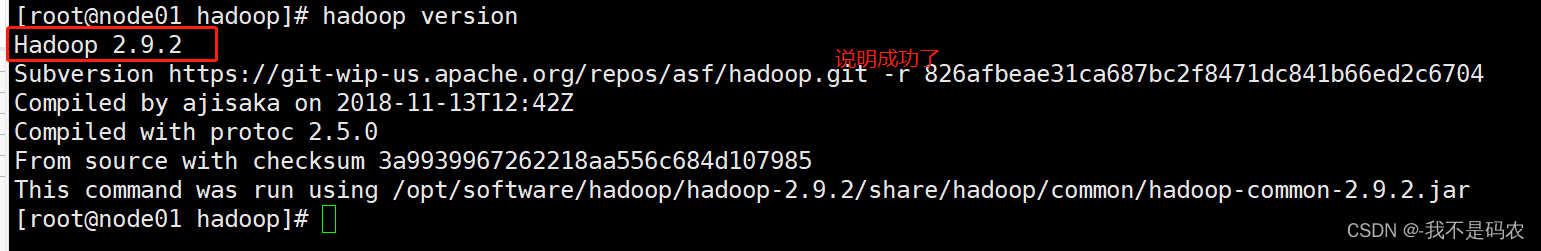

source /etc/profile----测试hadoop是否安装成功

hadoop version

----配置hadoop-env.sh(仅修改JA

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1338

1338

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?