主节点:

要提前配好hosts文件

hadoop-env.sh\yarn-env.sh\mapred-env.sh配置jdk环境

core-site.sh\hdfs-site.sh\yarn-site.sh\mapred-site.sh配置文件

配置环境变量

1.scp hadoop

2.scp hosts

3.scp profile

4.启动zk

5.启动journalnode hadoop-daemon.sh start journalnode

6.格式化HDFS系统hdfs namenode -format

7.启动hadoop上的nodename系统:hadoop-daemon.sh start namenode

8.启动datanode:hadoop-daemon.sh start datanode

9.添加hdfs.site.sh/core-site.sh

10.单独scp hdfs-site.sh/core-site.sh到子节点

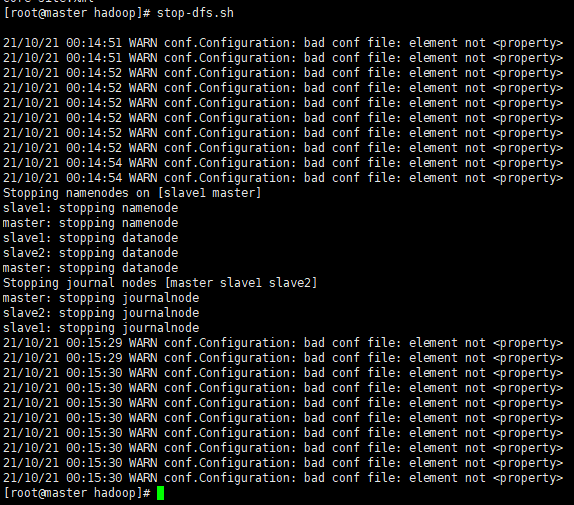

11.关闭HDFS服务

12.启动zookeeper

13.初始化HA在zookeeper中的状态:hdfs zkfc -formatZK

14.启动HDFS服务:start-dfs.sh

子节点1:

1.生效环境变量

2.启动zk

3.启动journalnode hadoop-daemon.sh start journalnode

4.从 Active NameNode 节点拷贝 HDFS

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

6501

6501

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?