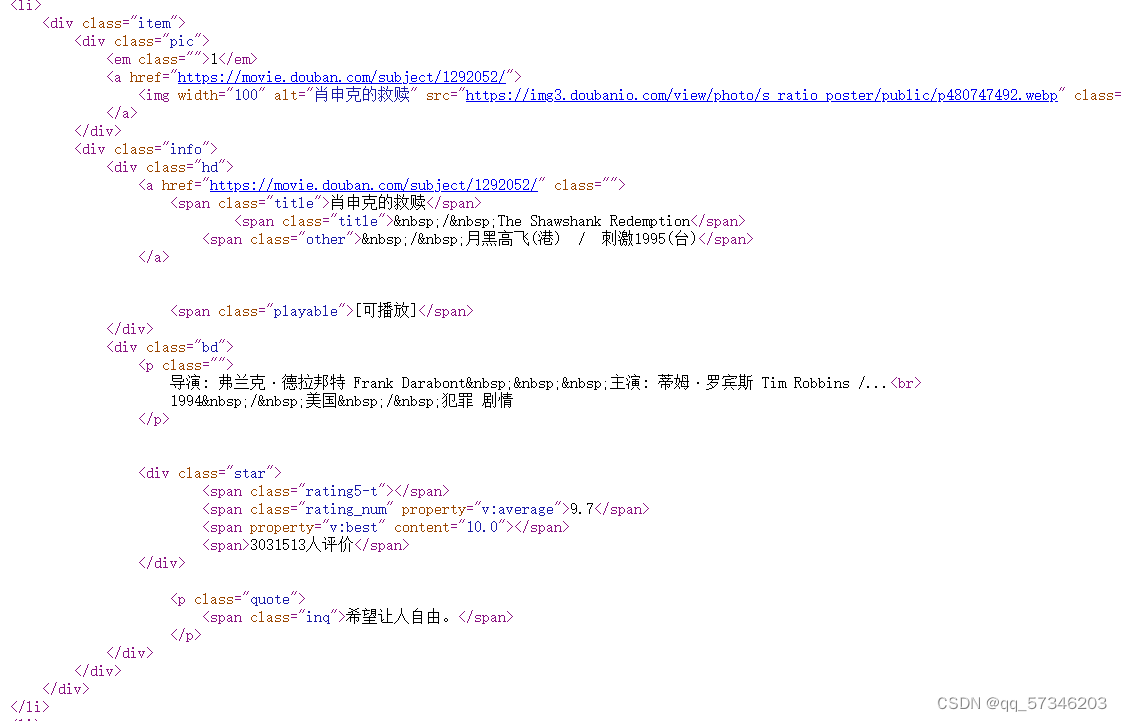

打开豆瓣电影,F12进入网页源代码,然后ctrf+f搜索肖申克的救赎,找到<li>标签。

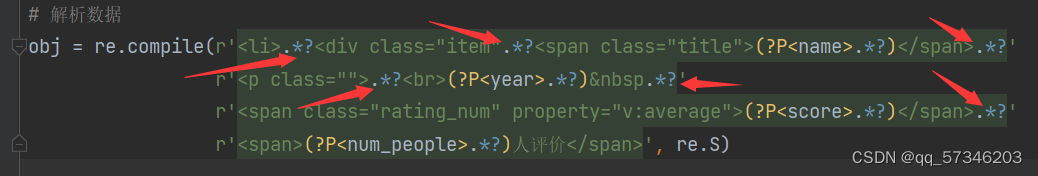

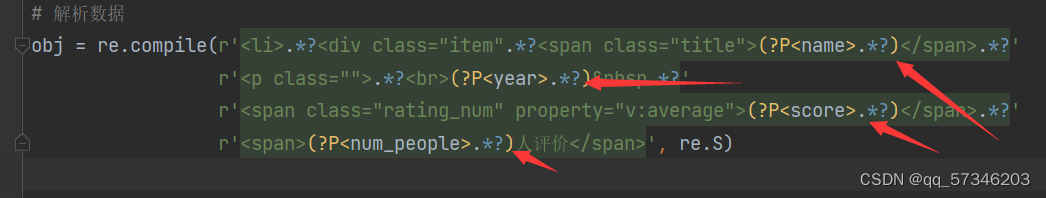

中间的.*?是处理空格回车等问题

提取有效数据使用(?P<xxx>.*?),xxx相当于一个想要提取数据的一个名字

如果不设置浏览器上的“User-Agent”参数,代码能运行但提取不到数据。

只匹配电影名字、年份、电影评分和评分人数四项。

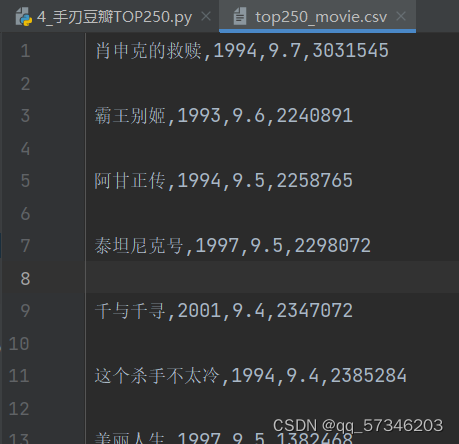

csv是纯文本格式,具有一系列用逗号分隔的值。

# 拿到页面源代码, requests

# 通过re提取想要的有效信息, re

import requests

import re

import csv

url = "https://movie.douban.com/top250"

headers = {

"User-Agent" : "Mozilla/5.0 (Linux; Android 6.0; Nexus 5 Build/MRA58N) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/125.0.0.0 Mobile Safari/537.36"

}

resp = requests.get(url, headers=headers)

page_content = resp.text # 拿到页面源代码并用变量page_content代表页面源代码

# 解析数据

obj = re.compile(r'<li>.*?<div class="item".*?<span class="title">(?P<name>.*?)</span>.*?'

r'<p class="">.*?<br>(?P<year>.*?) .*?'

r'<span class="rating_num" property="v:average">(?P<score>.*?)</span>.*?'

r'<span>(?P<num_people>.*?)人评价</span>', re.S)

# 开始匹配

result = obj.finditer(page_content)

# encoding="utf-8"解决中文乱码问题

f = open("top250_movie.csv", encoding="utf-8", mode="w")

csvwriter = csv.writer(f)

for it in result:

# print("电影名字:", it.group("name"))

# print("电影评分:", it.group("score"))

# print("评分人数:", it.group("num_people"))

# print("电影年份:", it.group("year").strip()) # strip方法处理掉年份前面的空格

dic = it.groupdict()

dic['year'] = dic['year'].strip() # strip方法单独处理一下字典中'year'的空格问题

csvwriter.writerow(dic.values())

f.close()

print("over!!!")

运行完以后会生成一个文件 top250_movie.csv

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?