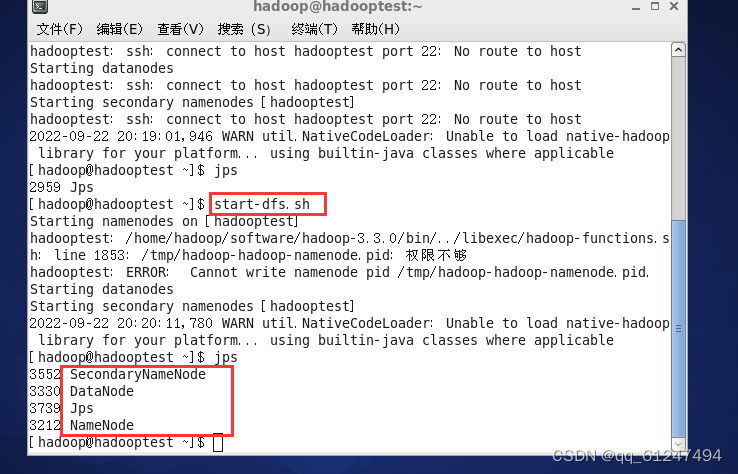

首先,在虚拟机上启动hdfs

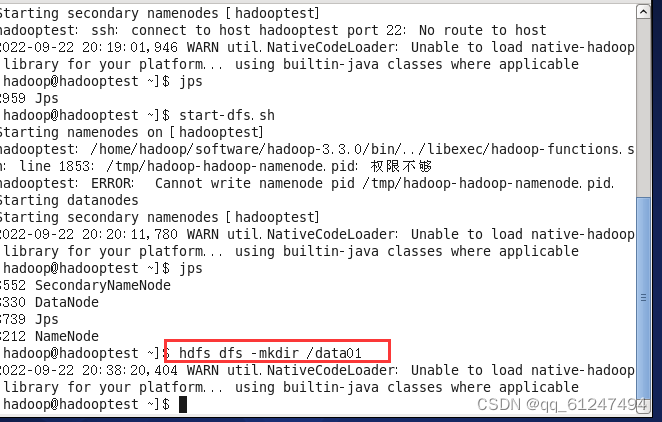

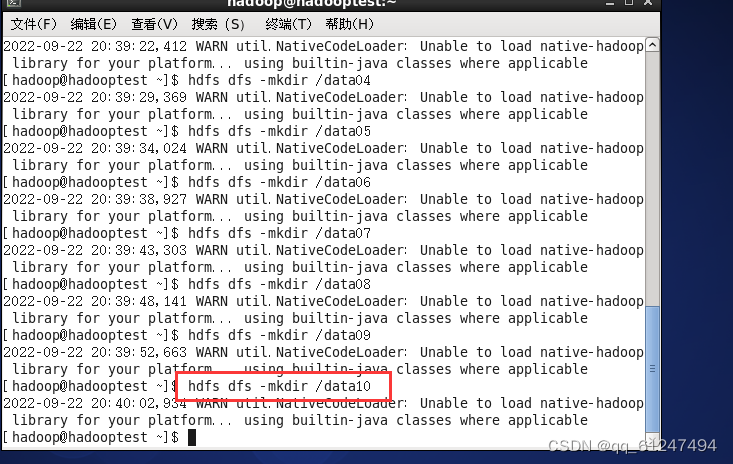

1.在HDFS的/上创建10目录(data01~data10)

①输入命令:hdfs dfs -mkdir /da01 (~data10)

②在浏览器网址栏9870端口查看命令结果如下

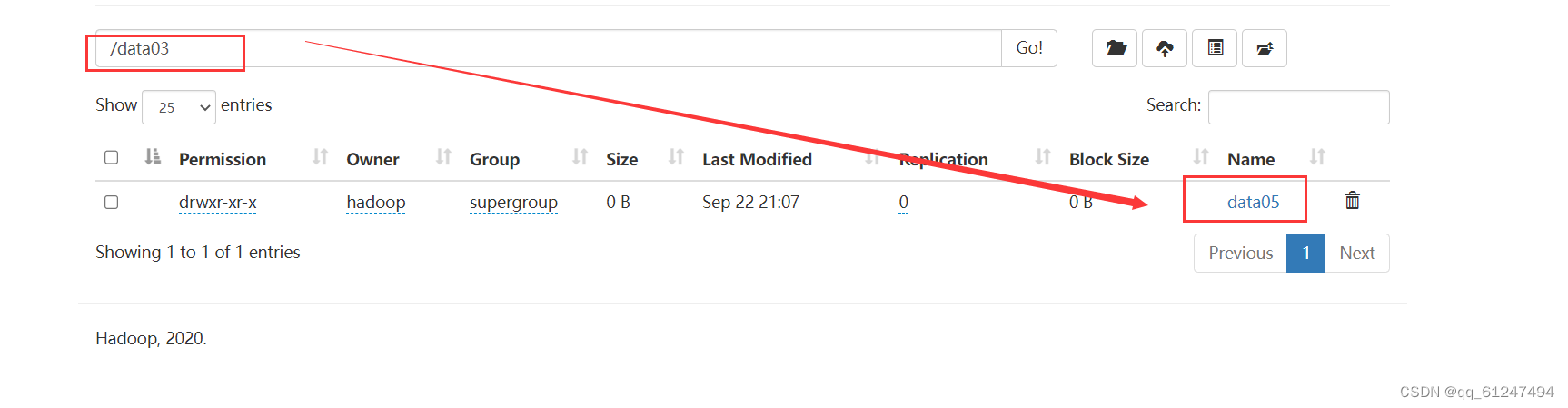

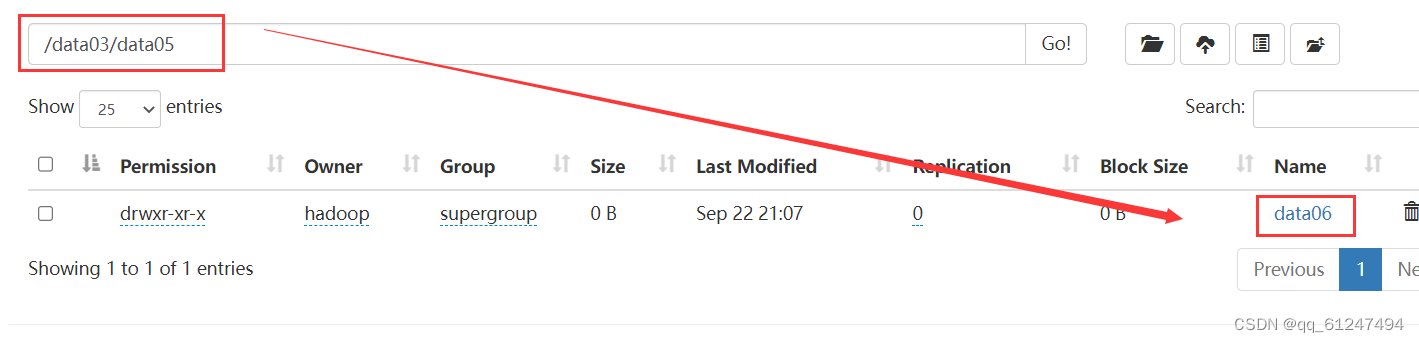

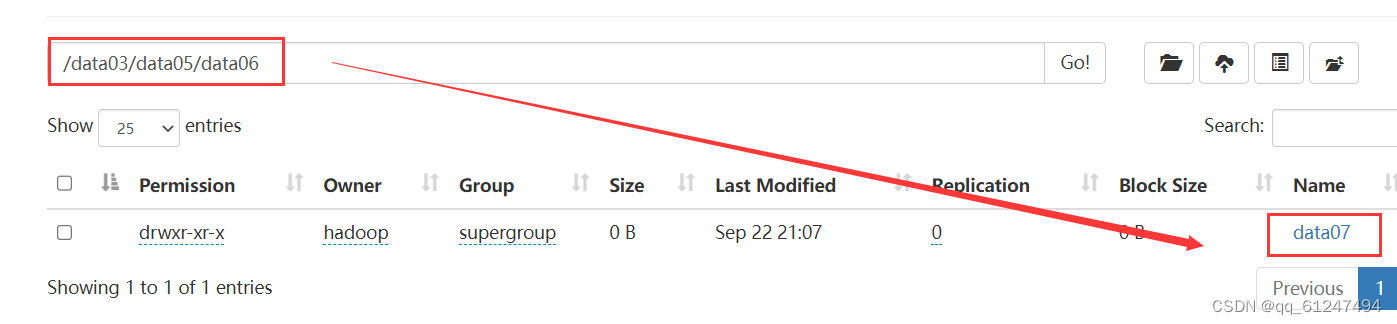

2.在HDFS的/data03下递归创建/data05/data06/data07

①输入命令:hdfs dfs -p /data03/data05/data06/data07

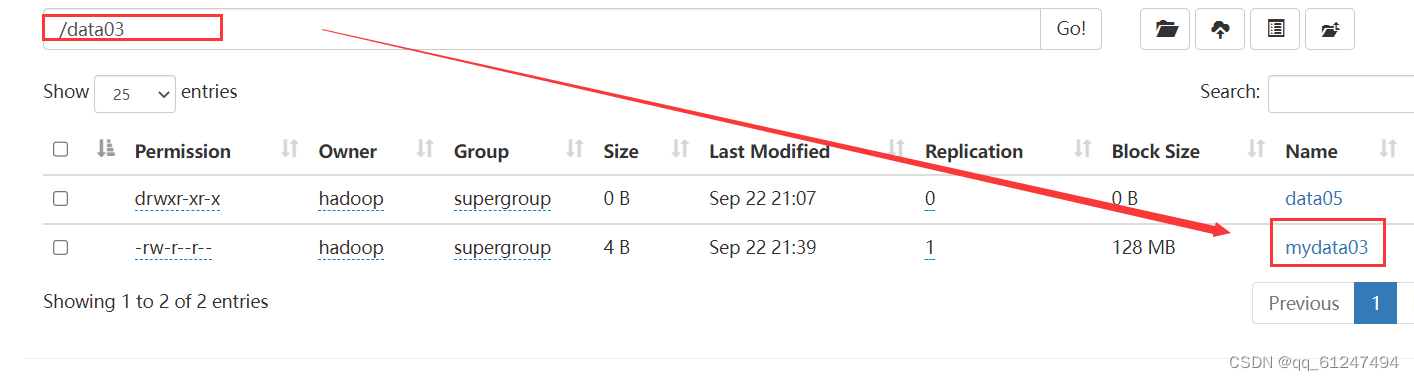

②在浏览器网址栏9870端口查看命令结果如下

3.在/home/hadoop/software/自己名字命名 目录下创建5分有数据的文件(mydata01-mydata05)文件内容自定义。

输入命令:

mkdir yt

vim mydata01进入编辑

cat mydata01~05查看是否创建成功

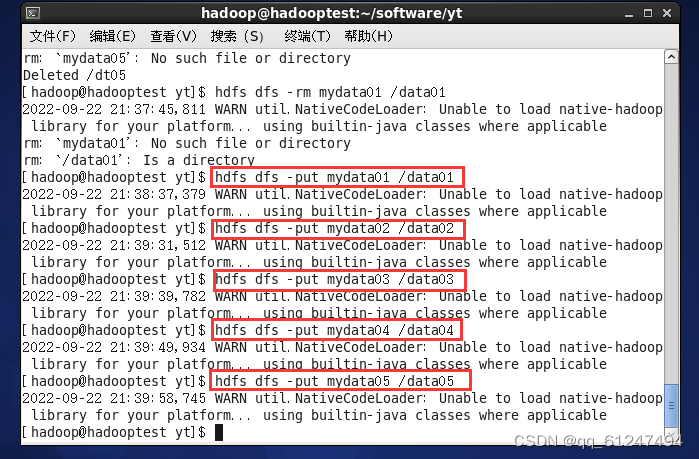

4.把mydata01上传到HDFS的/data01,把mydata02上传到HDFS的/data02,以此类推,

把5份文件都上传到大数据平台的HDFS上。

①输入命令:hdfs dfs -put mydata01(~05) /data01(~05)

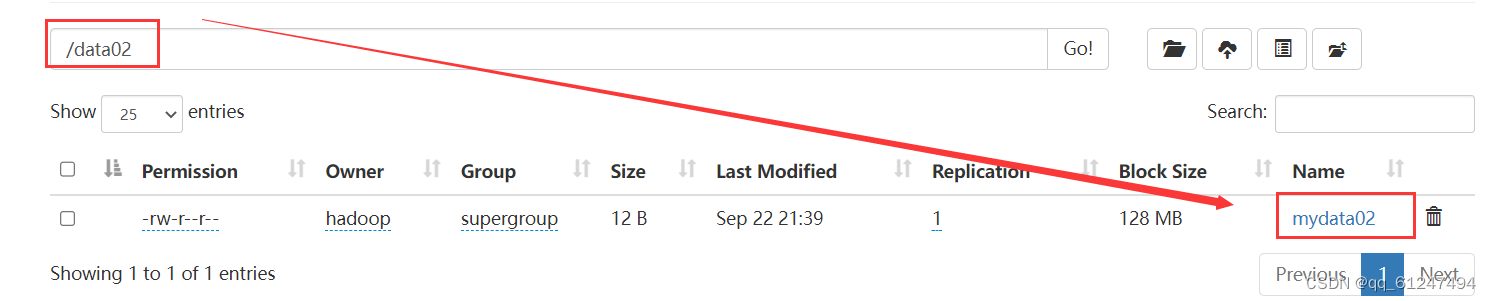

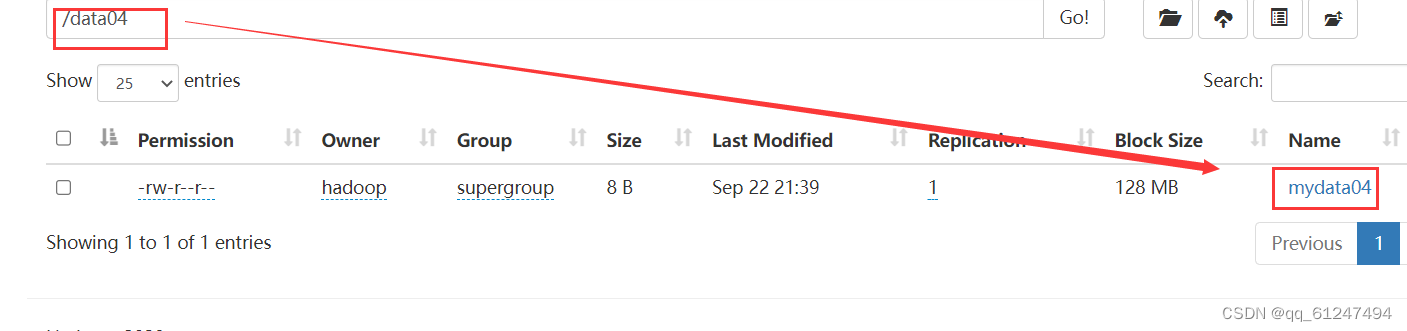

②在浏览器网址栏9870端口查看命令结果如下

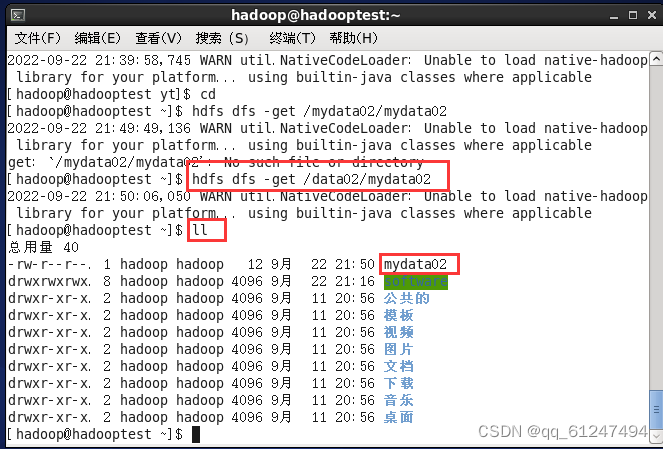

5.把大数据平台HDFS上/data02/mydata02文件下载到Linux本地的/home/hadoop路径下

①输入命令:hdfs dfs -get /data02/mydata02

②输入命令:ll查看是否下载到本地,如图

309

309

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?