文章目录

缓存双写一致性

同步直写策略

- 写数据库后也同步写redis缓存,缓存和数据库中的数据一致;

- 对于读写缓存来说,要想保证缓存和数据库中的数据一致,就要采用同步直写策略。

异步缓写策略

- 正常业务运行中,mysql数据变动了,但是可以在业务上容许出现一定时间后才作用于redis,比如仓库、物流系统。

- 异常情况出现了,不得不将失败的动作重新修补,有可能需要借助kafka或者RabbitMQ等消息中间件,实现重试重写。

双检加锁策略

多个线程同时去查询数据库的这条数据,那么我们可以在第一个查询数据的请求上使用一个 互斥锁来锁住它。

其他的线程走到这一步拿不到锁就等着,等第一个线程查询到了数据,然后做缓存。

后面的线程进来发现已经有缓存了,就直接走缓存。

@Service

@Slf4j

public class UserService {

public static final String CACHE_KEY_USER = "user:";

@Resource

private UserMapper userMapper;

@Resource

private RedisTemplate redisTemplate;

public User findUserById(Integer id)

{

User user = null;

String key = CACHE_KEY_USER+id;

//1 先从redis里面查询,如果有直接返回结果,如果没有再去查询mysql

user = (User) redisTemplate.opsForValue().get(key);

if(user == null)

{

//2 redis里面无,继续查询mysql

user = userMapper.selectByPrimaryKey(id);

if(user == null)

{

//3.1 redis+mysql 都无数据

//你具体细化,防止多次穿透,我们业务规定,记录下导致穿透的这个key回写redis

return user;

}else{

//3.2 mysql有,需要将数据写回redis,保证下一次的缓存命中率

redisTemplate.opsForValue().set(key,user);

}

}

return user;

}

public User findUserById2(Integer id)

{

User user = null;

String key = CACHE_KEY_USER+id;

//1 先从redis里面查询,如果有直接返回结果,如果没有再去查询mysql,

// 第1次查询redis,加锁前

user = (User) redisTemplate.opsForValue().get(key);

if(user == null) {

//2 大厂用,对于高QPS的优化,进来就先加锁,保证一个请求操作,让外面的redis等待一下,避免击穿mysql

synchronized (UserService.class){

//第2次查询redis,加锁后

user = (User) redisTemplate.opsForValue().get(key);

//3 二次查redis还是null,可以去查mysql了(mysql默认有数据)

if (user == null) {

//4 查询mysql拿数据(mysql默认有数据)

user = userMapper.selectByPrimaryKey(id);

if (user == null) {

return null;

}else{

//5 mysql里面有数据的,需要回写redis,完成数据一致性的同步工作

redisTemplate.opsForValue().setIfAbsent(key,user,7L,TimeUnit.DAYS);

}

}

}

}

return user;

}

}

数据库和缓存一致性的几种更新策略(不停机情况)

先更新数据库,再更新缓存(有隐患)

异常问题1

1 先更新mysql的某商品的库存,当前商品的库存是100,更新为99个。

2 先更新mysql修改为99成功,然后更新redis。

3 此时假设异常出现,更新redis失败了,这导致mysql里面的库存是99而redis里面的还是100 。

4 上述发生,会让数据库里面和缓存redis里面数据不一致,读到redis脏数据。

异常问题2

【先更新数据库,再更新缓存】,A、B两个线程发起调用

正常逻辑

1 A update mysql 100

2 A update redis 100

3 B update mysql 80

4 B update redis 80

=============================

【异常逻辑】多线程环境下,A、B两个线程有快有慢,有前有后有并行

1 A update mysql 100

3 B update mysql 80

4 B update redis 80

2 A update redis 100

=============================

最终结果,mysql和redis数据不一致,

mysql80,redis100

先更新缓存,再更新数据库

同样会出现缓存数据库不一致的情况

A 更新缓存 80

B 更新缓存 100

B 更新数据库 100

A 更新数据库 80

缓存数据库不一致!

先删除缓存,再更新数据库

异常情况

A线程先成功删除了redis里面的数据,然后去更新mysql,此时mysql正在更新中,还没有结束。(比如网络延时)

B突然出现要来读取缓存数据。

2 此时redis里面的数据是空的,B线程来读取,先去读redis里数据(已经被A线程delete掉了),此处出来2个问题:

2.1 B从mysql获得了旧值

B线程发现redis里没有(缓存缺失)马上去mysql里面读取,从数据库里面读取来的是旧值。

2.2 B会把获得的旧值写回redis

获得旧值数据后返回前台并回写进redis(刚被A线程删除的旧数据有极大可能又被写回了)。

A线程更新完mysql,发现redis里面的缓存是脏数据,A线程直接懵逼了。

两个并发操作,一个是更新操作,另一个是查询操作,

A删除缓存后,B查询操作没有命中缓存,B先把老数据读出来后放到缓存中,然后A更新操作更新了数据库。

于是,在缓存中的数据还是老的数据,导致缓存中的数据是脏的,而且还一直这样脏下去了。

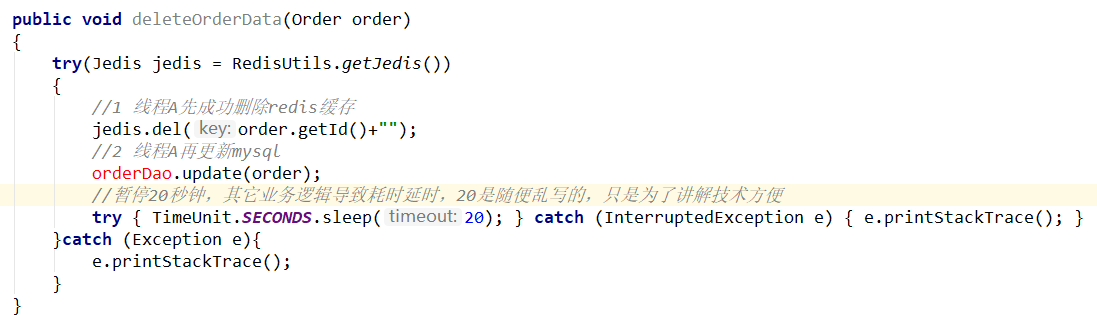

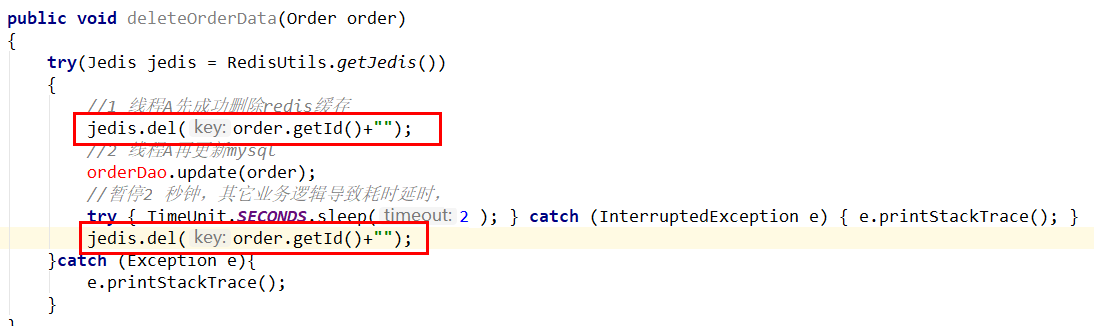

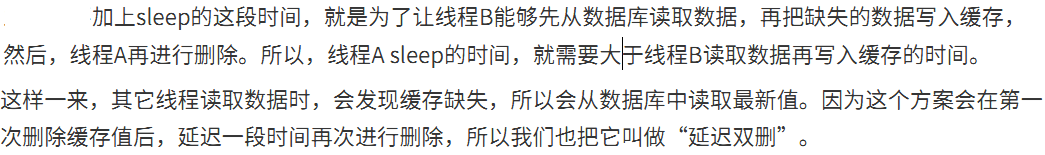

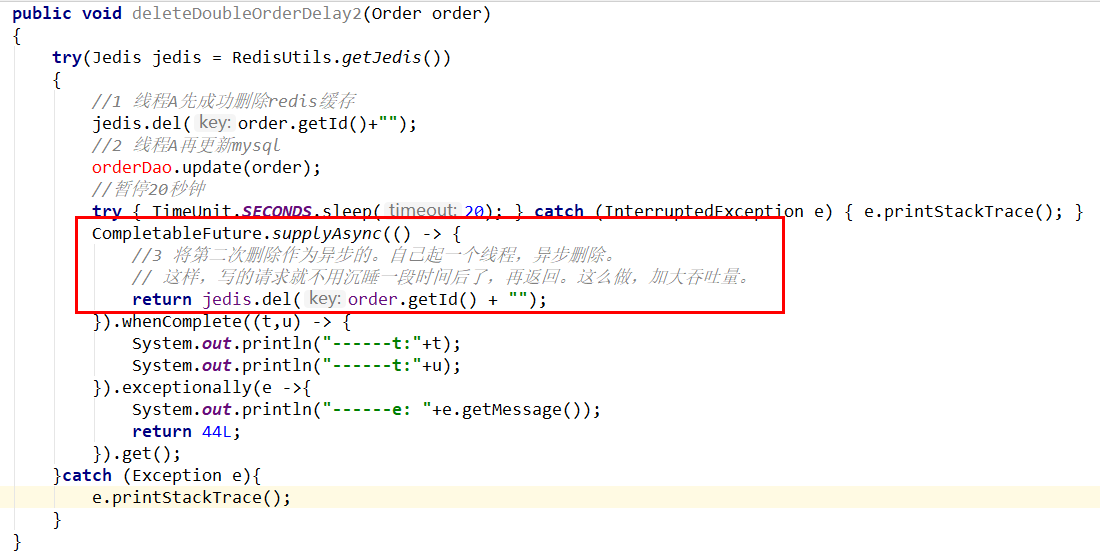

延时双删

这种删除该休眠多久?(面试)

线程A sleep的时间,就需要大于线程B读取数据再写入缓存的时间。

这个时间怎么确定呢?

第一种方法:

在业务程序运行的时候,统计下线程读数据和写缓存的操作时间,自行评估自己的项目的读数据业务逻辑的耗时,

以此为基础来进行估算。然后写数据的休眠时间则在读数据业务逻辑的耗时基础上加百毫秒即可。

这么做的目的,就是确保读请求结束,写请求可以删除读请求造成的缓存脏数据。

第二种方法:

新启动一个后台监控程序,比如后面要讲解的WatchDog监控程序,会加时

这种同步淘汰策略,吞吐量降低怎么办?(面试)

先更新数据库,再删除缓存

优先使用先更新数据库,再删除缓存的方案(先更库→后删存)。理由如下:

1 先删除缓存值再更新数据库,有可能导致请求因缓存缺失而访问数据库,给数据库带来压力导致打满mysql。

2 如果业务应用中读取数据库和写缓存的时间不好估算,那么,延迟双删中的等待时间就不好设置。

面试题

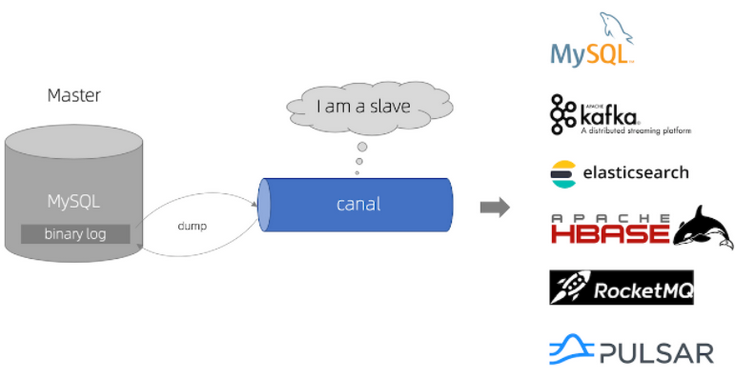

我想mysql有记录改动了(有增删改写操作),立刻同步反应到redis???该如何做?

binlog日志可以记录数据库所有执行的DDL 和 DML 等数据库更新事件的语句,但是不包含没有修改任何数据的语句(如数据查询语句select、

show等)。

canel

能干嘛

数据库镜像

数据库实时备份

索引构建和实时维护(拆分异构索引、倒排索引等)

业务 cache 刷新

带业务逻辑的增量数据处理

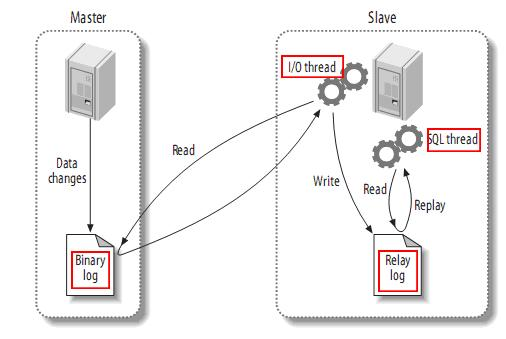

MySQL的主从复制

MySQL的主从复制将经过如下步骤:

1、当 master 主服务器上的数据发生改变时,则将其改变写入二进制事件日志文件中;

2、salve 从服务器会在一定时间间隔内对 master 主服务器上的二进制日志进行探测,探测其是否发生过改变,

如果探测到 master 主服务器的二进制事件日志发生了改变,则开始一个 I/O Thread 请求 master 二进制事件日志;

3、同时 master 主服务器为每个 I/O Thread 启动一个dump Thread,用于向其发送二进制事件日志;

4、slave 从服务器将接收到的二进制事件日志保存至自己本地的中继日志文件中;

5、salve 从服务器将启动 SQL Thread 从中继日志中读取二进制日志,在本地重放,使得其数据和主服务器保持一致;

6、最后 I/O Thread 和 SQL Thread 将进入睡眠状态,等待下一次被唤醒;

canel工作原理

操作环节

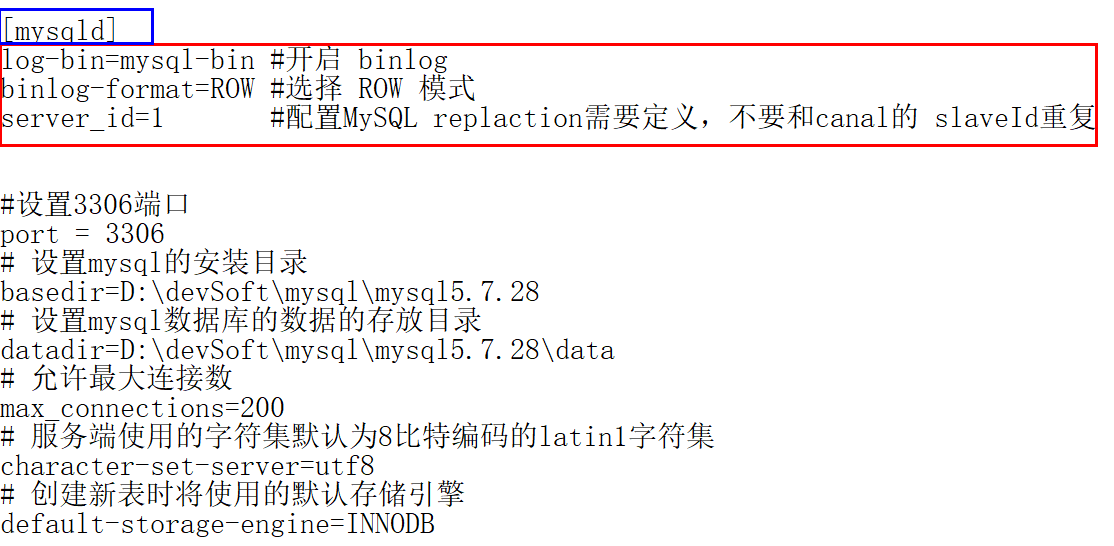

my.ini

开启binlog日志

| log-bin=mysql-bin #开启 binlog

binlog-format=ROW #选择 ROW 模式

| server_id=1 #配置MySQL replaction需要定义,不要和canal的 slaveId重复 |

|---|

| ROW模式 除了记录sql语句之外,还会记录每个字段的变化情况,能够清楚的记录每行数据的变化历史,但会占用较多的空间。

STATEMENT模式只记录了sql语句,但是没有记录上下文信息,在进行数据恢复的时候可能会导致数据的丢失情况;

| MIX模式比较灵活的记录,理论上说当遇到了表结构变更的时候,就会记录为statement模式。当遇到了数据更新或者删除情况下就会变为row模式; |

|---|

select version();

show master status;

show variables like 'log_bin';

SELECT * FROM mysql.`user`;

DROP USER IF EXISTS 'canal'@'%';

CREATE USER 'canal'@'%' IDENTIFIED BY 'canal';

GRANT ALL ON *.* TO 'canal'@'%';

FLUSH PRIVILEGES;

SELECT * FROM mysql.user;

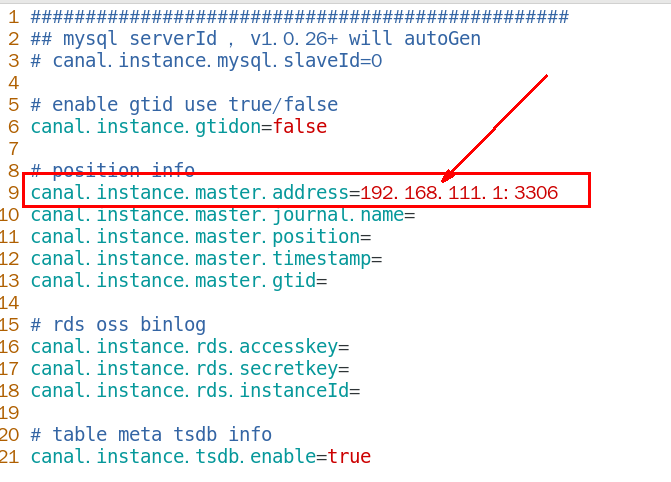

canal端

mysql为canal赋予密码

ALTER USER canal IDENTIFIED BY 'canal';

关键的POM

<!--canal-->

<dependency>

<groupId>com.alibaba.otter</groupId>

<artifactId>canal.client</artifactId>

<version>1.1.0</version>

</dependency>

application.properties

server.port=5555

# ========================alibaba.druid=====================

spring.datasource.type=com.alibaba.druid.pool.DruidDataSource

spring.datasource.driver-class-name=com.mysql.jdbc.Driver

spring.datasource.url=jdbc:mysql://localhost:3306/test

spring.datasource.username=root

spring.datasource.password=123456

spring.datasource.druid.test-while-idle=false

package com.xzh.redis.utils;

import redis.clients.jedis.Jedis;

import redis.clients.jedis.JedisPool;

import redis.clients.jedis.JedisPoolConfig;

public class RedisUtils

{

public static final String REDIS_IP_ADDR = "192.168.200.100";

public static final String REDIS_pwd = "123456";

public static JedisPool jedisPool;

static {

JedisPoolConfig jedisPoolConfig=new JedisPoolConfig();

jedisPoolConfig.setMaxTotal(20);

jedisPoolConfig.setMaxIdle(10);

jedisPool=new JedisPool(jedisPoolConfig,REDIS_IP_ADDR,6379,10000,REDIS_pwd);

}

public static Jedis getJedis() throws Exception {

if(null!=jedisPool){

return jedisPool.getResource();

}

throw new Exception("Jedispool is not ok");

}

}

package com.xzh.redis;

import com.alibaba.fastjson.JSONObject;

import com.alibaba.otter.canal.client.CanalConnector;

import com.alibaba.otter.canal.client.CanalConnectors;

import com.alibaba.otter.canal.protocol.CanalEntry.*;

import com.alibaba.otter.canal.protocol.Message;

import com.xzh.redis.utils.RedisUtils;

import redis.clients.jedis.Jedis;

import java.net.InetSocketAddress;

import java.util.List;

import java.util.UUID;

import java.util.concurrent.TimeUnit;

/**

* @auther zzyy

* @create 2022-12-22 12:43

*/

public class RedisCanalClientExample

{

public static final Integer _60SECONDS = 60;

public static final String REDIS_IP_ADDR = "192.168.200.100";

private static void redisInsert(List<Column> columns)

{

JSONObject jsonObject = new JSONObject();

for (Column column : columns)

{

System.out.println(column.getName() + " : " + column.getValue() + " update=" + column.getUpdated());

jsonObject.put(column.getName(),column.getValue());

}

if(columns.size() > 0)

{

try(Jedis jedis = RedisUtils.getJedis())

{

jedis.set(columns.get(0).getValue(),jsonObject.toJSONString());

}catch (Exception e){

e.printStackTrace();

}

}

}

private static void redisDelete(List<Column> columns)

{

JSONObject jsonObject = new JSONObject();

for (Column column : columns)

{

jsonObject.put(column.getName(),column.getValue());

}

if(columns.size() > 0)

{

try(Jedis jedis = RedisUtils.getJedis())

{

jedis.del(columns.get(0).getValue());

}catch (Exception e){

e.printStackTrace();

}

}

}

private static void redisUpdate(List<Column> columns)

{

JSONObject jsonObject = new JSONObject();

for (Column column : columns)

{

System.out.println(column.getName() + " : " + column.getValue() + " update=" + column.getUpdated());

jsonObject.put(column.getName(),column.getValue());

}

if(columns.size() > 0)

{

try(Jedis jedis = RedisUtils.getJedis())

{

jedis.set(columns.get(0).getValue(),jsonObject.toJSONString());

System.out.println("---------update after: "+jedis.get(columns.get(0).getValue()));

}catch (Exception e){

e.printStackTrace();

}

}

}

public static void printEntry(List<Entry> entrys) {

for (Entry entry : entrys) {

if (entry.getEntryType() == EntryType.TRANSACTIONBEGIN || entry.getEntryType() == EntryType.TRANSACTIONEND) {

continue;

}

RowChange rowChage = null;

try {

//获取变更的row数据

rowChage = RowChange.parseFrom(entry.getStoreValue());

} catch (Exception e) {

throw new RuntimeException("ERROR ## parser of eromanga-event has an error,data:" + entry.toString(),e);

}

//获取变动类型

EventType eventType = rowChage.getEventType();

System.out.println(String.format("================> binlog[%s:%s] , name[%s,%s] , eventType : %s",

entry.getHeader().getLogfileName(), entry.getHeader().getLogfileOffset(),

entry.getHeader().getSchemaName(), entry.getHeader().getTableName(), eventType));

for (RowData rowData : rowChage.getRowDatasList()) {

if (eventType == EventType.INSERT) {

redisInsert(rowData.getAfterColumnsList());

} else if (eventType == EventType.DELETE) {

redisDelete(rowData.getBeforeColumnsList());

} else {//EventType.UPDATE

redisUpdate(rowData.getAfterColumnsList());

}

}

}

}

public static void main(String[] args)

{

System.out.println("---------O(∩_∩)O哈哈~ initCanal() main方法-----------");

//=================================

// 创建链接canal服务端

CanalConnector connector = CanalConnectors.newSingleConnector(new InetSocketAddress(REDIS_IP_ADDR,

11111), "example", "", "");

int batchSize = 1000;

//空闲空转计数器

int emptyCount = 0;

System.out.println("---------------------canal init OK,开始监听mysql变化------");

try {

connector.connect();

//connector.subscribe(".*\\..*");

connector.subscribe("test.t_user");

connector.rollback();

int totalEmptyCount = 10 * _60SECONDS;

while (emptyCount < totalEmptyCount) {

System.out.println("我是canal,每秒一次正在监听:"+ UUID.randomUUID().toString());

Message message = connector.getWithoutAck(batchSize); // 获取指定数量的数据

long batchId = message.getId();

int size = message.getEntries().size();

if (batchId == -1 || size == 0) {

emptyCount++;

try { TimeUnit.SECONDS.sleep(1); } catch (InterruptedException e) { e.printStackTrace(); }

} else {

//计数器重新置零

emptyCount = 0;

printEntry(message.getEntries());

}

connector.ack(batchId); // 提交确认

// connector.rollback(batchId); // 处理失败, 回滚数据

}

System.out.println("已经监听了"+totalEmptyCount+"秒,无任何消息,请重启重试......");

} finally {

connector.disconnect();

}

}

}

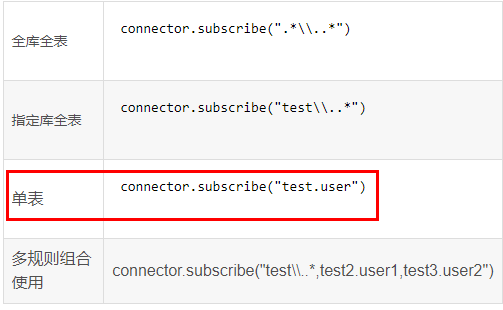

需要格外注意的不仅是ip地址,还有第129行:

connector.subscribe("test.t_user");

需要与自己的数据库对应

java程序下connector.subscribe配置的过滤正则

4324

4324

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?