线性回归的简洁实现:

1.生成数据集。

代码:

import numpy as np

import torch

from torch.utils import data

from d2l import torch as d2l此处可以看到,导入了torch.utils中的data

true_w = torch.tensor([2, -3.4])

true_b = 4.2

features, labels = d2l.synthetic_data(true_w, true, 1000)

#通过synthetic_data函数生成数据集这里调用了synthetic_data来生成数据集。

2.读取数据集

代码:

def load_array(data_arrays, batch_size, is_train=True):

"""构造迭代器"""

dataset = data.TensorDataset(*data_arrays)

#这里,TensorDataset函数,是把输入的两类数据一一对应,*的作用是把输入数据拆包

return data.DataLoader(dataset, batch_size, shuffle=is_train)

#DataLoader函数用于重新排序

batch_size = 10

daya_iter = load_array((feature, labels), batch_size)

next(iter(data_iter))dataloader中第二项batch_size表示每次取的个数,shuffle表示是否需要随机打乱顺序

这里is train是训练集,所以要打乱。

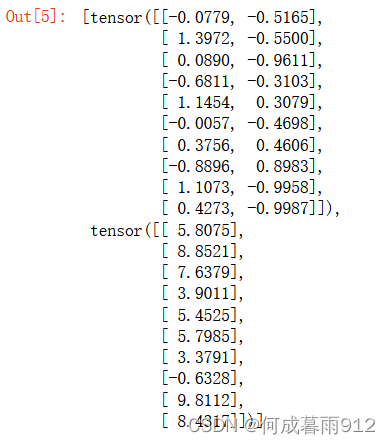

结果:

3.模具:

调用框架的预定义好的层

代码:

from torch import nn

net = nn.Sequential(nn.Linear(2,1))nn是神经网络的缩写,里面有大量定义好的层,线性回归只要用线性层,只要指定输入和输出的维度,上面使用了nn的linear层,输入为2,输出为1;然后把层放在sequential容器中

初始化模型参数

代码;

net[0].weight.data.normal_(0, 0.01)

#net[0]表示选中网络中的第一层,此处weight.data表示w的值,也相当于之前的实现中的相关函数#的X的值,用于产生数据集,使用normal中的分布替换(y=Xw+b)

net[0].bias.data.fill_(0)

#这里的bias表示偏置,置0均方误差调用

代码:

loss = nn.MSELoss()sgd优化调用

代码:

trainer = torch.optim.SGD(net.parameters(), lr=0.03)parameter是network中所有参数,包括w和b,lr表示学习率

4.训练模块

代码:

num_epochs = 3

for epoch in range(num_epochs):

for X, y in data_iter:

l = loss(net(x), y)

trainer.zero_grad()

l.backward()

trainer.step()

l = loss(net(features), labels)

print(f'epoch {epoch + 1}, loss {l:f}')

4140

4140

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?