一,介绍及背景

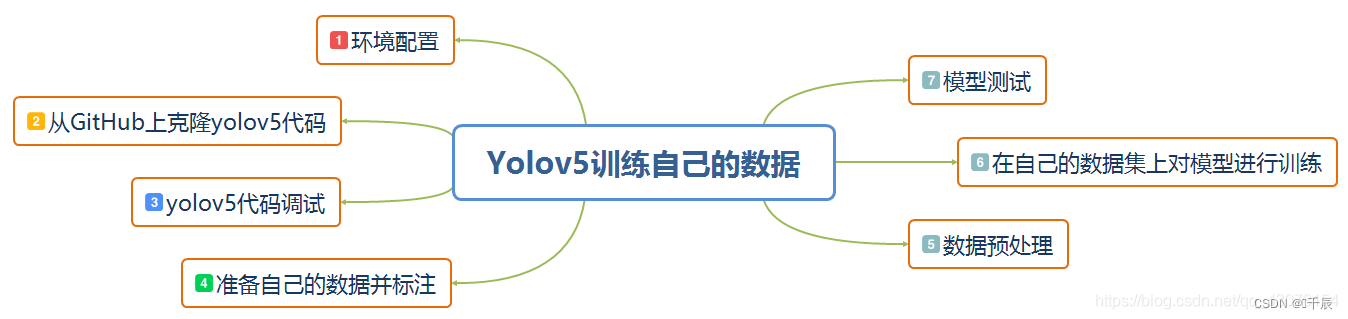

YOLO系列是非常优秀的物体检测框架,目前总共有V1-V5五个版本。本博客的目的在于教大家如何使用YOLOv5训练自己的数据,重点在于应用。有关原理我会在后面的博客中详细介绍。使用YOLOv5训练自己的数据往往要经过以下几个步骤

二,简单的步骤操作

没有下载可以点击下列链接查看教程并下载(跟详细的博客)

https://blog.csdn.net/qq_43078154/article/details/119865421?spm=1001.2014.3001.5501

一,下载yolov5

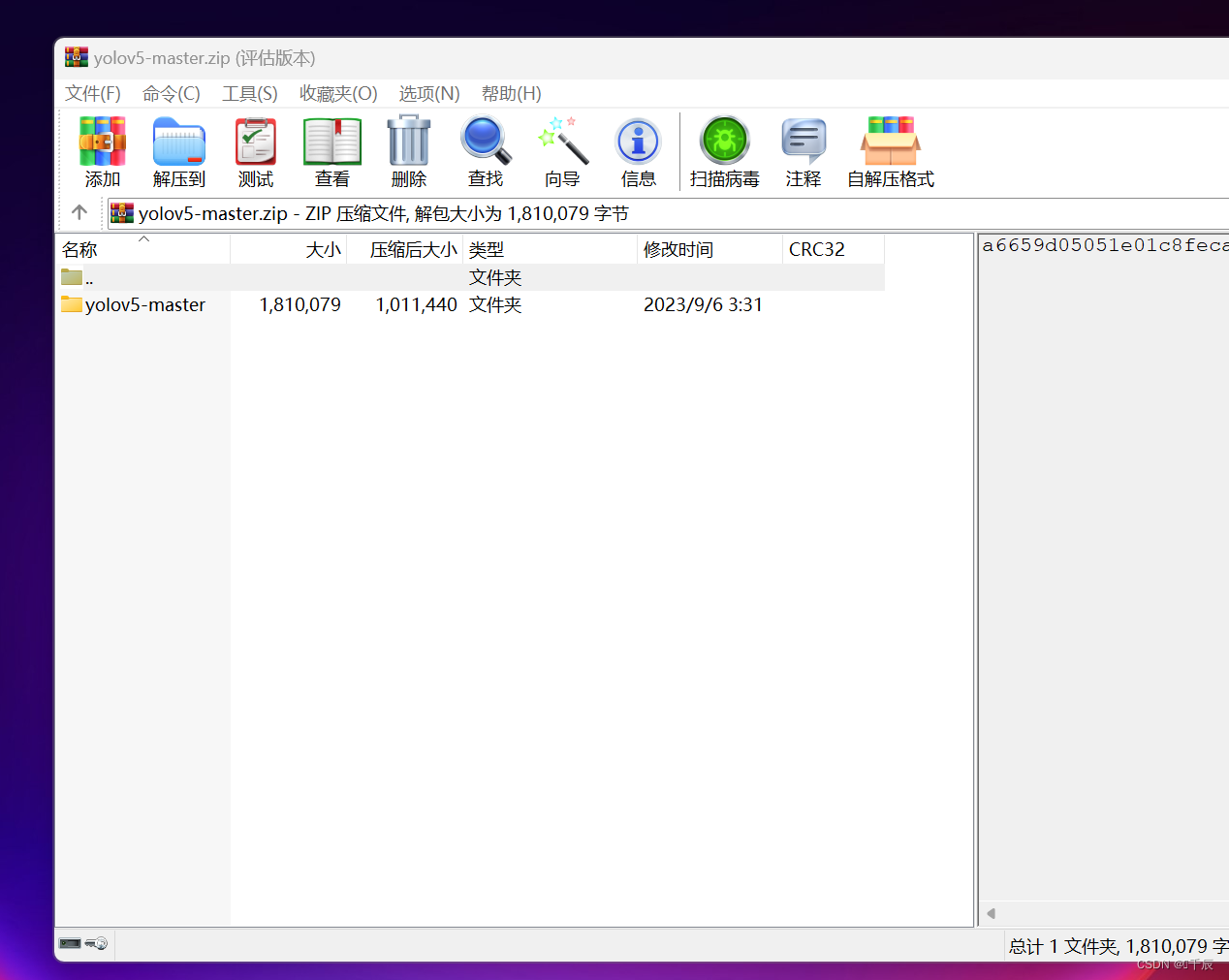

进入到GitHub 上下载yolov5 GitHub是外网所以会有访问不上的问题,多试几次就能解决)

github.com 这是GitHub的官

进去之后在搜索框内输入yolov5 master 点击第一个下载下来即可

三. 数据标注

能够打开到这样的界面即可 点击yolov5

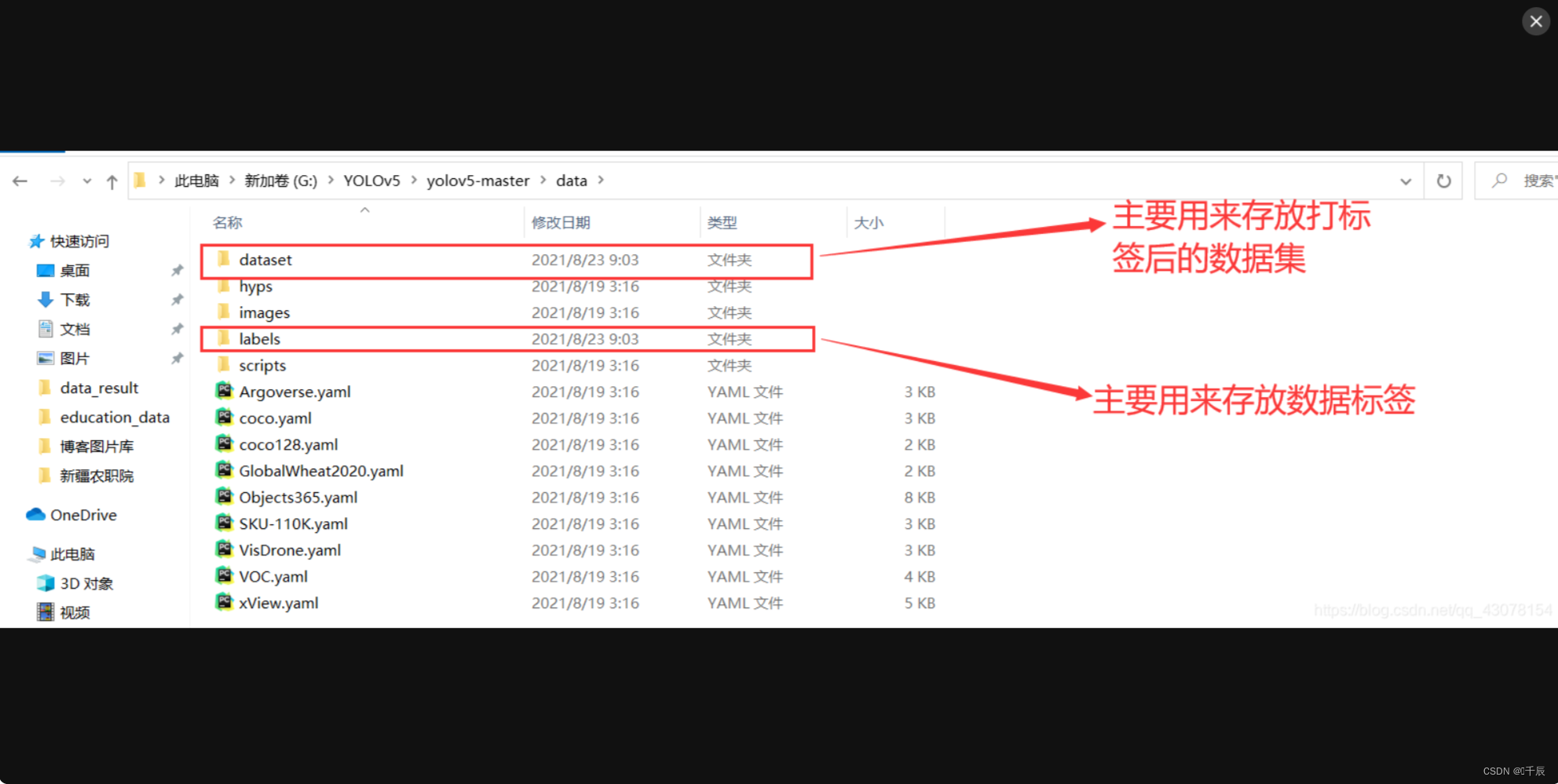

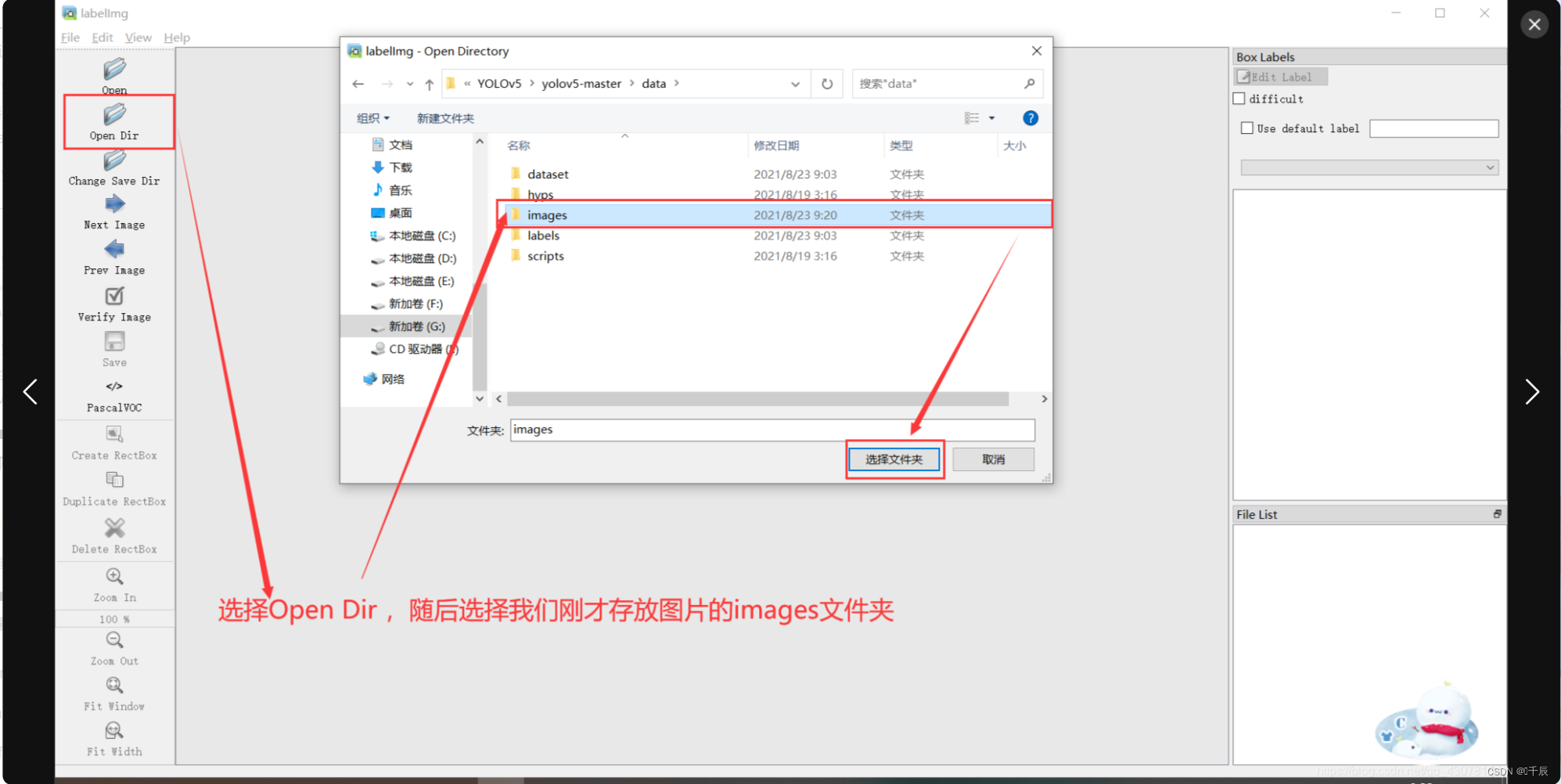

首先准备自己的数据集,然后进行标注。首先将所有要打标签的图片存放在data下面的images文件夹中,(这点比较重要,千万注意路径images文件夹一定要放在data下面,如果放在外面那需要修改split.py文件中的路径。并且,要标注的图片直接放在images文件夹下)具体如下图所示:

然后在工程中的data文件夹下新建两个文件夹,分别为dataset、labels。其中,datasets主要用来存放打好标签后的数据集,labels主要用来存放数据标签。具体如下图所示

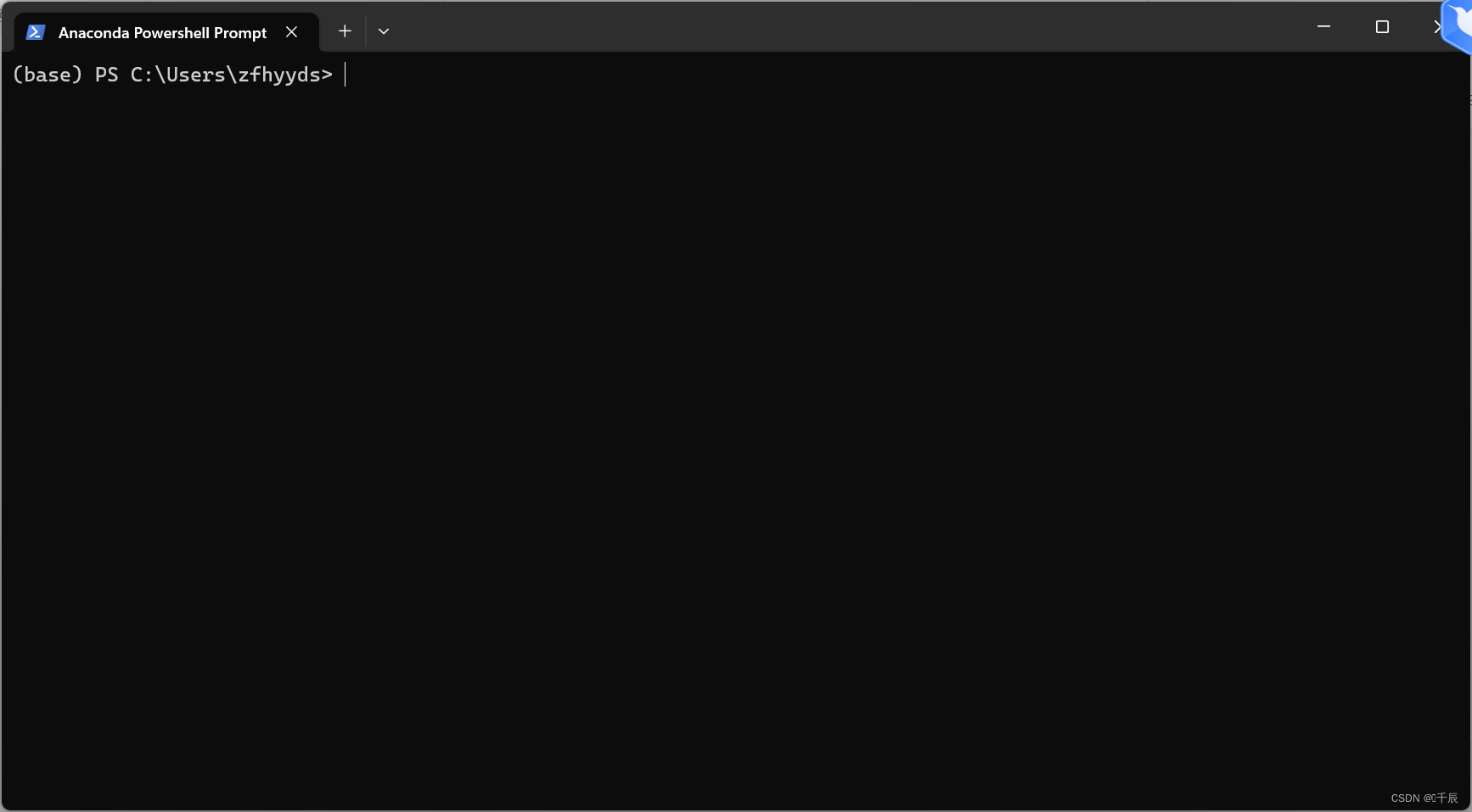

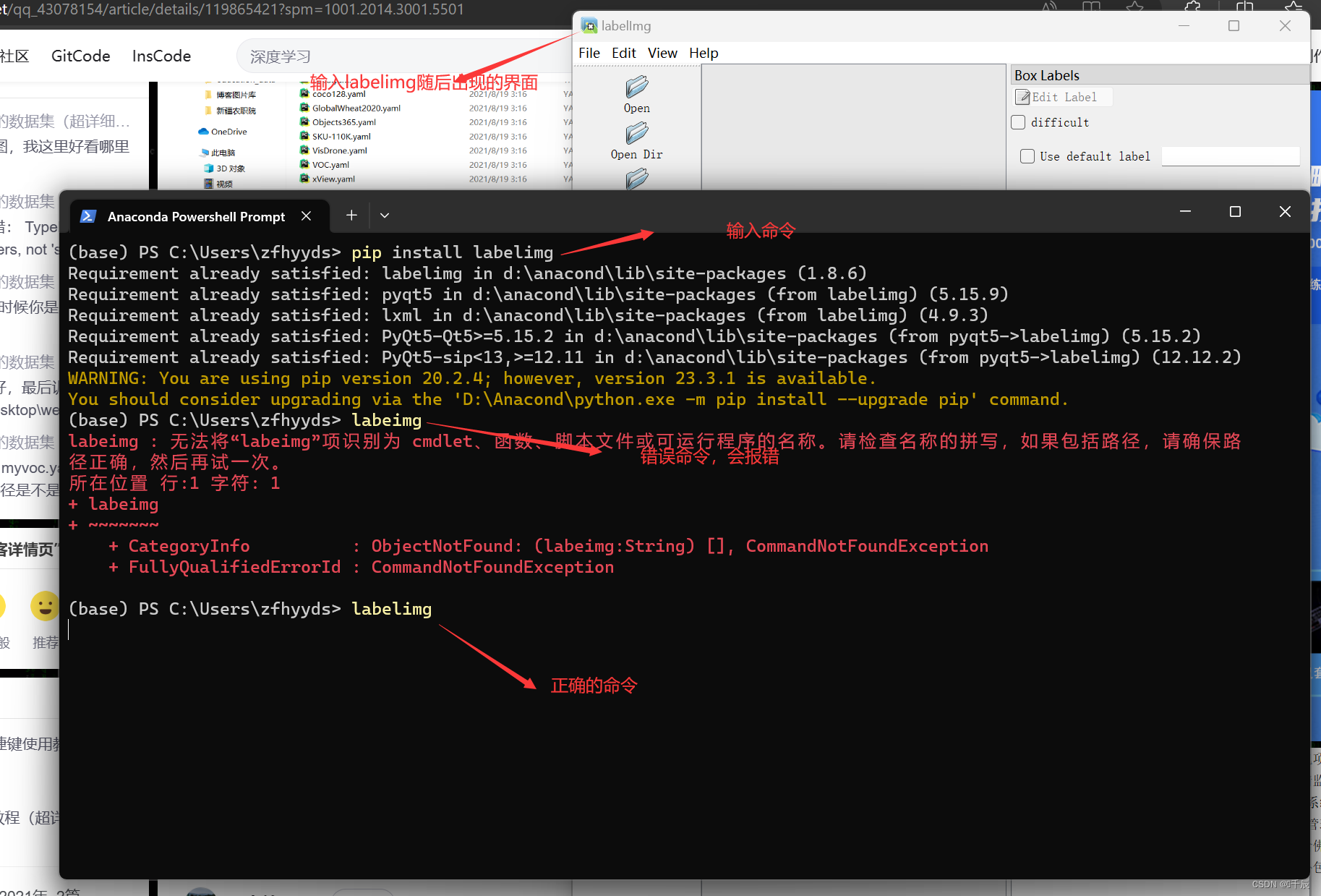

然后打开我们的 anaconda powershell prompt

如图:

输入 :pip install labeling

如图:

打开labelimg

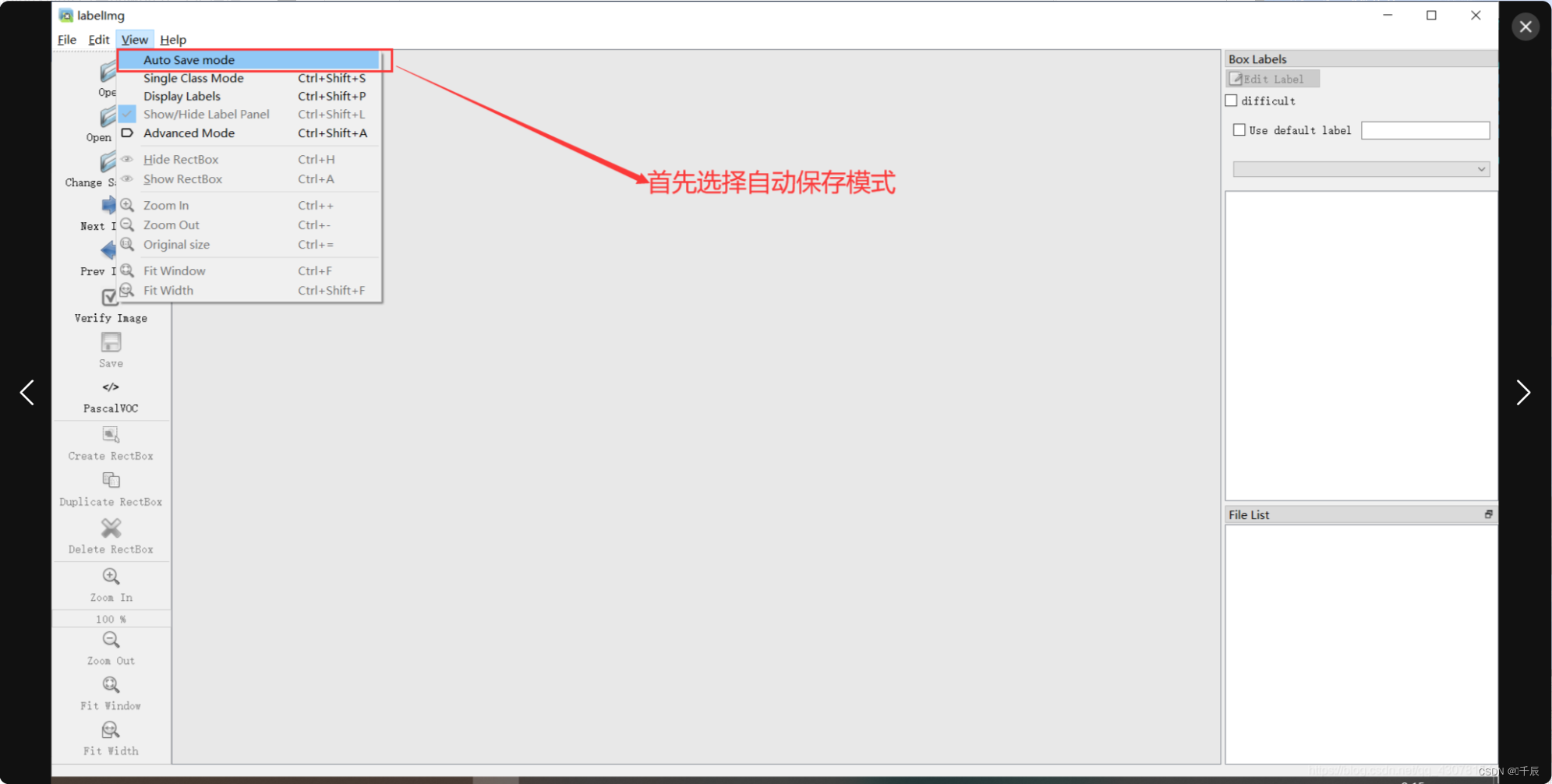

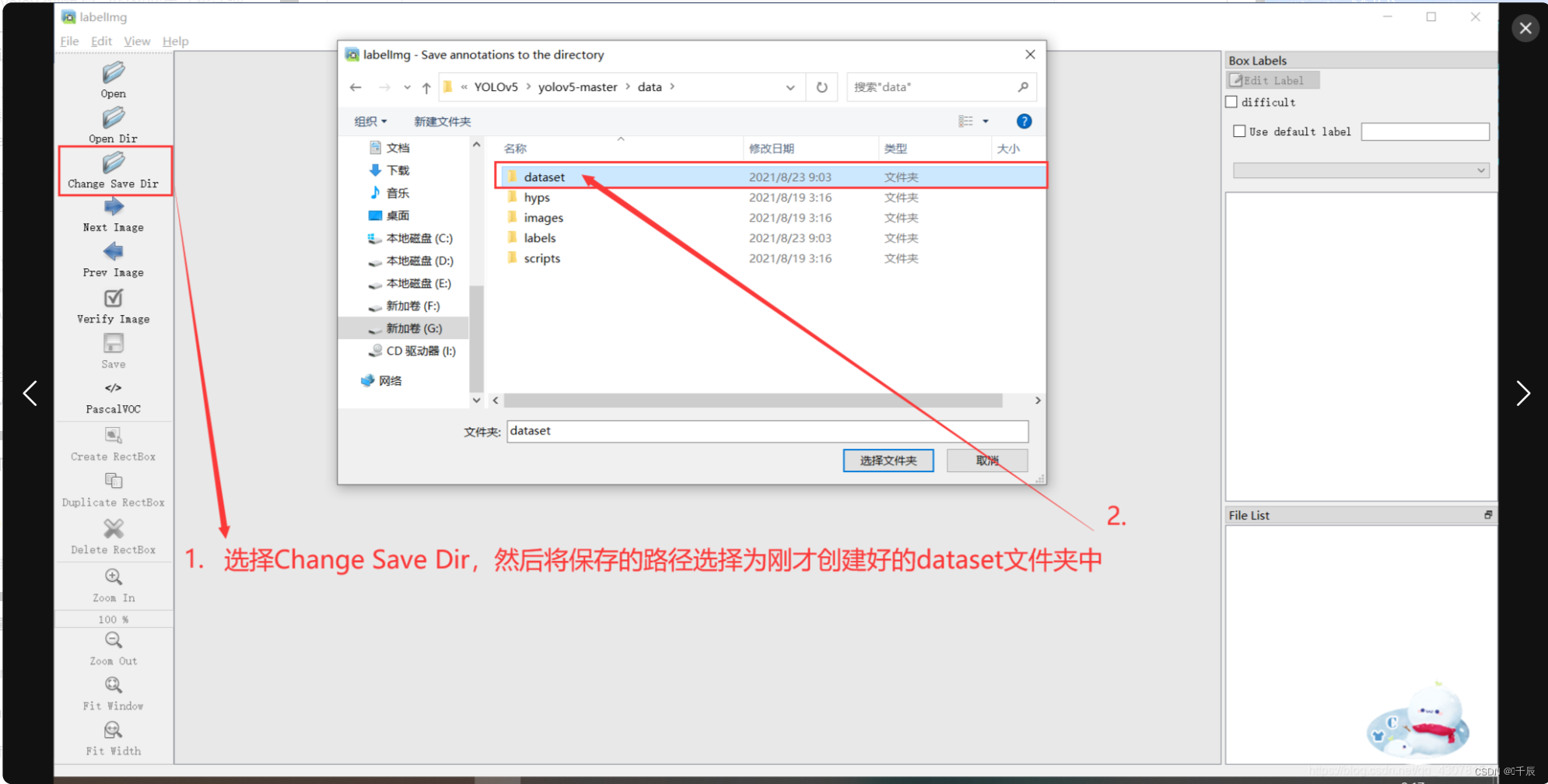

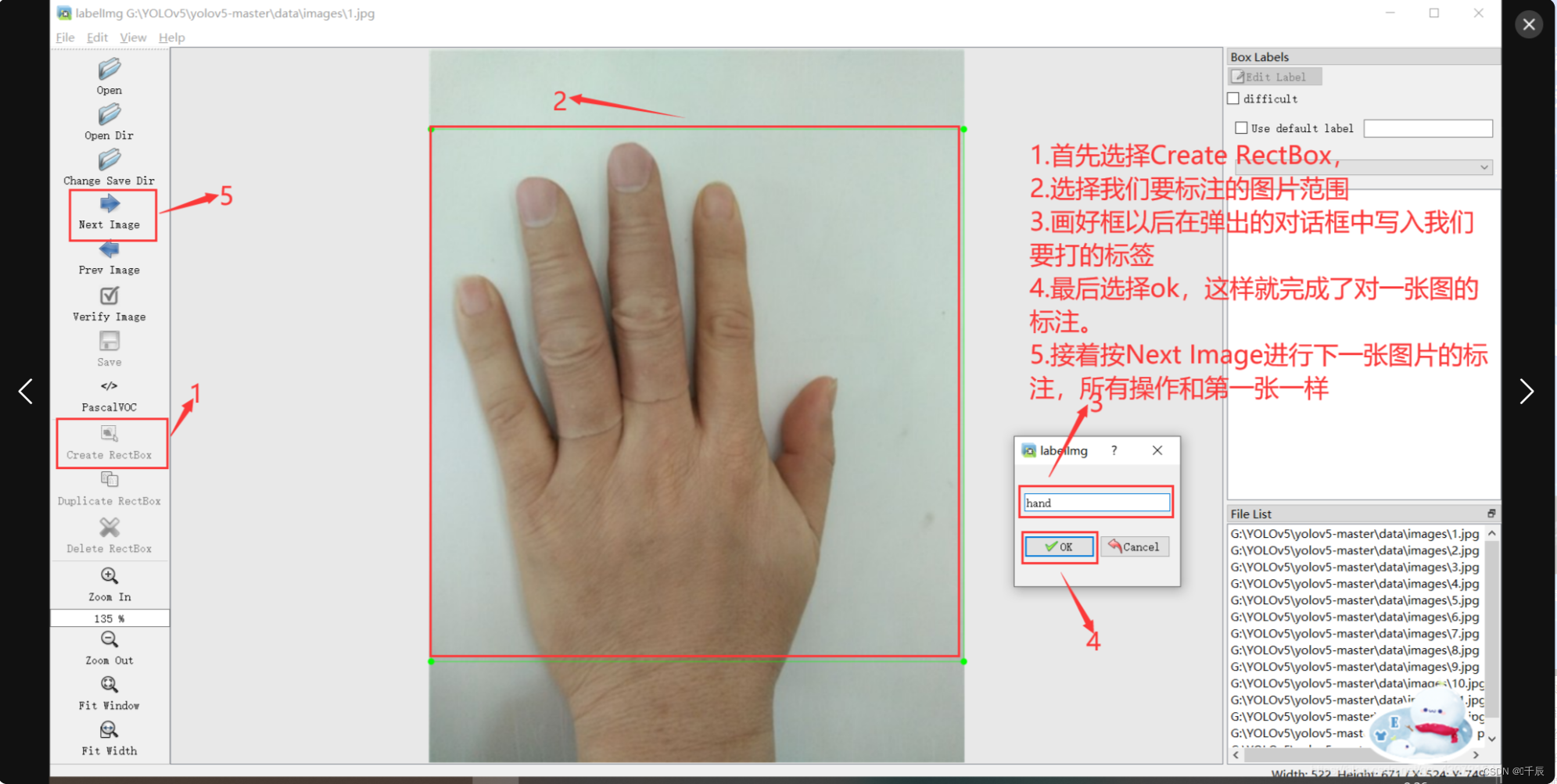

接下来,我们首先需要对labelimg进行一些设置:首先选择自动保存模型,然后再选择改变保存路径,最后打开图片文件进行数据的标注。具体操作如下面几张图所示:

最后打上标签

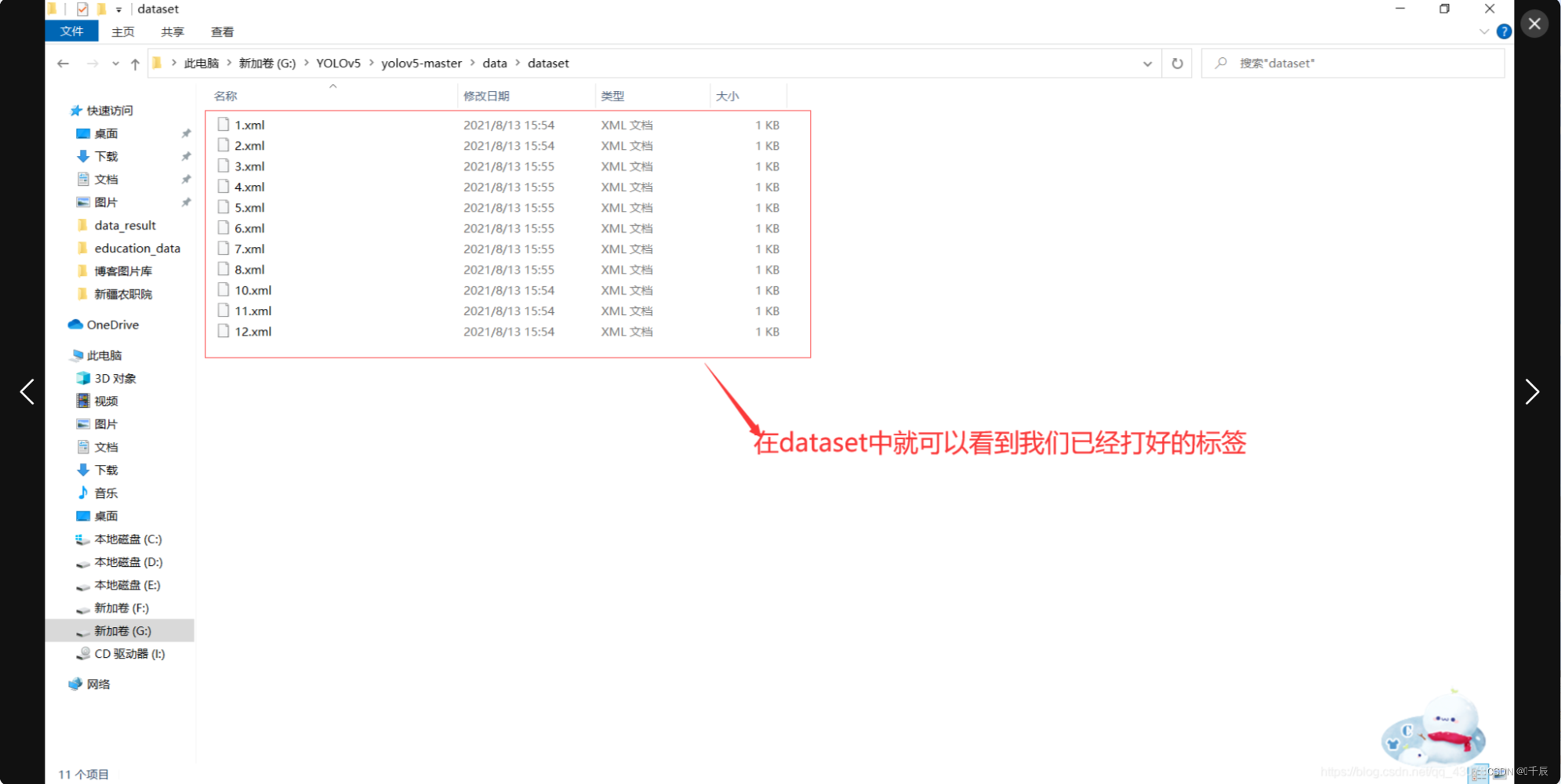

对所有的图片都进行打标签,最后可以在dataset文件夹中,看到我们打好标签的xml文件。具体如下图所示:

这样就完成了数据标注

四,数据预处理

用pychar打开yolov5

将yolov5 移动到pychar上打开

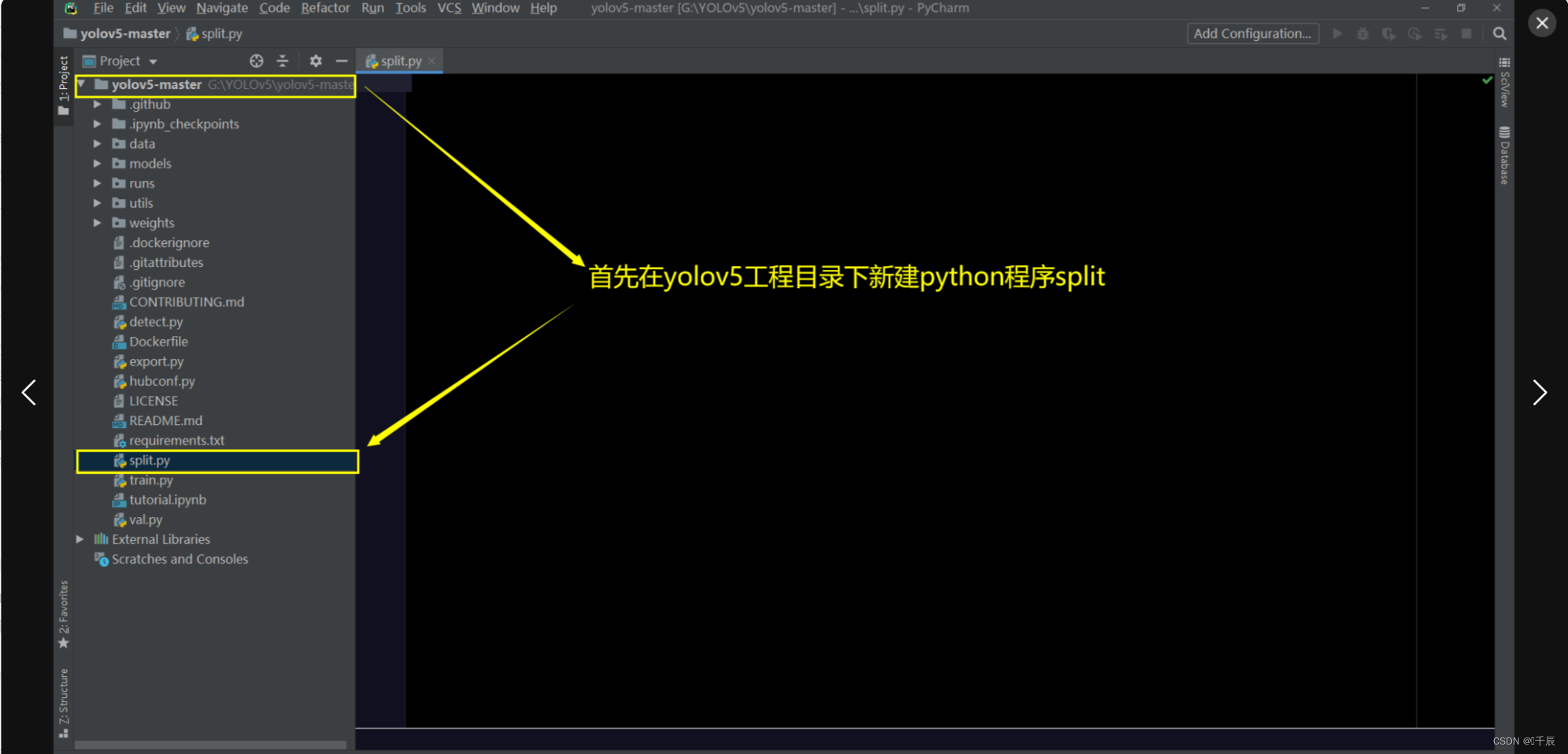

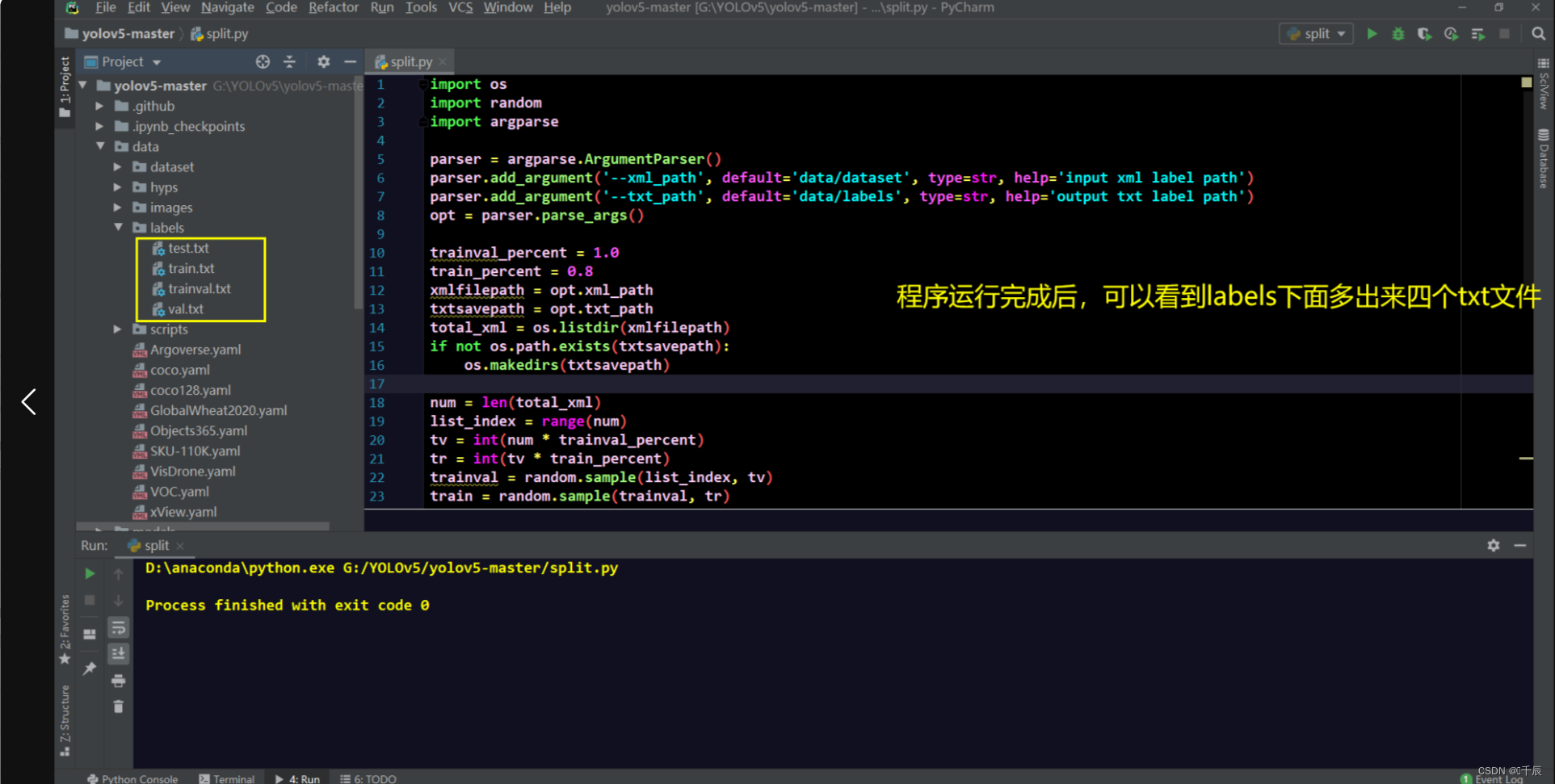

接下来需要对标注好的数据进行预处理操作,首先在工程目录文件下新建split.py程序,具体如下所示:

split.py文件代码如下:

import os import random import argparse parser = argparse.ArgumentParser() parser.add_argument('--xml_path', default='data/dataset', type=str, help='input xml label path') parser.add_argument('--txt_path', default='data/labels', type=str, help='output txt label path') opt = parser.parse_args() trainval_percent = 1.0 train_percent = 0.8 xmlfilepath = opt.xml_path txtsavepath = opt.txt_path total_xml = os.listdir(xmlfilepath) if not os.path.exists(txtsavepath): os.makedirs(txtsavepath) num = len(total_xml) list_index = range(num) tv = int(num * trainval_percent) tr = int(tv * train_percent) trainval = random.sample(list_index, tv) train = random.sample(trainval, tr) file_trainval = open(txtsavepath + '/trainval.txt', 'w') file_test = open(txtsavepath + '/test.txt', 'w') file_train = open(txtsavepath + '/train.txt', 'w') file_val = open(txtsavepath + '/val.txt', 'w') for i in list_index: name = total_xml[i][:-4] + '\n' if i in trainval: file_trainval.write(name) if i in train: file_train.write(name) else: file_val.write(name) else: file_test.write(name) file_trainval.close() file_train.close() file_val.close() file_test.close()

然后运行此代码,运行完成后的结果如下图所示:

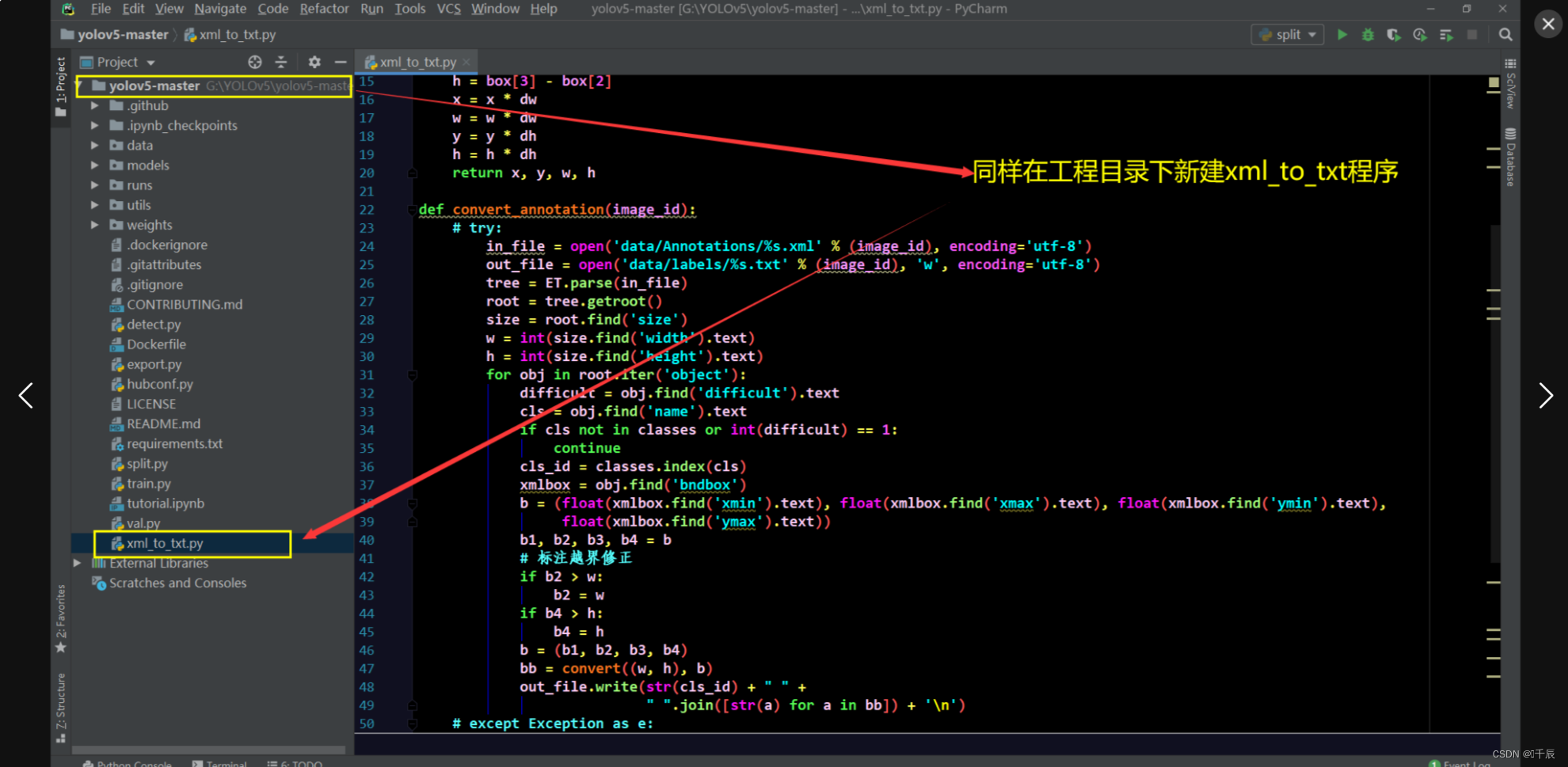

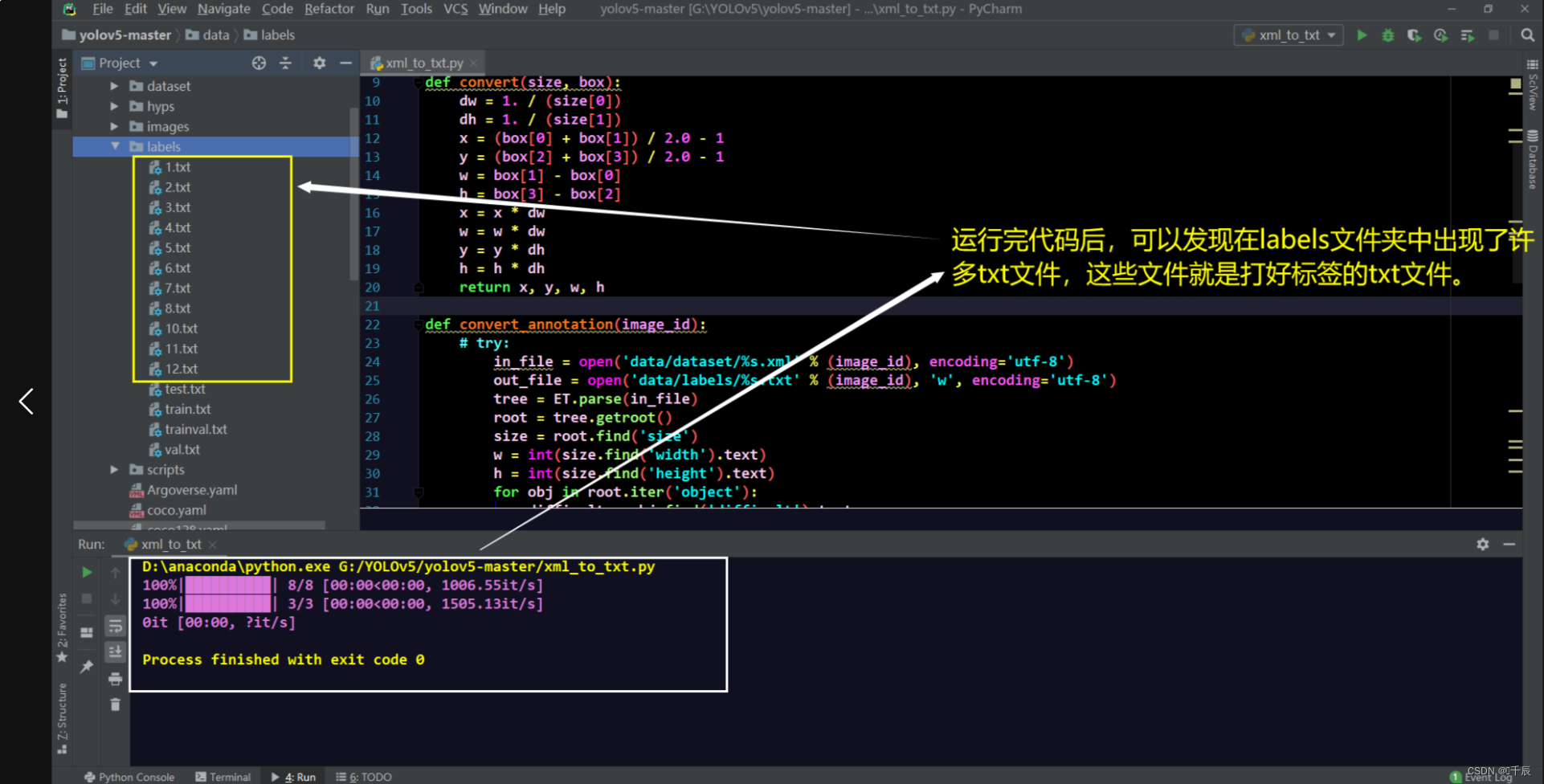

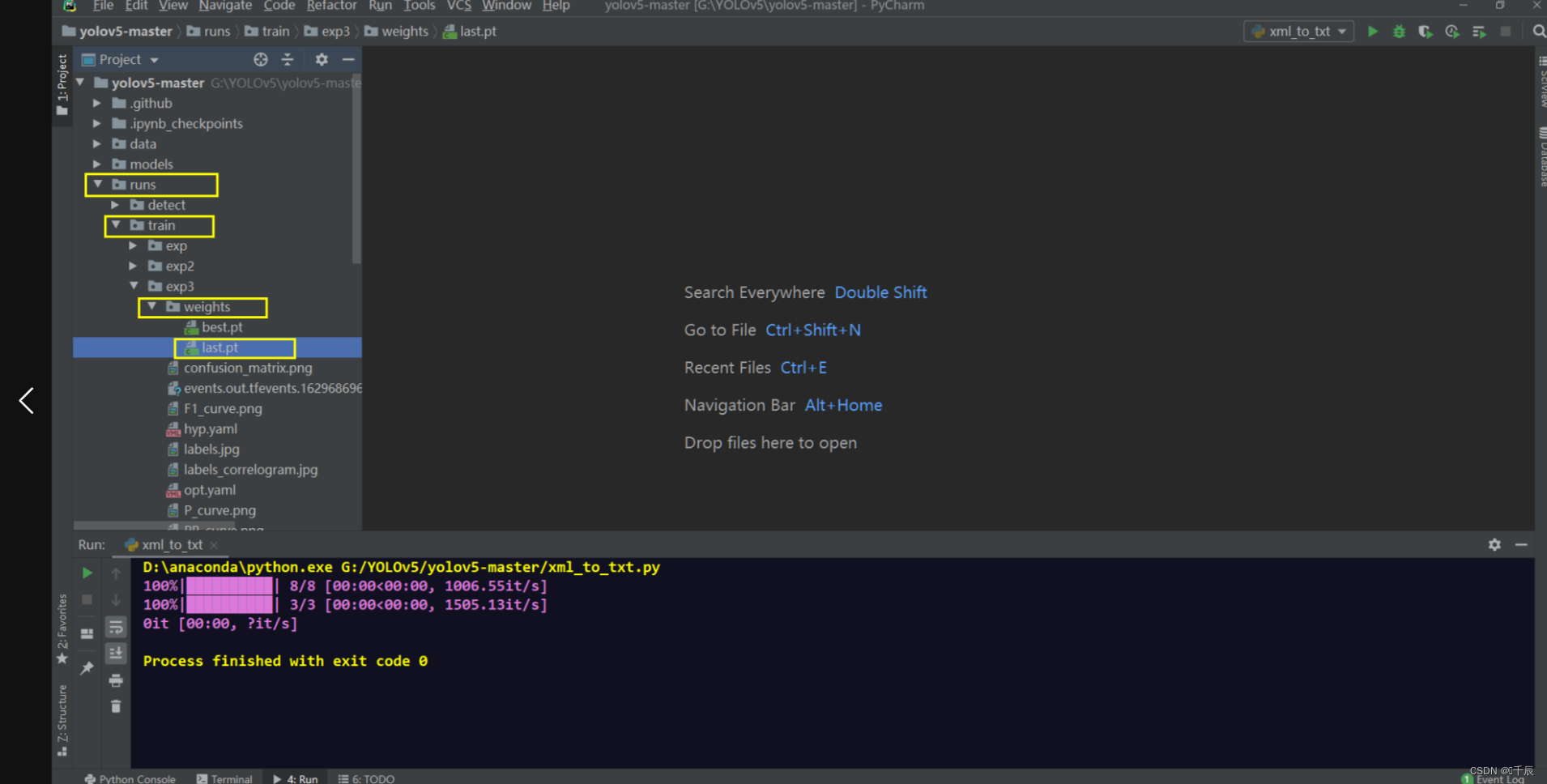

然后以同样的方式再创建xml_to_txt.py文件并运行,具体如下图所示

xml_to_txt.py代码如下:

import xml.etree.ElementTree as ET from tqdm import tqdm import os from os import getcwd sets = ['train', 'val', 'test'] classes = ['1','5'] # 这里改为你要训练的标签,否则会报错。比如你要识别“hand”,那这里就改为hand def convert(size, box): dw = 1. / (size[0]) dh = 1. / (size[1]) x = (box[0] + box[1]) / 2.0 - 1 y = (box[2] + box[3]) / 2.0 - 1 w = box[1] - box[0] h = box[3] - box[2] x = x * dw w = w * dw y = y * dh h = h * dh return x, y, w, h def convert_annotation(image_id): # try: in_file = open('data/dataset/%s.xml' % (image_id), encoding='utf-8') out_file = open('data/labels/%s.txt' % (image_id), 'w', encoding='utf-8') tree = ET.parse(in_file) root = tree.getroot() size = root.find('size') w = int(size.find('width').text) h = int(size.find('height').text) for obj in root.iter('object'): difficult = obj.find('difficult').text cls = obj.find('name').text if cls not in classes or int(difficult) == 1: continue cls_id = classes.index(cls) xmlbox = obj.find('bndbox') b = (float(xmlbox.find('xmin').text), float(xmlbox.find('xmax').text), float(xmlbox.find('ymin').text), float(xmlbox.find('ymax').text)) b1, b2, b3, b4 = b # 标注越界修正 if b2 > w: b2 = w if b4 > h: b4 = h b = (b1, b2, b3, b4) bb = convert((w, h), b) out_file.write(str(cls_id) + " " + " ".join([str(a) for a in bb]) + '\n') # except Exception as e: # print(e, image_id) wd = getcwd() for image_set in sets: if not os.path.exists('data/labels/'): os.makedirs('data/labels/') image_ids = open('data/labels/%s.txt' % (image_set)).read().strip().split() list_file = open('data/%s.txt' % (image_set), 'w') for image_id in tqdm(image_ids): list_file.write('data/images/%s.jpg\n' % (image_id)) convert_annotation(image_id) list_file.close()

以上代码中classes = [“你要训练的标签名称”],在本代码中我要训练的数据是识别1和5所以我这里改成了“1”和“5”。大家根据自己的情况进行修改。运行此代码,运行后的结果如下图所示:

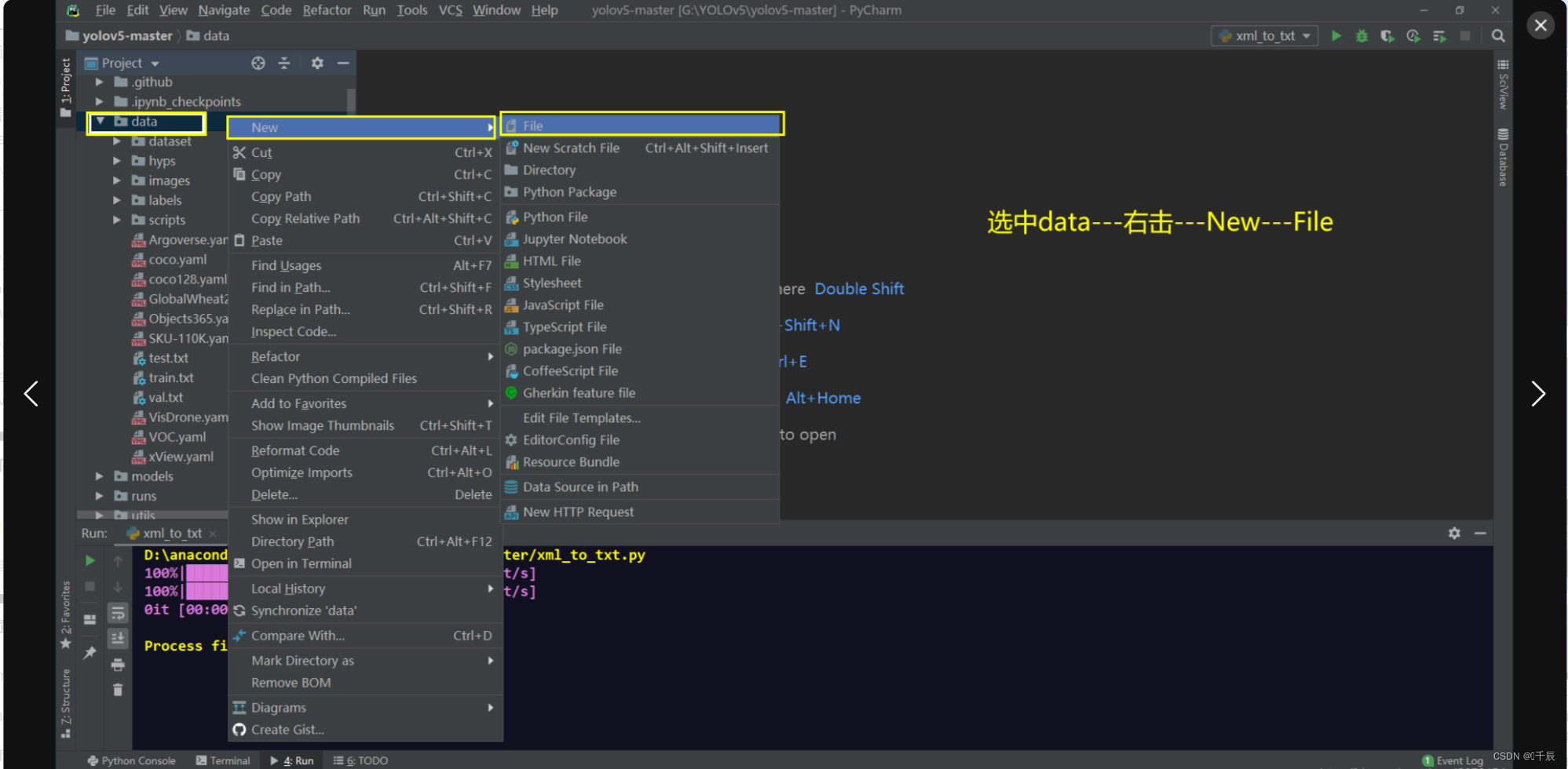

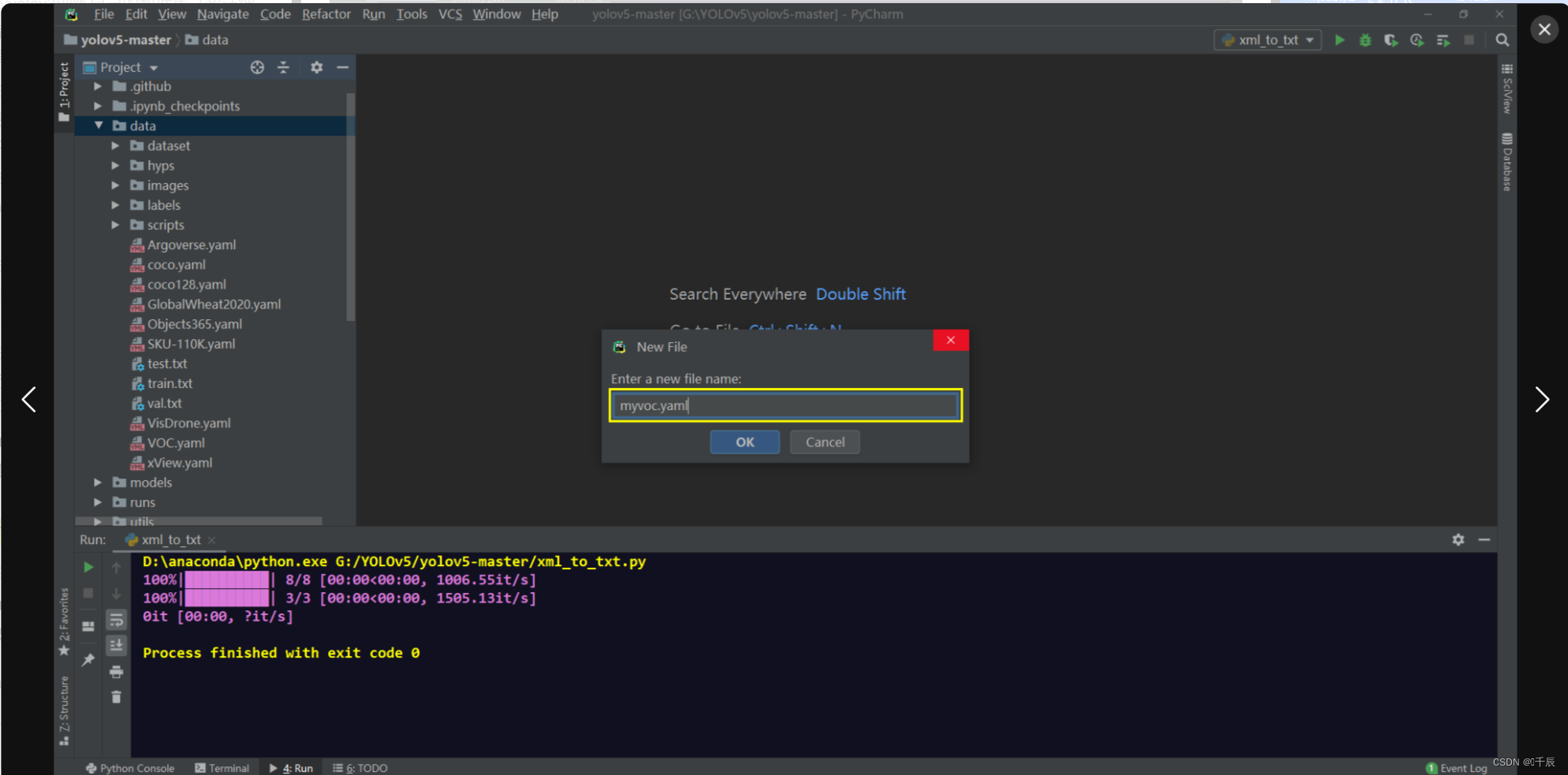

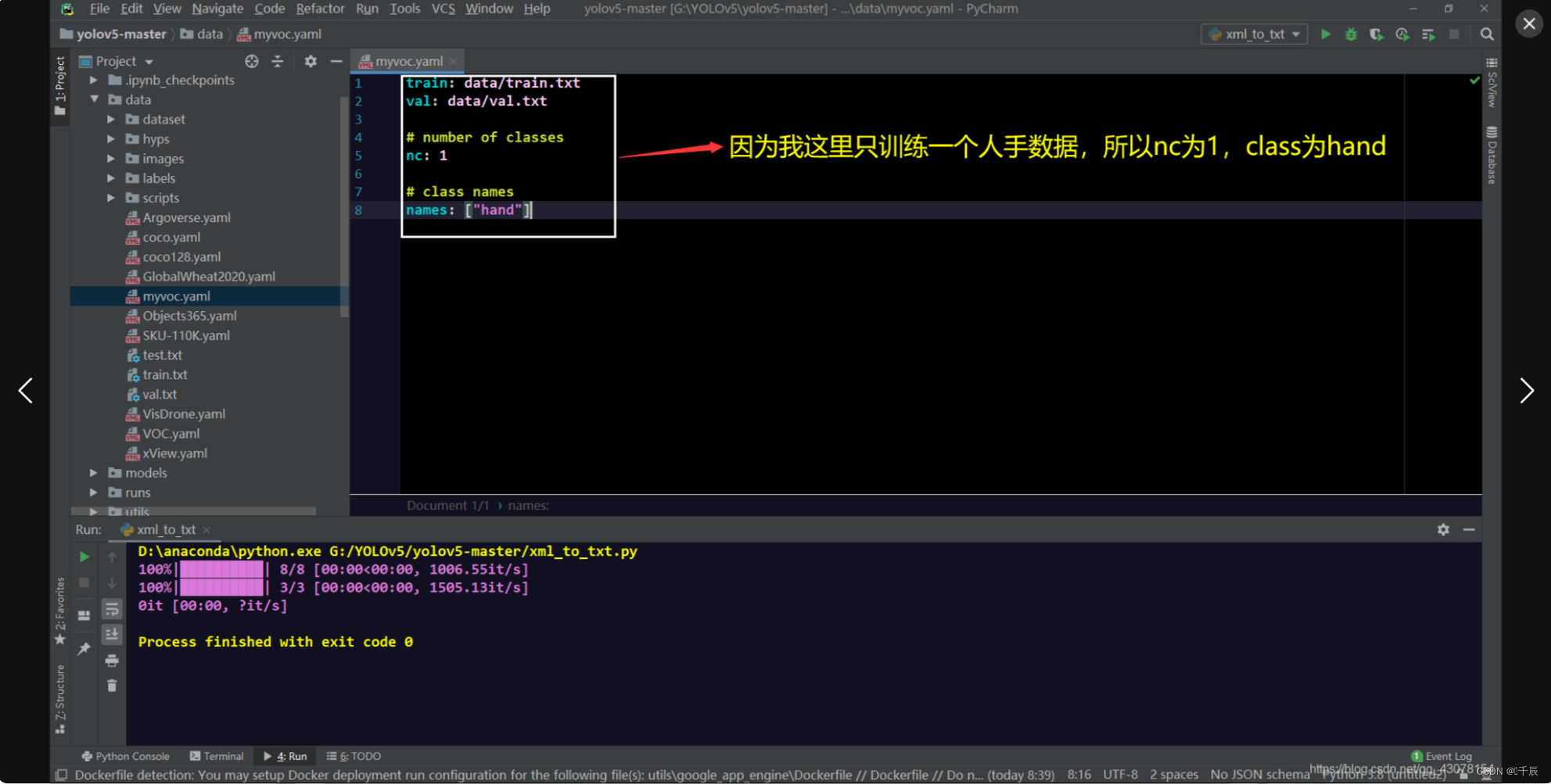

接下来在data文件夹中新建myvoc.yaml文件,具体操作以及代码如下图所示:

注意的是 nc 指的是对象,一张图片里的对象 class是类

如两只狗 nc为2 class 就是前面你标注图片的类

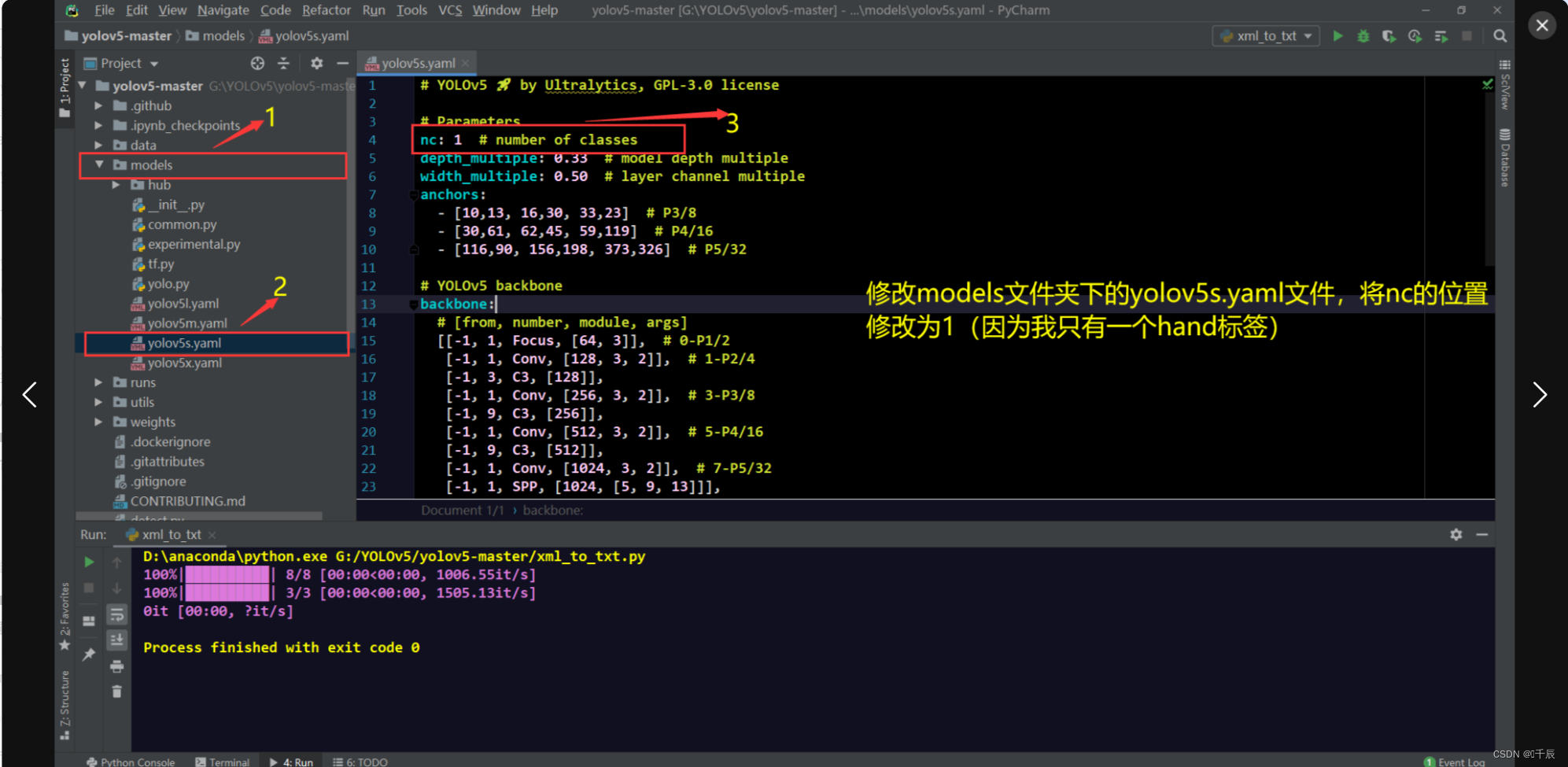

这里一定要注意一点在train,val,nc,names冒号后面一定要空一格,要判断正确不正确,只要看这几个关键字有没有变颜色,要是变颜色那就说明是正确的。最后再修改models下的yolov5s.yaml文件,具体修改方式如下图所示:

就这样完成了预处理的工作

五,模型训练

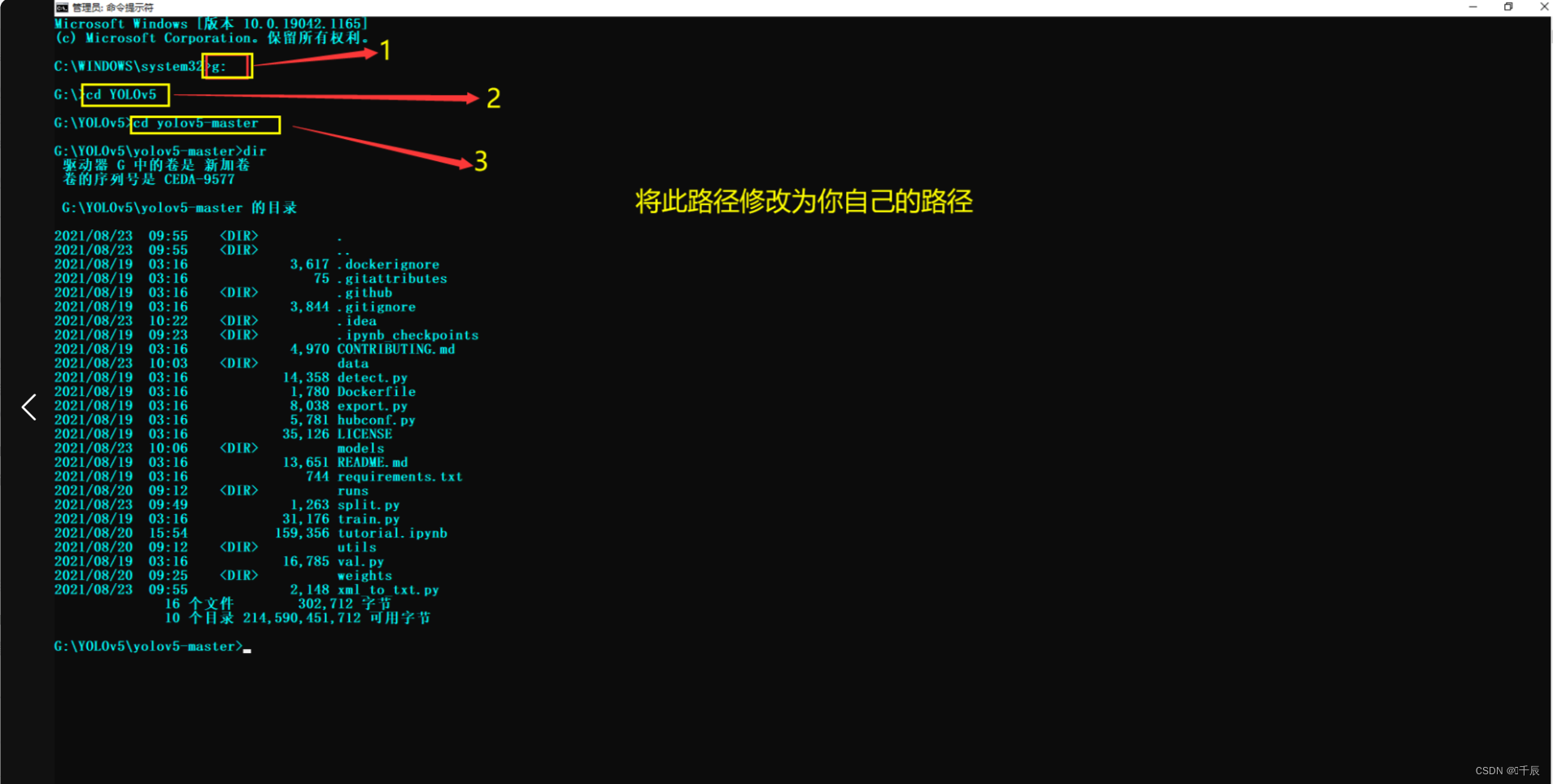

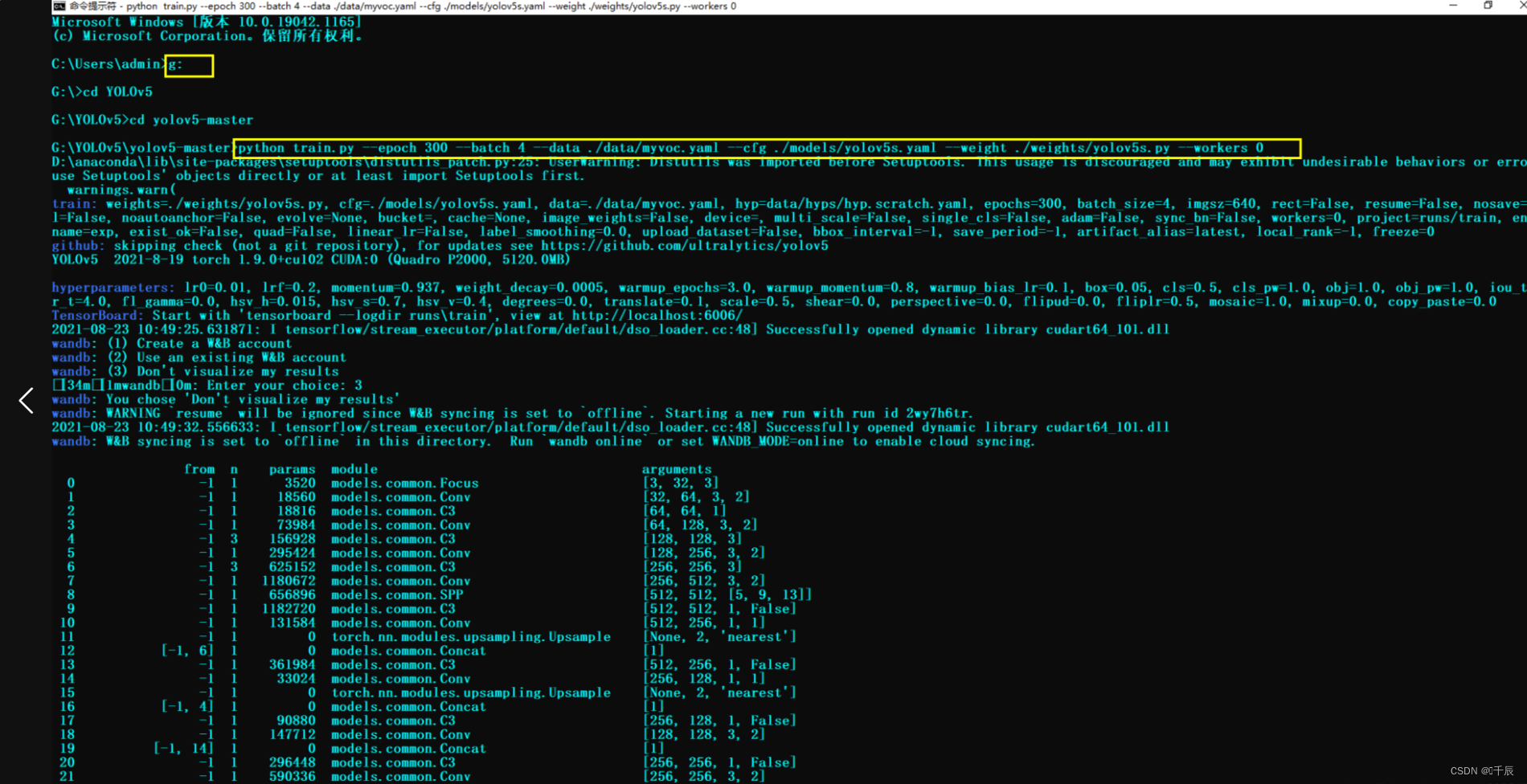

接下来,我们就可以训练自己的数据了。首先打开终端并进入到yolov5的工程目录中:

然后输入命令:

python train.py --epoch 300 --batch 4 --data ./data/myvoc.yaml --cfg ./models/yolov5s.yaml --weight ./weights/yolov5s.pt --workers 0

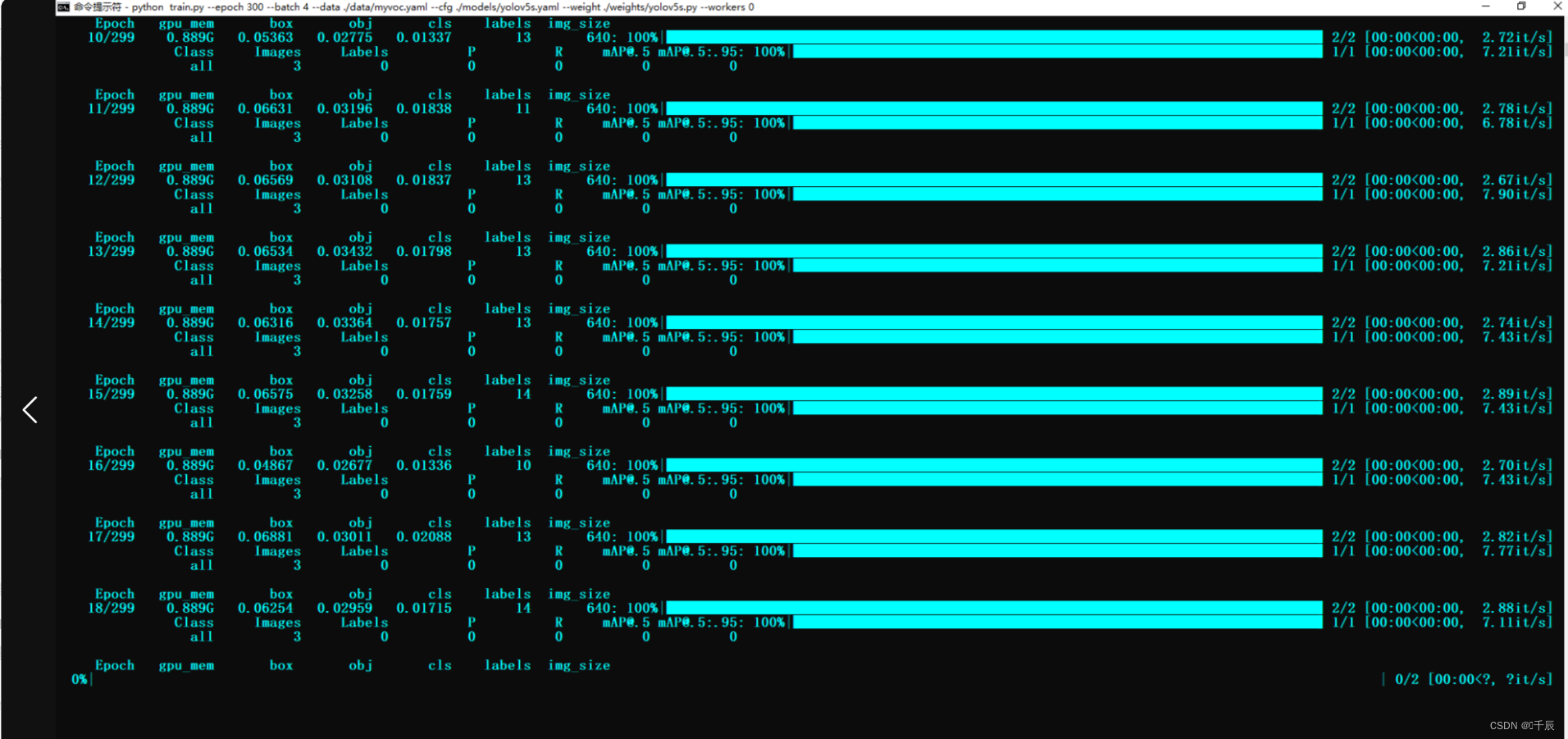

训练中出现如图的情况就代表正在训练,时间较长慢慢等待

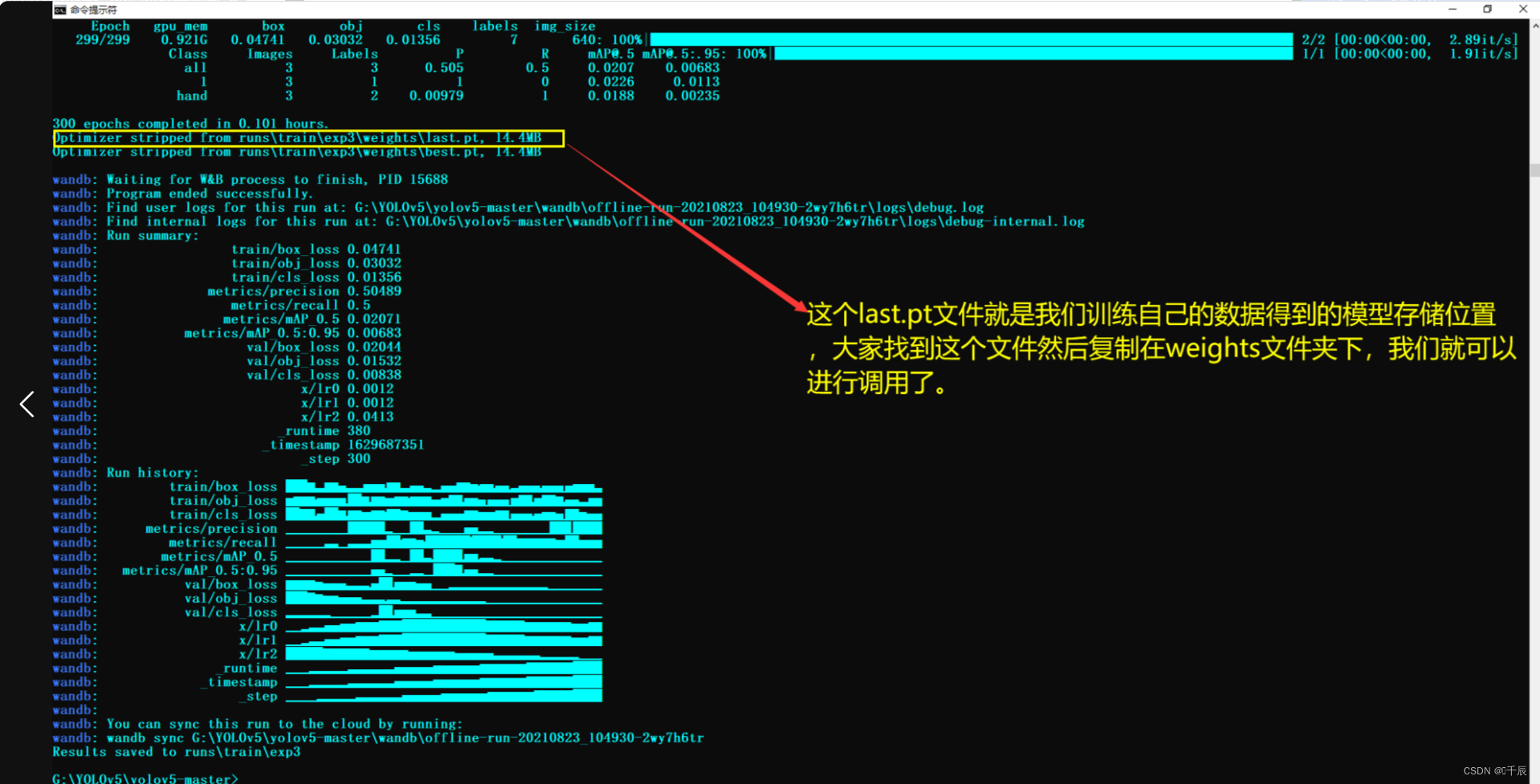

训练结束后,我们就可以看到训练好模型存储的位置,具体如下图所示

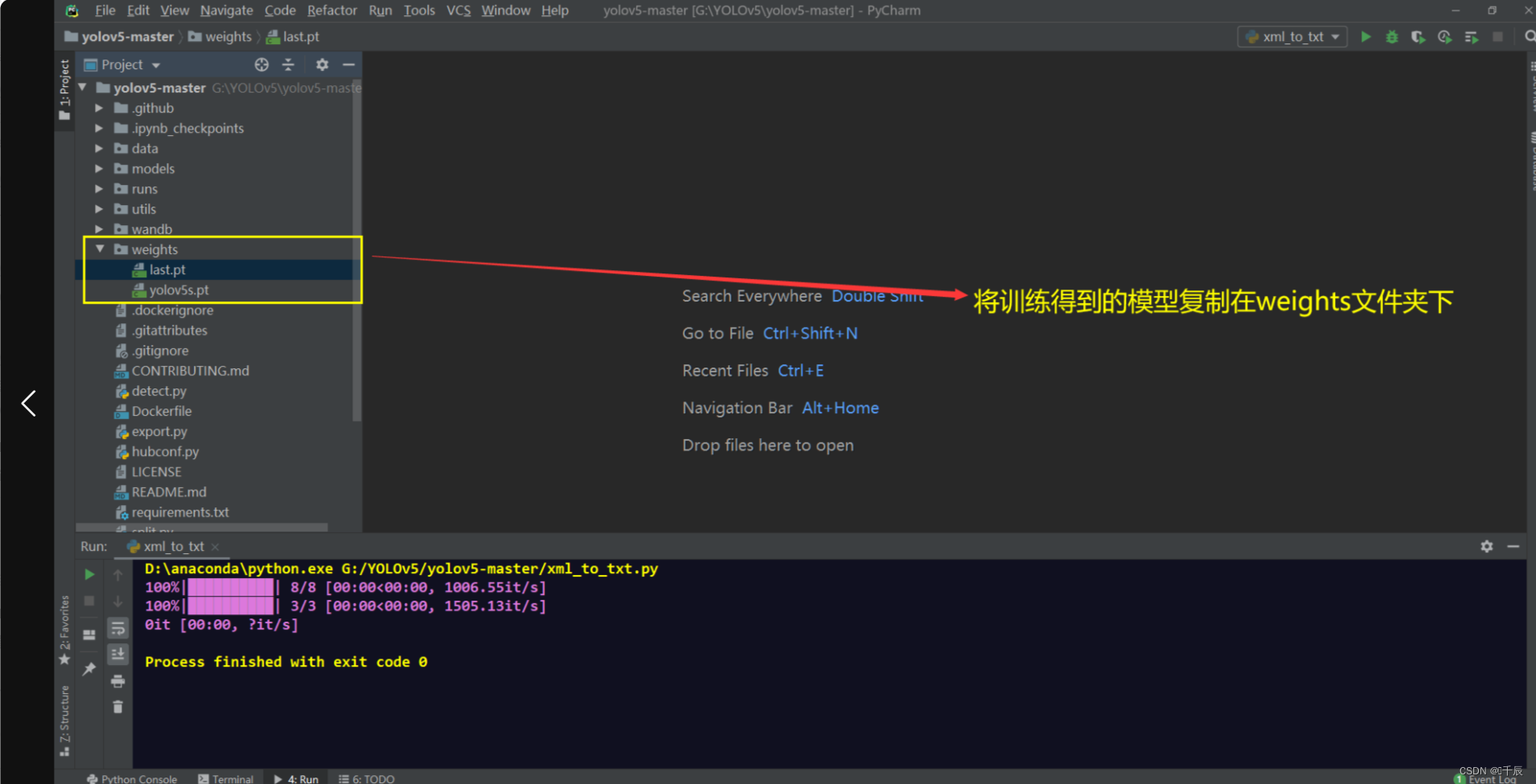

找到训练好的模型last.py将其复制在weights文件下,具体如下图所示:

至此我们就完成了模型的训练。

打开摄像头,运行结果

训练完成后,我们可以进行模型的测试,测试一下刚刚训练的结果。打开命令行:

输入指令:

python detect.py --weight ./weights/last.pt --source 0

注意:0 是电脑自带摄像头

1 是外接的摄像头

5466

5466

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?