Spark基于应用作业的操作

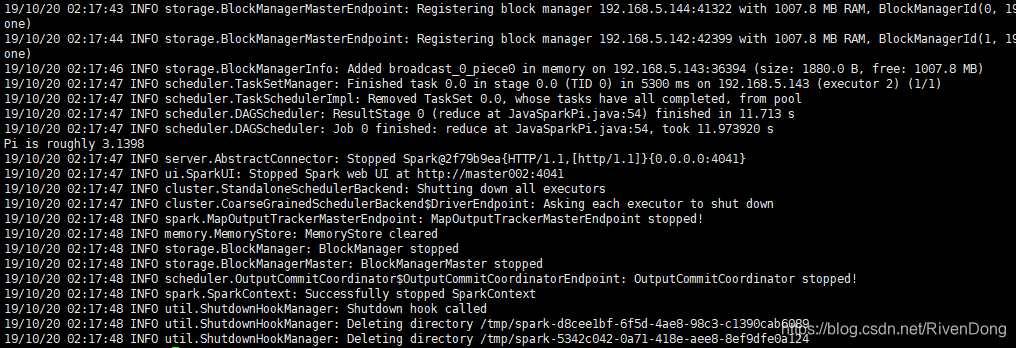

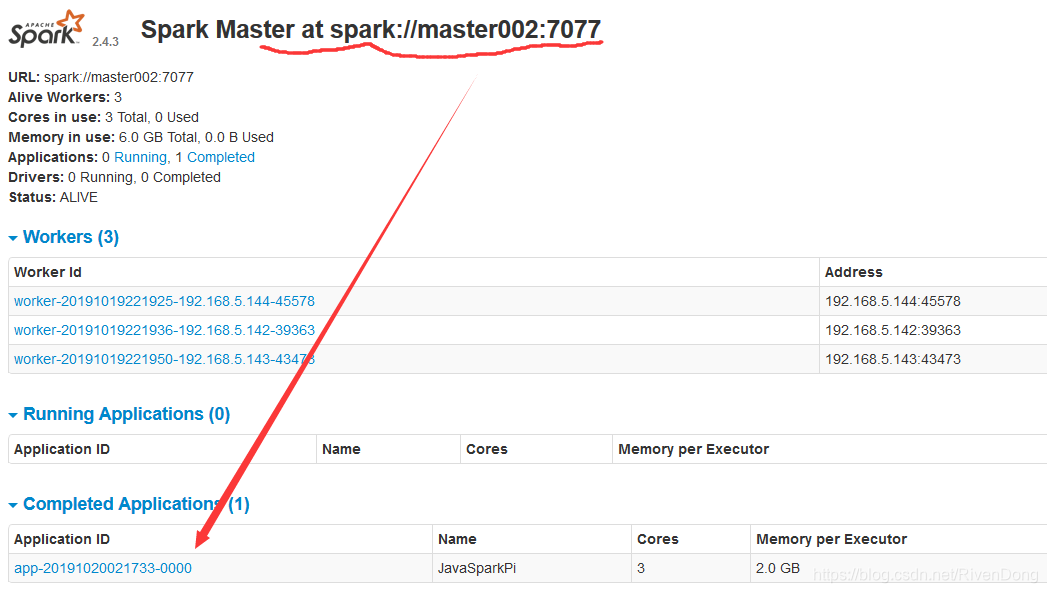

Spark框架可借助spark-submit来提交一个编写好的Job应用到集群,从而完成Spark应用的分析和处理,这通常是生产场景中使用的一种操作方式。

spark-submit --class org.apache.spark.examples.JavaSparkPi --master spark://master002:7077 ../examples/jars/spark-examples_2.11-2.4.3.jar 1

注释:

- –class 参数用于指定提交的JAR包中的运行主类

- 最后一个数字1代表运行的slices数量(即并行度),每一个slice都将启动一个Task来运行,每一个Task任务对应一个JVM进程

- .jar 是提交到Spark集群的Job作业打包JAR,这与Hadoop提交作业的方式是相同的

Spark操作的基础命令与开发工具介绍

- 在Spark的安装目录下的bin目录中有以下两个运行命令

- Spark-submit:该命令用于提交Spark的Job应用,通常用于测试

- Spark-shell:Spark交互式命令行工具,通常用于生产环境

- 开发Spark应用可使用IDEA或Eclipse

572

572

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?