昨天学习到训练集和测试集之间的性能差异是过拟合的明显标志,因此我们应该试图找到一个可以控制复杂度的模型。标准线性回归最常用的替代方法之一就是岭回归(ridgeregression),下面来看一下。

1、岭回归

岭回归也是一种用于回归的线性模型,因此它的预测公式与普通最小二乘法相同。

但在岭回归中,对系数(w)的选择不仅要在训练数据上得到好的预测结果,而且还要拟合附加约束。我们还希望系数尽量小。

换句话说,w的所有元素都应接近于0。

直观上来看,这意味着每个特征对输出的影响应尽可能小(即斜率很小),同时仍给出很好的预测结果。这种约束是所谓正则化(regularization)的一个例子。

正则化是指对模型做显式约束,以避免过拟合。

岭回归用到的这种被称为L2正则化。

岭回归在linear model.Ridge中实现。

来看一下它对扩展的波士顿房价数据集的效果如何:

from sklearn.linear_model import Ridge

#引入

ridge = Ridge().fit(X_train, y_train)

#fit方法

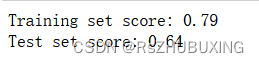

print("Training set score: {:.2f}".format(ridge.score(X_train, y_train)))

#打印桥岭score 训练集结果

print("Test set score: {:.2f}".format(ridge.score(X_test, y_test)))

#打印测试集结果

可以看出,Ridge在训练集上的分数要低于LinearRegression,但在测试集上的分数更高。这和我们的预期一致。

线性回归对数据存在过拟合。

Ridge是一种约束更强的模型,所以更不容易过拟合。

复杂度更小的模型意味着在训练集上的性能更差,但泛化性能更好。

由于我们只对泛化性能感兴趣,所以应该选择Ridge模型而不是LinearRegression模型。

Ridge模型在模型的简单性(系数都接近于0)与训练集性能之间做出权衡。

简单性和训练集性能二者对于模型的重要程度可以由用户通过设置alpha参数来指定。

在前面的例子中,我们用的是默认参数alpha=1.0。

但没有理由认为这会给出最佳权衡。alpha的最佳设定值取决于用到的具体数据集。

增大alpha会使得系数更加趋向于0,从而降低训练集性能,但可能会提高泛化性能。

例如:

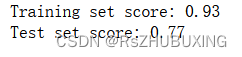

ridge10 = Ridge(alpha=10).fit(X_train, y_train)

print("Training set score: {:.2f}".format(ridge10.score(X_train, y_train)))

print("Test set score: {:.2f}".format(ridge10.score(X_test, y_test)))

当alpha系数减小到很小的时候,Bridge与LinearRegression差不多

ridge01 = Ridge(alpha=0.1).fit(X_train, y_train)

print("Training set score: {:.2f}".format(ridge01.score(X_train, y_train)))

print("Test set score: {:.2f}".format(ridge01.score(X_test, y_test)))

这里的alpha=0.1效果很不错,我们可以尝试减小alpha来增强泛化能力

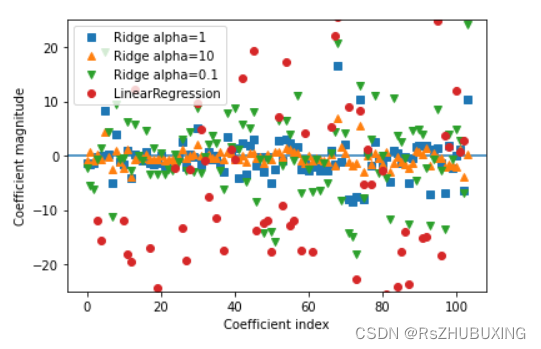

我们还可以查看alpha取不同值时模型的coef属性,从而更加定性地理解alpha参数是如何改变模型的。更大的alpha表示约束更强的模型,所以我们预计大alpha对应的coef元素比小alpha对应的coef元素要小。

plt.plot(ridge.coef_, 's', label="Ridge alpha=1")

plt.plot(ridge10.coef_, '^', label="Ridge alpha=10")

plt.plot(ridge01.coef_, 'v', label="Ridge alpha=0.1")

plt.plot(lr.coef_, 'o', label="LinearRegression")

plt.xlabel("Coefficient index")

plt.ylabel("Coefficient magnitude")

xlims = plt.xlim()

plt.hlines(0, xlims[0], xlims[1])

plt.xlim(xlims)

plt.ylim(-25, 25)

plt.legend()

这里x轴对应coef的元素:x=0对应第一个特征的系数,x=1对应第二个特征的系数,以此类推,一直到x=100。y轴表示该系数的具体数值。这里需要记住的是,对于alpha=10,系数大多在-3和3之间。对于alpha=1的Ridge模型,系数要稍大一点。对于alpha=0.1,点的范围更大。对于没有做正则化的线性回归(即alpha=0),点的范围很大,许多点都超出了图像的范围。

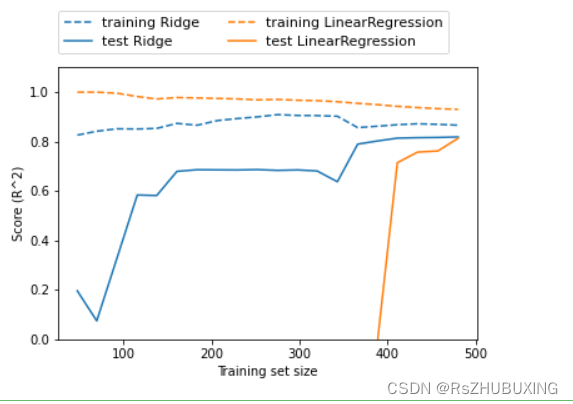

另一种方法理解正则化,即固定alpha,改变训练数据集量。

对波士顿房价数据集做二次抽样,并在数据量逐渐增加的子数据集上分别对LinearRegression和Ridge(alpha=1)两个模型进行评估(将模型性能作为数据集大小的函数进行绘图,这样的图像叫作学习曲线):

mglearn.plots.plot_ridge_n_samples()

无论是岭回归还是线性回归,所有数据集大小对应的训练分数都要高于测试分数。由于岭回归是正则化的,因此它的训练分数要整体低于线性回归的训练分数。但岭回归的测试分数要更高,特别是对较小的子数据集。如果少于400个数据点,线性回归学不到任何内容。

随着模型可用的数据越来越多,两个模型的性能都在提升,最终线性回归的性能追上了岭回归。这里要记住的是,如果有足够多的训练数据,正则化变得不那么重要,并且岭回归和线性回归将具有相同的性能。

线性回归的训练性能在下降。如果添加更多数据,模型将更加难以过拟合或记住所有的数据

2、lasso

除了Ridge,还有一种正则化的线性回归是Lasso。

与岭回归相同,使用lasso也是约束系数使其接近于0,但用到的方法不同,叫作L1正则化。

L1正则化的结果是,使用lasso时某些系数刚好为0。

这说明某些特征被模型完全忽略。这可以看作是一种自动化的特征选择。

某些系数刚好为0,这样模型更容易解释,也可以呈现模型最重要的特征。

我们将lasso应用在扩展的波士顿房价数据集上:

from sklearn.linear_model import Lasso

lasso = Lasso().fit(X_train, y_train)

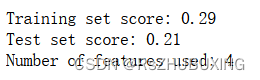

print("Training set score: {:.2f}".format(lasso.score(X_train, y_train)))

print("Test set score: {:.2f}".format(lasso.score(X_test, y_test)))

print("Number of features used:", np.sum(lasso.coef_ != 0))

Lasso在训练集与测试集上的表现都很差。

这表示存在欠拟合,我们发现模型只用到了105个特征中的4个。

与Ridge类似,Lasso也有一个正则化参数alpha,可以控制系数趋向于0的强度。

在上一个例子中,我们用的是默认值alpha=1.0。

为了降低欠拟合,我们尝试减小alpha。

这么做的同时,我们还需要增加max iter的值(运行迭代的最大次数):

lasso001 = Lasso(alpha=0.01, max_iter=100000).fit(X_train, y_train)

print("Training set score: {:.2f}".format(lasso001.score(X_train, y_train)))

print("Test set score: {:.2f}".format(lasso001.score(X_test, y_test)))

print("Number of features used:", np.sum(lasso001.coef_ != 0))

alpha值变小,我们可以拟合一个更复杂的模型,在训练集和测试集上的表现也更好。

模型性能比使用Ridge时略好一点,而且我们只用到了105个特征中的33个。

这样模型可能更容易理解。

但如果把alpha设得太小,那么就会消除正则化的效果,并出现过拟合,得到与LinearRegression类似的结果:

lasso00001 = Lasso(alpha=0.0001, max_iter=100000).fit(X_train, y_train)

print("Training set score: {:.2f}".format(lasso00001.score(X_train, y_train)))

print("Test set score: {:.2f}".format(lasso00001.score(X_test, y_test)))

print("Number of features used:", np.sum(lasso00001.coef_ != 0))

对不同模型的系数作图

plt.plot(lasso.coef_, 's', label="Lasso alpha=1")

plt.plot(lasso001.coef_, '^', label="Lasso alpha=0.01")

plt.plot(lasso00001.coef_, 'v', label="Lasso alpha=0.0001")

plt.plot(ridge01.coef_, 'o', label="Ridge alpha=0.1")

plt.legend(ncol=2, loc=(0, 1.05))

plt.ylim(-25, 25)

plt.xlabel("Coefficient index")

plt.ylabel("Coefficient magnitude")

在alpha=1时,我们发现不仅大部分系数都是0,而且其他系数也都很小。

将alpha减小至0.01,我们得到图中向上的三角形,大部分特征等于0。

alpha=0.0001时,我们得到正则化很弱的模型,大部分系数都不为0,并且还很大。

为了便于比较,图中用圆形表示Ridge的最佳结果。

alpha=0.1的Ridge模型的预测性能与alpha=0.01的Lasso模型类似,但Ridge模型的所有系数都不为0。

3、总结

在实践中,在两个模型中一般首选岭回归。但如果特征很多,你认为只有其中几个是重要的,那么选择Lasso可能更好。同样,如果你想要一个容易解释的模型,Lasso可以给出更容易理解的模型,因为它只选择了一部分输入特征。

正则化是指对模型做显式约束,以避免过拟合。

桥岭,正则化系数L2。

增大alpha会使得系数更加趋向于0,从而降低训练集性能,但可能会提高泛化性能。

减小alpha可以让系数受到的限制更小,对于更小的,机会没有限制,减小alpha也可以提高泛化性能。

Lasso,正则化系数L1,alpha系数在把特征值正则化成零。

alpha越小,0越少,我们可以拟合一个更复杂的模型,在训练集和测试集上的表现也更好,但过小,会完全消除正则化的效果,并出现过拟合,要注意确定一个比较适合的值。

alpha过大,就会存在欠拟合。

691

691

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?