目录

一、Docker私有仓库创建

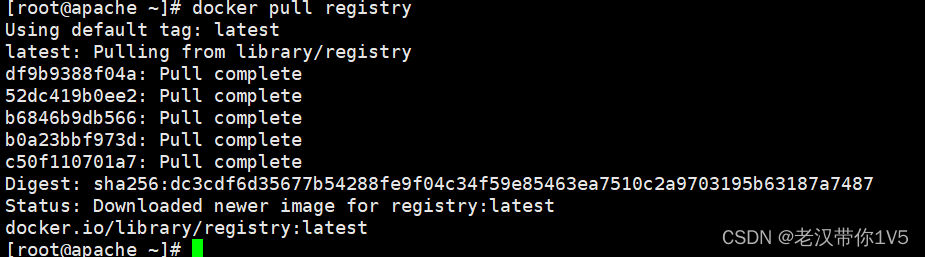

1、下载registry

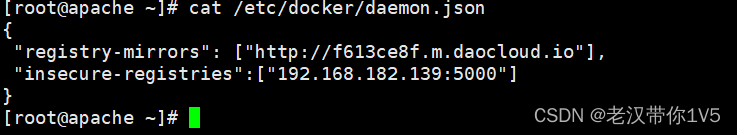

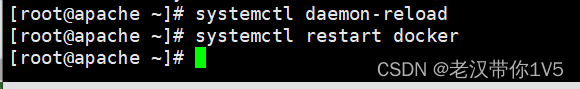

2、设置镜像加速在引擎中断设置(下载时 会在本地搜寻是否有自己要找的镜像)

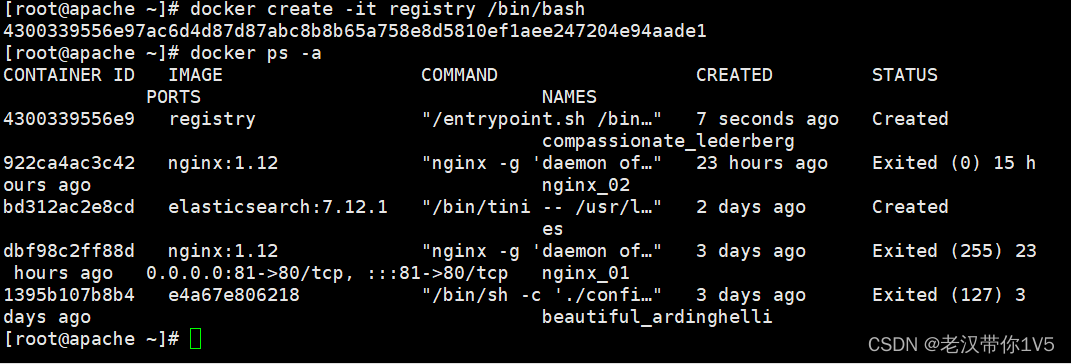

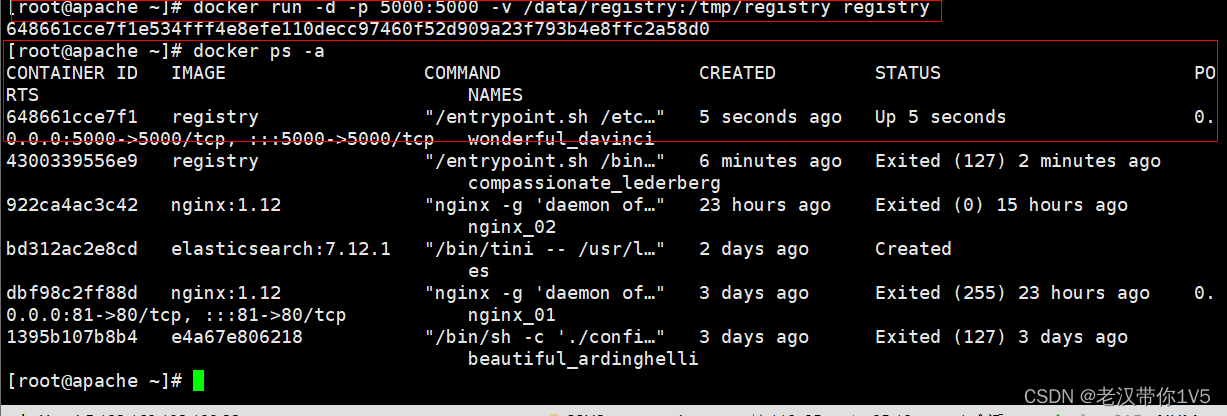

3、创建容器 registry

宿主机的/data/registry自动创建挂载容器中的/tmp/registry

docker run -d -p 5000:5000 -v /data/registry:/tmp/registry registry

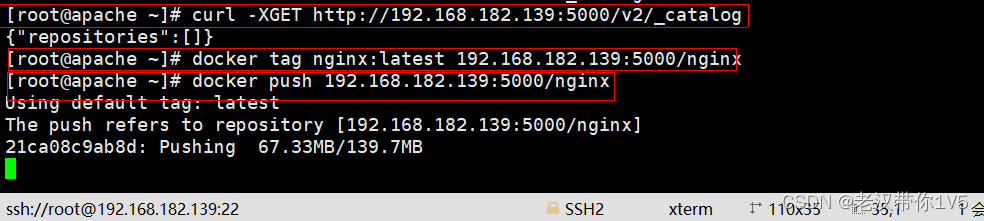

//更改标记为192.168.182.139:5000/nginx

docker tag nginx:latest 192.168.182.139:5000/nginx

//上传

docker push 192.168.182.139:5000/nginx

4、获取私有仓库列表

4、获取私有仓库列表

#偏门的面试题: 怎么获取registry的镜像仓库中的镜像信息

curl -XGET http://192.168.226.128:5000/v2/_catalog

//显示上传成功

{"repositories":["nginx"]}

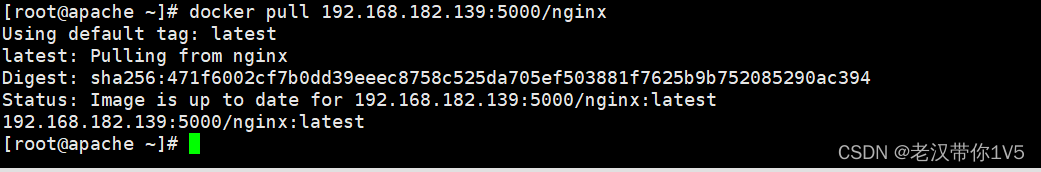

5、测试私有仓库下载

docker pull 192.168.182.139:5000/nginx

二、Cgroup 资源配置方法

⭐docker 使用cgroup控制资源,K8S 里面也有 limit (使用上限)

⭐Docker通过 Cgroup 来控制容器使用的资源配额,包括 CPU、内存、磁盘三大方面, 基本覆盖了常见的资源配额和使用量控制。

⭐Cgroup 是 Control Groups 的缩写,是Linux 内核提供的一种可以限制、记录、隔离进程组所使用的物理资源(如 CPU、内存、磁盘 IO 等等)的机制

⭐07年谷歌,可以控制资源分配通过操作系统内核,控制应用程序使用内存资源、cpu资源、 文件系统资源等等

⭐cgroup是一种资源控制手段

也是容器隔离的6个名称空间的一种实现手段

每个容器相当于一个进程

CPU使用率控制

cpu周期: 1s为一个周期的定律,参数值一般为100000 (CPU衡量单位是秒)

假如需要给此容器分配cpu使用率的20%,则参数需要设置为20000,相当于每个周期分配给这个容器0.2s

cpu在一个时刻,只能给一个进程占用

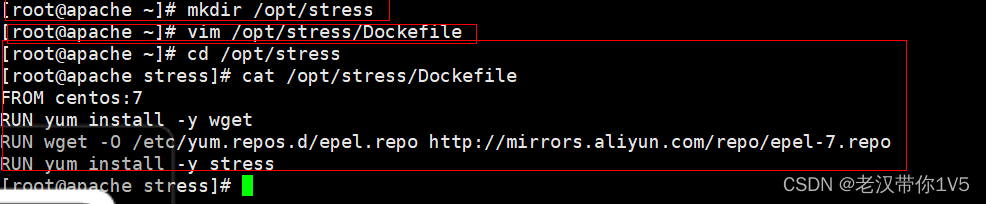

1、使用 stress 工具测试 CPU 和内存

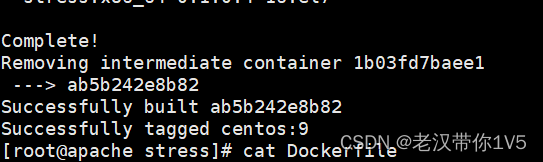

使用 Dockerfile 来创建一个基于 Centos 的 stress 工具镜像。

[root@localhost ~]# mkdir /opt/stress

[root@localhost ~]# vim /opt/stress/Dockerfile

FROM centos:7

RUN yum install -y wget

RUN wget -O /etc/yum.repos.d/epel.repo http://mirrors.aliyun.com/repo/epel-7.repo

RUN yum install -y stress

[root@localhost ~]# cd /opt/stress/

[root@localhost stress]# docker build -t centos:stress .

使用如下命令创建容器,命令中的--cpu-shares 参数值不能保证可以获得 1 个 vcpu 或 者多少 GHz 的 CPU 资源,它仅是一个弹性的加权值。

[root@localhost stress]# docker run -itd --cpu-shares 100 centos:stress

nginx

upstream tomcat_server {

192.168.226.129:8080 weight=1

192.168.226.130:8080 weight=2

}

说明:默认情况下,每个 Docker容器的CPU份额都是1024。单独一个容器的份额是没有意义的。只有在同时运行多个容器时,容器的 CPU 加权的效果才能体现出来。

例如,两个容 器 A、B 的 CPU 份额分别为 1000 和 500,在CPU进行时间片分配的时候,容器A比容器B多一倍的机会获得 CPU 的时间片。

但分配的结果取决于当时主机和其他容器的运行状态, 实际上也无法保证容器 A一定能获得CPU时间片。比如容器A的进程一直是空闲的,

那么容器B是可以获取比容器A更多的CPU时间片的。极端情况下,例如主机上只运行了一个容器,即使它的 CPU 份额只有 50,它也可以独占整个主机的CPU资源。

一个主机运行一个容器,只运行了一个应用(容器也是虚拟化技术 )

一个主机运行一个应用

Cgroups 只在容器分配的资源紧缺时,即在需要对容器使用的资源进行限制时,才会生效。因此,无法单纯根据某个容器的CPU份额来确定有多少CPU资源分配给它,

资源分配 结果取决于同时运行的其他容器的CPU分配和容器中进程运行情况。

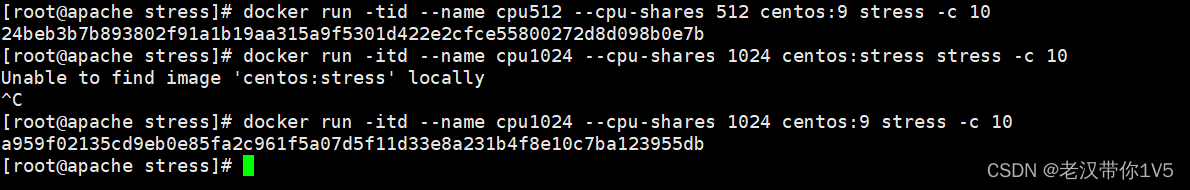

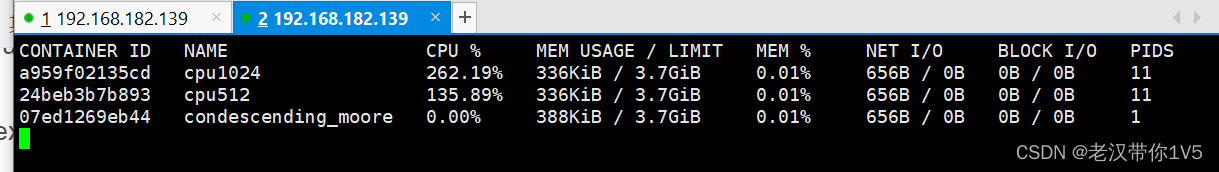

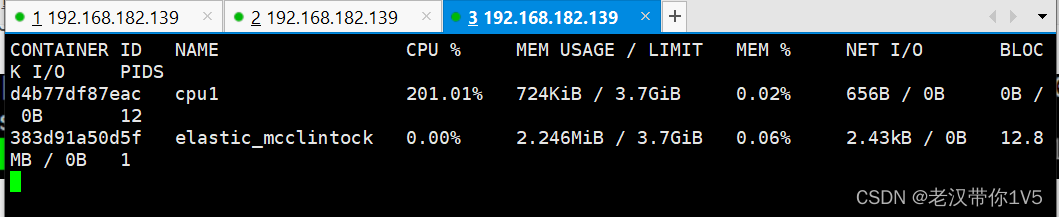

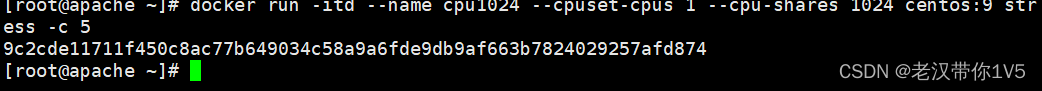

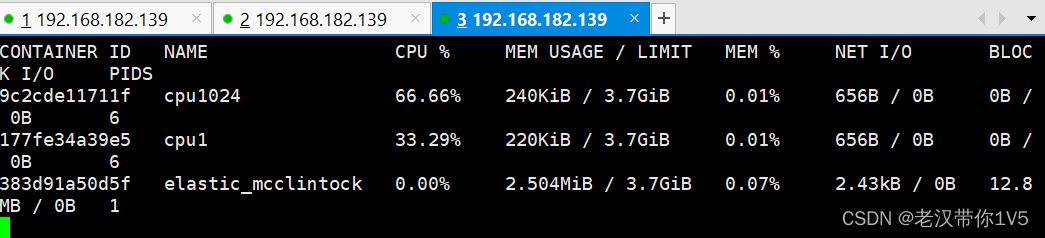

可以通过 cpu share 可以设置容器使用 CPU 的优先级/权重,比如启动了两个容器及运行查看 CPU 使用百分比。

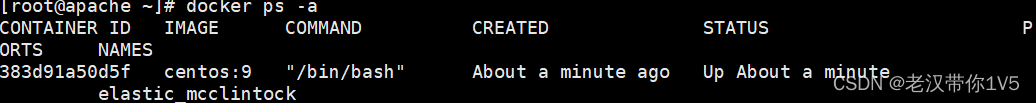

[root@localhost stress]# docker run -tid --name cpu512 --cpu-shares 512 centos:9 stress -c 10 //容器产生10个子函数进程

[root@localhost stress]# docker exec -it f4953c0d7e76 bash //进入容器使用top查看cpu使用情况

//再开启一个容器做比较

[root@localhost stress]# docker run -tid --name cpu1024 --cpu-shares 1024 centos:stress stress -c 10

[root@localhost stress]# docker exec -it 容器id bash //进容器使用top对比两个容器的%CPU,比例是1:2

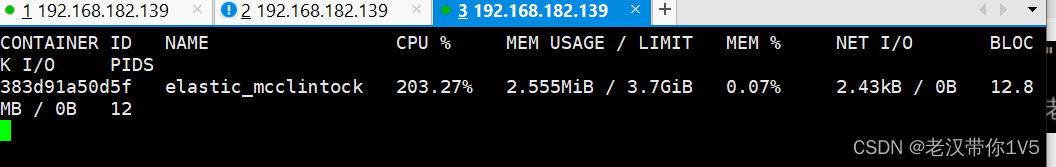

docker stats 查看资源使用

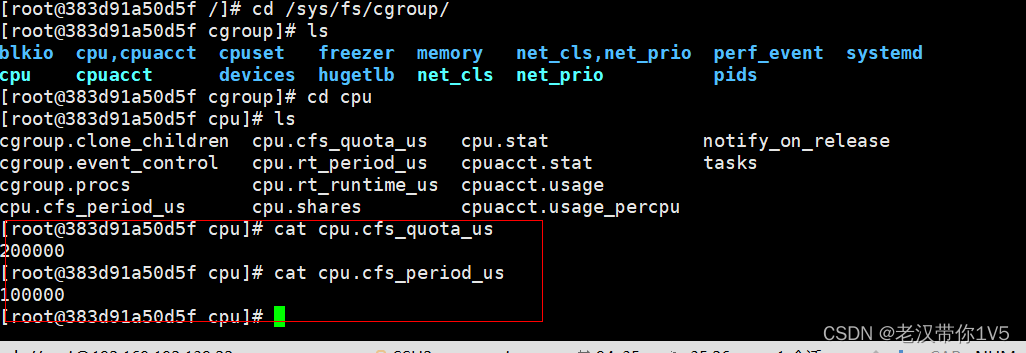

2、CPU 周期限制

Docker 提供了--cpu-period、--cpu-quota 两个参数控制容器可以分配到的 CPU 时钟周期。

--cpu-period 是用来指定容器对 CPU 的使用要在多长时间内做一次重新分配。

PS:(春儿)

cd /sys/fs/cgroup/cpu/docker容器ID/cpu.cfs_quota_us

宿主机怎么提供资源、怎么控制docker容器中的应用的:

CPU --->VCPU-->以进程的方式体现在vorkstation环境(docker环境中)---》docker表现形式是容器

-->Vcpu以进程的方式控制容器--》容器中的应用需要的是服务进程支持--》宿主机内核中cpu可以被cgroup管理(通过

分配资源手段)--》linux 内核中的cgroup可以控制管理docker 容器中的应用

--cpu-quota 是用来指定在这个周期内,最多可以有多少时间用来跑这个容器。

与 --cpu-shares 不同的是,这种配置是指定一个绝对值,容器对 CPU 资源的使用绝对不会超过配置的值。

cpu-period 和 cpu-quota 的单位为微秒(μs)。cpu-period 的最小值为 1000 微秒, 最大值为 1 秒(10^6 μs),默认值为 0.1 秒(100000 μs)。

cpu-quota 的值默认为 -1, 表示不做控制。cpu-period 和 cpu-quota 参数一般联合使用。

redis 中,用来表示的永久 -1

ttl teacher

-1

lrange teacher 0 -1

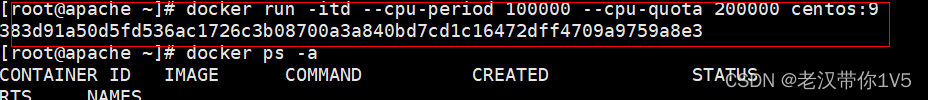

例如:容器进程需要每 1 秒使用单个 CPU 的 0.2 秒时间,可以将 cpu-period 设置 为 1000000(即 1 秒),cpu-quota 设置为 200000(0.2 秒)。

当然,在多核情况下,如果允许容器进程完全占用两个 CPU,则可以将 cpu-period 设置为 100000(即 0.1 秒), cpu-quota 设置为 200000(0.2 秒)。

[root@localhost stress]# docker run -tid --cpu-period 100000 --cpu-quota 200000 centos:stress

[root@localhost stress]# docker exec -it 98d2aaa50019 bash

[root@localhost stress]# docker exec -it 98d2aaa50019 bash

###查询容器的资源限制参数

1、在指定容器目录中

[root@98d2aaa50019 /]# cat /sys/fs/cgroup/cpu/docker/容器ID/cpu.cfs_period_us

100000

[root@98d2aaa50019 /]# cat /sys/fs/cgroup/cpu/docker/容器ID/cpu.cfs_quota_us

200000

2、使用docker inspect 容器ID/容器名

"CpuPeriod": 100000,

"CpuQuota": 200000,

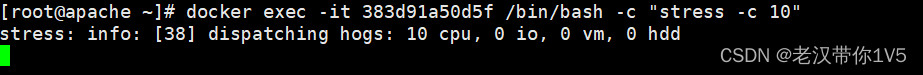

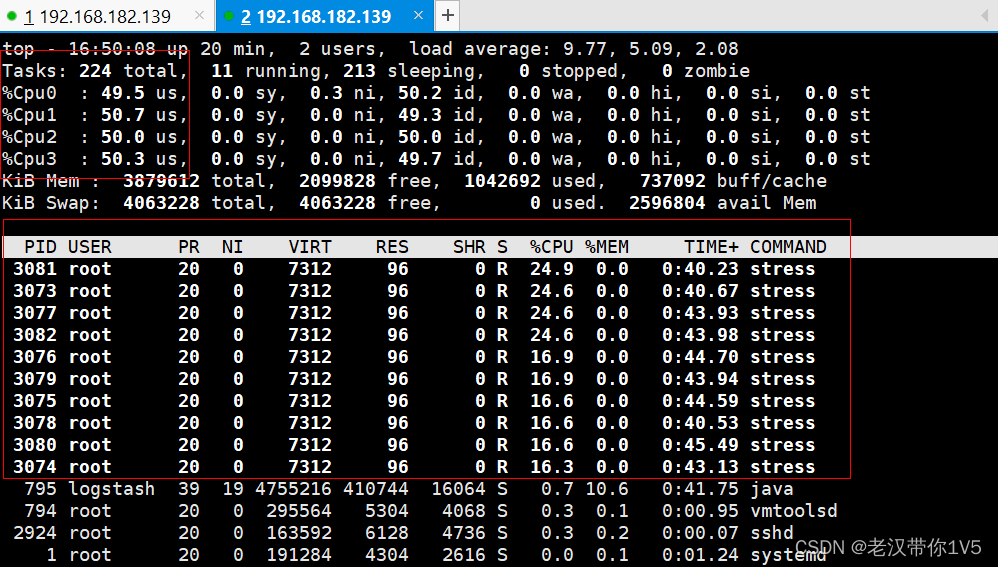

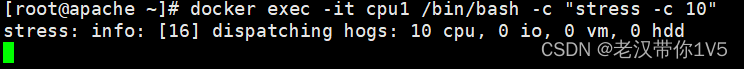

给10个子函数进程 进行压测 (docker exec -itd 容器名 /bin/bash -c "stress -c 10")

可以看到%CPU进程的资源占用

分配到两个cpu

3、 CPU Core 控制

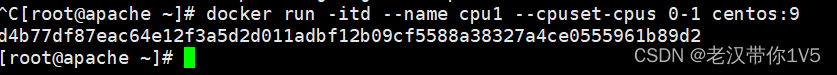

对多核 CPU 的服务器,Docker 还可以控制容器运行使用哪些 CPU 内核,即使用--cpuset-cpus 参数。

这对具有多 CPU 的服务器尤其有用,可以对需要高性能计算的容器进行性能最优的配置。

[root@localhost stress]# docker run -tid --name cpu1 --cpuset-cpus 0-1 centos:9

执行以上命令需要宿主机为双核,表示创建的容器只能用 0、1两个内核。最终生成 的 cgroup 的 CPU 内核配置如下:

[root@localhost /]# cat/sys/fs/cgroup/cpuset/docker/f8481d4957529e5c9ed392d169c3dba0f076399bf46132e3073e8e10c7983ec4/cpuset.cpus

0-1

通过下面指令可以看到容器中进程与 CPU 内核的绑定关系,达到绑定 CPU 内核的目的。

[root@localhost stress]# docker exec 容器id taskset -c -p 1 //容器内部第一个进程号pid为1被绑定到指定CPU上运行

pid 1's current affinity list: 0,1

1、创建容器时 直接使用参数指定资源限制

2、创建容器后,指定资源分配

修改宿主机对应容器资源控制的文件

/sys/fs/cgroup/*

可以看到只有cpu0和cpu1的资源被占用了

4、CPU 配额控制参数的混合使用

通过 cpuset-cpus 参数指定容器 A 使用 CPU 内核 0,容器 B 只是用 CPU 内核 1。

在主机上只有这两个容器使用对应 CPU 内核的情况,它们各自占用全部的内核资源,cpu-shares 没有明显效果。

cpuset-cpus、cpuset-mems 参数只在多核、多内存节点上的服务器上有效,并且必须与实际的物理配置匹配,否则也无法达到资源控制的目的。

在系统具有多个 CPU 内核的情况下,需要通过 cpuset-cpus 参数为设置容器 CPU 内核才能方便地进行测试。

//宿主系统修改为4核心CPU

[root@localhost stress]# docker run -tid --name cpu1 --cpuset-cpus 1 --cpu-shares 512 centos:stress stress -c 1

[root@localhost stress]# docker exec -it 84598dfadd34 bash

[root@localhost stress]# docker exec -it 84598dfadd34 bash

[root@localhost stress]# exit

[root@localhost stress]# docker run -tid --name cpu10244 --cpuset-cpus 1 --cpu-shares 1024 centos:stress stress -c 1

[root@localhost stress]# docker exec -it 容器id bash

总结:上面的 centos:stress 镜像安装了 stress 工具,用来测试 CPU 和内存的负载。通过 在两个容器上分别执行 stress -c 1 命令,

将会给系统一个随机负载,产生 1 个进程。这个进程都反复不停的计算由 rand(产生随机数的平方根,直到资源耗尽。

观察到宿主机上的 CPU 使用率,第三个内核的使用率接近 100%, 并且一批进程的 CPU 使用率明显存在 2:1 的使用比例的对比。

cpu比例

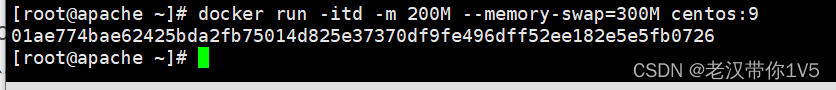

5、内存限额

与操作系统类似,容器可使用的内存包括两部分:物理内存和 Swap。

Docker 通过下面两组参数来控制容器内存的使用量。

-m 或 --memory:设置内存的使用限额,例如 100M、1024M。

--memory-swap:设置 内存+swap 的使用限额。

执行如下命令允许该容器最多使用 200M 的内存和 300M 的 swap。

[root@localhost stress]# docker run -it -m 200M --memory-swap=300M centos:9

--vm 1:启动 1 个内存工作线程。

--vm-bytes 280M:每个线程分配 280M 内存。

默认情况下,容器可以使用主机上的所有空闲内存。

与 CPU 的 cgroups 配置类似, Docker 会自动为容器在目录 /sys/fs/cgroup/memory/docker/<容器的完整长 ID>

中创建相应 cgroup 配置文件

如果让工作线程分配的内存超过 300M,分配的内存超过限额,stress 线程报错,容器 退出。

[root@localhost stress]# docker run -it -m 200M --memory-swap=300M progrium/stress --vm 1 --vm-bytes 310M

注:虚拟内存指的是当内存被占用完时 系统会直接调用swap中的虚拟内存 (将每个pe模块没有被永尽的多余磁盘空间进行整合 将其调用)

6、构建镜像(docker build)时指定资源限制

--build-arg=[] : 设置镜像创建时的变量;

--cpu-shares : 设置 cpu 使用权重;

--cpu-period : 限制 CPU CFS周期;

--cpu-quota : 限制 CPU CFS配额;

--cpuset-cpus : 指定使用的CPU id;

--cpuset-mems : 指定使用的内存 id;

--disable-content-trust :忽略校验,默认开启;

-f : 指定要使用的Dockerfile路径;

--force-rm : 设置镜像过程中删除中间容器;

--isolation : 使用容器隔离技术;

--label=[] : 设置镜像使用的元数据;

-m : 设置内存最大值;

--memory-swap : 设置Swap的最大值为内存+swap,"-1"表示不限swap;

--no-cache : 创建镜像的过程不使用缓存;

--pull : 尝试去更新镜像的新版本;

--quiet, -q : 安静模式,成功后只输出镜像 ID;

--rm : 设置镜像成功后删除中间容器;

--shm-size : 设置/dev/shm的大小,默认值是64M;

--ulimit : Ulimit配置。

--squash : 将 Dockerfile 中所有的操作压缩为一层。

--tag, -t: 镜像的名字及标签,通常 name:tag 或者 name 格式;可以在一次构建中为一个镜像设置多个标签。

--network: 默认 default。在构建期间设置RUN指令的网络模式

总结:

一、资源限制的主要类型

1、CPU 权重shares、quota、cpuset

2、磁盘 BPS、TPS限制,指定使用哪个磁盘、磁盘分区

3、内存 -m -swap 内存、交换分区

大部分做的是上限的限制

二、资源限制的几种方式

1、build 构建镜像时,可以指定该镜像的资源限制

2、run 将镜像跑为容器的时候,可以指定容器的资源限制

3、容器启动之后, 可以在宿主机对应容器的目录下。修改资源限制,然后重载

/sys/fs/cgroup/*(cpu、blk、mem)/docker/容器ID/ --->修改对应的资源限制文件参数就可以

三、资源限制的状态查询

1、docker inspect 镜像ID/容器ID

2、直接查看宿主机对应容器ID资源限制的文件

cgroup 资源 docker 原理之一 ,namespaces 6个名称空间

3、查看状态docker info (stats)可以查看到 状态的类型统计

310

310

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?