1、回归的概念

回归在数学上来说就是给定一个点的集合,能够用一条曲线拟合。如果是一条直线,就是线性回归;如果是一条二次曲线,就被称为二次回归,回归还有很多的变种,比如locally weighted(局部加权)、logistic回归等等。

(1) 统计回归分析的任务就是根据自变量x1,x2,….,xn和Y的观察值,去估计函数f,寻求变量之间近似的函数关系。

(2) 通常,我们假定f函数的数学形式已知,其中若干个参数未知,要通过自变量和因变量的观察值去估计未知的参数值,这叫“参数回归”。其中应用最广泛的是线性回归函数。函数表达式如下:

这种情况叫做线性回归,这个线性模型是我们今后主要讨论的对象。

(3) 自变量只有一个叫做一元线性回归,自变量有多个叫做多元线性回归;

(4) 分类与回归都属于监督学习,他们的区别在于:

分类:预测有限的离散值;

回归:预测实数值;

线性回归注意点:选定变量(多元)、避免多重共线性、避免拟合过度,通过观察结果检验模型是否合理。

2、线性回归

优点:结果容易理解,计算上也并不复杂;

缺点:对于非线性的数据你和不好;

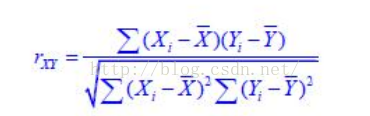

可以使用相关系数衡量线性相关性的强弱:

3、Logistic回归

尽管我也是一知半解的,但是还是把自己的理解整理一下,不得不说,不支持公式编辑真的是很麻烦啊,只能截图贴过来了;

先说线性函数模型,向量表示形式:

这个问题是已知一些数据,如何求里面的未知参数,给出一个最优解。如果寻找这个最优解的参数,

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1084

1084

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?