Spark的任务提交方式实际上有两种,分别是YarnClient模式和YarnCluster模式。

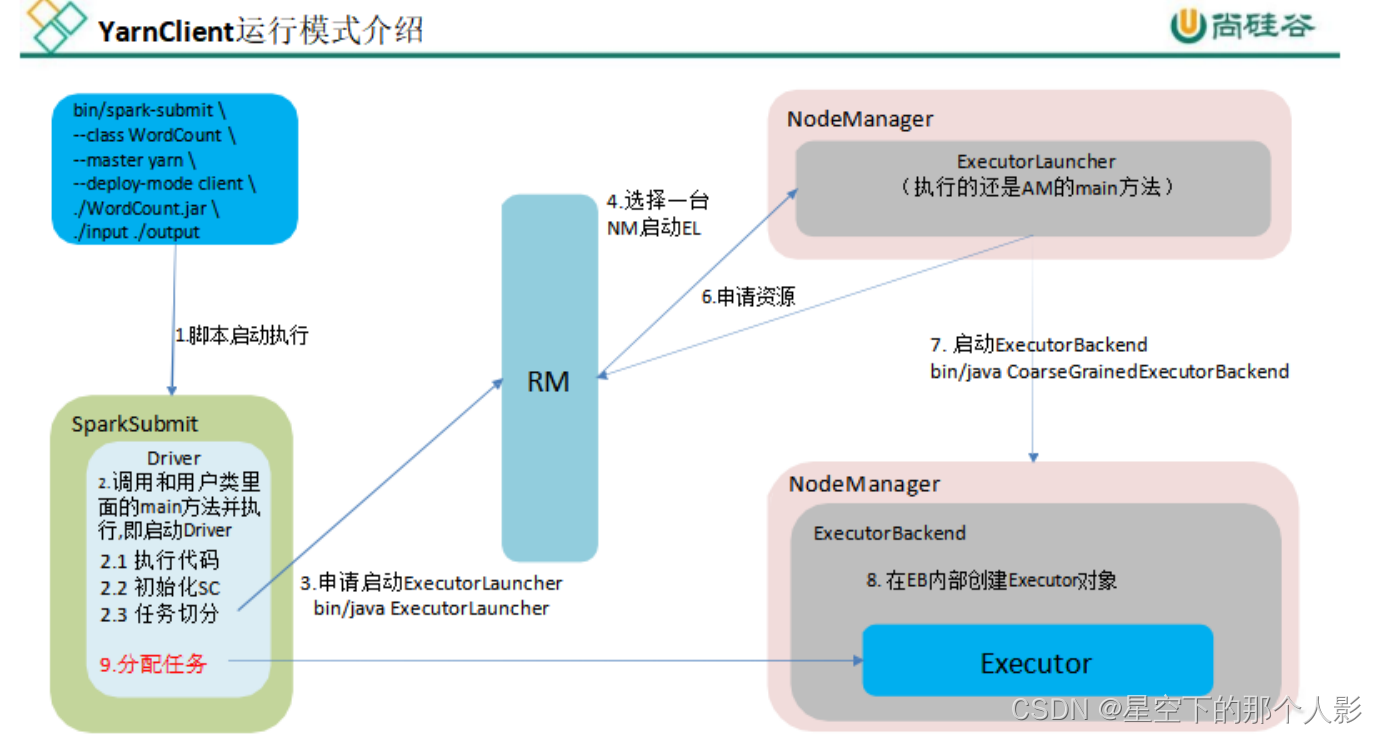

YarnClient模式

- 在 YARN Clinet 模式下,Driver 在任务提交的本地机器上运行;

- Driver 启动后会和 ResourceManager 通讯申请启动 ApplicationMaster;

- 随后 ResourceManager 分配 container,在合适的 NodeManager 上 启动 ApplicationMaster,此时的 ApplicationMaster 的功能相当于一个 ExecutorLauncher,只负责向 ResourceManager 申请 Executor 内存;

- ResourceManager 接到 ApplicationMaster 的资源申请后会分配 container,然后 ApplicationMaster 在资源分配指定的 NodeManager 上 启动 Executor 进程;

- Executor 进程启动后会向 Driver 反向注册,Executor 全部注册完成后 Driver 开始执行 main函数;

- 之后执行到 Action 算子时,触发一个 job ,并根据 宽依赖 开始划分 stage,每个stage生成对应的 taskset,之后将 task 分发到各个 Executor 上执行。

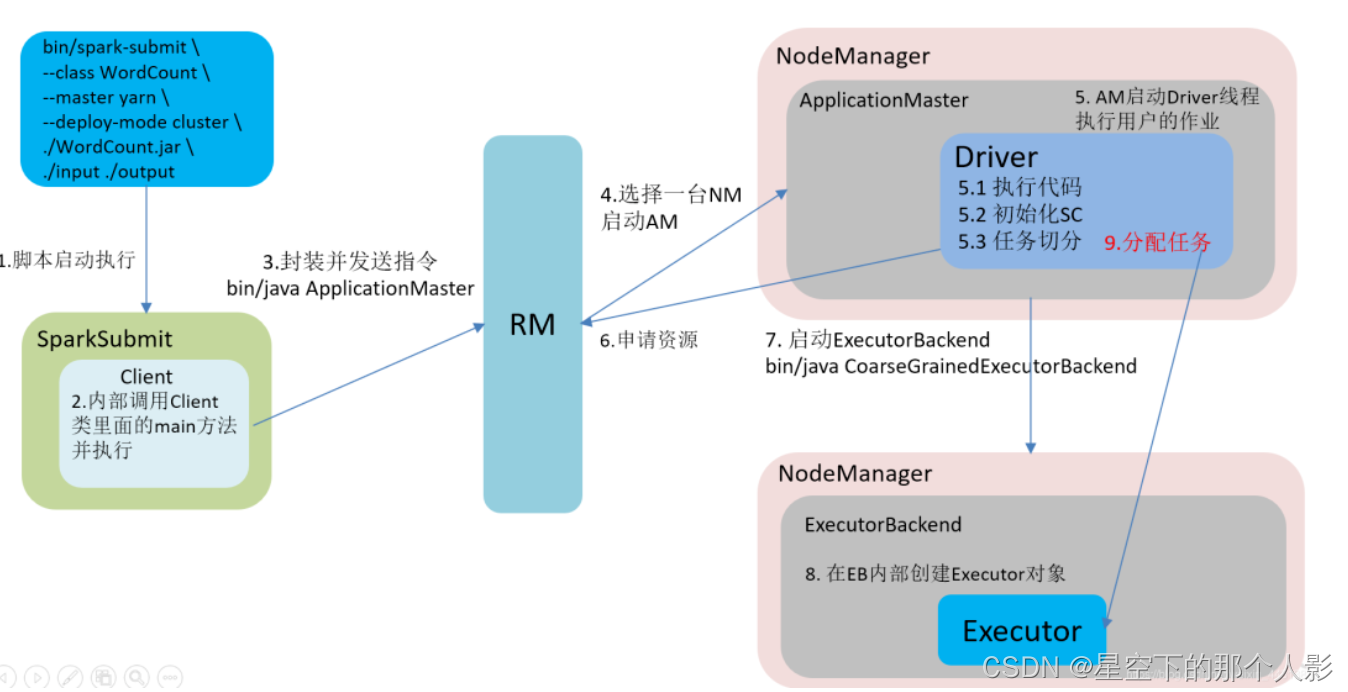

YarnCluster模式

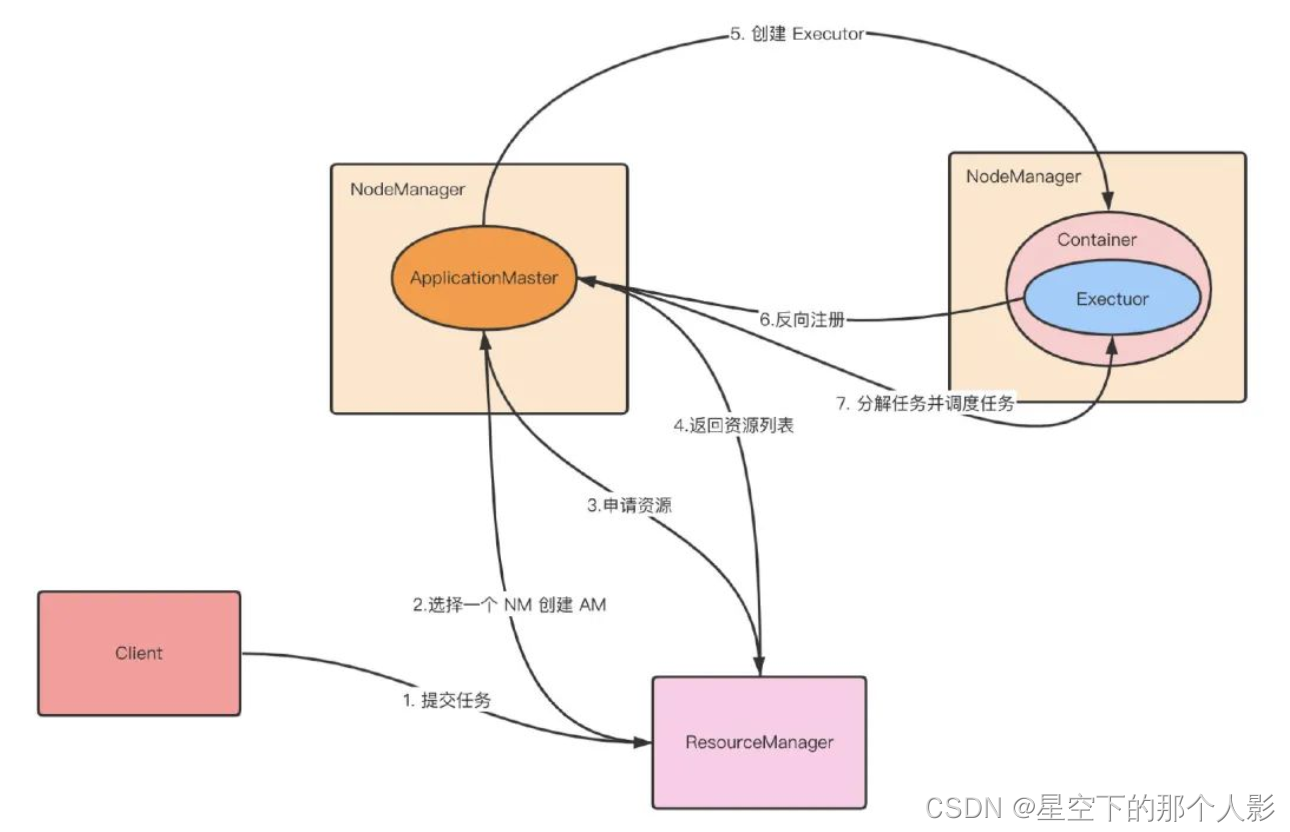

- 在 YARN Cluster 模式下,任务提交后会和 ResourceManager 通讯申请启动 ApplicationMaster;

- 随后 ResourceManager 分配 container,在合适的 NodeManager 上 启动 ApplicationMaster,此时的 ApplicationMaster 就是 Driver;

- Driver 启动后向 ResourceManager 申请 Executor 内存,ResourceManager 接到 ApplicationMaster 的资源申请后会分配 container,然后在合适的 NodeManager 上 启动 Executor 进程;

- Executor 进程启动后会向 Driver 反向注册,Executor 全部注册完成后 Driver 开始执行 main函数;

- 之后执行到 Action 算子时,触发一个 job ,并根据 宽依赖 开始划分 stage,每个stage生成对应的 taskset,之后将 task 分发到各个 Executor 上执行。

3326

3326

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?