上一篇已经讲解了如何构建自己的私人GPT,这一篇主要讲如何让GPT支持中文。

privateGPT 本地部署目前只支持基于llama.cpp 的 gguf格式模型,GGUF 是 llama.cpp 团队于 2023 年 8 月 21 日推出的一种新格式。它是 GGML 的替代品,llama.cpp 不再支持 GGML。

本文主要采用国产YI-34B-CHAT模型。

1.模型下载

>>>yi模型yi-34b-chat.Q4_K_M.gguf下载<<<

下载后放置在 models 文件夹下

embedding模型下载:https://huggingface.co/BAAI/bge-small-zh-v1.5

下载后放置在models/cache文件夹下,bge is short for BAAI general embedding,FlagEmbedding 可以将任何文本映射到低维密集向量,该向量可用于检索、分类、聚类或语义搜索等任务。它还可以用于法学硕士的矢量数据库

2.settings.yaml 文件修改:

主要修改local部分,使用YI模型使用prompt_style: "tag"类型的提示词模板

prompt_style: "tag"

llm_hf_model_file: yi-34b-chat.Q4_K_M.gguf

embedding_hf_model_name: BAAI/bge-small-zh-v1.53.代码修改

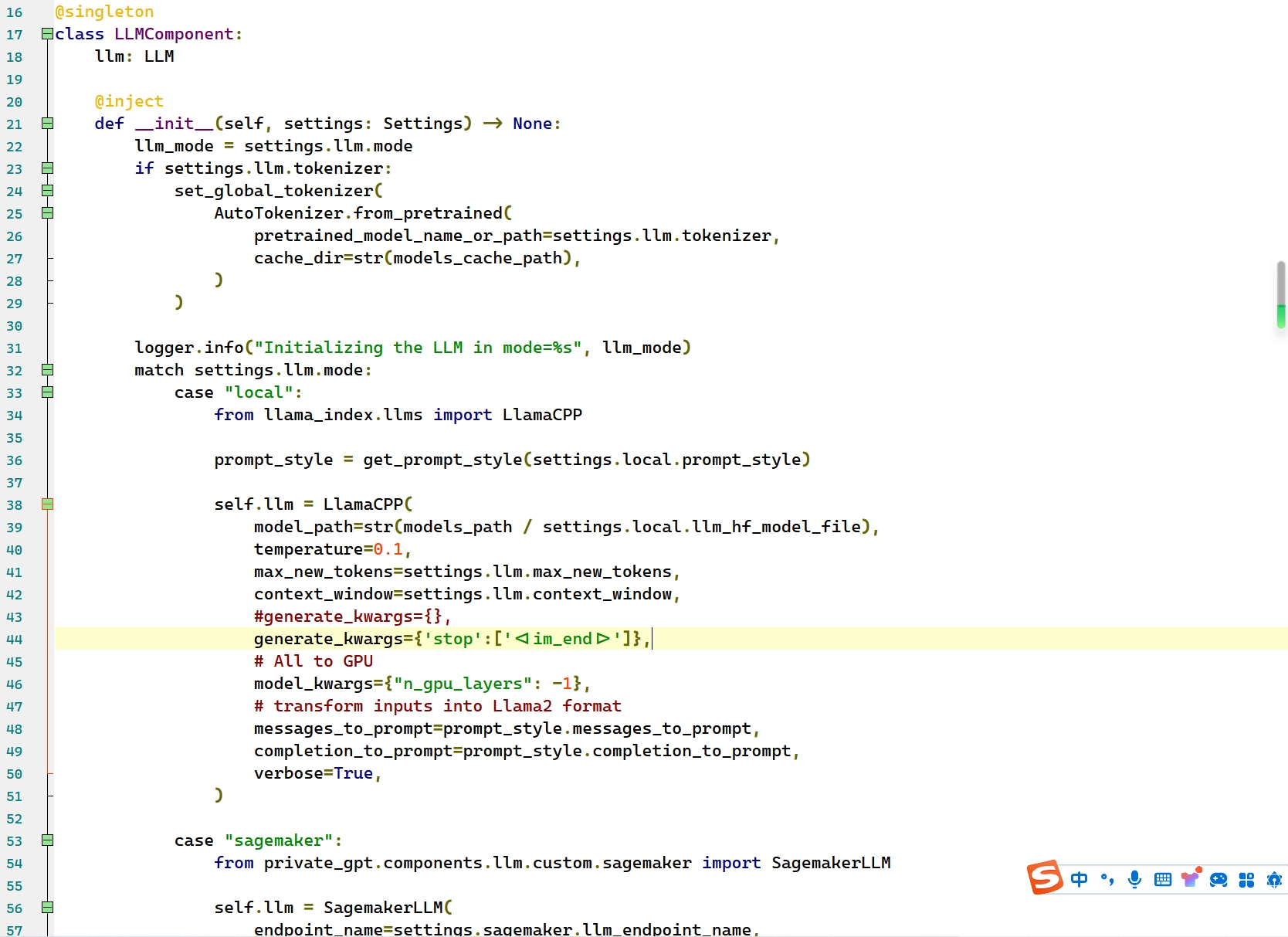

使用YI-34B-CHAT模型,源码要简单修改下,修改如下

文件路径 privateGPT/private_gpt/components/llm/llm_component.py

第44行,添加如下内容:

generate_kwargs={'stop':['<|im_end|>']},如图:

启动

set PGPT_PROFILES=local

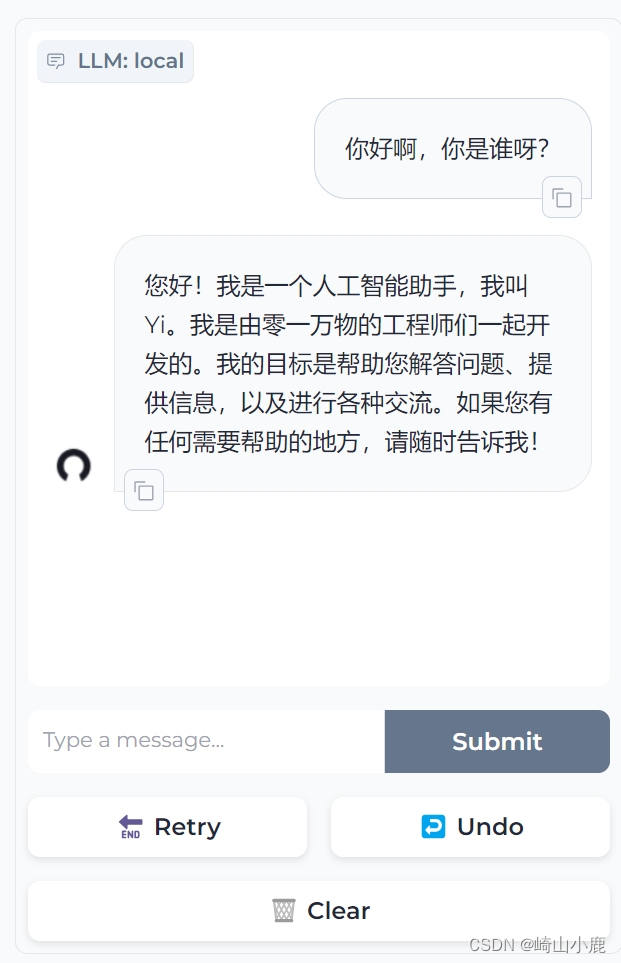

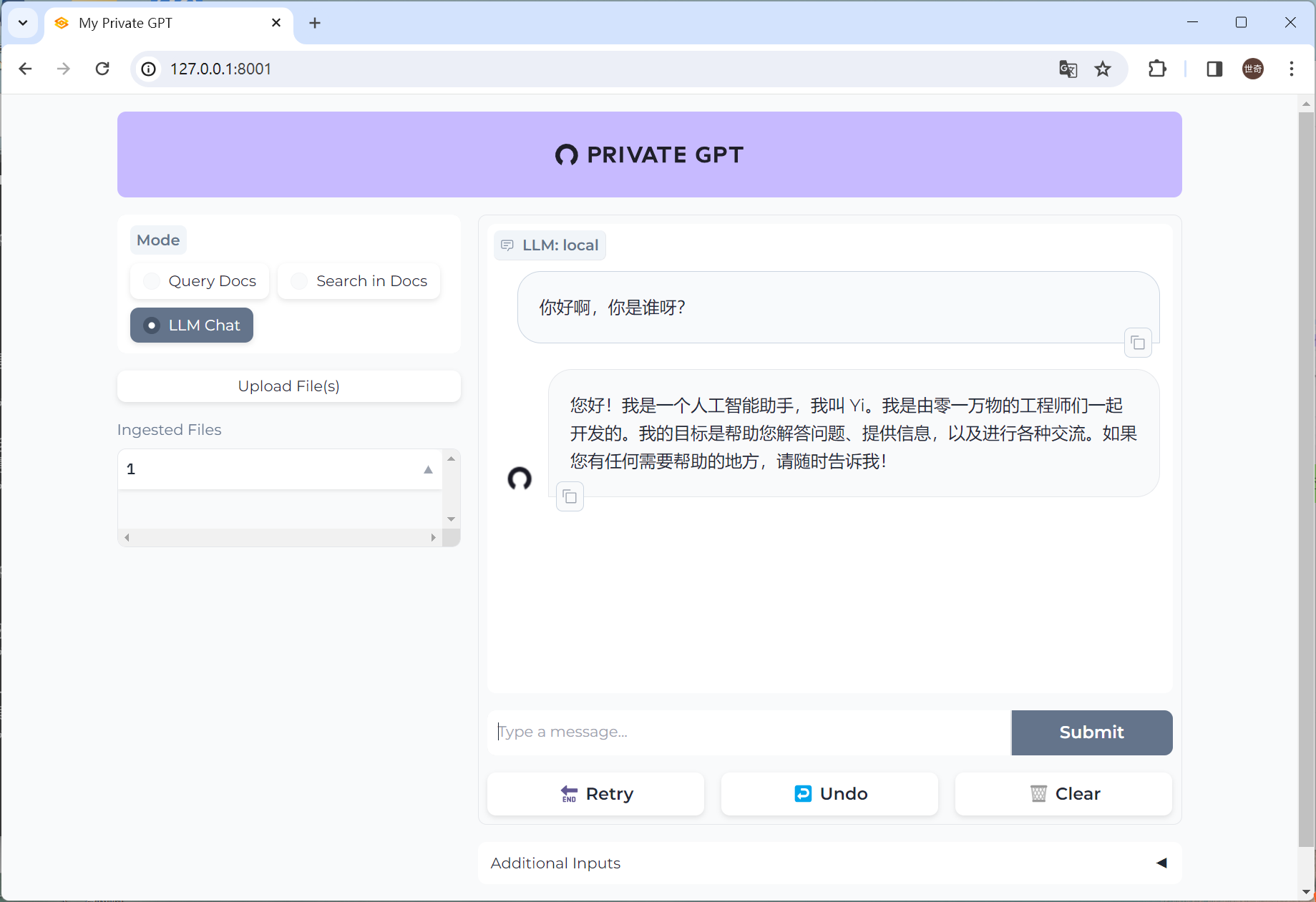

poetry run python -m private_gpt导航到 UI:在浏览器中打开 http://localhost:8001/。

创作不易,多多支持!

构建中国人自己的私人GPT—使用中文

http://jinshuangshi.com/forum.php?mod=viewthread&tid=135

(出处: 金双石科技)

3115

3115

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?