immich 自托管照片和视频管理 解决方案

immich 自托管照片和视频管理 解决方案

轻松在您自己的服务器上备份、组织和管理您的照片。Immich 可帮助您轻松浏览、搜索和整理您的照片和视频,而不会牺牲您的隐私。

分享持续更新中,有了最新版的也会继续分享在这里。

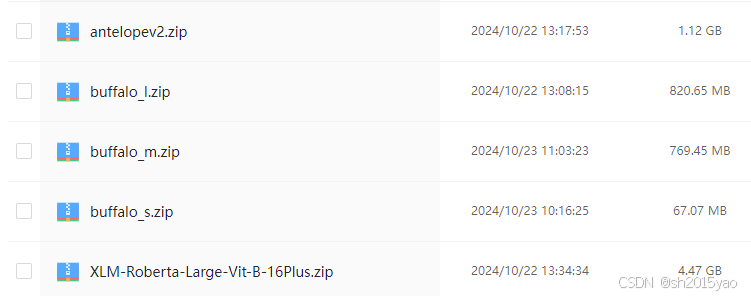

文字搜图,图片文本化大模型(2024-09-05):XLM-Roberta-Large-Vit-B-16Plus

人脸识别模型(2023-11-10):antelopev2

人脸识别模型(2023-11-10):buffalo_l

人脸识别模型(2023-11-10):buffalo_m

人脸识别模型(2023-11-10):buffalo_s

immich 机器学习模型下载 | XLM-Roberta-Large-Vit-B-16Plus | antelopev2 | buffalo_l

大家能搜到这里,说明大家已经安装好了,但是ai模型是需要联网下载的,因为不可抗力的因素下载不了,所以我写了这篇文章。

需要注意的是,你已经为ai模型的目录映射了假设为如下

/docker/immich/models:/cache

所以我的目录为 /docker/immich/models,之后要在此目录上添加文件夹和上传模型

mkdir /docker/immich/models/facial-recognition

mkdir /docker/immich/models/clipfacial-recognition 目录为人脸识别的模型的目录。

clip 目录为中文搜图的模型的目录。

immich 机器学习模型下载 | XLM-Roberta-Large-Vit-B-16Plus | antelopev2 | buffalo_l

直接把zip文件上传到对应的目录

/docker/immich/models/facial-recognition 目录上传 antelopev2.zip 或者 buffalo_l.zip 或者 buffalo_m.zip 或者 buffalo_s.zip,磁盘空间足够也可以全部上传(后台配置时,请选择你上传的)。

/docker/immich/models/clip 目录上传 XLM-Roberta-Large-Vit-B-16Plus.zip

zip包直接解压即可。zip包直接解压即可。zip包直接解压即可。

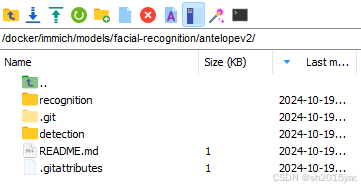

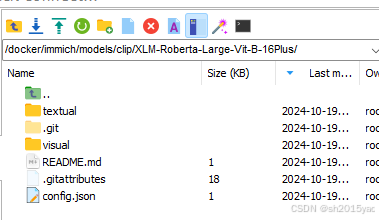

正确的目录为:

人脸识别:/docker/immich/models/facial-recognition/antelopev2 或者 /docker/immich/models/facial-recognition/buffalo_l

中文搜图:/docker/immich/models/clip/XLM-Roberta-Large-Vit-B-16Plus

至此全部OK。

下面是两个正确的截图:

有关于immich相关的问题大家可以私信给我。需要其它大模型的也可以私信给我。

417

417

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?