一、概率密度函数

说到概率密度函数(probability density function, PDF,后面用简写),肯定是针对连续型变量而言的。对于离散型变量,我们称之为分布律

对于概率密度函数,有这么几个性质:

设p是某个概率密度函数,则有:

• p 的定义域必须是 x 所有可能状态的集合。

• ∀x ∈ x, p(x) ≥ 0. 注意,我们并不要求 p(x) ≤ 1。(很重要)

•∫p(x)dx = 1.(归一化)

使用PDF计算概率时,其实质是用积分运算 p(x)δx,也很好理解。

二、独立性

- 若∀x ∈ x, y ∈ y, p(x = x, y = y) = p(x = x)p(y = y). 则称x,y相互独立

- 如果关于 x 和 y 的条件概率分布对于 z 的每一个值都可以写成乘积的形式,

那么这两个随机变量 x 和 y 在给定随机变量 z 时是 条件独立的

∀x ∈ x, y ∈ y, z ∈ z, p(x = x, y = y | z = z) = p(x = x | z = z)p(y = y | z = z)

另,我们可以采用一种简化形式来表示独立性和条件独立性:x⊥y 表示 x 和 y 相互

独立,x⊥y | z 表示 x 和 y 在给定 z 时条件独立。

三、期望、方差和协方差

- 期望是最简单的,简而言之就是平均值:

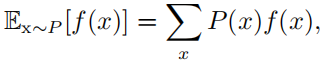

对于离散型随机变量:

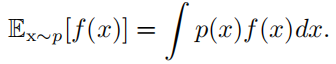

对于连续型随机变量:

- 方差,从定义出发,就能很好的记忆

方差(variance)衡量的是当我们对 x 依据它的概率分布进行采样时,随机变

量 x 的函数值会呈现多大的差异:

Var(f(x)) = E[(f(x) − E[f(x)])2] - 协方差应当是最不好理解的了

协方差(covariance)在某种意义上给出了两个变量线性相关性的强度以及这些

变量的尺度

Cov(f(x), g(y)) = E[(f(x) − E[f(x)])(g(y) − E[g(y)])].

协方差的绝对值如果很大则意味着变量值变化很大并且它们同时距离各自的均值很

远。如果协方差是正的,那么两个变量都倾向于同时取得相对较大的值。如果协方

差是负的,那么其中一个变量倾向于取得相对较大的值的同时,另一个变量倾向于

取得相对较小的值,反之亦然。

四、常用概率分布

非常之重要了。其实深度学习的前提假设都要求训练数据和测试数据相互独立,并且有相一致的分布,但是在使用的时候好像都忽略了这一点,然而在实践中对大多数有用。这也是深度学习缺乏理论依据的其中一个原因吧

- 伯努利分布(二项分布)

Bernoulli 分布(Bernoulli distribution)是单个二值随机变量的分布。它由单

个参数 ϕ ∈ [0, 1] 控制,ϕ 给出了随机变量等于 1 的概率。它具有如下的一些性质

P(x = 1) = ϕ

P(x = 0) = 1 − ϕ

P(x = x) = ϕx(1 − ϕ)1−x

Ex[x] = ϕ

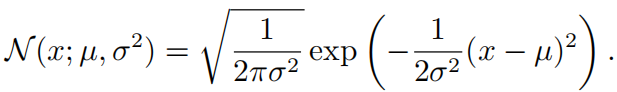

Varx(x) = ϕ(1 − ϕ) - 高斯分布(灰常重要了,用的特别多)

实数上最常用的分布就是 正态分布(normal distribution),也称为 高斯分布

采用正态分布在很多应用中都是一个明智的选择。当我们由于缺乏关于某个实

数上分布的先验知识而不知道该选择怎样的形式时,正态分布是默认的比较好的选

择,其中有两个原因:

第一,我们想要建模的很多分布的真实情况是比较接近正态分布的。 中心极限

定理(central limit theorem)说明很多独立随机变量的和近似服从正态分布。这意

味着在实际中,很多复杂系统都可以被成功地建模成正态分布的噪声,即使系统可

以被分解成一些更结构化的部分。

第二,在具有相同方差的所有可能的概率分布中,正态分布在实数上具有最大

的不确定性。因此,我们可以认为正态分布是对模型加入的先验知识量最少的分布。

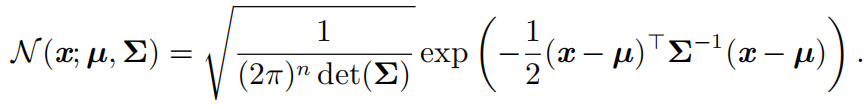

正态分布可以推广到 Rn 空间,这种情况下被称为 多维正态分布(multivariate

normal distribution)。它的参数是一个正定对称矩阵 Σ:

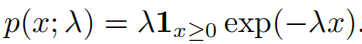

- 指数分布和 Laplace 分布

在深度学习中,我们经常会需要一个在 x = 0 点处取得边界点 (sharp point) 的

分布。为了实现这一目的,我们可以使用 指数分布(exponential distribution):

指数分布使用指示函数(indicator function)1x≥0 来使得当 x 取负值时的概率为零。

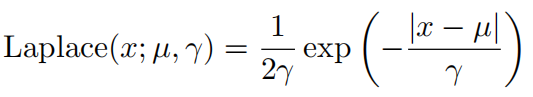

一个联系紧密的概率分布是 Laplace 分布(Laplace distribution),它允许我们

在任意一点 µ 处设置概率质量的峰值

五、若干有用函数

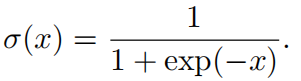

-

logistic sigmoid 函数

logistic sigmoid 函数通常用来产生 Bernoulli 分布中的参数 ϕ,因为它的范围是

(0, 1),处在 ϕ 的有效取值范围内 -

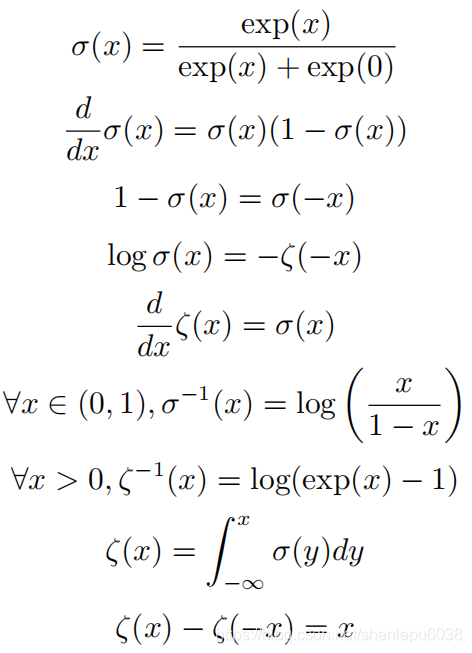

softplus 函数

ζ(x) = log(1 + exp(x)).

softplus 函数可以用来产生正态分布的 β 和 σ 参数,因为它的范围是 (0, ∞)。

对于上述两个函数,有这么几个性质,需要记忆:

六、贝叶斯规则

贝叶斯规则:已知 P(y | x) ,P(x)时计算 P(x | y)

P(x | y) = P(x)P(y | x) / P(y)

注意到 P(y) 出现在上面的公式中,它通常使用 P(y) = ∑x P(y | x)P(x) 来计算,

所以我们并不需要事先知道 P(y) 的信息

七、信息论

信息论的基本想法是一个不太可能的事件居然发生了,要比一个非常可能的事

件发生,能提供更多的信息。消息说:‘‘今天早上太阳升起’’ 信息量是如此之少以至

于没有必要发送,但一条消息说:‘‘今天早上有日食’’ 信息量就很丰富。

我们想要通过这种基本想法来量化信息。特别地,

• 非常可能发生的事件信息量要比较少,并且极端情况下,确保能够发生的事件

应该没有信息量。

• 较不可能发生的事件具有更高的信息量。

• 独立事件应具有增量的信息。例如,投掷的硬币两次正面朝上传递的信息量,

应该是投掷一次硬币正面朝上的信息量的两倍。

为了满足上述三个性质,我们定义一个事件 X = x 的 自信息(self-information)

为 I(x) = − log P(x)

自信息只处理单个的输出。我们可以用 香农熵(Shannon entropy)来对整个概

率分布中的不确定性总量进行量化:

H(x) = Ex∼P [I(x)] = −Ex∼P [log P(x)]

换言之,一个分布的香农熵是指遵循这个分布的事件所产生的期望信息总量

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?