学习深度学习的时候经常看到一个概念[感受野],下面介绍一下简单的理解。

感受野可以理解为,特征图上的点还原到输入的图上的范围。

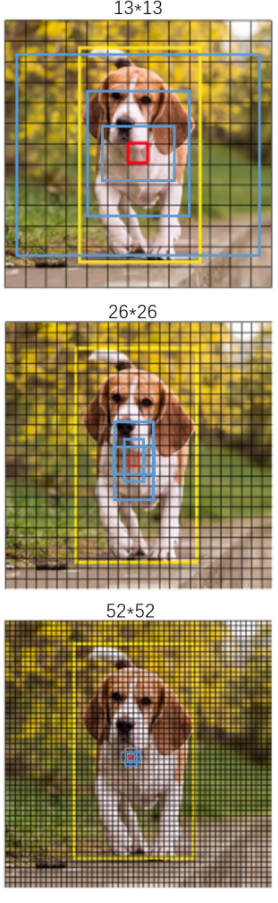

下图的感受野,逐渐变小,感受野大的的适合检测大目标,感受野小的适合检测小目标。

更简单的理解,三个图中的网格大小代表的就是感受野的大小,输入图像没变,特征图的深度变了,感受野变了。

图来自:YOLO系列解析

感受野简单理解

最新推荐文章于 2024-07-17 10:32:13 发布

学习深度学习的时候经常看到一个概念[感受野],下面介绍一下简单的理解。

感受野可以理解为,特征图上的点还原到输入的图上的范围。

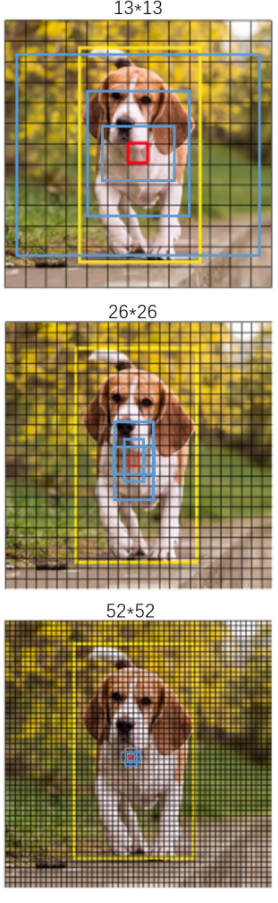

下图的感受野,逐渐变小,感受野大的的适合检测大目标,感受野小的适合检测小目标。

更简单的理解,三个图中的网格大小代表的就是感受野的大小,输入图像没变,特征图的深度变了,感受野变了。

图来自:YOLO系列解析

3万+

3万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?