- Linux权限的管理

1. Linux有两种用户:超级用户(root)和

普通用户

超级用户:在Linux下做任何事情,不受限制

普通用户:在Linux下做有限的事情

超级用户的命令提示符是“#”,普通用户的命令提示符是“$”

命令:su [用户名]

功能:切换用户

注: 从普通用户切换到root用户,此时系统会提示输入root用户的口令,从root切换到普通用户不需要口令

2.关于用户权限

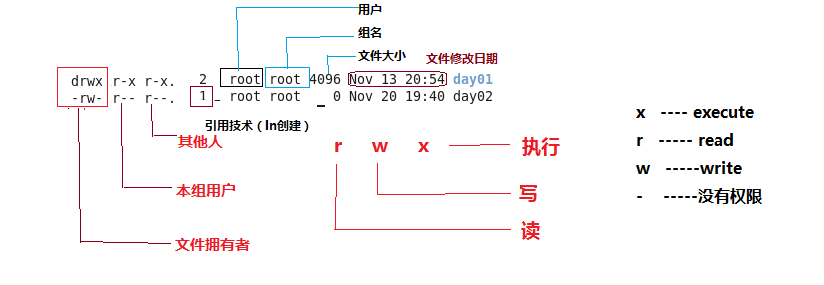

第1个字符:文件类型(d文件夹,-普通文件,l链接文件,b/s设备文件)

第2-10位字符:文件权限(r可读,w可写,x可执行)

2-4位:拥有者的权限

5-7位:同组人的权限

8-10: 其他人的权限

1)r(read):对于文件而言,具有读取文件内容的权限;对于目录来说,具有浏览该目录信息的权限

2)w(write):对于文件而言,具有修改文件内容的权限;对于目录来说,具有删除移动目录内文件的权限

3)x(execute):对于文件而言,具有执行文件的权限;对目录来说,具有进入目录的权限

4)- :表示不具有该权限

3.文件权限的表示方法

1)字符表示法

2)8进制数值表示法

问题:

进入目录需要哪些权限, 在目录中执行增删查(cd, touch, ls, rm, mv等)改文件动作, 需要哪些权限.

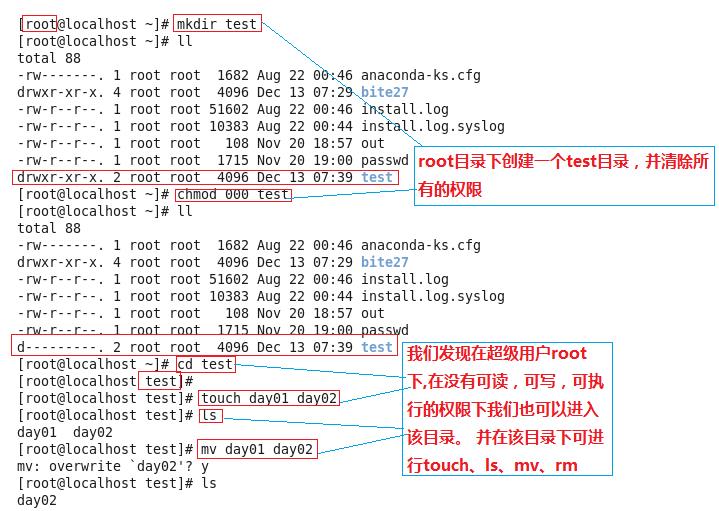

在超级用户(root)下:

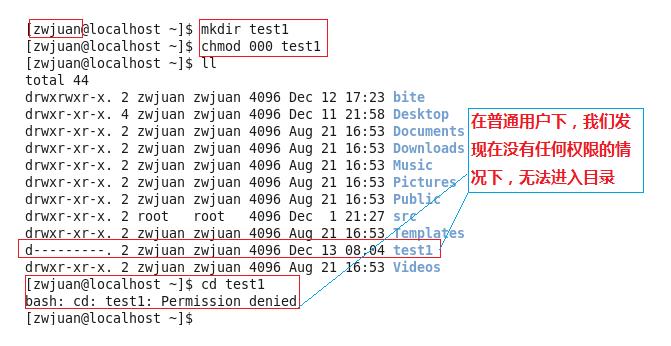

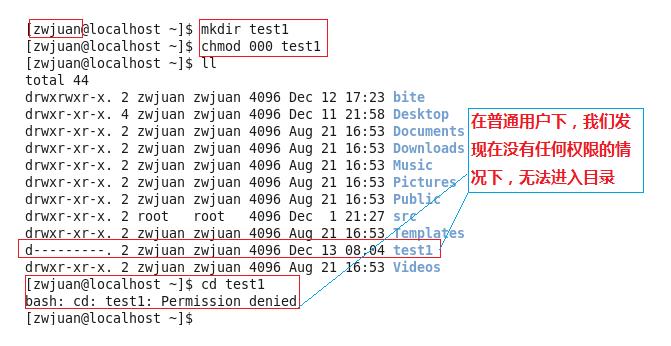

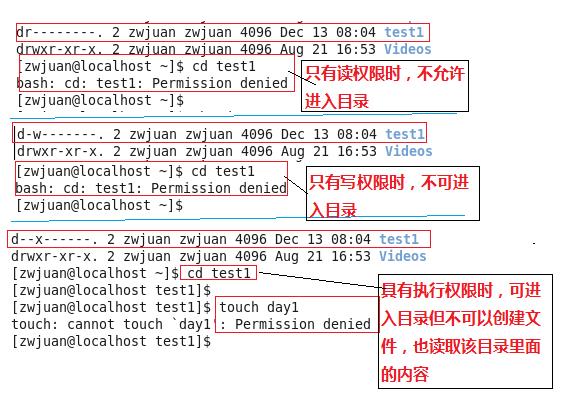

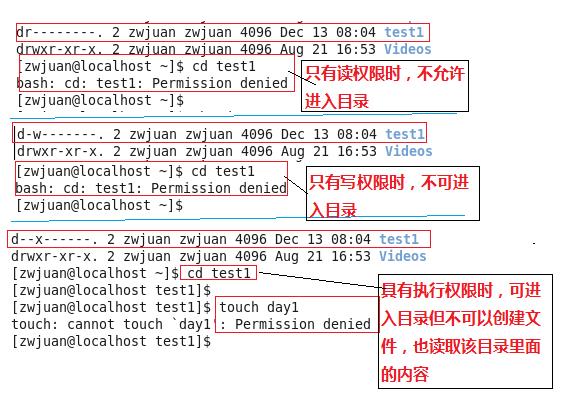

在普通用户下,我们同样创建一个test1目录,并清除所用权限

我们依次增加读、写、执行权限,发现当有执行权限时,才可进入目录

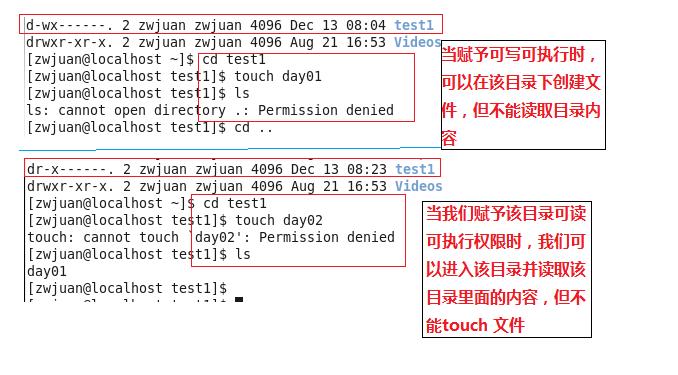

在只有可执行权限时,该目录可以进入,但是不能读取该目录里面的内容,同时也不能touch文件

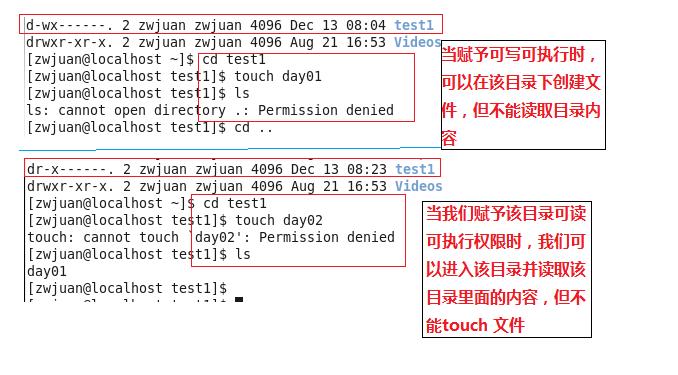

当我们赋予该目录可读可执行权限时,我们可以进入该目录并读取该目录里面的内容,但不能touch 文件

当赋予可写可执行时,可以在该目录下创建文件,但不能读取目录内容

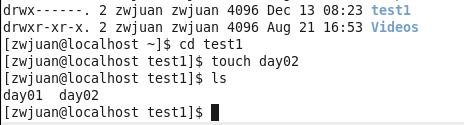

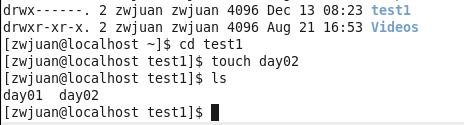

我们发现在可读可写可执行的权限下,我们可以在目录test1中创建文件day2,并且我们可以读取目录中的内容。

总结:在Linux的超级用户下,没有可读可写可执行的权限我们可以创建目录,进入目录,在目录中创建文件,读 取文件,在普通用户下,我们在没有任何权限的情况下无法进去该目录,在可执行的权限下可以进入该目录,但是我们无法读取该目录中的内容,在可读可执行的权限下我们可以进入该目录,也可以读取该目录中的内容,但是不能在该目录中创建文件,在可写可执行的权限下,我们可以在目录中创建文件但是不能读取,在可读可写可执行的情况下我们可以在该目录中创建文件并且可以读取。

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?