一直没搞懂神经网络到底是个什么玩意,今天看了斯坦福的深度学习基础教程才算知道神经网络的那个经典的三层结构。以下是原文:

以监督学习为例,假设我们有训练样本集

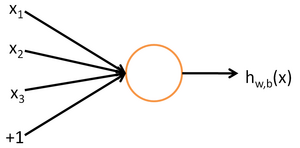

为了描述神经网络,我们先从最简单的神经网络讲起,这个神经网络仅由一个“神经元”构成,以下即是这个“神经元”的图示:

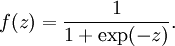

这个“神经元”是一个以

可以看出,这个单一“神经元”的输入-输出映射关系其实就是一个逻辑回归(logistic regression)。

虽然本系列教程采用sigmoid函数,但你也可以选择双曲正切函数(tanh):

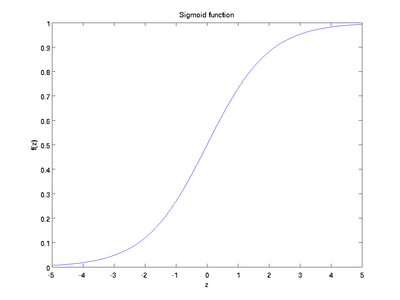

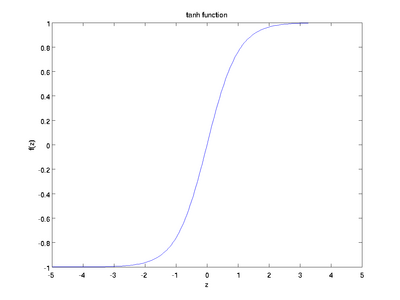

以下分别是sigmoid及tanh的函数图像:

tanh(z) 函数是sigmoid函数的一种变体,它的取值范围为[-1,1] ,而不是sigmoid函数的[0,1] 。

注意,与其它地方(包括OpenClassroom公开课以及斯坦福大学CS229课程)不同的是,这里我们不再令x_0=1 。取而代之,我们用单独的参数 b来表示截距。

最后要说明的是,有一个等式我们以后会经常用到:如

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?