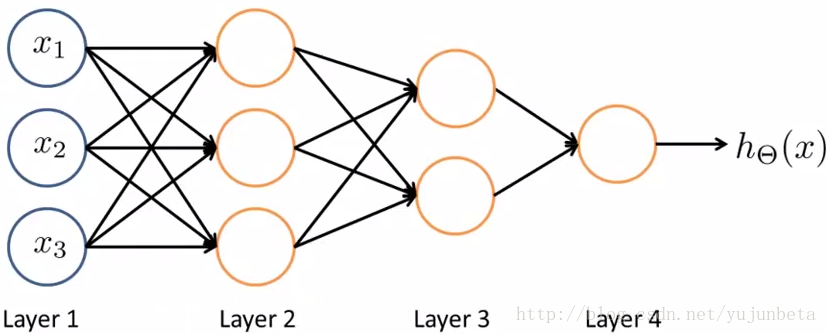

人工神经网络(ANN),简称神经网络,是一种模仿生物神经网络的结构和功能的数学模型或计算模型。神经网络由大量的人工神经元联结进行计算。大多数情况下人工神经网络能在外界信息的基础上改变内部结构,是一种自适应系统。现代神经网络是一种非线性统计性数据建模工具,常用来对输入和输出间复杂的关系进行建模,或用来探索数据的模式。

人工神经网络从以下四个方面去模拟人的智能行为:

- 物理结构:人工神经元将模拟生物神经元的功能

- 计算模拟:人脑的神经元有局部计算和存储的功能,通过连接构成一个系统。人工神经网络中也有大量有局部处理能力的神经元,也能够将信息进行大规模并行处理

- 存储与操作:人脑和人工神经网络都是通过神经元的连接强度来实现记忆存储功能,同时为概括、类比、推广提供有力的支持

- 训练:同人脑一样,人工神经网络将根据自己的结构特性,使用不同的训练、学习过程,自动从实践中获得相关知识

神经网络是一种运算模型,由大量的节点(或称“神经元”,或“单元”)和之间相互联接构成。每个节点代表一种特定的输出函数,称为激励函数。每两个节点间的连接都代表一个对于通过该连接信号的加权值,称之为权重,这相当于人工神经网络的记忆。网络的输出则依网络的连接方式,权重值和激励函数的不同而不同。而网络自身通常都是对自然界某种算法或者函数的逼近,也可能是对一种逻辑策略的表达。

一、感知器

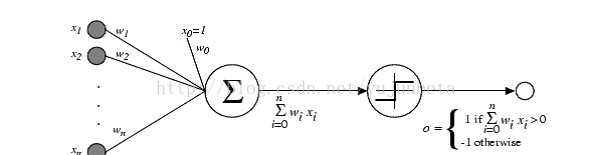

感知器相当于神经网络的一个单层,由一个线性组合器和一个二值阈值原件构成:

构成ANN系统的单层感知器:

- 感知器以一个实数值向量作为输入,计算这些输入的线性组合,如果结果大于某个阈值,就输出1,否则输出‐1。

- 感知器函数可写为:sign(w*x)有时可加入偏置b,写为sign(w*x b)

- 学习一个感知器意味着选择权w0,…,wn的值。所以感知器学习要考虑的候选假设空间H就是所有可能的实数值权向量的集合

算法训练步骤:

1、定义变量与参数x(输入向量),w(权值向量),b(偏置),y(实际输出),d(期望输出),a(学习率参数)

2、初始化,n=0,w=0

3、输入训练样本,对每个训练样本指定其期望输出:A类记为1,B类记为-1

4、计算实际输出y=sign(w*x b)

5、更新权值向量w(n 1)=w(n) a[d-y(n)]*x(n),0<a<1

6、判断,若满足收敛条件,算法结束,否则返回3

注意,其中学习率a为了权值的稳定性不应过大,为了体现误差对权值的修正不应过小,说到底,这是个经验问题。

从前面的叙述来看,感知器对于线性可分的例子是一定收敛的,对于不可分问题,它没法实现正确分类。这里与我们前面讲到的支持向量机的想法十分的相近,只是确定分类直线的办法有所不同。可以这么说,对于线性可分的例子,支持向量机找到了“最优的”那条分类直线,而单层感知器找到了一条可行的直线。

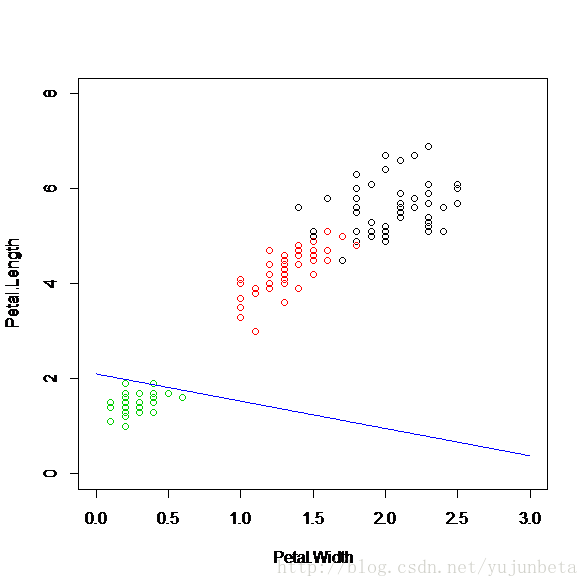

我们以鸢尾花数据集为例,由于单层感知器是一个二分类器,所以我们将鸢尾花数据也分为两类,“setosa”与“versicolor”(将后两类均看做第2类),那么数据按照特征:花瓣长度与宽度做分类。

运行下面的代码:

[plain] view plaincopyprint?

- #感知器训练结果:

- a<-0.2

- w<-rep(0,3)

- iris1<-t(as.matrix(iris[,3:4]))

- d<-c(rep(0,50),rep(1,100))

- e<-rep(0,150)

- p<-rbind(rep(1,150),iris1)

- max<-100000

- eps<-rep(0,100000)

- i<-0

- repeat{

- v<-w%*%p;

- y<-ifelse(sign(v)>=0,1,0);

- e<-d-y;

- eps[i 1]<-sum(abs(e))/length(e)

- if(eps[i 1]<0.01){

- print(“finish:”);

- print(w);

- break;

- }

- w<-w a*(d-y)%*%t(p);

- i<-i 1;

- if(i>max){

- print(“max time loop”);

- print(eps[i])

- print(y);

- break;

- }

- }

- #绘图程序

- plot(Petal.Length~Petal.Width,xlim=c(0,3),ylim=c(0,8),

- data=iris[iris$Species=="virginica",])

- data1<-iris[iris$Species=="versicolor",]

- points(data1$Petal.Width,data1$Petal.Length,col=2)

- data2<-iris[iris$Species=="setosa",]

- points(data2$Petal.Width,data2$Petal.Length,col=3)

- x<-seq(0,3,0.01)

- y<-x*(-w[2]/w[3])-w[1]/w[3]

- lines(x,y,col=4)

- #绘制每次迭代的平均绝对误差

- plot(1:i,eps[1:i],type=”o”)

分类结果如图:

这是运行了7次得到的结果。与我们前面的支持向量机相比,显然神经网络的单层感知器分类不是那么的可信,有些弱。

我们可以尝试来做交叉验证,可以发现交叉验证结果并不理想。

二、线性神经网络

尽管当训练样例线性可分时,感知器法则可以成功地找到一个权向量,但如果样例不是线性可分时它将不能收敛。因此,人们设计了另一个训练法则来克服这个不足,称为delta法则。

如果训练样本不是线性可分的,那么delta法则会收敛到目标概念的最佳近似。

delta法则的关键思想是使用梯度下降来搜索可能权向量的假设空间,以找到最佳拟合训练样例的权向量。

我们将算法描述如下:

本文详细介绍了神经网络的基础知识,包括感知器、线性神经网络、BP神经网络及其训练算法,如SIGMOID函数、最速下降法等。通过鸢尾花数据集展示了神经网络的实现过程,并与支持向量机进行了比较。文章还讨论了R语言中神经网络函数的使用,以及在手写数字识别案例中的应用。

本文详细介绍了神经网络的基础知识,包括感知器、线性神经网络、BP神经网络及其训练算法,如SIGMOID函数、最速下降法等。通过鸢尾花数据集展示了神经网络的实现过程,并与支持向量机进行了比较。文章还讨论了R语言中神经网络函数的使用,以及在手写数字识别案例中的应用。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?