LR模型属于广义线性模型,将特征空间映射成一种可能性。

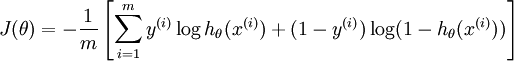

损失函数:

逻辑回归函数:

算法流程:

代码实现:

设置迭代次数为500次,每次迭代,对每个训练文本都更新一次w

预测的方法是:先将训练文本与w相乘得到z,再判断g(z)是否大于等于0.5

(在PLA的代码基础上进行修改就可以得到LR)

数据集格式为:第一行为58个属性名称,最后一个是分享值(0或1),接下来n行是训练数据集,再继续来m行是预测数据集,其share值为空。需要求出预测数据集的share预测值。

<span style="font-size:14px;">#include<bits/stdc++.h>

#define rate 0.01

#define line_train 27751

#define line_test 11893

#define item_num 58

#define inf 1000000

using namespace std;

int line = line_train + line_test;

struct TEXT{

vector <double>feature;

int shares;

}text[40000];

void input()

{

string str;

double data;

ifstream fin("Datac_all.csv");

getline(fin, str);

for(int i=0;i<line;i++){

getline(fin, str);

istringstream ss(str);

vector<double> tmp;

while (!ss.eof()){

ss >> data; //忽略逗号

ss.ignore(str.size(), ',');

text[i].feature.push_back(data);

}

if(i<line_train){

text[i].shares = data;

}

}

fin.close();

cout << "Read done.\n";

}

void normalization(){

double MAX, MIN;

for(int i = 0; i < item_num; i++){

MAX = 0;

MIN = inf;

//求出Max-Min

for(int j=0;j<line;j++){

if(text[j].feature[i] > MAX)

MAX = text[j].feature[i];

if(text[j].feature[i] < MIN)

MIN = text[j].feature[i];

}

//归一化

for(int j = 0; j < line; j++){

if((MAX - MIN)!= 0)

text[j].feature[i] = (text[j].feature[i] - MIN) / (MAX - MIN);

else

text[j].feature[i] = 0;

}

}

}

double g(double z){

return 1.0/(1.0 + exp(-z));

}

double XW(vector<double> w, int i){

double A = w[0]*1.0;

for(int j = 1; j <= item_num; j++)

A += (double)w[j]*text[i].feature[j-1];

return A;

}

vector<double> new_w(vector<double> w, int index){//更新

vector<double> xe(item_num+1, 0);

double A = XW(w, index);

double err = text[index].shares - g(A);

w[0] += 1.0*rate*err;

for(int i = 1; i <= item_num; i++)

w[i] += rate * err * text[index].feature[i-1];

return w;

}

void print(vector<double> w){

for(int i = 0; i <= item_num; i++)

cout << w[i] << " ";

cout << endl << endl;

}

void LR(){

int DDL = 150;

vector<double> w(item_num+1, 1);

while(DDL--){ //迭代

for(int i = 0; i < line_train; i++){

w = new_w(w, i); //更新

}

}

print(w);

ofstream predict("LR.txt");

for(int i = line_train; i < line; i++){

double temp = XW(w, i); //预测

predict << (g(temp)>=0.5) << endl;

}

}

int main(){

input();

normalization();

LR();

cout << "Predict done" << endl;

return 0;

}</span>

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?