HDFS的安装准备环境

java 环境

sudo apt-get update

sudo apt-get install openjdk-8-jdk

添加java环境变量

在/etc/profile 文件中进行编辑

$ sudo vim /etc/profile

# 如果使用oracle java

export JAVA_HOME="/usr/lib/jvm/java-8-oracle/jre/bin"

# 如果使用openjdk

export JAVA_HOME="/usr/lib/jvm/java-8-openjdk-amd64/jre/bin"

hadoop安装

-

下载hadoop安装包

wget http://mirrors.shu.edu.cn/apache/hadoop/common/hadoop-2.7.7/hadoop-2.7.7.tar.gz -

解压

tar -zvxf hadoop-2.7.7.tar.gz

添加hadoop的环境变量

export HADOOP_HOME=/disk/Hadoop/hadoop-2.7.7

export PATH=$PATH:$HADOOP_HOME/bin:$HADOOP_HOME/sbin

设置ssh免密方式

参考地址: https://blog.csdn.net/nmjhehe/article/details/81050713

这里如果采用非root的时候最后是master 和 slave node都设置一样的用户名

配置Haddop

-

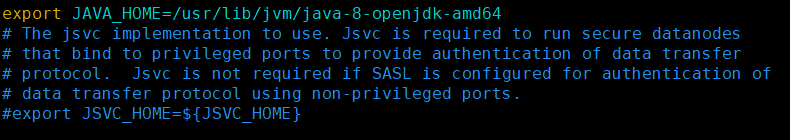

在hadoop-env.sh 设置java 目录

-

在core-site.xml 配置

-

在hdfs-site.xml配置

对于分布式要将relication 设置大于1的值, 不然在网页端就看不到datanode节点。

将配置好的整个hadoop目录拷贝到各个节点(各个节点安装好相同的java环境)

格式化

hadoop namenode -format

启动

start-all.sh

网页界面

python hdfs

这里在使用的时候注意要配置/etc/hosts

否则会出现找不到子节点的情况, 从而造成找不到节点的情况

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?