来源:知乎

本文带你了解并区分常用的Normalization。

Batch Normalization(BN,2015年)

Layer Normalization(LN,2016年)

Instance Normalization(IN,2017年)

Group Normalization(GN,2018年)

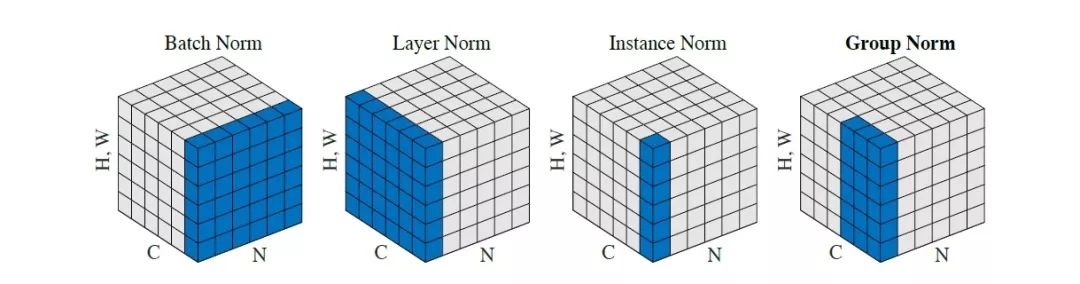

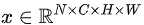

我们将输入的 feature map shape 记为[N, C, H, W],其中N表示batch size,即N个样本;C表示通道数;H、W分别表示特征图的高度、宽度。这几个方法主要的区别就是在:

BN是在batch上,对N、H、W做归一化,而保留通道 C 的维度。BN对较小的batch size效果不好。BN适用于固定深度的前向神经网络,如CNN,不适用于RNN;

LN在通道方向上,对C、H、W归一化,主要对RNN效果明显;

IN在图像像素上,对H、W做归一化,用在风格化迁移;

-

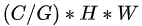

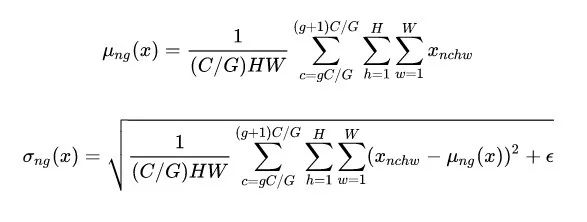

GN将channel分组,然后再做归一化。

如果把特征图 比喻成一摞书,这摞书总共有 N 本,每本有 C 页,每页有 H 行,每行 有W 个字符。

比喻成一摞书,这摞书总共有 N 本,每本有 C 页,每页有 H 行,每行 有W 个字符。

BN 求均值时,相当于把这些书按页码一一对应地加起来(例如第1本书第36页,第2本书第36页......),再除以每个页码下的字符总数:N×H×W,因此可以把 BN 看成求“平均书”的操作(注意这个“平均书”每页只有一个字),求标准差时也是同理。

LN 求均值时,相当于把每一本书的所有字加起来,再除以这本书的字符总数:C×H×W,即求整本书的“平均字”,求标准差时也是同理。

IN 求均值时,相当于把一页书中所有字加起来,再除以该页的总字数:H×W,即求每页书的“平均字”,求标准差时也是同理。

GN 相当于把一本 C 页的书平均分成 G 份,每份成为有 C/G 页的小册子,求每个小册子的“平均字”和字的“标准差”。

一、 Batch Normalization, BN (‘重点、重点、重点’,重要的事情说三遍)

为什么要进行BN呢?

在深度神经网络训练的过程中,通常以输入网络的每一个mini-batch进行训练,这样每个batch具有不同的分布,使模型训练起来特别困难。

Internal Covariate Shift (ICS) 问题:在训练的过程中,激活函数会改变各层数据的分布,随着网络的加深,这种改变(差异)会越来越大,使模型训练起来特别困难,收敛速度很慢,会出现梯度消失的问题。

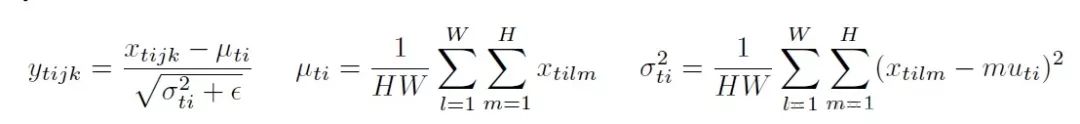

BN的主要思想:针对每个神经元,使数据在进入激活函数之前,沿着通道计算每个batch的均值、方差,‘强迫’数据保持均值为0,方差为1的正态分布,避免发生梯度消失。具体来说,就是把第1个样本的第1个通道,加上第2个样本第1个通道 ...... 加上第 N 个样本第1个通道,求平均,得到通道 1 的均值(注意是除以 N×H×W 而不是单纯除以 N,最后得到的是一个代表这个 batch 第1个通道平均值的数字,而不是一个 H×W 的矩阵)。求通道 1 的方差也是同理。对所有通道都施加一遍这个操作,就得到了所有通道的均值和方差。

BN的使用位置:全连接层或卷积操作之后,激活函数之前。

BN算法过程:

-

沿着通道计算每个batch的均值μ

-

沿着通道计算每个batch的方差σ²

-

做归一化

-

加入缩放和平移变量 γ 和 β

。

加入缩放和平移变量的原因是:

保证每一次数据经过归一化后还保留原有学习来的特征,同时又能完成归一化操作,加速训练。

这两个参数是用来学习的参数。

。

加入缩放和平移变量的原因是:

保证每一次数据经过归一化后还保留原有学习来的特征,同时又能完成归一化操作,加速训练。

这两个参数是用来学习的参数。

允许较大的学习率;

减弱对初始化的强依赖性;

保持隐藏层中数值的均值、方差不变,让数值更稳定,为后面网络提供坚实的基础;

有轻微的正则化作用(相当于给隐藏层加入噪声,类似Dropout)。

每次是在一个batch上计算均值、方差,如果batch size太小,则计算的均值、方差不足以代表整个数据分布。

batch size太大:

会超过内存容量;

需要跑更多的epoch,导致总训练时间变长;

会直接固定梯度下降的方向,导致很难更新。

论文链接:

https://arxiv.org/pdf/1607.06450v1.pdf

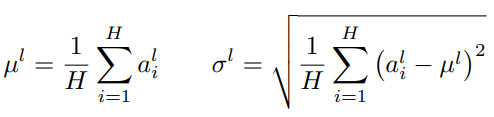

,LN 对每个样本的 C、H、W 维度上的数据求均值和标准差,保留 N 维度。

其均值和标准差公式为:

,LN 对每个样本的 C、H、W 维度上的数据求均值和标准差,保留 N 维度。

其均值和标准差公式为:

论文链接:https://arxiv.org/pdf/1607.08022.pdf

论文链接:https://arxiv.org/pdf/1803.08494.pdf

的均值和方差,这样就与batch size无关,不受其约束。

的均值和方差,这样就与batch size无关,不受其约束。

def GroupNorm(x, gamma, beta, G=16):

# x_shape:[N, C, H, W]

results = 0.

eps = 1e-5

x = np.reshape(x, (x.shape[0], G, x.shape[1]/16, x.shape[2], x.shape[3]))

x_mean = np.mean(x, axis=(2, 3, 4), keepdims=True)

x_var = np.var(x, axis=(2, 3, 4), keepdims=True0)

x_normalized = (x - x_mean) / np.sqrt(x_var + eps)

results = gamma * x_normalized + beta

return results

比喻成一摞书,这摞书总共有 N 本,每本有 C 页,每页有 H 行,每行 有W 个字符。

比喻成一摞书,这摞书总共有 N 本,每本有 C 页,每页有 H 行,每行 有W 个字符。

BN是在batch上,对N、H、W做归一化,而保留通道 C 的维度。BN 相当于把这些书按页码一一对应地加起来,再除以每个页码下的字符总数:N×H×W。

LN在通道方向上,对C、H、W归一化。LN 相当于把每一本书的所有字加起来,再除以这本书的字符总数:C×H×W。

IN在图像像素上,对H、W做归一化。IN 相当于把一页书中所有字加起来,再除以该页的总字数:H×W。

GN将channel分组,然后再做归一化。GN 相当于把一本 C 页的书平均分成 G 份,每份成为有 C/G 页的小册子,对每个小册子做Norm。

本文转自知乎作者G-kdom文章:常用的 Normalization 方法:BN、LN、IN、GN。

文章地址:

https://zhuanlan.zhihu.com/p/72589565

编辑:于腾凯

校对:林亦霖

1339

1339

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?