作者:Ketan Doshi

翻译:欧阳锦校对:和中华

本文约3800字,建议阅读10分钟本文通过可视化的方式清晰地展示了Transformer的工作本质,并从本质中探索了它具有优良表现的原因。

关键字:注意力机制 Transformer NLP

图源自Olav Ahrens Røtne

在过去的几年里,Transformers席卷了NLP 的世界。现在,它们也成功地用于NLP 以外的技术中。

由于注意力(Attention)模块,Transformer 从中受益良多,而这一切都是因为注意力模块捕获了序列中每个单词与每个其他单词之间的关系。

然而,最重要的问题是transformer究竟是如何做到这一点的?

在本文中,我们将尝试回答这个问题,并理解为什么它要执行它所做的计算。

本文作者在关于transformer的系列文章中还有几篇文章。在那些文章中,我们了解了 Transformer架构,并逐步了解了它们在训练和推理过程中所进行的操作。我们还探索了其背后的理论细节,并准确了解了它们的工作原理。

1. 功能概述(如何使用 Transformer,以及为什么它们比RNN 更好。该架构的组件,以及训练和推理期间的行为。)

https://towardsdatascience.com/transformers-explained-visually-part-1-overview-of-functionality-95a6dd460452

2. 工作原理(端到端的内部操作。数据如何流动以及执行哪些计算,其中包括矩阵表示。)

https://towardsdatascience.com/transformers-explained-visually-part-2-how-it-works-step-by-step-b49fa4a64f34

3. 多头注意力(整个Transformer中注意力模块的内部工作原理。)

https://towardsdatascience.com/transformers-explained-visually-part-3-multi-head-attention-deep-dive-1c1ff1024853

如果你对一般的 NLP 应用感兴趣,这里还有一些你可能喜欢的其他文章。

1. 集束搜索(在Speech-to-Text 和 NLP 应用中常用于增强预测的算法)

https://towardsdatascience.com/foundations-of-nlp-explained-visually-beam-search-how-it-works-1586b9849a24

2. Bleu分数(Bleu Score 和 Word Error Rate 是 NLP 模型的两个基本指标)

https://towardsdatascience.com/foundations-of-nlp-explained-bleu-score-and-wer-metrics-1a5ba06d812b

要了解是什么让Transformer得以工作,我们必须关注注意力机制。让我们从它的输入开始,看看它如何处理这个输入。

输入序列如何到达注意力模块

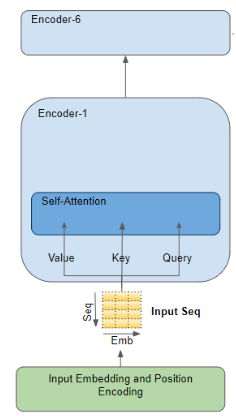

注意力模块存在于编码器堆栈中的每个编码器中,以及解码器堆栈中的每个解码器中。我们将首先来看看编码器的注意力机制。

编码器中的Attention机制(图源自作者)

例如,假设我们正在解决英语到西班牙语

本文深入探讨Transformer的工作原理,尤其是其注意力机制如何捕获序列中单词之间的关系。通过可视化解释,揭示Transformer如何通过点积计算单词间的相关性,学习并调整词向量以优化注意力得分。同时,介绍了Transformer在编码器和解码器中的自注意力机制以及编码-解码注意力机制。

本文深入探讨Transformer的工作原理,尤其是其注意力机制如何捕获序列中单词之间的关系。通过可视化解释,揭示Transformer如何通过点积计算单词间的相关性,学习并调整词向量以优化注意力得分。同时,介绍了Transformer在编码器和解码器中的自注意力机制以及编码-解码注意力机制。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?