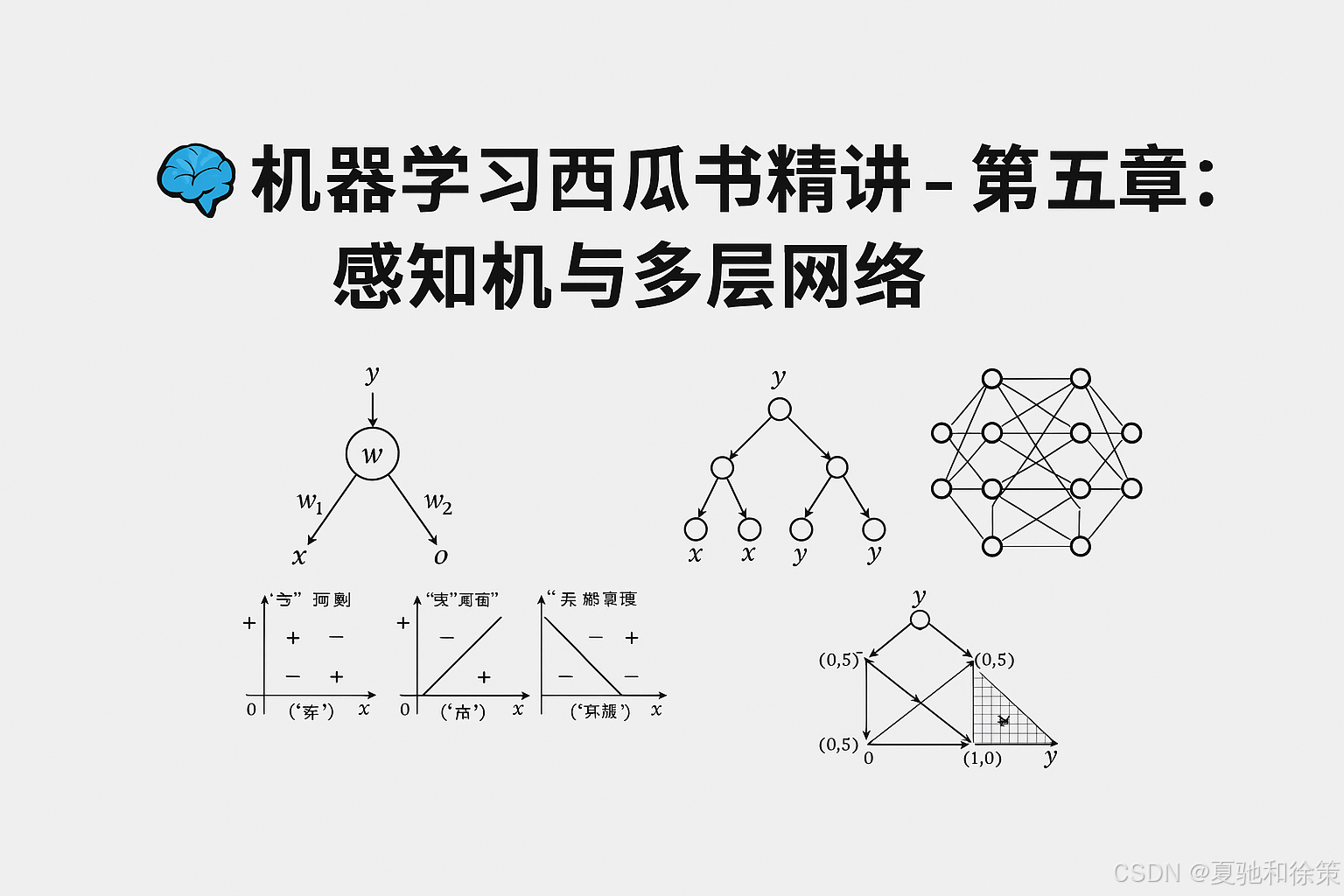

🧠 机器学习西瓜书精讲 - 第五章:感知机与多层网络

“与其说感知机是解决问题的工具,不如说它是我们理解神经网络的起点。”

—— 来自一个西瓜书读者的感慨

📌 5.2 感知机与多层网络

在进入深层神经网络的学习之前,我们必须从最基础的结构 —— 感知机(Perceptron)出发。感知机是最早的神经元模型之一,它模拟了人脑神经元“接受信号 → 加权 → 激活”的基本处理过程。

🧩 单层感知机结构

一个标准的感知机由两层神经元组成:输入层和输出层。输入层接收特征信号,输出层通过权重计算并使用激活函数输出分类结果。其结构如图所示:

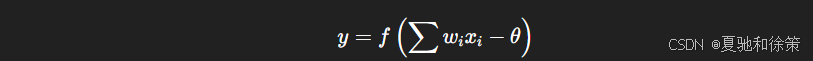

输出计算公式如下:

其中,ff 通常为阶跃激活函数(如图 5.2(a)),即当输入大于阈值 θ\theta 时输出为 1,否则为 0。

✅ 感知机如何实现逻辑函数

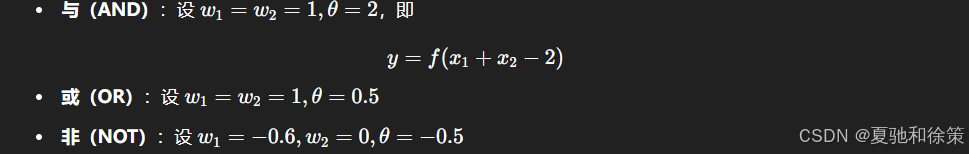

感知机可以轻松实现逻辑运算,如:

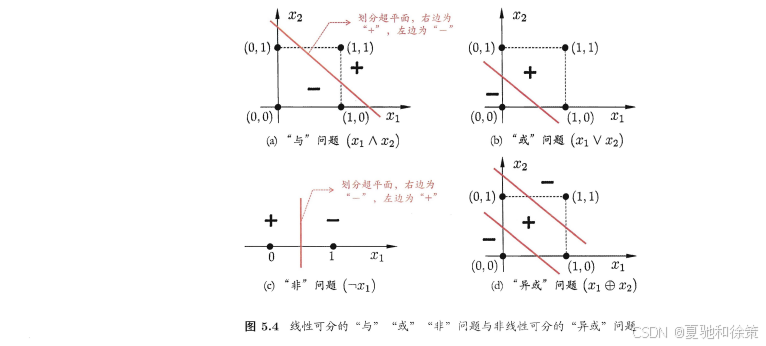

这些逻辑结构的几何解释是:它们都能通过一条线性超平面划分样本空间(见图 5.4(a)-(c))。

⚠️ 感知机的局限:非线性可分问题

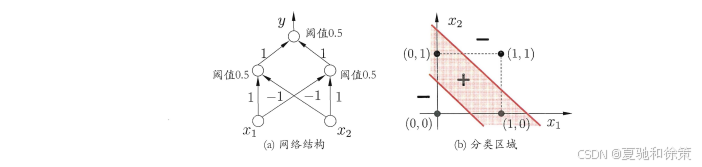

然而感知机有一个致命的限制:无法解决非线性可分问题,例如“异或(XOR)”问题。如下图所示,XOR 无法用一条直线将正负样本分开:

即使训练多轮,感知机的权重也会在错误修正中反复震荡,无法收敛。

🏗️ 使用多层感知机解决 XOR 问题

为了突破线性可分的限制,我们引入 多层感知机(Multi-Layer Perceptron, MLP)。最简单的结构是三层网络:输入层 → 隐含层(hidden layer) → 输出层。

在图中,两个隐层神经元首先将输入映射到新的空间,再由输出层组合这两个结果,实现对 XOR 的正确分类。

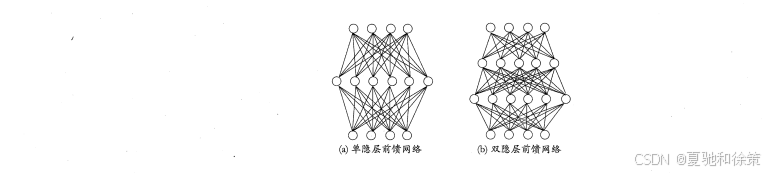

🧬 多层前馈神经网络(MLP)

更广义地,神经网络的标准结构为多层前馈神经网络(Multi-layer Feedforward Neural Networks)。其特点包括:

-

每层神经元只与下一层全连接;

-

层间无回环,称为前馈结构;

-

隐含层和输出层包含激活函数。

这种结构强大而通用,是现代神经网络的基础。每条连接的权值和每个神经元的阈值共同构成网络“记忆”的载体。

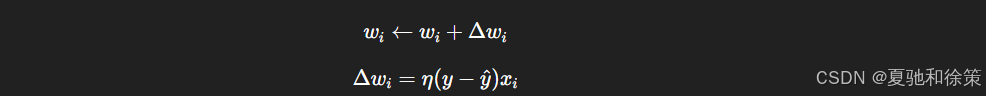

📘 感知机学习规则简述

感知机的权重更新规则如下:

其中:

-

η\eta 是学习率;

-

yy 是真实标签;

-

y^\hat{y} 是模型预测结果。

若预测正确则不更新,预测错误则按错误程度进行修正。

🎯 总结:从感知机迈向深度网络

-

感知机是最基础的神经网络结构,适合解决线性可分问题;

-

为解决更复杂的问题,需引入多层结构;

-

多层前馈神经网络可通过引入隐藏层,实现任意复杂的非线性函数逼近;

-

下一节将进一步讲解多层网络的训练方式 —— 误差逆传播算法(BP)。

下节预告:误差逆传播(BackPropagation),揭开深度学习的训练秘密!

如果你喜欢这样的精讲,欢迎收藏、点赞并关注本专栏📚。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?