内容概要

随着人工智能技术的快速发展,模型的规模和复杂性逐渐增加,这导致了对计算资源的需求急剧上升。因此,模型压缩和优化策略变得尤为重要。本文旨在探索模型压缩技术与优化策略在提升AI模型效率与性能方面的巨大潜力。

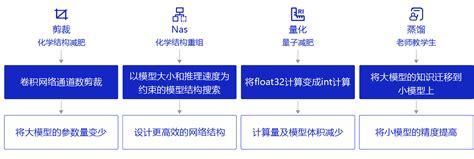

首先,模型压缩技术通过剪枝、量化和蒸馏等手段,显著降低了模型的存储空间和计算需求。其次,优化策略则通过参数调整和架构改进,提升了模型在实际应用中的表现。以下表格总结了几种主要的模型压缩技术及其适用场景:

| 技术 | 描述 | 适用场景 |

|---|---|---|

| 剪枝 | 移除冗余神经元或连接 | 大规模深度学习模型 |

| 量化 | 使用更小的数据类型表示参数 | 资源有限的嵌入式设备 |

| 蒸馏 | 使用大型预训练模型指导小型学生模型学习 | 较小服务端或移动端执行 |

这些方法不仅能够提高运行效率,还能显著减少资源消耗,为研究者和开发者提供了一系列切实可行的解决方案。在后续部分中,将进一步分析各个技术对于提升效率与性能的重要性,以及它们在处理复杂应用时面临的挑战。

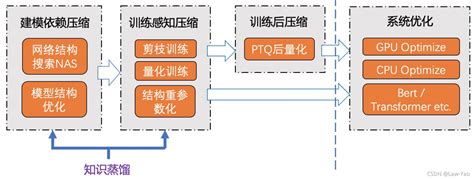

模型压缩技术概述

模型压缩技术是提升人工智能模型在多种应用场景下效率与性能的一种有效手段。随着深度学习模型的复杂性和规模不断增加,传统方法在计算和存储资源上的需求也逐渐上升,这给部署和实际应用带来了挑战。通过模型压缩,可以显著减少模型的参数数量和计算量,使得模型更适合在资源受限的环境中快速运行。

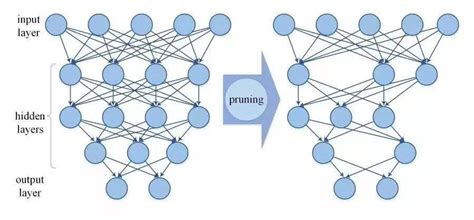

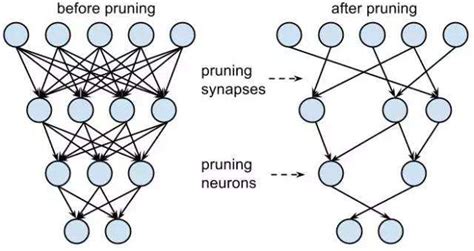

目前,主流的模型压缩技术包括剪枝、量化、低秩分解等。剪枝技术通过去除冗余的神经元或连接,从而达到减少参数的目的;量化则是将浮点数权重映射到低精度格式,从而降低存储需求并加速计算;而低秩分解则通过矩阵分解来简化复杂的层结构,以此来提高效率。

这些技术不仅有助于提升推理速度,还可以减轻存储负担,允许更广泛的硬件部署。与此同时,研究者们也在探索结合多种压缩技术,实现更高效的混合应用,以满足日益增长的现场需求。通过对这些方法的深入了解与实践应用,我们可以不断推动人工智能系统向更高效、更经济的发展方向迈进。

优化策略的重要性分析

在当今人工智能领域,优化策略的实施对于提升模型性能和资源利用率至关重要。随着大数据时代的到来,算法复杂度与数据规模持续上升,单纯依赖硬件的提升已无法满足不断增长的计算需求。因此,优化策略的合理应用不仅可以提升训练与推理速度,还可以有效降低成本。

实施优化策略,可以帮助研究者和开发者更好地平衡性能与资源之间的关系,从而更合理地配置计算资源。

通过有效的参数调整、算子重排及量化等方法,我们可以消除模型中的冗余计算环节,减少不必要的运算开销,从而达到加速模型运行速度的效果。此外,优化策略不仅限于模型内部结构,还应关注数据预处理、特征选择等前期步骤,以保证整个流水线的高效运行。

研究表明,在特定应用场景下,通过综合运用多种优化手段,可以显著提高模型的准确性和响应速度。因此,将优化策略作为一种系统性的思维模式融入到AI开发过程中,将是推动人工智能技术进步的重要途径。

模型压缩对运行效率的提升

模型压缩是提升人工智能模型运行效率的重要手段之一。通过精简模型的参数和结构,压缩技术能够在保持模型性能的前提下,显著降低计算负担和存储需求。这一过程通常涉及权重剪枝、量化和知识蒸馏等方法,能够有效减少冗余信息,使得模型在处理复杂任务时更加高效。

例如,权重剪枝通过去掉对最终输出影响较小的参数,从而减小模型的大小,这不仅提高了推理速度,也降低了内存占用。量化则是将浮点数参数转换为更低位数的整数,这一转换使得模型在运行时所需进行的数据处理量大幅度减少,尤其适用于移动设备和边缘计算环境。

此外,结合知识蒸馏技术,可以利用一个大规模、高性能的“教师”模型去指导一个更小而高效的“学生”模型。通过这种方式,学生模型能够学习到教师模型的重要特征,从而实现性能优化。同时,由于学生模型占用更少的计算资源,它可以更快速地满足实时应用需求。

综上所述,利用这些先进的模型压缩技术,不仅提升了AI系统在实际应用中的运行效率,还为用户提供了更加高效、经济的解决方案。这些策略使得人工智能技术能够更广泛地适应各类应用场景,从而满足日益增长的市场需求。

优化策略在资源消耗中的作用

在人工智能模型的应用中,资源消耗是一个不可忽视的重要因素。优化策略旨在通过对模型的结构和计算流程进行精细调整,从而有效降低资源的占用。在深度学习领域,复杂的模型往往需要大量的计算资源来实现高效的性能,但这些资源开销不仅增加了运行成本,也限制了模型的普及和应用。

通过引入优化策略,例如模型剪枝、量化和知识蒸馏等,可以显著减少不必要的参数,压缩模型体积,同时保持或甚至提升其性能。这些方法通过消除冗余信息和简化计算,让模型更加轻量化,进而降低内存和计算能力消耗。例如,剪枝技术可以识别并移除对最终输出贡献不大的神经元,使得网络结构更加简洁,有效缩减了运行时所需的计算量。

此外,优化策略还可以在推理过程中采用动态计算图,根据输入数据灵活调整运算路径,这样不仅提高了执行效率,也确保了资源使用的灵活性。结合适当的软件框架与硬件加速技术(如GPU、TPU),优化策略能够充分发挥其潜力,为应用提供快速响应与高效能。

综上所述,通过实施合适的优化策略,可以有效降低人工智能模型在使用中的资源消耗,为大规模应用奠定坚实基础。这不仅有助于提高系统整体效率,还有助于促进可持续发展目标,减轻运算负担对环境造成的影响。

结合案例分析模型压缩与优化效果

在当前的人工智能应用场景中,模型压缩与优化技术的有效结合,已经在多个真实案例中体现出其显著效果。例如,在图像识别的任务中,一家知名科技公司通过应用深度学习模型,该模型初始参数达到几千万,但在经过剪枝技术和量化优化后,参数数量减少到仅剩几百万。经过这种压缩处理后,不仅显著降低了模型的存储需求,也使得其推理速度提升了近50%,确保了实时处理的需求得以满足。

另一个例子是自然语言处理领域,一项研究展示了一种新型的知识蒸馏方法。通过将大型预训练模型所学到的知识转移给一个轻量级模型,在保持较高准确率的基础上,有效减少了计算资源的消耗。这种优化策略使得轻量级模型在移动设备上能够顺畅运行,大大提升了用户体验。

这些实例清楚地表明,结合先进的模型压缩与优化策略,不仅能有效增强AI算法的性能,还能有效应对资源限制带来的挑战。未来,随着对AI性能要求日益提高,该领域还将继续创新,推动智能应用的发展。

未来发展趋势与挑战

随着人工智能技术的快速发展,模型压缩与优化正面临着新的机遇与挑战。从技术层面看,当前进一步提高模型效率的需求愈发迫切。尤其在边缘计算和物联网的发展背景下,要求模型不仅要具备强大的性能,同时还需适应资源有限的环境,推动了轻量化和高效化的压缩技术的研究。

然而,随着模型压缩方法的日益增多,各种新技术也相继涌现,这使得开发者在选择合适策略时面临艰巨的挑战。除了技术本身,这一领域还需要关注伦理和隐私保护的问题。在压缩过程中,一些信息可能会被丢弃,这个过程需谨慎,以免影响模型决策的公平性。

此外,如何在保证性能的前提下进行有效的压缩也是一个重要课题。未来,研究者们将需要探索更加智能化的优化策略,通过自适应算法和深度学习相结合的方法,实现更高效的数据利用和处理速度。整体来看,尽管面临诸多挑战,但通过持续创新与合作,可以有望推动模型压缩与优化技术更为广泛的发展应用。

研究者与开发者的实用建议

在当前人工智能领域,模型压缩和优化策略的实施已成为提升模型效率的重要途径。研究者和开发者在进行模型压缩时,首先应深入了解不同压缩技术的适用场景,例如剪枝、量化和知识蒸馏等。这些技术各有其特点,选择合适的方法能显著提高模型性能并减少内存占用。对于初创项目或资源有限的团队,可以优先尝试简单有效的技术,如剪枝,以减少模型体积,同时注意保持精度。

此外,优化策略同样不可忽视。利用早期终止、学习率调度等技巧,可以在训练中提高效率,节省计算资源。同时,引入集成学习或迁移学习等方法,也能有效提升模型的泛化能力和鲁棒性。开发者在实现优化时,应密切关注资源利用情况,通过监控工具实时分析性能指标,以便及时调整策略。

最后,持续学习和跟踪最新研究成果是必不可少的。通过关注学术论文、参加相关研讨会及技术社区,与同行交流经验,不断积累知识,将为解决未来挑战打下坚实基础。

结论

通过对模型压缩及优化策略的深入探讨,我们可以清楚地看到,这些技术在提升人工智能模型的效率与性能方面具有重要意义。模型压缩不仅能够有效减少模型的规模和计算资源消耗,还可以在某些情况下改善推理速度。通过合理实施优化策略,我们能够最大限度地发挥现有资源的效用,从而在保持模型性能的同时,满足日益严峻的实时响应需求。尽管当前模型压缩与优化技术已经取得了一定进展,但仍面临一些挑战,包括如何在保证模型准确度的前提下进行有效压缩,以及如何适应不断变化的应用场景。因此,研究者和开发者需持续关注这一领域的新技术和趋势,以灵活应对不断增长的应用需求和技术挑战。在未来,结合实际案例进行研究与实践,将有助于推动这一领域的发展,并实现更高效、更智能的人工智能系统。

常见问题

什么是模型压缩?

模型压缩是指通过减少模型大小或减少计算需求来提高人工智能模型效率的技术。这可以通过剪枝、量化和知识蒸馏等方法实现。

模型压缩对模型性能有影响吗?

通常情况下,模型压缩可能会导致轻微的性能下降,但通过合理的策略选择和实施,可以在保持性能的同时显著降低计算资源的消耗。

优化策略有什么作用?

优化策略旨在提高算法在执行过程中的效率,降低资源消耗,从而提升人工智能系统的整体性能。这些策略可以包括算法改进、代码优化和硬件加速等。

怎样选择合适的优化策略?

选择合适的优化策略取决于具体应用场景和目标。研究者应分析现有问题、资源限制以及所需性能指标,从而制定相应方案。

常见的模型压缩技术有哪些?

常见的模型压缩技术包括权重剪枝、低秩分解、网络量化和知识蒸馏等,这些技术能够有效地减小模型大小,提高运行效率。

哪些领域特别适合应用模型压缩与优化?

模型压缩与优化在需要实时响应或资源有限的领域表现尤为突出,如移动设备、物联网设备、自动驾驶辆以及智能家居系统等。

712

712

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?