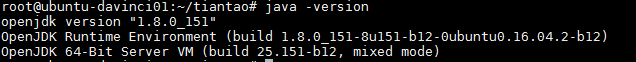

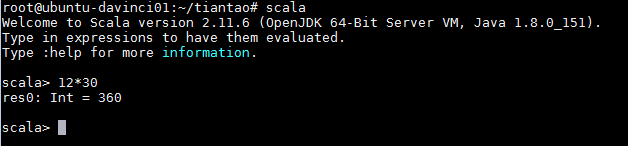

1.首先检查是否安装了java和scala

可以通过java -version检查java是否成功安装

可见通过检测scala 检查scala是否成功安装

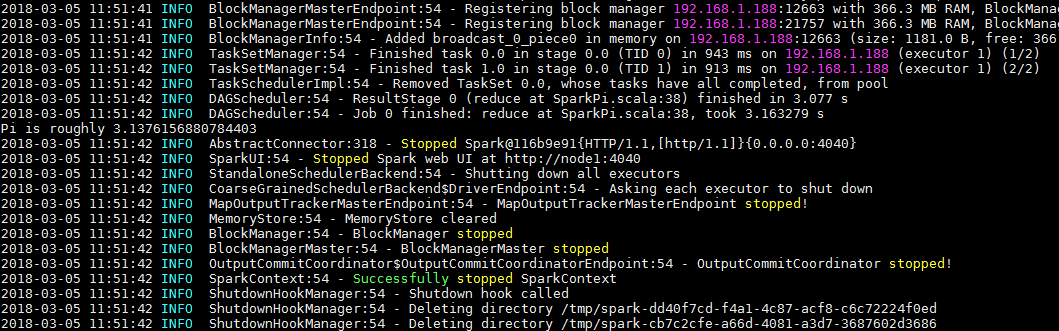

下载spark

wget http://mirror.bit.edu.cn/apache/spark/spark-2.3.0/spark-2.3.0-bin-hadoop2.7.tgz

解压tar -zxvf spark-2.3.0-bin-hadoop2.7.tgz

手动新建三个配置文件

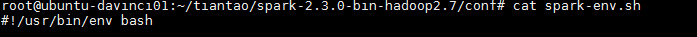

cd conf/

cp spark-env.sh.template spark-env.sh

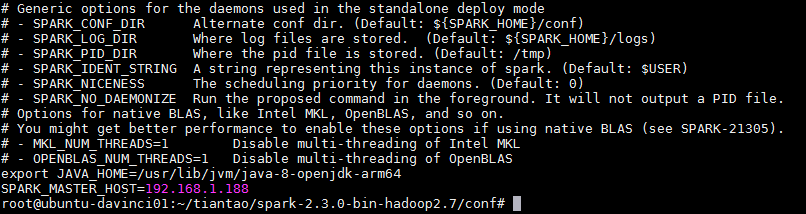

cp spark-defaults.conf.template spark-defaults.conf

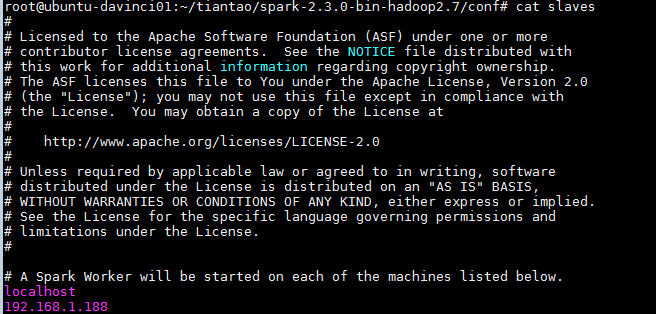

cp slaves.template slaves

本机ip是192.168.1.188。三个配置文件的内容分别如下:

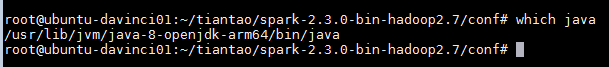

注意spark-env.sh中java_home设置的路径和which java 得到的路径的区别

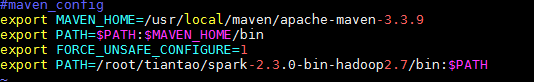

针对etc/profile文件我只添加了spark的路径并没有修改别的

通过./sbin/start-all.sh

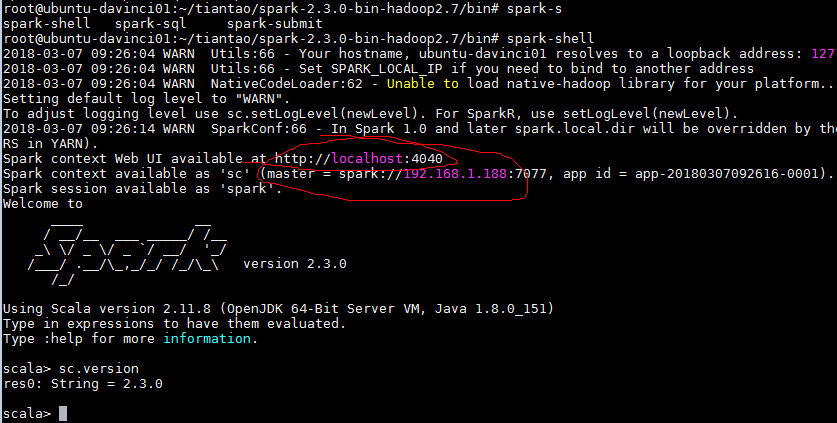

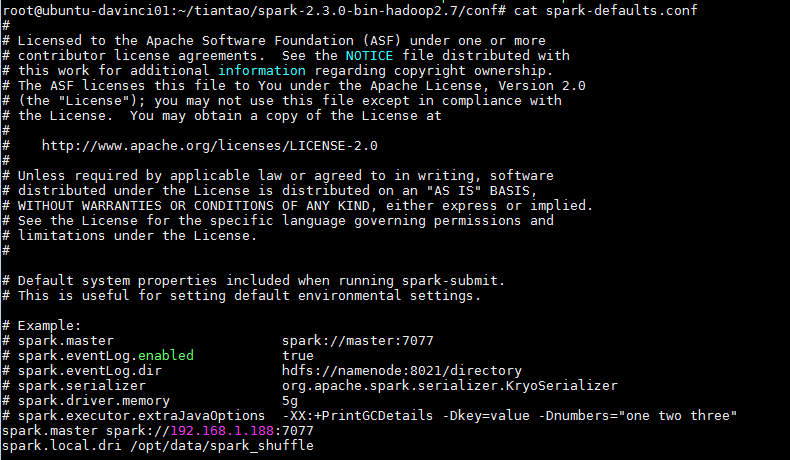

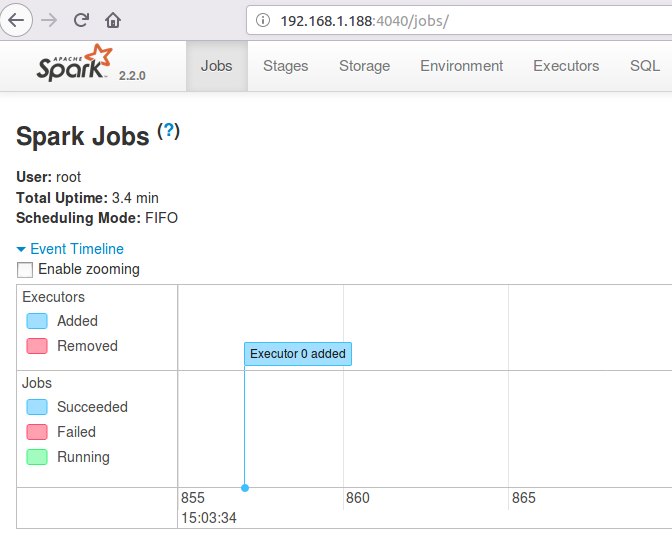

通过spark-shell 检查spark是否运行正常

从上图中可以看到spark的网页是http:localhost:4040

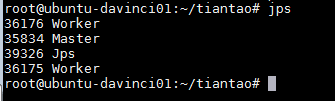

通过jps查看worker和master

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?