搭建过程

具体的步骤,笔者就不做过多介绍了,只是记录下,遇到的问题

安装的步骤,有兴趣的可参考

安装结果

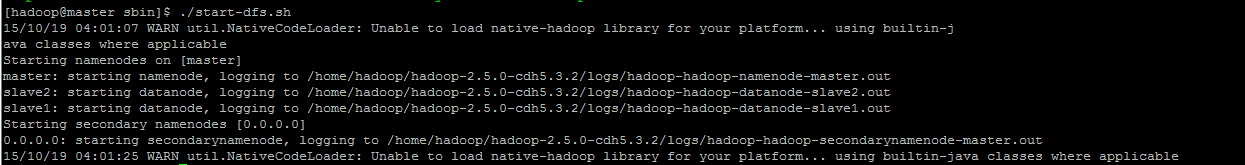

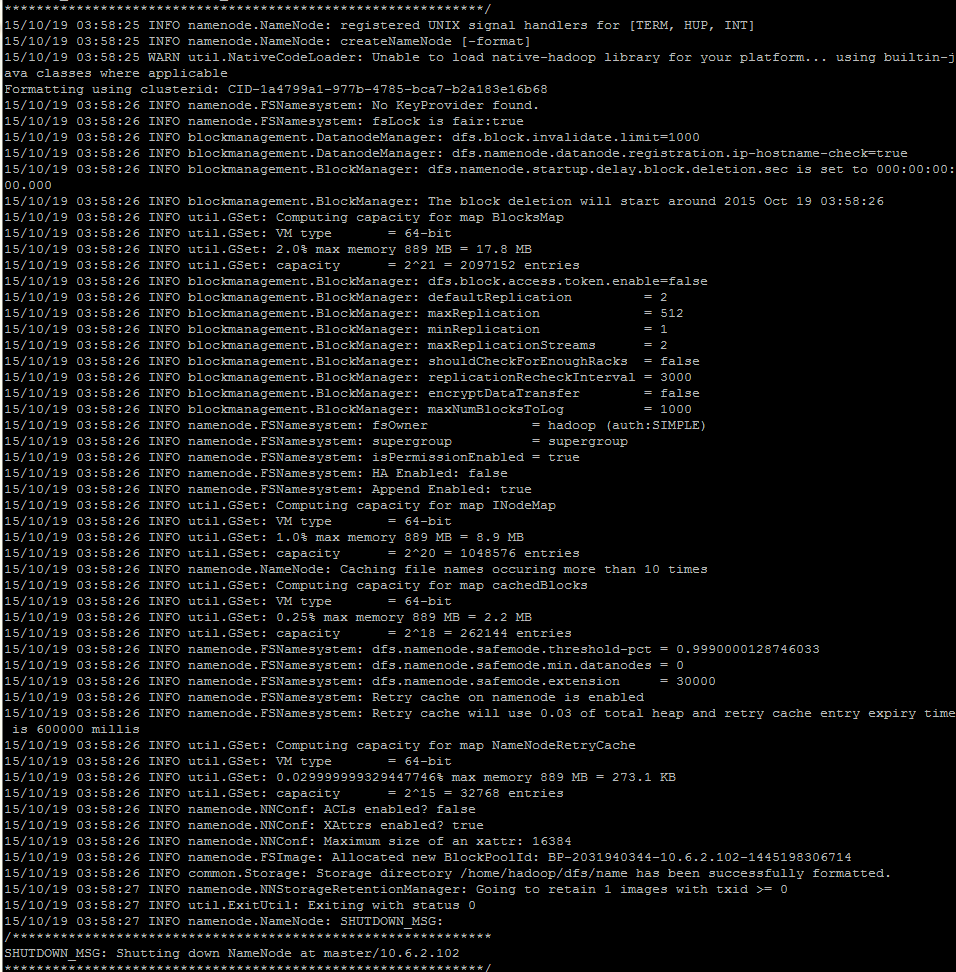

格式化成功:

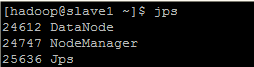

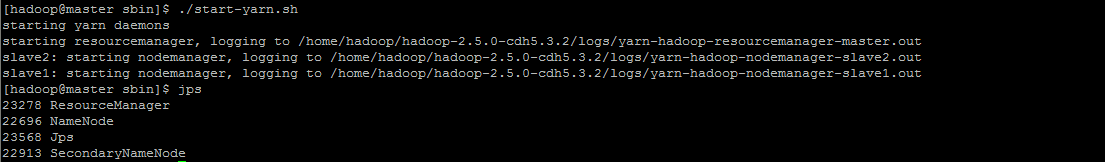

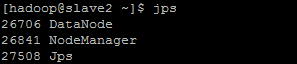

节点进程成功启动:

Hadoop-2.5.0-cdh5.2.0 问题

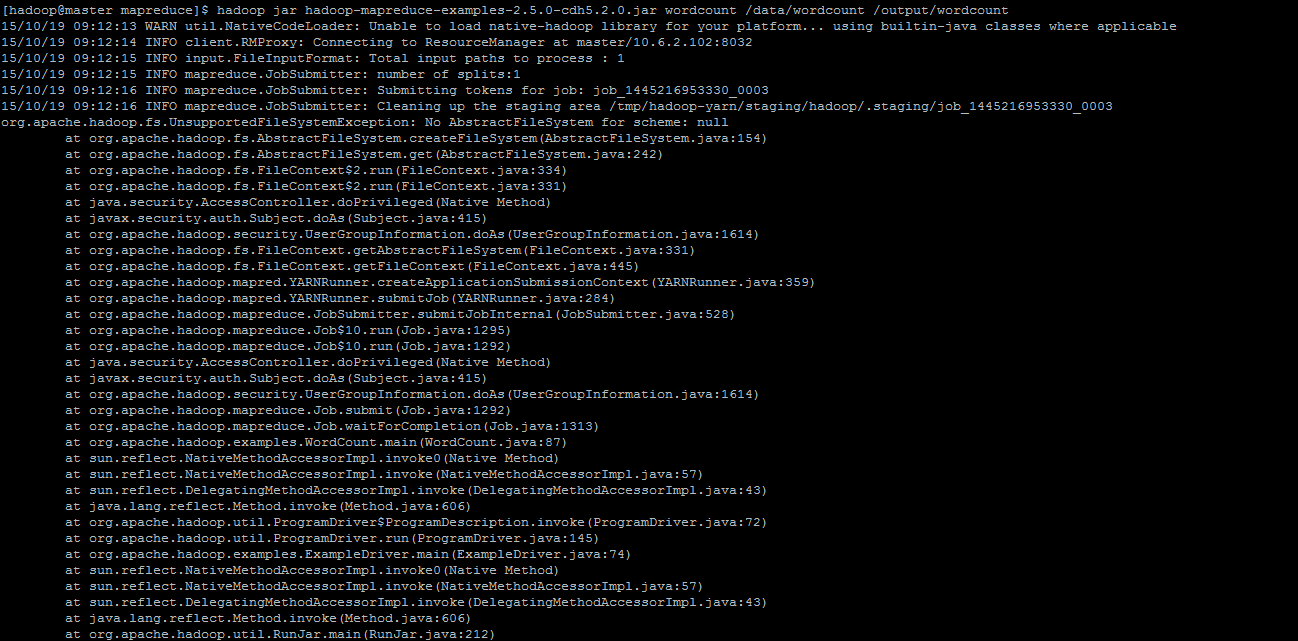

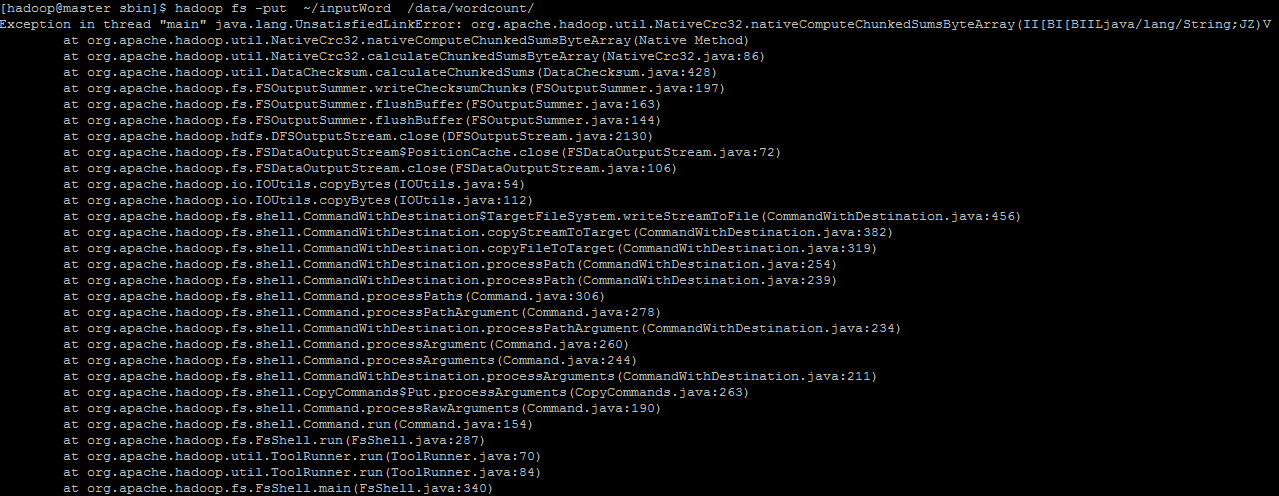

什么库文件的 Warning 都没啥问题了,进程也都OK,但是最后一个步骤居然崩了!

无法解决!!!望大神指点一二….

认真检查配置,然后重新安装,关键是不管它,一天之后,居然成功了:

Hadoop-2.5.0-cdh5.3.2 问题

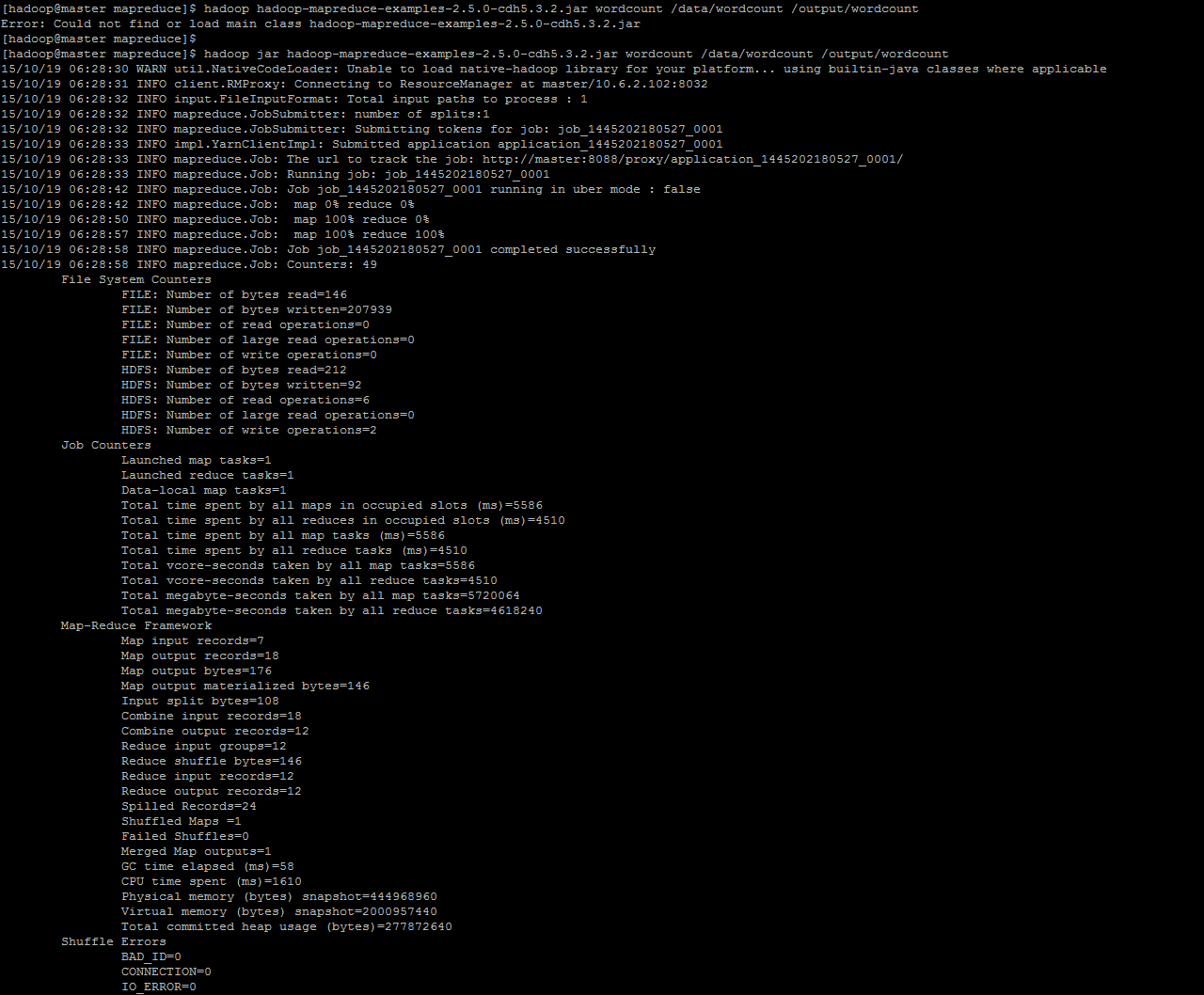

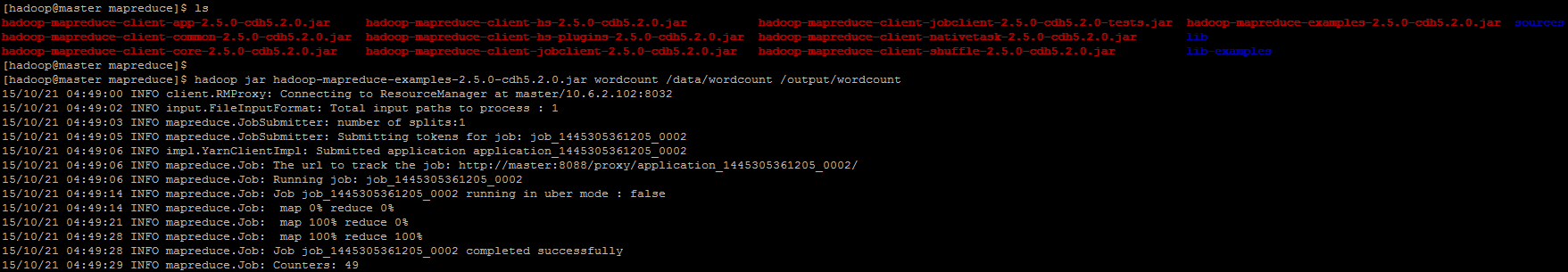

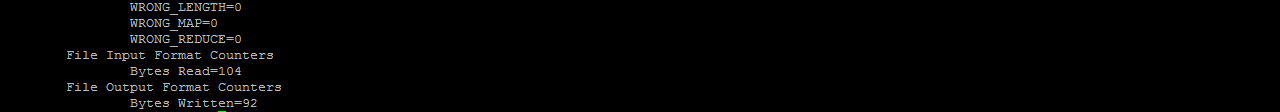

自带的 wordcount 程序的运行结果:

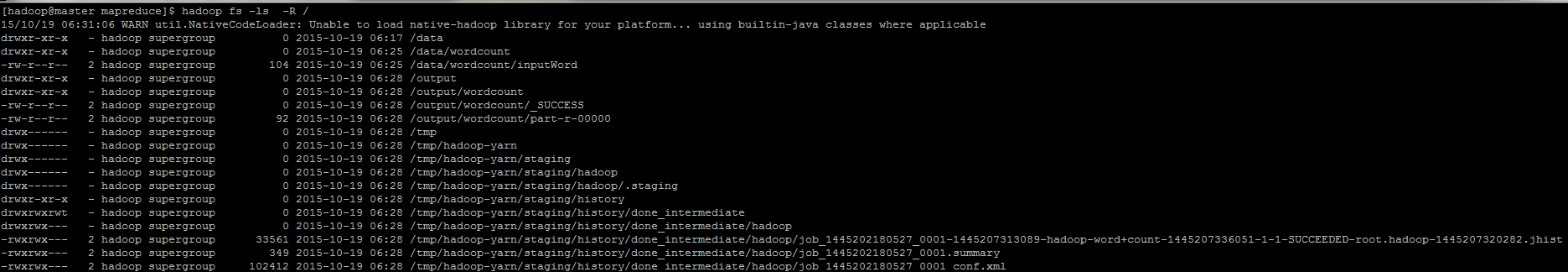

查看 hdfs 上的文件:

这里面最大的问题是,本地库文件!!!还是那句话,没法编译….Hadoop-2.5.0-cdh5.2.1以及Hadoop-2.5.0-cdh5.3.2 获取源码及编译(失败)

然后本采用 Hadoop-2.5.0-cdh5.2.0 获取源码及编译 的方法,结果就是下面这种惨样!!!

说明了不同版本(虽然都是基于 hadoop 2.5.0,仅cdh 版本不一致)之间 hadoop 的编译结果是不能直接套用的!

后来笔者也解决了编译的问题,有兴趣详见:Hadoop-2.5.0-cdh5.3.2 获取源码及编译, 同时也提供了已经编译好的库文件压缩包下载地址。

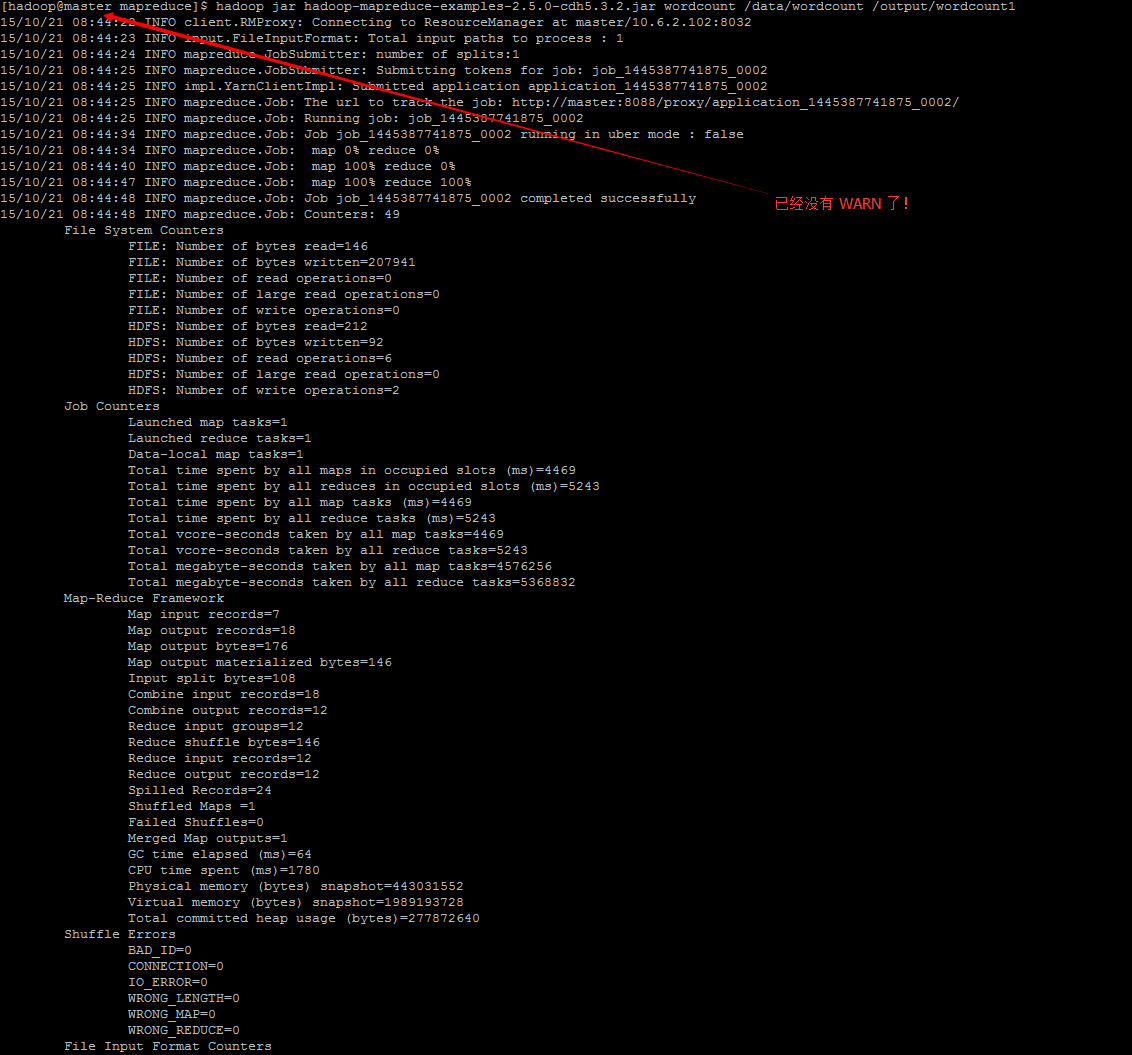

将编译之后的本地库文件放入 /lib/native,然后问题解决:

最终运行程序的命令(已经省略了很多步骤及命令):

hadoop jar hadoop-mapreduce-examples-2.5.0-cdh5.3.2.jar wordcount /data/wordcount /output/wordcount

4701

4701

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?