1、首先下载更新apt—get,sudo apt-get update 后边会用到这个命令下载软件

2、ssh免密登录

(1)执行ssh-keygen产生秘钥将秘钥写到文件id_rsa.pub中

(2)执行cat ./id_rsa.pub >> ./authorized_keys

(3)测试ssh localhost如果成功那么恭喜你,如果还需要密码则很可能是文件以及文件夹权限问题

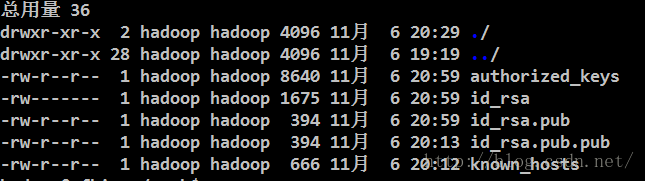

首先将.ssh目录权限是755,id_rsa的权限设置为600,其余文件权限是644.如下图所示

然后重试ssh localhost成功。

3、设置root用户密码, sudo passwd root然后键入自己的密码。用root用户登录su root,操作这样比较方便。

4、Hadoop 可以在单节点上以伪分布式的方式运行,Hadoop 进程以分离的 Java 进程来运行,节点既作为 NameNode 也作为 DataNode,同时,读取的是 HDFS 中的文件。

Hadoop 的配置文件位于 /usr/local/hadoop/etc/hadoop/ 中,伪分布式需要修改2个配置文件 core-site.xml 和 hdfs-site.xml 。Hadoop的配置文件是 xml 格式,每个配置以声明 property 的 name 和 value 的方式来实现。

(1)修改配置文件 core-site.xml

在<configuretion> </configuration>中间添加如下配置

<span style="white-space:pre"> </span><property>

<name>hadoop.tmp.dir</name>

<value>file:/usr/local/hadoop/tmp</value>

<description>Abase for other temporary directories.</description>

</property>

<property>

<name>fs.defaultFS</name>

<value>hdfs://localhost:9000</value>

</property>

<span style="white-space:pre"> </span><property>

<name>dfs.replication</name>

<value>1</value>

</property>

<property>

<name>dfs.namenode.name.dir</name>

<value>file:/usr/local/hadoop/tmp/dfs/name</value>

</property>

<property>

<name>dfs.datanode.data.dir</name>

<value>file:/usr/local/hadoop/tmp/dfs/data</value>

</property>5、 配置完成后,执行 NameNode 的格式化:

进入bin目录执行./bin/hdfs namenode -format。接着开启 NameNode 和 DataNode 守护进程。

进入sbin目录执行start-dfs.sh

/hdfs namenode -format

-m hadoop -s /bin/bash

7707

7707

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?