1、首先下载spark软件,如果使用的是CDH版本,软件提供如下连接

链接: https://pan.baidu.com/s/1vQJiQ_-S7ZKIIYq98-9Bmg 提取码: v4rj

2、将软件解压到对应的目录

/Users/admin/Documents/softwares/spark-2.6.0-bin-2.6.0-cdh5.16.2/

3、配置spark相应的环境变量

sudo vi ~/.bash_profile

4、相应环境变量如下

export SPARK_HOME=/Users/admin/Documents/softwares/spark-2.6.0-bin-2.6.0-cdh5.16.2

export PYTHONPATH=$SPARK_HOME/python:$SPARK_HOME/python/lib/py4j-0.10.7-src.zip:$PYTHONPATH

export PYTHONPATH=$SPARK_HOME/python:$PYTHONPATH

5、将/Users/admin/Documents/softwares/spark-2.6.0-bin-2.6.0-cdh5.16.2/python文件夹下面的 pyspark文件夹拷贝到激活的环境中/Users/admin/opt/anaconda3/envs/recommend_data/lib/python3.6/site-packages/

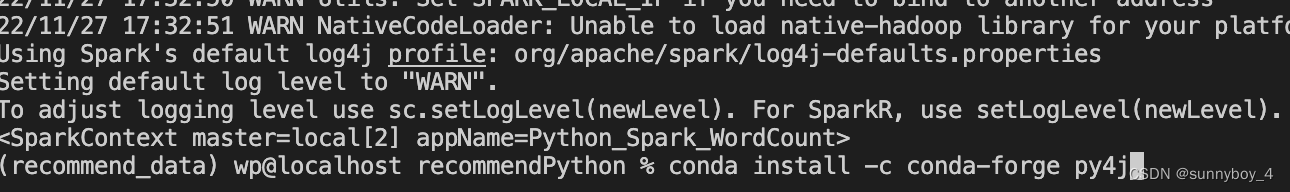

5.1、配置成功后演示代码

from pyspark import SparkContext,SparkConf

spark_conf = SparkConf().setAppName('Python_Spark_WordCount').setMaster('local[2]')

#使用spark最原始的API进行数据分析

sc = SparkContext(conf=spark_conf)

sc.setLogLevel('WARN')

print (sc)

以上环境参数就配齐了

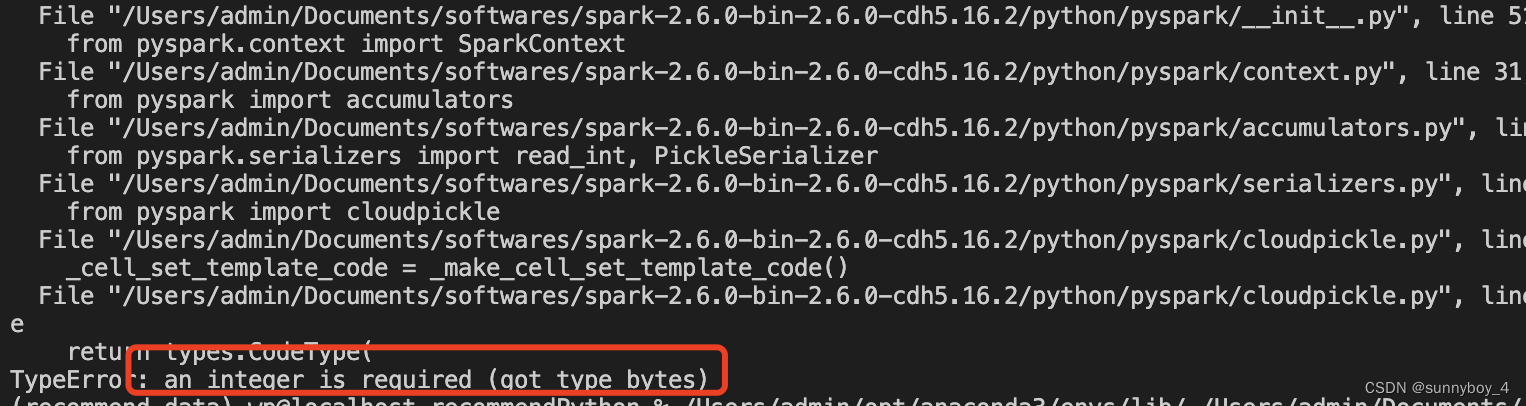

6、如果有如下报错请根据下面的方式解决

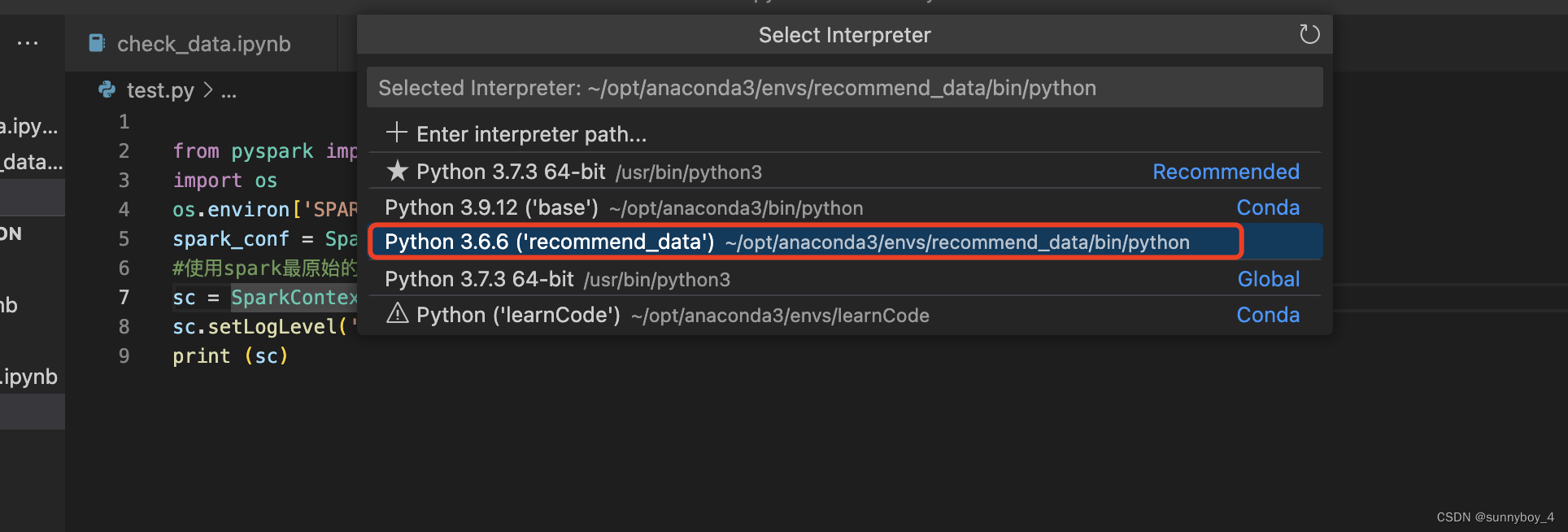

6.1、版本不兼容,考试版本为3.9.12太新了,我给他降低到了3.6.6

conda create -n recommend_data python=3.6.6

conda activate recommend_data

vscode切换环境

6.2、还有报错 ModuleNotFoundError: No module named ‘py4j’

由于没有找打这个模块就直接通过conda安装一个

conda install -c conda-forge py4j

1077

1077

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?