配置白名单

(1)在NameNode的/opt/module/hadoop-2.7.2/etc/hadoop目录下创建dfs.hosts文件,

添加如下主机名称(不添加hadoop105)

hadoop102

hadoop103

hadoop104

(2)在NameNode的hdfs-site.xml配置文件中增加dfs.hosts属性

<property>

<name>dfs.hosts</name>

<value>/opt/module/hadoop-2.7.2/etc/hadoop/dfs.hosts</value>

</property>

(3)配置文件分发

xsync hdfs-site.xml

xsync dfs.hosts

(4)刷新NameNode

hdfs dfsadmin -refreshNodes

(5)更新ResourceManager节点

yarn rmadmin -refreshNodes

如果更新后,还存在,手动停掉hadoop105的nodemanager

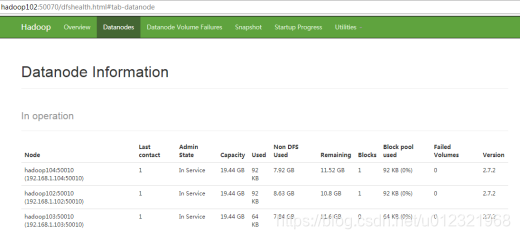

(6)在web浏览器上查看

黑名单退役

在黑名单上面的主机都会被强制退出

在操作以下案例前,先将hadoop105恢复为正常状态(修改hdfs-site,删除dfs.hosts最后同步文件并刷新节点)

1.在NameNode的/opt/module/hadoop-2.7.2/etc/hadoop目录下创建dfs.hosts.exclude文件,

添加如下主机名称(要退役的节点)

hadoop105

2.在NameNode的hdfs-site.xml配置文件中增加dfs.hosts.exclude属性

<property>

<name>dfs.hosts.exclude</name>

<value>/opt/module/hadoop-2.7.2/etc/hadoop/dfs.hosts.exclude</value>

</property>

同步上面修改的两个文件xsync

3.刷新NameNode、刷新ResourceManager

hdfs dfsadmin -refreshNodes

yarn rmadmin -refreshNodes

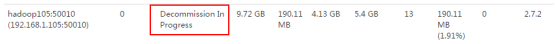

4.检查Web浏览器,退役节点的状态为decommission in progress(退役中),说明数据节点正在复制块到其他节点,如图所示

5. 等待退役节点状态为decommissioned(所有块已经复制完成),停止该节点及节点资源管理器。注意:如果副本数是3,服役的节点小于等于3,是不能退役成功的,需要修改副本数后才能退役,如图所示

sbin/hadoop-daemon.sh stop datanode

stopping datanode

sbin/yarn-daemon.sh stop nodemanager

6.如果数据不均衡,可以用命令实现集群的再平衡

sbin/start-balancer.sh

378

378

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?