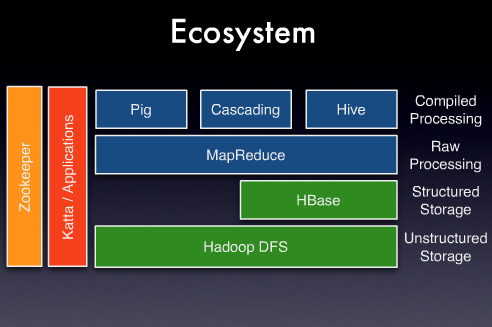

Hadoop是一个由Apache基金会所开发的分布式系统基础架构。用户可以在不了解分布式底层细节的情况下,开发分布式程序。充分利用集群的威力进行高速运算和存储。Hadoop的框架最核心的设计就是:HDFS和MapReduce。HDFS为海量的数据提供了存储,则MapReduce为海量的数据提供了计算。作为一种分布式数据和计算的框架,Hadoop很擅长存储大量的半结构化的数据集。但是只擅长处理“线下”数据。

HDFS (Hadoop Distributed File System): 存储系统,主要支持以流(stream)的形式访问写入的大型文件。

MapReduce:编程模型,将多数据来源整合读写问题进行抽象,转换为计算一个由成对键、值(key,value)组成的数据集。计算由两部分组成:Map和Reduce。

HBase(Hadoop Database):Hadoop对随机读写并不有好,而HBase就是为了解决这个问题。HBase是一个可伸缩的(scalable)分布式存储系统,利用HBase技术可在廉价PC Server上搭建起大规模结构化存储集群。该技术来源于 Fay Chang 所撰写的Google论文“Bigtable: A Distributed Storage System for Structured Data”。就像Bigtable利用了Google文件系统(File System)所提供的分布式数据存储一样,HBase在Hadoop之上提供了类似于Bigtable的能力。H

本文详细介绍了Hadoop生态系统中的关键组件,包括HDFS作为分布式存储系统,MapReduce作为编程模型,HBase解决Hadoop的随机读写问题,Hive提供SQL接口简化数据分析,以及Pig和Mahout在数据处理和挖掘中的作用。此外,还提及了Apache Storm和Spark等其他处理框架,帮助理解Hadoop集群中各种工具的定位和应用场景。

本文详细介绍了Hadoop生态系统中的关键组件,包括HDFS作为分布式存储系统,MapReduce作为编程模型,HBase解决Hadoop的随机读写问题,Hive提供SQL接口简化数据分析,以及Pig和Mahout在数据处理和挖掘中的作用。此外,还提及了Apache Storm和Spark等其他处理框架,帮助理解Hadoop集群中各种工具的定位和应用场景。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

455

455

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?