数学模型:

y^=w0+w1x1+...+wpxp

其中向量 w=(w1,w2,...wp) 为 coef_ , w0 为 intercept_

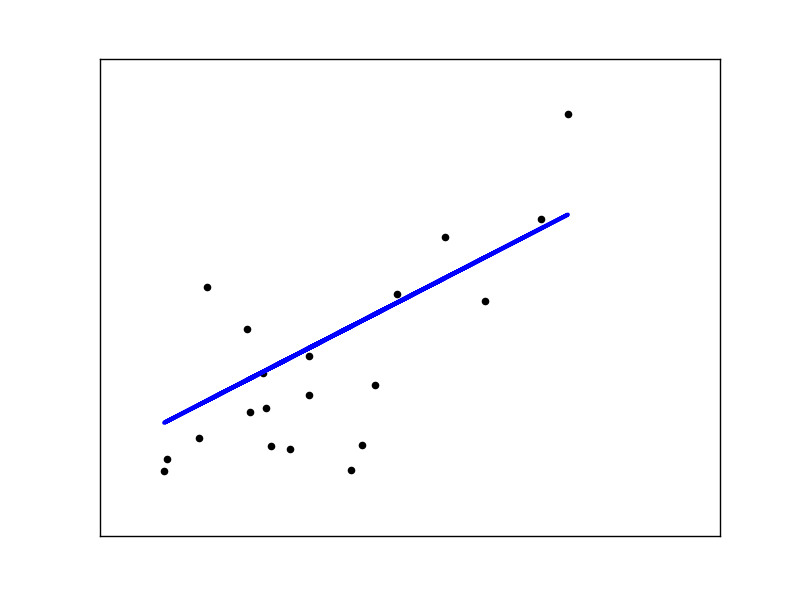

1.1.1 普通最小二乘法(OLS)

用回归系数 w=(w1,w2,...wp) 来拟合线性模型,使得残差平方和(RSS)最小。用数学形式表示:

minw∥xw−y∥22

线性回归(LR)将通过 fit 方法,来拟合数组 x 、y,回归系数会存储在成员 w coef_

>>> from sklearn import linear_model

>>> clf = linear_model.LinearRegression()

>>> clf.fit([[0,0],[1,1],[2,2]],[0,1,2])

LinearRegression(copy_X=True, fit_intercept=True, n_jobs=1, normalize=False)

>>> clf.coef_

array([ 0.5, 0.5])普通最小二乘法的参数估计依赖于模型中各项的独立性。如果在线性回归模型中的解释变量之间存在精确相关关系或高度相关关系,普通最小二乘估计对观察项的随机误差将十分敏感,可能出现多重共线问题。

1.1.1.1 普通最小二乘法的复杂度

这种方法通过

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?