1、auc含义

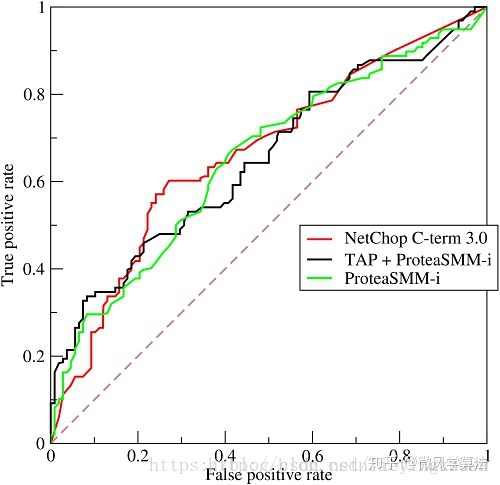

AUC(Area under curve)是机器学习常用的二分类评测手段,直接含义是ROC曲线下的面积,如下图

- 表中列代表预测分类,行代表实际分类:

- 实际1,预测1:真正类(tp)

- 实际1,预测0:假负类(fn)

- 实际0,预测1:假正类(fp)

- 实际0,预测0:真负类(tn)

- 真实负样本总数=n=fp+tn

- 真实正样本总数=p=tp+fn

- 在第一张图中,

- 横坐标false positive rate 代表假正类率,由fp/n计算得到,

- 意为 在实际负样本中出现预测正样本的概率。

- 纵坐标true positive rate 代表真正类率,由tp/p计算得到,

- 意为 在实际正样本中出现预测正样本的概率。

2、统计排序值计算auc

2.1、计算公式

● 对预测概率从高到低排序

● 对每一个概率值设一个rank值(最高的概率的rank为n,第二高的为n-1)

● rank实际上代表了该score(预测概率)超过的样本的数目,(预测概率相等时,取均值)

为了求的组合中正样本的score值大于负样本,如果所有的正样本score值都是大于负样本的,那么第一位与任意的进行组合score值都要大,我们取它的rank值为n,但是n-1中有M-1是正样例和正样例的组合这种是不在统计范围内的(为计算方便我们取n组,相应的不符合的有M个),所以要减掉,那么同理排在第二位的n-1,会有M-1个是不满足的,依次类推,故得到后面的公式M*(M+1)/2,我们可以验证在正样本score都大于负样本的假设下,AUC的值为1

● 除以M*N

2.2、python实现

import numpy as np

from sklearn.metrics import roc_curve

from sklearn.metrics import auc

#---自己按照公式实现

def auc_calculate(labels,preds,n_bins=100):

postive_len = sum(labels)

negative_len = len(labels) - postive_len

total_case = postive_len * negative_len

pos_histogram = [0 for _ in range(n_bins)]

neg_histogram = [0 for _ in range(n_bins)]

bin_width = 1.0 / n_bins

for i in range(len(labels)):

nth_bin = int(preds[i]/bin_width)

if labels[i]==1:

pos_histogram[nth_bin] += 1

else:

neg_histogram[nth_bin] += 1

accumulated_neg = 0

satisfied_pair = 0

for i in range(n_bins):

satisfied_pair += (pos_histogram[i]*accumulated_neg + pos_histogram[i]*neg_histogram[i]*0.5)

accumulated_neg += neg_histogram[i]

return satisfied_pair / float(total_case)

if __name__ == '__main__':

y = np.array([1,0,0,0,1,0,1,0,])

pred = np.array([0.9, 0.8, 0.3, 0.1,0.4,0.9,0.66,0.7])

fpr, tpr, thresholds = roc_curve(y, pred, pos_label=1)

print("-----sklearn:",auc(fpr, tpr))

print("-----py脚本:",auc_calculate(y,pred))3、统计正负样本计算auc

3.1、计算公式

在有M个正样本,N个负样本的数据集里。一共有M*N对样本(一对样本即,一个正样本与一个负样本)。统计这M*N对样本里,正样本的预测概率大于负样本的预测概率的个数。

即:给定正样本M个,负样本N个,以及他们的预测概率(0-1)之间,那么auc的含义就是所有穷举所有的正负样本对,如果正样本的预测概率大于负样本的预测概率,那么就+1;如果如果正样本的预测概率等于负样本的预测概率,那么就+0.5, 如果正样本的预测概率小于负样本的预测概率,那么就+0;最后把统计处理的个数除以M×N就得到我们的AUC,公式描述如下:

3.2、python实现

def AUC(label, pre):

"""

适用于python3.0以上版本

"""

#计算正样本和负样本的索引,以便索引出之后的概率值

pos = [i for i in range(len(label)) if label[i] == 1]

neg = [i for i in range(len(label)) if label[i] == 0]

auc = 0

for i in pos:

for j in neg:

if pre[i] > pre[j]:

auc += 1

elif pre[i] == pre[j]:

auc += 0.5

return auc / (len(pos)*len(neg))

if __name__ == '__main__':

label = [1,0,0,0,1,0,1,0]

pre = [0.9, 0.8, 0.3, 0.1, 0.4, 0.9, 0.66, 0.7]

print(AUC(label, pre))

from sklearn.metrics import roc_curve, auc

fpr, tpr, th = roc_curve(label, pre , pos_label=1)

print('sklearn', auc(fpr, tpr))

参考

https://zhuanlan.zhihu.com/p/84035782 (auc原理及计算逻辑)

https://blog.csdn.net/lieyingkub99/article/details/81266664 (包含详细的实例)

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?